사상 리더

실용적인 방어 가능한 LLM 출력을 위한 플레이북

대부분의 기업용 GenAI 배포에는 조용한 가정 하나가 깔려 있다: 출력이 올바르게 보이면, 그것은 올바르다. 저위험 환경에서는 합리적인捷徑이다. 하지만 의료, 금융, 제약, 품질 보증과 같은 규제 산업에서는 잠재적인 책임이다.

LLM 출력이 임상적 결정을 影響하거나 금융 기록, 또는 규제 문서에 영향을 미칠 때, 유창성은 더 이상 신뢰성을 대신할 수 없다. 그리고 감리인, 규제 기관, 또는 법률 팀이 어떤 데이터를 사용했는지, 어떤 규칙을 적용했는지,誰が 승인했는지 물었을 때, “모델이 그렇게 말했다”는 아무도 승인할 수 없는答案이다.

이것은 대부분의 GenAI 팀이 설계하지 않는 책임 격차이다. 여기에서는 어떻게 이를 메우는지에 대해 설명한다.

“올바르게 보인다”는 잘못된 표준

전통적인 AI 평가에는 정확도, 대기 시간, 비용이 포함된다. 이들은 중요하다. 하지만 규제 환경에서는 다른 세 축이 필요하다: 감리 가능성.

EU AI 법률은 현재 시행 중이며, 고위험 AI 시스템은 기술 문서화, 추적 로그, 및 전체 수명 주기 동안의 인간 감시 증거를 유지해야 한다. FDA의 제1차 지침 초안은 생명 과학 분야에서도 같은 방향을 나타낸다. 이러한 프레임워크는 유창성을 기준으로 평가하지 않는다. 재구성, 검사, 및 방어 가능한 시스템이 필요하다.

방어 가능한 LLM 출력은 검증 가능한 증거 사슬을 통해 추적할 수 있는 출력이다: 어떤 데이터를 사용했는지, 어떤 제약이 형성했는지,誰가 검토했는지, 그리고 미래의 검사 위해 무엇을 보관했는지. 이러한 사슬이 없으면, 심지어 올바른 출력이라도 방어할 수 없다.

이것은 규제 환경에서 AI의 “제작 준비”가 실제로 무엇을 의미하는지 다시 정의한다.

감리 준비 GenAI의 4가지 기둥

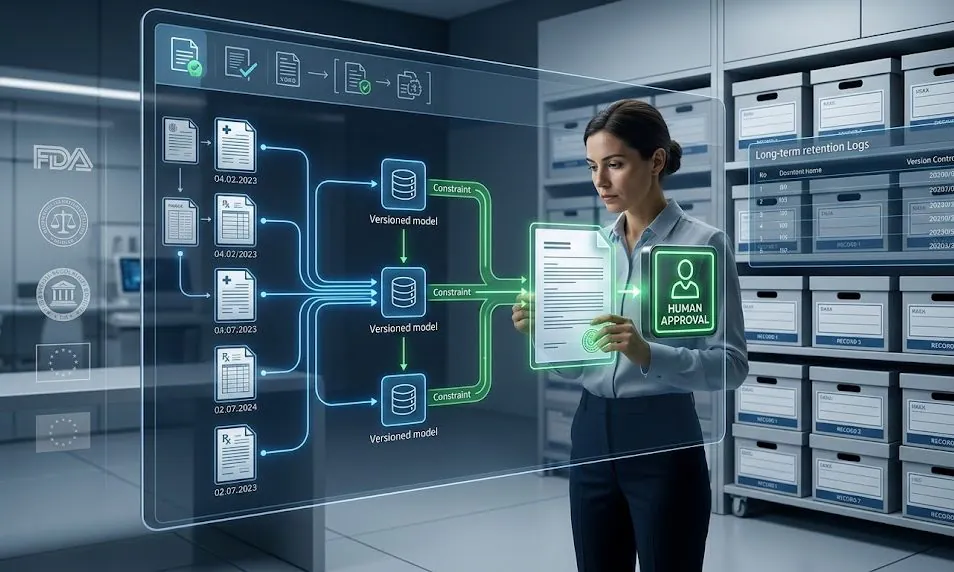

방어 가능한 LLM 시스템을 구축하는 것은 4가지 엔지니어링 요구 사항으로 좁혀진다. 이것들은 추상적인 원칙이 아니다. 이것들은 인프라 결정이며, 시스템이 감리 가능성을 결정한다.

1. 기원: 모델이 정보를 얻는 곳을 제어한다

기업 AI에서 가장 일반적인 실패 모드는 또한 가장 보이지 않는다: 모델이 일반 지식 또는 느슨하게 정의된 데이터 소스를 사용한다. 제어된 지식 경계가 없으면, 출력을 감리 가능한 소스로 추적할 수 없으며, 재구성이 불가능하다.

실용적인 해결책은 승인된 지식 경계를 설정하는 것이다: 버전화된, 소유된 문서 및 데이터 세트가 시스템이 명시적으로 사용하도록 허용된다. 모든答案에는 최소한의 증거 팩이 있어야 한다: 버전 및 효과 날짜가 있는 소스 식별자, 조회 및 선택한 내용을 보여주는 조회 로그, 및 인라인 인용. 유용한 운영 규칙: 인용문이 없으면 주장이 없다.

이것은 시스템을 메모리 기반 생성에서 증거 기반 추론으로 변환한다. 구별은 출력을 특정 시점에 재구성해야 할 때 중요하다.

2. 제약: 즉흥성을 제어된 행동으로 대체한다

LLM은 설득력 있게 설계되었다. 제약이 없으면, 가능성에 최적화하며, 규제 환경에서는 위험이 존재한다.

제약은 확률적 텍스트 생성기를 제한된 실행 구성 요소로 변환하는 메커니즘이다. 실제로는 다음과 같다:

- 소스 바운드 생성: 모든 주장은 승인된, 버전화된 소스가 필요하다. 소스가 없으면 답변은 없다 — 오직 거부 또는 에스컬레이션만 있다.

- 구조화된 출력 스키마: 응답은 기계와 감리자가 검증할 수 있는 정의된 형식을 따른다.

- 신뢰 경계 적용:检索된 콘텐츠는 입력으로 처리되어 보안 및 감리 가능성에 대한 위험을 직접 해결한다.

- 최소 특권 접근: 모델은 실제로 필요한 데이터 및 도구만 상호 작용한다.

제약은 규제 체크박스가 아니다. 이것은 시스템이 감리 가능한지 여부를 결정하는 설계 결정이다.

3. 검토: 인간 감시를 공식적인 제어 계층으로 만든다

규제 AI에서 인간 검토는 임의적일 수 없다. 그것은 위험을 계층화해야 하며(더 높은 위험의 출력은 더 엄격한 검증을 트리거한다) 및 이벤트 주도적이어야 한다. 모델 신뢰도가 낮을 때, 소스가 없을 때, 또는 이상이 감지되었을 때 활성화한다.

EU AI 법률은 명시적으로 요구한다. 인간이 고위험 사용 사례에서 AI 주도적인 결정을 해석, 무효화, 및 중지할 수 있어야 한다. 이러한 요구 사항을 충족하려면 검토 기록이 출력을 승인한 사람, 어떤 조건에서, 그리고 어떤 수준의 검토를 했는지 캡처해야 한다. “누군가 확인했다”는 제어가 아니다. 문서화된, 타임스탬프가 있는 검토 기록이 필요하다.

이것은 검토를 수동 QA에서 공식적인 거버넌스 계층으로 승격시킨다. 이것은 규제 기관이 시작하는 방식이다.

4. 보존: 책임을 지속 가능하게 만든다

로그가 없으면 감리 트레이스가 없다. 감리 트레이스가 없으면 책임은 이론적이다.

동시에 모든 것을 보관하면 감리 가능성에 대한 위험이 있다. 특히 GDPR 또는 HIPAA와 같은 프레임워크에서 민감한 건강 또는 금융 데이터가 최소화 요구 사항의 대상일 때 그렇다.

실용적인 접근법은 계층화된 모델이다. 항상 모델 및 버전 메타데이터, 소스 식별자, 정책 결정, 및 타임스탬프를 저장한다. 상호 작용 콘텐츠(프롬프트, 출력, 및 전체 추적)를 선택적으로 저장한다. 위험 분류, 적절한 편집, 및 접근 제어에 따라 저장한다. 목표는 출력을 재구성할 수 있게 하면서도 데이터를过度 수집하여 하위 노출을 생성하지 않는다.

실제 적용

생명 과학 분야에서 이것이 어떻게 적용되는지 고려한다. CFR 21 Part 11은 전자 기록이 속성 가능, 가독성, 동시적, 원본, 및 정확해야 한다. 규제 문서를 생성하는 LLM은 모든 5가지 기준을 충족해야 한다. 읽을 수 있는 텍스트를 생성하는 것만이 아니다.

이 컨텍스트에서 4가지 기둥은 선택적인 강화가 아니다. 이것은 규제 시스템의 최소 기준이다. 기원은 출력이 속성 가능하고 원본임을 보장한다. 제약은 출력이 정의된 경계를 벗어나지 않도록 보장한다. 검토는 출력이 인간 감시와 동시에 진행됨을 보장한다. 보존은 출력이 가독성 및 검사 가능하도록 보장한다.

같은 논리가 금융 서비스에 적용된다. MiFID II는 결정과 그背後의 이유에 대한 기록을 요구한다. 또한 의료 분야에서 임상적 의사 결정 지원 시스템은 설명 가능성 및 편향에 대한 심각한 감사를 받고 있다.

더 큰 변화

GenAI는 실험에서 운영 인프라로 이동하고 있다. 이 전환은 시스템의 기준을 높인다.

유용한 출력만으로는 더 이상 충분하지 않다. 조직은 설명 가능, 추적 가능, 및 감리 가능성이 있는 출력이 필요하다. 왜냐하면 AI는 실제 결과를 가진 일들을 요청받고 있기 때문이다.

설계에서 방어 가능성을 고려하는 팀은 안전하게 AI를 확장하고 규제 신뢰를 유지할 수 있는 위치에 있을 것이다. 그렇지 않은 팀은 결국 같은 순간을 맞이할 것이다: 감리, 특정 출력에 대한 간단한 질문, 그리고 아무 것도 보여줄 수 없다.

감리 준비 AI를 구축하는 것은 느리게 하는 것이 아니다. 그것은 지속 가능성을 가진 것을 구축하는 것이다.