인공지능

인공지능 기반 뉴스 기사 편향 검사기, 파이썬에서 사용 가능

캐나다, 인도, 중국, 호주의 연구자들이 협력하여 편향된 언어를 식별하고 대체할 수 있는 무료 파이썬 패키지를 개발했습니다.

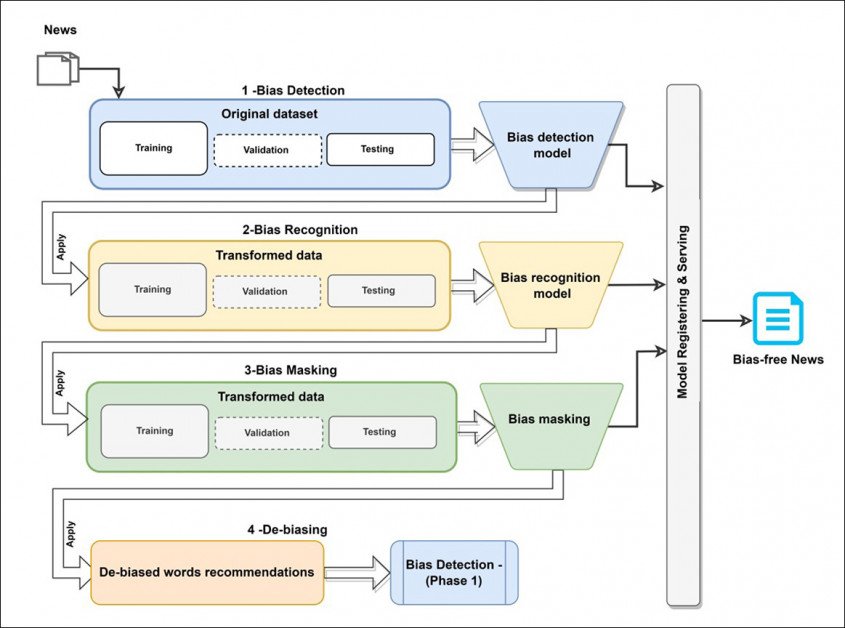

이 시스템은 Dbias라고 불리며, 다양한 기계 학습 기술과 데이터베이스를 사용하여 편향된 텍스트를 세 단계의 순환 워크플로우로 정제하여 비편향적이거나 중립적인 버전으로 반환할 수 있습니다.

Loaded language in a news snippet identified as ‘biased’ is transformed into a less incendiary version by Dbias. Source: https://arxiv.org/ftp/arxiv/papers/2207/2207.03938.pdf

이 시스템은 재사용 가능하고 자체 포함된 파이프라인을 나타내며, Hugging Face에서 Pip를 통해 설치하고 기존 프로젝트에 보충 단계, 애드온 또는 플러그인으로 통합할 수 있습니다.

4월에 Google Docs에서 유사한 기능이 구현되었지만, 편집 가능性的 부족으로 비판을 받았습니다. 반면에 Dbias는 사용자가 원하는 뉴스 코퍼스에 대해 더 선택적으로 훈련될 수 있으며, 사용자 정의 공정성 지침을 개발하는 능력을 유지합니다.

중요한 차이점은 bahwa Dbias 파이프라인은 사용자를 지속적으로 교육하는 대신 ‘loaded language’ (사실적인 의사소통에 비판적인 계층을 추가하는 단어)를 중립적이거나 평범한 언어로 자동 변환하는 것을 목표로 합니다. 본질적으로, 최종 사용자는 윤리적 필터를 정의하고 시스템을 해당 필터에 따라 훈련합니다. Google Docs 접근 방식에서는 시스템이 사용자를 일방적으로 훈련합니다.

Conceptual architecture for the Dbias workflow.

연구자에 따르면, Dbias는 실제로 구성 가능한 첫 번째 편향 검사 패키지입니다. 이는 자연어 처리의 이 하위 분야에서 지금까지 특징적인 오프-더-シェルフ 어셈블리 프로젝트와 대조됩니다.

새로운 논문은 An Approach to Ensure Fairness in News Articles라는 제목을 가지고 있으며, 토론토 대학교, 토론토 메트로폴리탄 대학교, 방갈로르의 환경 자원 관리, 중국의 DeepBlue 과학 아카데미, 시드니 대학교의 기여자들로부터 나왔습니다.

방법

Dbias의 첫 번째 모듈은 Bias Detection입니다. 이는 DistilBERT 패키지를 사용하며, 이는 Google의 비교적 기계 집중적인 BERT의 고도로 최적화된 버전입니다. 이 프로젝트에서는 DistilBERT가 Media Bias Annotation (MBIC) 데이터셋에 대해 미세 조정되었습니다.

MBIC는 허핑턴 포스트, USA 투데이, MSNBC를 포함한 다양한 미디어 소스에서 뉴스 기사를 포함합니다. 연구자들은 데이터셋의 확장 버전을 사용했습니다.

원래 데이터는 크라우드소싱된 작업자들에 의해 주석 처리되었지만 (이 방법은 2021년 말에 비판을 받았습니다), 새로운 논문의 연구자들은 데이터셋에서 추가로 레이블이 지정되지 않은 편향의 인스턴스를 식별할 수 있었으며, 이를 수동으로 추가했습니다. 식별된 편향 사례는 인종, 교육, 민족, 언어, 종교, 성별과 관련이 있습니다.

다음 모듈인 Bias Recognition은 입력 텍스트에서 편향된 단어를 식별하기 위해 Named Entity Recognition (NER)을 사용합니다. 논문은 다음과 같이 말합니다:

‘예를 들어, “토네이도와 기후 변화에 대한 유사 과학적 허풍을 사지 마십시오”라는 뉴스는 이전의 편향 탐지 모듈에 의해 편향된 것으로 분류되었으며, 편향 인식 모듈은 “유사 과학적 허풍”이라는 용어를 편향된 단어로 식별할 수 있습니다.’

NER는 이 작업에 특별히 설계된 것은 아니지만, 편향 식별을 위해 이전에 사용되었습니다. 특히 2021년 영국의 더럼 대학교 프로젝트에서 사용되었습니다.

이 단계에서는 RoBERTa와 SpaCy 영어 트랜스포머 NER 파이프라인을 결합하여 연구자들이 사용했습니다.

다음 단계인 Bias Masking은 식별된 편향 단어의 새로운 다중 마스킹을 포함하며, 여러 개의 편향된 단어가 식별되는 경우 순차적으로 작동합니다.

Loaded language is replaced with pragmatic language in the third stage of Dbias. Note that ‘mouthing’ and ‘using’ equate to the same action, though the former is considered derisive.

필요에 따라 이 단계의 피드백은 추가 평가를 위해 파이프라인의 시작 부분으로 다시 전송됩니다. 이 단계에서는 Masked Language Modeling (MLM)을 사용하며, 이는 Facebook Research가 주도한 2021년 협력에 따라 설정된 방식입니다.

일반적으로 MLM 작업은 15%의 단어를 무작위로 마스킹하지만, Dbias 워크플로는 식별된 편향된 단어를 입력으로 사용하도록 프로세스를 지시합니다.

이 아키텍처는 Google Colab Pro에서 NVIDIA P100과 24GB의 VRAM을 사용하여 배치 크기 16으로 구현 및 훈련되었습니다. 두 개의 레이블 (편향 및 비편향)을 사용했습니다.

테스트

연구자들은 Dbias를 다섯 가지 비교 가능한 접근 방식과 비교했습니다: LG-TFIDF와 로지스틱 회귀 및 TfidfVectorizer (TFIDF) 단어 임베딩; LG-ELMO; MLP-ELMO (ELMO 임베딩을 포함하는 피드 포워드 인공 신경망); BERT; 및 RoBERTa.

테스트에 사용된 메트릭은 정확도 (ACC), 정밀도 (PREC), 재현율 (Rec) 및 F1 점수였습니다. 연구자들은 모든 세 가지 작업을 단일 파이프라인으로 수행할 수 있는 기존 시스템에 대한 지식이 없기 때문에, Dbias의 주요 작업인 편향 탐지 및 인식만을 평가하기 위해競爭框架에 대해 배려를 했습니다.

Results from the Dbias trials.

Dbias는 더 무거운 처리 부하를 가진 다른 프레임워크를 포함하여 모든 경쟁 프레임워크를 능가하는 결과를 달성했습니다.

논문은 다음과 같이 말합니다:

‘결과는 또한 깊은 신경망 임베딩이 일반적으로 편향 분류 작업에서 전통적인 임베딩 방법 (예: TFIDF)보다 더 나은 성능을 발휘할 수 있음을 보여줍니다. 이는 ELMO (깊은 신경망 임베딩)가 로지스틱 회귀와 함께 사용될 때 TFIDF 벡터화와 비교하여 더 나은 성능을 보인 것으로 나타났습니다. ‘

‘이것은 깊은 신경망 임베딩이 다양한 컨텍스트에서 텍스트의 단어 컨텍스트를 더 잘 캡처할 수 있기 때문일 것입니다. 깊은 신경망 임베딩 및 깊은 신경망 방법 (MLP, BERT, RoBERTa)은 또한 전통적인 ML 방법 (LG)보다 더 나은 성능을 보입니다.’

연구자들은 또한 트랜스포머 기반 방법이 편향 탐지에서 경쟁 방법을 능가한다고 주목합니다.

추가 테스트에서는 Dbias를 다양한 SpaCy Core Web 버전 (core-sm, core-md, core-lg)과 비교했습니다. Dbias는 이러한 테스트에서도 선두를 유지했습니다:

연구자들은 편향 인식 작업이 일반적으로 더 큰 모델과 더 많은 매개 변수 및 데이터 포인트로 인해 더 높은 정확도를 보인다고 관찰합니다. 또한 이 분야의 미래 작업의 효ิภาพ은 더 높은 품질의 데이터셋을 주석으로 표시하는 더 큰 노력에 달려 있다고 관찰합니다.

산과 나무

이러한 종류의 세분화된 편향 인식 프로젝트가 궁극적으로 편향을 찾는 프레임워크에 통합되어 더 나은 시야를 갖고 특정 스토리를 다루는 것이 편향된 것으로 간주될 수 있으며, 보고된 시청자 통계 외에도 다양한 요인에 의해 주도될 수 있다는 것을 고려하는 것을หว했습니다.

最初에 2022년 7월 14일에 게시되었습니다.