Anderson의 관점

AI는 책을 읽는 것을 영화를 보는 것보다 선호한다

실제 비디오 콘텐츠를 시청하고 주석을 달기 위해 AI 모델을 얻는 것은驚くほど 어렵다. 그들은 비디오 콘텐츠를 분석하는 데 만들어졌지만, 글쓰기에 더 관심이 있다.

ChatGPT나 유사한 인기 있는 비전/언어 모델에 작은 비디오 클립을 업로드하려고 시도해 본 적이 있다면, 모델이 실제로 비디오를 파싱할 수 없다는 사실을 알게 된 것에 놀랐을 것이다. ChatGPT-4o+와 같은 모델은 개별 프레임을 분석할 수 있다. 예를 들어 JPEG 및 PNG와 같은 이미지 형식으로 분석할 수 있지만, 사용자가 직접 프레임을 추출하여 이미지로 업로드하도록 더喜欢한다(그들은 주석을 달 준비가 되어 있다).

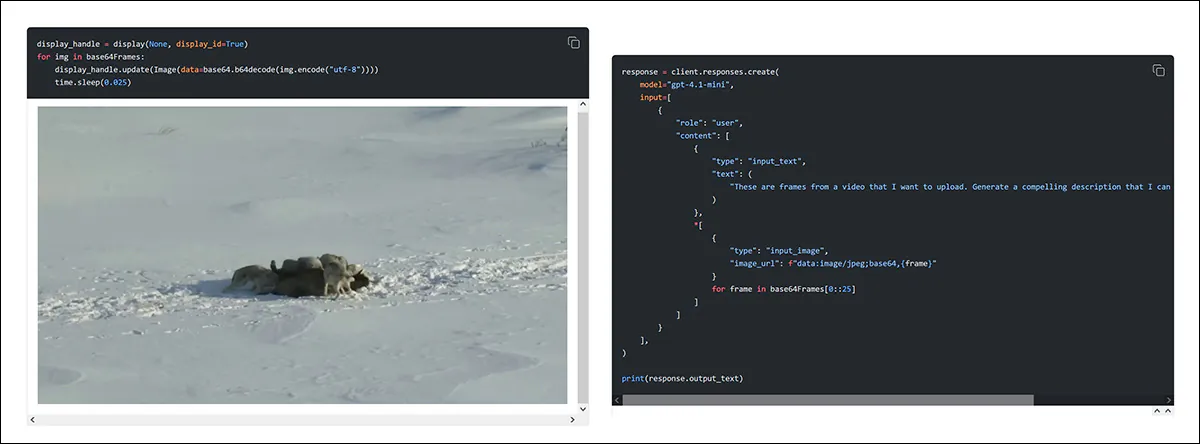

OpenAI GPT 시리즈의 경우, 비디오 클립에서 완전한 프레임 실행을 추출하여 ChatGPT에 제공할 수 있다. 예를 들어, AI 생성된 내레이션 트랙을 생성하는 목적을 위해:

OpenAI 튜토리얼의 이미지 및 코드에서 비디오 클립에 대한 AI 생성된 주석을 개발하기 위한 여러 추출된 프레임을 파싱하는 방법 소스

그러나 사용자가 비디오를 프레임으로 변환하는 것은 사용자의 몫이다. 이는 더 큰 루틴에서 함수를 호출하거나 FFMPEG 또는 다양한 무료 및 유료 비디오 편집 솔루션을 사용하여 프레임을 추출하여 수행할 수 있다.

일정 정도, 혹은 다소 큰 정도에 있어서, ChatGPT와 같은 고급 제품에서 비디오 분석의 제한은 리소스 사용에 달려 있다. 가장 인기 있는 비디오 코덱 중 하나를 선택하여 단일 AI 인스턴스를 도구로 만들고, 추출 과정을 위한 디스크 및 CPU 리소스를 할당하는 것은 Hundreds of millions of users가 이러한 기능을 사용하기 시작하면 중요하지 않은 고려 사항이 아니다.

또한, 시간적 분석은 다른 그림을 그릴 수 있다. 예를 들어, 한 사람이 행복한 기분으로 집에 들어가서 시체를 발견하는 경우; 따라서 짧은 비디오 클립의 전체 시간 ‘체크섬’을 고려하는 것은 요구 사항이다. 또한, Optical Flow와 같은 프레임워크 개발과 같이 연구 문헌의 전문 분야이다. Optical Flow는 기본적으로 비디오의 길이를 펼쳐서 정적 문서로 간주할 수 있도록 한다:

Optical flow 다이어그램은 비디오 시퀀스에서 프레임 간에 움직임을 추적하는 방법을 보여준다. 녹색 벡터는 움직임 방향과 강도를 나타낸다. 이러한 매핑은 VLM에 필요한 시간적 연속성을 제공하며 또한 VFX 워크플로우에서 구조적 지침으로 사용될 수 있다. 소스

클리프 노트에 정착

그럼에도 불구하고, Google의 Notebook LM과 더 최근의 ChatGPT 엔트리와 같은 모델은 관련 메타데이터(예: 비디오를 어떤 방식으로든 맥락화하는 내장 텍스트 콘텐츠)를 읽을 수 있으므로 비디오 파일 업로드를 금지하지는 않는다. 때때로 비디오를 해석하려고 시도할 수도 있다. 메타데이터가 없는 경우에도 vậy이다.

이 경우, NotebookLM에 6초짜리 임의의 클립을 업로드했다. 이 클립에는 유용한 텍스트가 전혀 포함되지 않았으며, 메타데이터나 파일 이름에도 텍스트가 포함되지 않았다.

NotebookLM은 비디오와 전혀 관련이 없는 물질을 상상력 있게 상상해 내고, 무의미하고 관련이 없는 5분짜리 대면 팟캐스트를 생성했다:

이탈리아 영화의 6초 클립에서 일상적인 순간을 NotebookLM이 광범위하게 잘못 해석했다. 소스: Google NotebookLM

Notebook와 ChatGPT는 YouTube 비디오를 입력으로 받아들이지만, 비디오에 해석 가능한 텍스트 레이어 주석 및/또는 자막(비디오에 번인된 자막이 아닌)이 포함된 경우에만 그렇게 한다.

이러한 방식으로 실제로 비디오 콘텐츠를 보며 듣고 의미적으로 해석하는 작업(YouTube의 경우 저작권 보호 조치 및 예정된 신원 보호 시스템으로 인해 법적 필수 사항임)은 사용자 업로드 후에 여유 시간에 할 수 있다.

실제 비디오 해석은 비용이 많이 들고 고갈되며, 비디오를 분석하는 작업을 수행하도록 특별히 훈련된 모델조차도 텍스트를 읽는 것을 선호한다는 사실이 밝혀졌다.

TL;DW

이것은 영국 브리스톨 대학교의 새로운 논문에서 밝혀졌다. 이 논문은 비디오는 천개의 단어가 아니다라는 제목으로, 두 저자는 현재 상태의 아트 비전 언어 모델(VLM)이 비디오를 분석할 수 있는 능력이 텍스트 기반 정보를 기본으로 사용한다고 결론지었다.

비디오와 함께 이동하는 이미지와 작성된 질문 및 선택형 답변을 제공했을 때, 모델은 텍스트 패턴에 기반하여 선택을 내렸으며, 비디오에서 발생하는 일은 고려하지 않았다. 많은 경우에 모델은 질문이 완전히 제거된 경우에도 동일하게 수행되었다.

이것은 단축 또는 부정행위의 일종으로 보인다. 모델에게 가장 중요한 것은 가능한 답변에서 패턴을 식별하는 것이었다. 모델은 더 많은 답변 옵션이 추가되어 작업이 더 어려워질 때 비디오에 더 주의를 기울이기 시작했다.

저자들은 6개의 VLM 모델에 대해 다양한 컨텍스트 길이를 사용하여 4개의 적합한 데이터 세트에서 VQA 테스트를 수행했다. 결과는 모델이 비디오 콘텐츠보다 텍스트에 의존한다는 것을 나타냈다.

비디오-분석 모델이 본 것과 읽은 것을 비교하는 예시. 클립에서는 대나무를 짜는 사람을 보여주지만, 모델은 비디오 프레임 자체보다 작성된 질문과 답변 텍스트에 훨씬 더 많은 중요성을 부여한다. 파란색 하이라이트는 선택한 답변을 지원하는 요소를 표시하고, 빨간색은 반대 방향으로 끌어당기는 요소를 표시한다. 모델의推論은 텍스트에 중심을 두고 이미지에는 중심을 두지 않는다. 소스