Artificial Intelligence

AI が手話認識をこれまで以上に正確にする方法

コミュニケーションの障壁を打破することを考えるとき、私たちはしばしば 言語翻訳アプリ あるいは音声アシスタント。しかし、手話を使用する何百万人もの人々にとって、これらのツールは溝を埋めるのに十分ではありません。手話は単なる手の動きではありません。顔の表情やボディランゲージを含む豊かで複雑なコミュニケーション形式であり、それぞれの要素が重要な意味を持っています。

これが特に難しいのは、主に語彙と文法が異なる音声言語とは異なり、世界中の手話は意味を伝える方法が根本的に異なるからです。たとえば、アメリカ手話 (ASL) には、話し言葉の英語とは一致しない独自の文法と構文があります。

この複雑さは、手話をリアルタイムで認識して翻訳する技術を作成するには、動作中の言語システム全体を理解する必要があることを意味します。

認識への新たなアプローチ

そこで、フロリダ・アトランティック大学(FAU)工学部・コンピュータサイエンス学部のチームは、新たなアプローチを採用することを決定しました。手話の複雑さ全体を一度に解決しようとするのではなく、重要な第一歩を踏み出すことに焦点を絞りました。それは、AIを用いてASLのアルファベットジェスチャーをかつてない精度で認識することです。

コンピューターに手書き文字の読み方を教えるようなものですが、29,820 次元で動きながら教えることになります。チームは驚くべきものを構築しました。ASL の手振りを示す 21 枚の静止画像のデータセットです。ただし、単に画像を集めただけではありません。各画像に手の XNUMX 個の重要なポイントをマークし、手がどのように動いてさまざまな手話を形成するかを示す詳細なマップを作成しました。

博士課程の学生としてこの研究を主導したバダー・アルシャリフ博士は、「この方法はこれまでの研究では研究されておらず、将来の進歩にとって新しく有望な方向性となっています」と説明しています。

テクノロジーを分解する

この手話認識システムを機能させるテクノロジーの組み合わせについて詳しく見ていきましょう。

MediaPipe と YOLOv8

この魔法は、MediaPipe と YOLOv8 という 21 つの強力なツールのシームレスな統合によって実現します。MediaPipe は、あらゆる微妙な指の動きと手の位置を追跡できる熟練した手話通訳者であり、熟練した手話通訳者です。研究チームが MediaPipe を選んだのは、前述のように、それぞれの手の XNUMX 個の正確なポイントを特定し、正確な手のランドマーク追跡を提供する優れた能力があるからです。

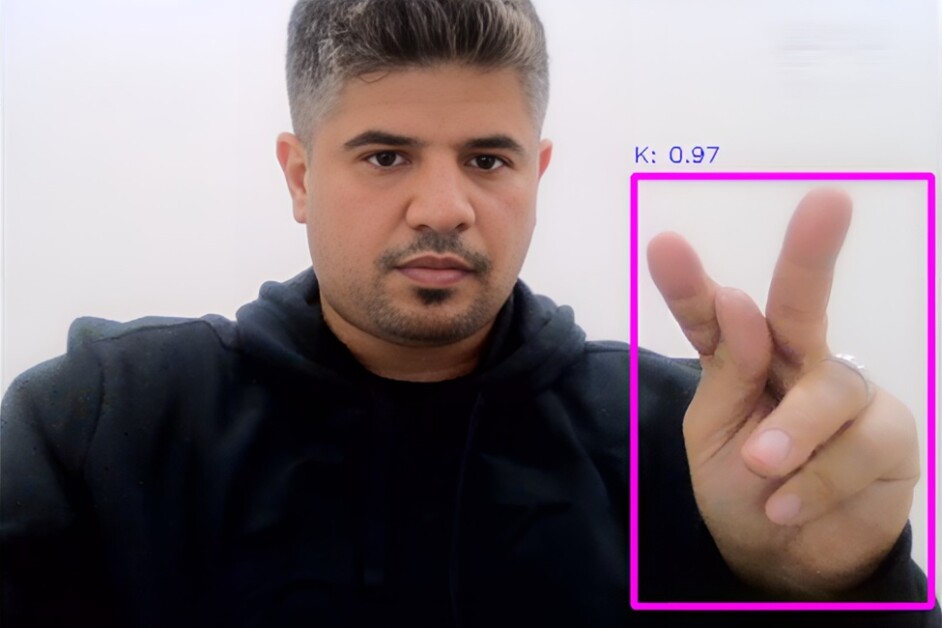

しかし、追跡だけでは十分ではありません。これらの動きが何を意味するかを理解する必要があります。そこで YOLOv8 の出番です。YOLOv8 はパターン認識の専門家であり、追跡されたすべてのポイントを取得して、それらがどの文字またはジェスチャーを表しているかを判断します。研究によると、YOLOv8 は画像を処理するときに、それを S × S グリッドに分割し、各グリッド セルがその境界内のオブジェクト (この場合は手のジェスチャー) を検出する役割を果たします。

アルシャリフ他、フランクリンオープン(2024)

システムの実際の仕組み

このプロセスは、一見したほど複雑ではありません。

舞台裏では次のようなことが起こります:

手検出ステージ

手話を行うと、MediaPipe はまずフレーム内の手を識別し、21 個の重要なポイントをマッピングします。これらは単なるランダムな点ではなく、指先から手のひらの付け根まで、手の特定の関節やランドマークに対応しています。

空間分析

YOLOv8 はこの情報を取得してリアルタイムで分析します。画像内の各グリッド セルについて、次のことを予測します。

- 手振りが存在する確率

- ジェスチャーの位置の正確な座標

- 予測の信頼度スコア

欠陥種類の識別

このシステムは「バウンディング ボックス予測」と呼ばれるものを使用します。手のジェスチャーの周りに完全な長方形を描くことを想像してください。YOLOv8 は、各ボックスの XNUMX つの重要な値 (中心の x 座標と y 座標、幅、高さ、および信頼スコア) を計算します。

アルシャリフ他、フランクリンオープン(2024)

この組み合わせがなぜうまくいくのか

研究チームは、これらの技術を組み合わせることで、個々の技術の総和以上のものを生み出すことを発見しました。MediaPipeの精密な追跡機能とYOLOv8の高度な物体検出機能を組み合わせることで、驚くほど正確な結果が得られました。精度は98%、F99スコアは1%です。

このシステムが特に印象的なのは、手話の複雑さをどのように処理するかです。一部の手話は訓練されていない目には非常によく似ているように見えるかもしれませんが、システムは微妙な違いを見つけることができます。

記録破りの結果

研究者が新しい技術を開発するとき、常に大きな疑問が浮かびます。「実際にどの程度うまく機能するのか?」この手話認識システムの場合、結果は印象的です。

FAU のチームはシステムを厳密なテストにかけ、次のような結果を得ました。

- システムは98%の確率で標識を正しく識別します

- 目の前で作られたすべてのサインの98%をキャッチします

- 総合的なパフォーマンススコアは驚異の99%を達成

「私たちの研究の結果は、私たちのモデルがアメリカ手話のジェスチャーをほとんどエラーなく正確に検出し分類する能力があることを示しています」とアルシャリフは説明します。

このシステムは、さまざまな照明、さまざまな手の位置、さらにはさまざまな人が手話する場合でも、日常的な状況でうまく機能します。

この画期的な技術は、手話認識の可能性の限界を押し広げます。従来のシステムは精度に課題を抱えていましたが、MediaPipeのハンドトラッキングとYOLOv8の検出機能を組み合わせることで、研究チームは特別な技術を開発しました。

「このモデルの成功は、転移学習、綿密なデータセット作成、そして精密なチューニングの慎重な統合に大きく依存しています」と、研究の共著者の一人であるモハマド・イリヤス氏は述べています。こうした細部へのこだわりが、システムの驚異的なパフォーマンスに結実しました。

コミュニケーションにとってこれが何を意味するか

このシステムの成功により、コミュニケーションをよりアクセスしやすく、より包括的にするための刺激的な可能性が開かれます。

研究チームは文字認識だけに留まりません。次の大きな課題は、システムにさらに幅広い手の形やジェスチャーを理解させることです。手話の「M」と「N」のように、ほとんど同じに見えるサインを想像してみてください。研究者たちは、システムがこうした微妙な違いをさらに正確に捉えられるよう取り組んでいます。アルシャリフ博士は次のように述べています。「重要なのは、この研究結果がシステムの堅牢性だけでなく、実用的なリアルタイムアプリケーションへの応用可能性も強調している点です。」

チームは現在、次のことに重点を置いています。

- 通常のデバイスでシステムをスムーズに動作させる

- 現実世界での会話に十分な速さを実現する

- どのような環境でも確実に動作することを保証する

FAU 工学部およびコンピュータサイエンス学部の学部長ステラ・バタラマ氏は、より大きなビジョンを次のように共有しています。「アメリカ手話の認識を改善することで、この取り組みは聴覚障害者や難聴者のコミュニティのコミュニケーションを強化するツールの作成に貢献します。」

想像してみてください。このテクノロジーが、医者のオフィスや授業に足を踏み入れた瞬間に、コミュニケーションの溝を埋めてくれるのです。それこそが、この真の目標です。日々のやり取りを、関わるすべての人にとってよりスムーズで自然なものにすること。人と人との繋がりを真に支えるテクノロジーを創造すること。教育、医療、そして日常会話など、あらゆる場面で、このシステムはコミュニケーションの障壁がますます小さくなる世界への一歩を踏み出すのです。