Sicurezza informatica

Proteggere i server di comando e controllo basati su Twitter con reti neurali

I ricercatori cinesi hanno utilizzato la natura “black box” delle reti neurali per elaborare un nuovo metodo per comunicare in modo malintenzionato con i server di comando e controllo (C&C) su Twitter in un modo che non può essere esposto dai ricercatori di sicurezza, e potrebbe rendere difficile fermare le loro operazioni.

Il documento aggiornato paper pubblicato il 2 agosto si intitola DeepC2: AI-powered Covert Botnet Command and Control on OSNs.

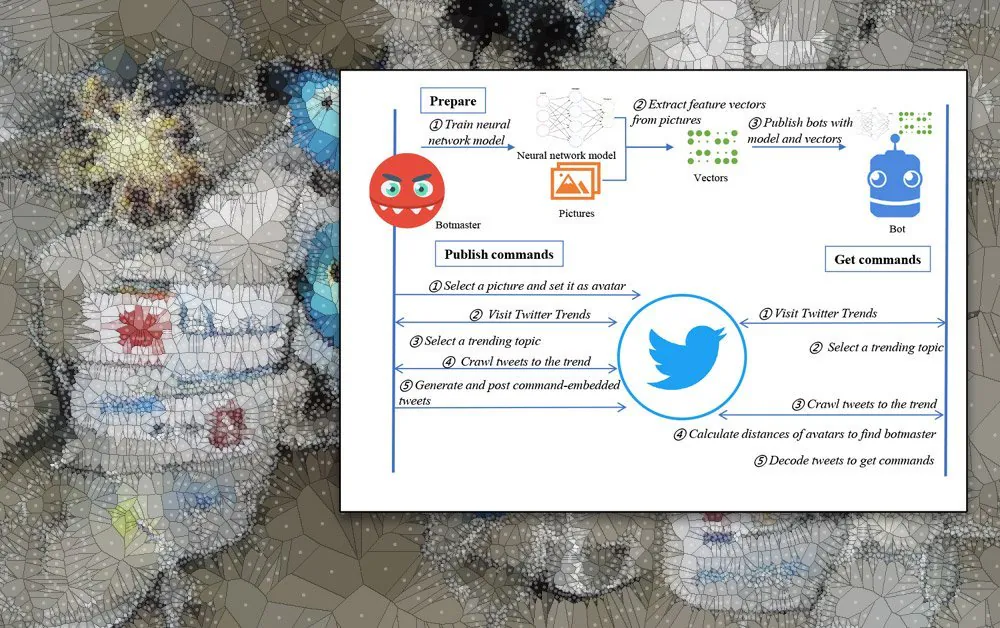

Il metodo proposto, testato con successo in un trial su Twitter, addestra una rete neurale per identificare l’account Twitter controllato da un’entità C&C in base al suo icona dell’utente Twitter. Una volta che l’account di comando è stato “autenticato” dalla rete neurale, i comandi nascosti nei suoi tweet apparentemente innocui possono essere eseguiti dall’esercito di computer infettati con il botnet.

Source: https://arxiv.org/abs/2009.07707

Un botnet è un gruppo di computer che sono stati compromessi in modo che possano essere comandati da attori malintenzionati centralizzati per eseguire vari tipi di attacchi informatici crowd-sourced, tra cui incursioni DDoS, mining di criptovalute e campagne di spam.

La lotta per l’anonimato del C&C

Ogni computer compromesso nel botnet “orchestra” richiede una direzione centrale dagli originatori del malware, e quindi deve comunicare in qualche modo con un server C&C. Tuttavia, questo ha tradizionalmente significato che i ricercatori di sicurezza sono stati in grado di reverse-engineering l’infezione del botnet individuale e esporre l’URL del server C&C, di solito hard-codificato nell’infezione.

Una volta che il dominio C&C maligno era noto, era possibile bloccarlo a livello di rete e indagare sulle sue origini ai fini di azioni legali.

Negli ultimi anni, la tendenza per i server C&C si è allontanata dagli indirizzi di dominio http dedicati verso l’uso di servizi web popolari come Gmail, Twitter, servizi di clipboard online e una varietà di reti sociali online (OSN).

Nel 2015 è stato rivelato che il backdoor del malware Hammertoss stava utilizzando Twitter, GitHub e servizi di archiviazione cloud per questi scopi; nel 2018, che lo strumento di amministrazione remota (RAT) HeroRat utilizzava il protocollo di messaggistica Telegram per gli stessi scopi; e che nel 2020 il malware ComRAT del gruppo Turla aveva migrato all’uso di Gmail come framework di comunicazione.

Tuttavia, questi approcci richiedono ancora qualche tipo di informazione di identificazione da essere hard-codificata nel software di infezione, rendendolo scopribile, seppur spesso con difficoltà, dalle iniziative di sicurezza. In tali casi, la natura esplicabile dei comandi malintenzionati e l’identificazione degli ID utente possono consentire di chiudere questi canali, di solito disabilitando il botnet dipendente.

Identificatori segreti

Il metodo DeepC2 proposto dai ricercatori cinesi rende la reverse-engineering delle informazioni di identificazione del C&C praticamente impossibile, poiché tutto ciò che il codice rivelerà è un algoritmo di rete neurale opaco che non può essere facilmente ri-implementato nella sua forma altamente ottimizzata (cioè effettivamente “compilata”).

Con DeepC2, il bot individua il “botmaster” cercando un’icona dell’utente specifica (nei temi di tendenza, in modo che il bot non debba scorrere tutto Twitter) le cui caratteristiche di alto livello sono state codificate nella sua rete neurale. Gli autori del malware selezionano in anticipo le immagini dell’icona adatte alla campagna e addestrano la rete neurale su di esse. I vettori delle caratteristiche derivati e la rete neurale stessa vengono distribuiti come parte del payload malintenzionato.

Quando il server C&C pubblica un nuovo comando, la mano guidante dietro di esso sceglie alcuni temi di tendenza su Twitter (o qualsiasi altra rete sociale che viene sfruttata) e genera post di social media apparentemente ordinari che contengono comandi incorporati. La popolarità del tema spinge i post a una prominenza scopribile, in modo che i bot possano facilmente accedere a nuovi comandi scorrendo la rete sociale.

Workflow di DeepC2.

Per prevenire la rilevazione, ogni icona di Twitter e account associato viene utilizzato come meccanismo di C&C solo una volta con DeepC2, con il sistema che passa a un nuovo handle di C&C OSN pre-rotolato dopo questo evento. Inoltre, i bot elimineranno le informazioni vettoriali utilizzate per identificare le icone dell’avatar del C&C dopo un solo uso (un comando inviato), per ulteriormente ostacolare la riproduzione dei metodi di sicurezza forensi.

Oscurare i comandi del C&C

Come ulteriore aiuto per l’oscuramento, DeepC2 include un metodo per prevenire la rilevazione di comandi espliciti nei messaggi di Twitter, utilizzando collisioni di hash e un aumento dei dati migliorato (EDA), quest’ultimo basato su lavoro del Protago Labs Research nel 2019, in collaborazione con il Dartmouth College e la Georgetown University.

Una collisione di hash si verifica quando due pezzi di dati diversi hanno una somma di controllo identica, cioè quando ogni pezzo di dati distinto è matematicamente equivalente nel profilo – uno scenario raro che può essere sfruttato, in questo caso, per creare indicatori di comando da contenuto di testo apparentemente innocuo.

I bot cercano questi hash pre-programmati nell’output dei social media degli account che sono stati in grado di identificare come server C&C in base alle icone dell’avatar riconosciute. Poiché i tweet generati dal comandante del C&C avranno some rilevanza contestuale per il flusso di argomenti di destinazione, sono difficili da identificare come anomalie, nascondendo l’intento dei post.

Sebbene i dati di testo aumentati potrebbero non essere grammaticalmente corretti, l’incoerenza grammaticale dei post su Twitter (e altre reti sociali) nasconde efficacemente questi ‘glitch’ nella comprensibilità.

Gli indirizzi IP vengono trasmessi dal botmaster ai bot dividendo l’URL in due hash separati con collisione di hash, che vengono identificati e concatenati in un indirizzo IP comprensibile dai bot remoti.

I ricercatori hanno utilizzato sette server virtuali privati per simulare posizioni geodiverse. Le icone dell’avatar di destinazione sono state derivate da 40 foto scattate con telefoni cellulari, che sono state quindi convertite in vettori durante l’addestramento. I bot sono stati successivamente posizionati con il modello addestrato e i dati del vettore.

Tutti i comandi nell’esperimento sono stati ricevuti e analizzati con successo dalle reti di bot virtualizzate, sebbene con una certa ridondanza di diffusione del messaggio, poiché il sistema non può essere completamente sicuro che ogni istanza di un messaggio verrà ricevuta da un particolare tweet.

In termini di contromisure, i ricercatori notano che la frequenza automatizzata del modo in cui i bot “slave” setacciano Twitter per i messaggi del C&C e il modo in cui il server del C&C itererà attraverso una serie di post, potrebbe potenzialmente rappresentare una firma identificabile che potrebbe essere affrontata da nuovi tipi di framework di protezione.

Inoltre, le reti sociali online potrebbero potenzialmente calcolare le differenze visive molto specifiche che sono state incorporate in una matrice di icone dell’avatar del C&C e sviluppare metodi per generare avvisi in base a quei criteri.