Angolo di Anderson

Servizi di inferenza decentralizzati in stile PiedPiper per l’AI?

È ‘BitTorrent per AI’ una possibilità imminente?

Opinione Dopo aver appena finito di rivedere la divertente e acida satira tecnologica di Mike Judge Silicon Valley – in cui un gruppo di geni geek socialmente sfidati tenta di creare una ‘nuova internet’ chiamata PiedPiper, tramite una rete mesh installata su tutti i telefoni cellulari – ero interessato a vedere la comunità HN impegnata con una nuova offerta di natura simile.

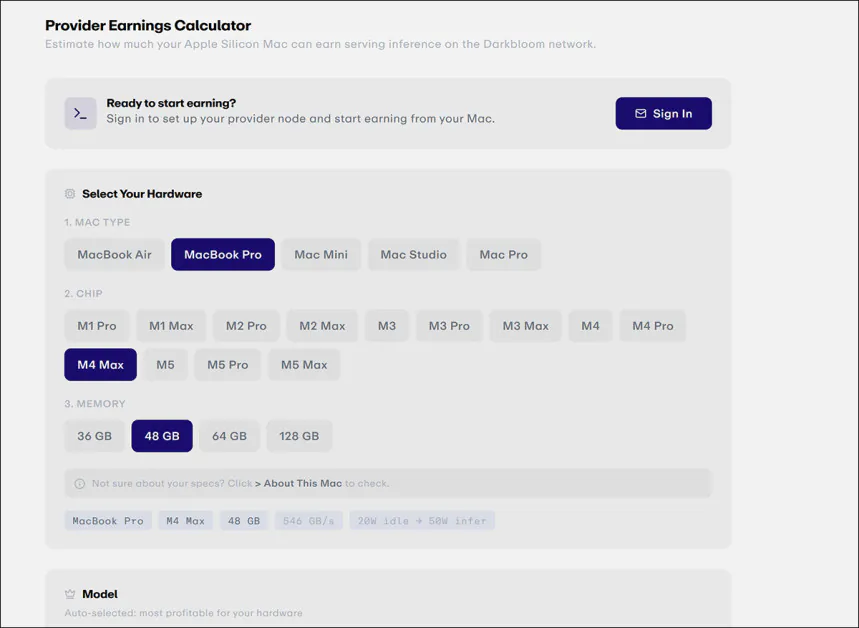

Eigen Labs’ DarkBloom si trova da qualche parte tra la nozione egualitaria di una rete mesh decentralizzata per l’inferenza AI e i motivi di profitto della criptovaluta, consentendo ai proprietari di sistemi Mac con chip Apple Silicon di trasformare il loro equipaggiamento in un nodo di inferenza:

Dalla sezione guadagni del sito web DarkBloom, gli utenti possono selezionare quale attrezzatura desiderano noleggiare e quali modelli AI desiderano supportare. Fonte

Il sistema si concentra attualmente su modelli basati su testo come il modello agente Trinity Mini (3B) e Cohere Transcribe, sebbene offra anche modelli di generazione di immagini diversi come FLUX 2 Klein 4B:

La gamma di modelli da cui il ‘proprietario’ può scegliere di noleggiare, insieme ai guadagni mensili stimati.

Gli utenti che partecipano allo schema possono apparentemente guadagnare abbastanza denaro in un solido mese di fornitura di inferenza per aggiungere regolarmente un nuovo Mac a una catena in continua crescita, fino a quando, in teoria, potrebbero guadagnare un’intera fattoria di inferenza.

Effettivamente, uno schema di questo tipo che dovesse realmente guadagnare popolarità (attualmente ha un problema di avvio a freddo) potrebbe mettere gli utenti entusiasti e occasionali in una posizione di ricerca di hardware, come nell’ultima grande boom di criptovaluta (e successivo crollo).

Non così veloce

Tuttavia, per i piccoli giocatori, quella barca potrebbe essere già salpata. Oltre alla necessità apocalittica di RAM dell’AI, la domanda di attrezzatura per data center abilitata all’AI a livello globale continua a aumentare i costi di hardware e servizi per il consumatore comune, che in precedenza era in grado di monopolizzare la RAM per la criptovaluta, a causa della natura periferica dell’attività, nonché dell’incertezza normativa, che ha tenuto gli interessi aziendali circospetti sulla criptovaluta.

Mentre il MacBook Neo a basso costo è emerso come un’alternativa vincente alla continua escalation di hardware, il suo chip per telefoni cellulari A18 e 8 GB di VRAM non lo mettono in seria competizione come macchina di inferenza.

Ma anche se l’utente finale non cerca di avviare una fattoria di inferenza a pieno titolo e desidera semplicemente noleggiare la sua capacità M[n] inutilizzata, i potenziali guadagni sembrano significativi, se il problema di avvio a freddo si risolve rapidamente e se la piattaforma inizia a pubblicizzarsi come qualcosa di più di un curioso esperimento di potenziale domanda.

Inferenza diversa

Sebbene molti commentatori abbiano riconosciuto una democrazia in stile PiedPiper/Torrent nello schema di DarkBloom, i compiti di inferenza non sono così facilmente divisibili come la frammentazione di un file movie in più slice hash, in modo che possa essere successivamente riassunto in un client torrent.

Il modello DarkBloom non propone che il chip M[n] di un partecipante gestisca x% di un compito di inferenza. Nell’uso mainstream, solo un numero limitato di framework o metodologie possono raggiungere questo tipo di utilizzo cross-GPU su un singolo compito di inferenza, tra cui NVIDIA TensorRT LLM, che utilizza pipeline parallelism; e DeepSpeed sharded inference che sfrutta model parallelism (MP).

Invece, il tuo Mac abilitato DarkBloom scaricherà e avvierà uno dei modelli elencati e eseguirà il 100% dell’inferenza per gli utenti che pagano, con crittografia end-to-end e con prompt decrittati solo su nodi attestati hardware, il che significa che i fornitori non saranno in grado di leggere i dati durante l’esecuzione. Il carico di lavoro stesso costituirà uno o più inferenze basate su testo, o almeno un’immagine completa.

Non è chiaro quanto estensivo sarebbe una singola sessione utente; come si presenta, gli appassionati di AI sono abituati a garantire una GPU tramite fattorie di inferenza come RunPod; sebbene possa richiedere un po’ di tempo per garantire la GPU desiderata al picco di utilizzo, l’utente può monopolizzarla finché la sessione non è consentita di scadere.

Quindi è possibile che un singolo utente pagante possa finire per utilizzare le capacità AI di un singolo Mac noleggiato DarkBloom per una sessione molto lunga, a meno che non ci sia un vantaggio logistico o di conformità nel cambiare i client tra le richieste.

I Mac sono stati selezionati per questo approccio, apparentemente, perché esistono solo un numero limitato di possibili configurazioni tecniche per un partecipante e quindi è facile assegnare modelli di dimensioni adeguate a un client.

Inoltre, i Mac in grado di contribuire a una rete DarkBloom hanno un enclave sicuro che garantisce un muro tra l’utente e il fornitore.

Questi sono tutti fattori non così facili da razionalizzare attraverso setup più generici e personalizzati e attraverso le centinaia o migliaia di laptop e computer desktop Windows e Linux disponibili negli ultimi 6-7 anni.

Tuttavia, deve essere ovvio che il pool di hardware non Mac molto più grande potrebbe ospitare una grande domanda se le loro caratteristiche diverse potessero essere razionalizzate, invece di – come con DarkBloom – fare un giro sulle specifiche limitate di Apple, il che rende un’offerta commerciale facile e un approccio architettonico (presumibilmente) più facile.

Sorveglianza legale?

Forse il problema più grande che si pone a una soluzione ‘democratica’ di questo tipo è la natura chiusa del processo proposto; i governi di tutto il mondo sono attualmente impegnati in nuove leggi che porrebbero effettivamente fine all’anonimato su Internet ovunque istituito e sono chiaramente non in una mentalità pro-privacy in questo periodo.

Pertanto, la prospettiva di inferenza AI casuale eseguita senza filtri, controlli o bilanciamenti, su una rete distribuita (se si può chiamare DarkBloom tale – è più di un mercato di inferenza) sembra, ironicamente, remota.

È possibile che DarkBloom, o altri schemi di mesh di inferenza successivi, debbano accettare backdoor che limitano effettivamente la privacy all’host, che non sarà in grado di vedere i lavori del client in esecuzione; invece, i dati di inferenza restituiti saranno resi disponibili attraverso strutture di agenzia governativa uomo-nel-mezzo (MiTM), mantenendo tutte le inferenze verificabili.

Presumibilmente, se la serie di nuove leggi proponendo controlli di identità a livello di sistema operativo dovesse mai raggiungere un’ampia adozione, tali misure potrebbero diventare ridondanti. Ma senza di esse, considerando l’attuale clima, una rete in stile DarkBloom sarebbe probabilmente considerata simile a un ‘darknet’ AI, dove potrebbero verificarsi attività illegali basate su AI in segreto.

Test di divisione

Finora ci sono stati sorprendentemente pochi tentativi reali di fare ciò che un sistema ‘in stile PiedPiper’ implica; DarkBloom si trova a un estremo, distribuendo compiti completi a macchine individuali piuttosto che tentare di frammentarli attraverso una rete, mentre la maggior parte dei sistemi di produzione evita semplicemente il problema mantenendo l’inferenza su un singolo host.

Tuttavia, esistono una manciata di progetti che rappresentano qualcosa di un po’ più vicino all’esecuzione ‘condivisa’.

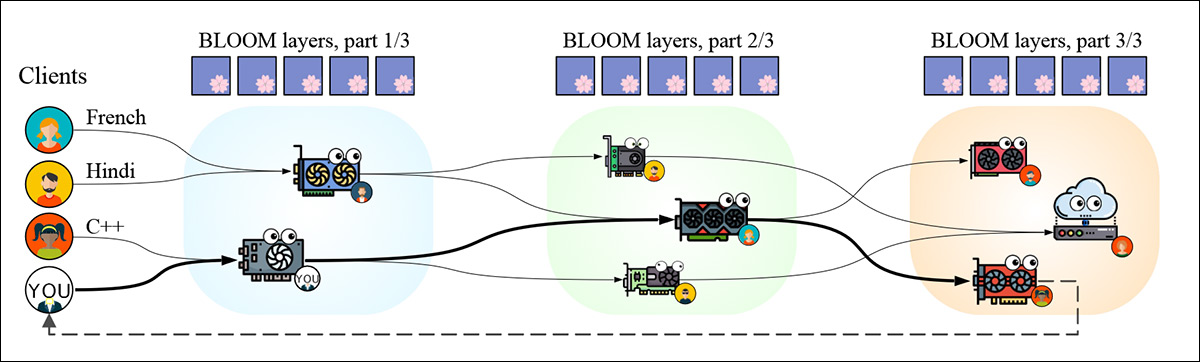

Petals, che si descrive attivamente come una rete ‘in stile BitTorrent’, distribuisce blocchi di trasformatori su più nodi connessi a Internet, passando stati intermedi tra loro:

Un flusso di lavoro tipico di Petals, in cui una singola richiesta di inferenza viene instradata su più GPU remote, ognuna delle quali detiene un subset di layer del modello; a differenza di DarkBloom, l’esecuzione è frammentata attraverso la rete, con stati intermedi passati tra nodi operati in modo indipendente, aumentando la latenza e l’esposizione ad ogni salto mentre si approssima a un vero e proprio sistema in stile mesh. Fonte

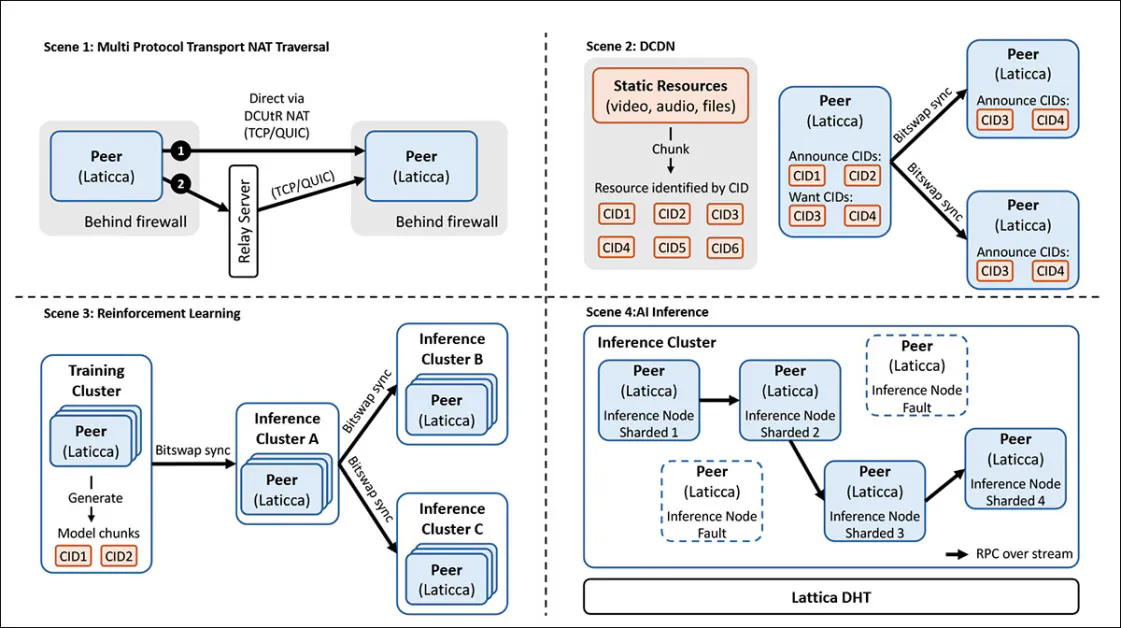

Hivemind sperimenta con una coordinazione peer-to-peer e un routing di esperti simili, sebbene al servizio della formazione di modelli piuttosto che dell’inferenza da modelli già formati; e Lattica si concentra sul livello di rete sottostante necessario per rendere tali sistemi fattibili:

<em Uno schema di Lattica, che mostra un substrato peer-to-peer a livello inferiore che gestisce il traversal NAT, la distribuzione di contenuti e la coordinazione basata su DHT, con inferenza sharded che emerge solo come un possibile livello di applicazione; a differenza di DarkBloom o Petals, Lattica non definisce un sistema di inferenza di per sé, ma fornisce i primitivi di rete e sincronizzazione necessari per costruirne uno. Fonte –

Tutti e tre questi modelli si avvicinano all’ideale mesh, ma al costo di latenza, instabilità ed esposizione.

Al contrario, exo mantiene l’inferenza all’interno di un cluster locale, utilizzando interconnessioni veloci per dividere i carichi di lavoro tra le GPU, senza affidarsi a Internet pubblico. Nella pratica, questo tipo di setup si comporta meno come una rete distribuita e più come una singola macchina estesa, sebbene ci sia la chiara possibilità di estendere questo approccio su una rete più ampia:

Una vista del cluster da exo, che mostra un anello di piccole macchine Apple Silicon locali che ospitano congiuntamente un singolo modello, con pipeline o tensor sharding che distribuiscono layer tra i nodi; a differenza dei sistemi basati su WAN, exo si affida a interconnessioni locali veloci, trasformando efficacemente più dispositivi in una singola macchina di inferenza composita. Fonte

Infine, diversi approcci comunemente citati non affrontano l’inferenza affatto: il venerabile (2016) Google FedAvg; l’uscita del 2018 di MIT SplitNN; e l’offerta australiana del 2020 SplitFed, sono preoccupati della distribuzione della formazione o dello scambio di dati che preserva la privacy, piuttosto che servire richieste di inferenza live.

Poiché la formazione è una prospettiva molto più intensiva in termini di risorse rispetto all’inferenza, qualsiasi rete che dimostri di essere in grado di distribuire tale carico in modo efficace, attraverso cluster o nodi, potrebbe avere un interesse sproporzionato di appassionati e aziende in seguito.

Conclusione

Poiché gran parte della tecnologia in Silicon Valley era invenzione selvaggia, non sappiamo se PiedPiper fosse veramente guidato da hash (cioè dividendo e distribuendo dati in chunk, in stile torrent) o se ‘stabilisse’ un compito o anche una sessione su qualsiasi nodo in qualsiasi momento, il che è ciò che fa DarkBloom.

Tuttavia, l’attuale corsa per fornire hardware di formazione e inferenza a livello di data center indica che il settore di fornitura si aspetta di servire tutti, in stile RunPod, o si sta preparando per la fornitura a livello aziendale di fascia alta – una prospettiva allettante minata dalla generale mancanza di vantaggi nel dispiegamento di AI.

Se l’inferenza mesh diventa una realtà, è ragionevole aspettarsi che tra i primi tentativi di sfruttarla ci saranno gli incumbent, come OpenAI e Anthropic, che potrebbero distribuire sistemi dedicati all’interno di una grande base di installazione di app esistente o collaborare su sistemi open source che sono facili da installare (poiché le aziende di questa dimensione e portata hanno i soldi e il motivo per semplificare installazioni difficili di questo tipo).

Per quanto riguarda la possibilità che emerga una rete mesh più democratica e guidata dall’utente, un vero equivalente AI di BitTorrent – una serie di fattori si oppone a essa.

In primo luogo, l’attuale spinta globale contro la crittografia e l’anonimato potrebbe rimuovere o indebolire molti o tutti i meccanismi che rendono sistemi come BitTorrent anonimi, come la crittografia end-to-end e le VPN. Una volta che i flussi di dati crittografati generici che nascondono tali protocolli sono aperti all’ispezione, nuovi strati di controllo e divieto diventano possibili e ciò potrebbe minare l’appeal di un sistema in stile DarkBloom.

In secondo luogo, le norme emergenti o proposte contro l'”abuso” di AI o contro l’operazione anonima di framework open source significano che il costo della conformità – trascurabile a livello aziendale – probabilmente toglierebbe dal mercato tutti i giocatori più piccoli.

Infine – il potere di un grande giocatore di settore per abbracciare, estendere e estinguere (EEE, come Facebook e Twitter hanno fatto con comunità Internet più ad hoc), significa che i giocatori principali attuali possono operativizzare e semplificare il modello mesh a proprio vantaggio, in un mercato in cui gli utenti finali sono quasi del tutto intolleranti a qualsiasi attrito nell’adozione.

Pubblicato per la prima volta giovedì, 16 aprile 2026