Intelligenza artificiale

No, Non Stavano Limitando Claude – Era Ancora Peggio

Va bene, parliamo di cosa è successo con Claude, perché se l’hai utilizzato nel corso dell’ultimo mese, probabilmente hai notato che qualcosa non andava.

Per le ultime sei settimane, gli utenti di Claude hanno perso la testa. A partire da inizio agosto, le lamentele hanno iniziato a sommergere Reddit, X e forum per sviluppatori. I problemi erano ovunque:

- Il codice che funzionava perfettamente era improvvisamente rotto

- Claude affermava di aver apportato modifiche ai file quando non lo aveva fatto

- Caratteri thai o cinesi casuali apparivano nelle risposte in inglese

- Istruzioni completamente ignorate

- La stessa richiesta dava risposte di qualità molto diverse

- Gli utenti di Claude Code dicevano che si sentiva “lobotomizzato” rispetto a prima

Le lamentele sono diventate così gravi che a fine agosto, la gente era convinta che Anthropic stesse segretamente limitando Claude per risparmiare denaro. Le teorie del complotto erano ovunque – forse stavano riducendo la qualità durante le ore di punta, forse avevano sostituito silenziosamente un modello più economico, forse questo era un degrado intenzionale per gestire i costi del server.

Gli utenti pagavano per Claude Pro e ottenevano quello che sembrava Claude Lite. Gli sviluppatori che avevano costruito flussi di lavoro intorno a Claude stavano improvvisamente guardando la loro produttività precipitare. Con questo detto, alcuni utenti non stavano sperimentando problemi di sorta, il che rendeva tutto più confuso.

Anthropic Ammette Finalmente: Sì, Avevamo Problemi

Dopo settimane di lamentele degli utenti e crescente frustrazione, Anthropic ha appena pubblicato un’enorme analisi tecnica post-mortem che sostanzialmente dice: “Avevate ragione. Claude era rotto. Ecco cosa è successo.”

E la risposta è interessante.

Risulta che non si trattava di un problema solo. Erano tre bug di infrastruttura completamente separati, tutti verificatisi allo stesso tempo, creando una tempesta perfetta di degrado dell’IA. Non stavano limitando. Non stavano tagliando angoli. Avevano semplicemente tre cose rotte simultaneamente in modi che hanno impiegato sei settimane per capire e risolvere.

Lasciami spiegare esattamente cosa è andato storto, perché questo è in realtà uno sguardo utile su come questi sistemi di IA possono fallire in modi che nessuno si aspetta.

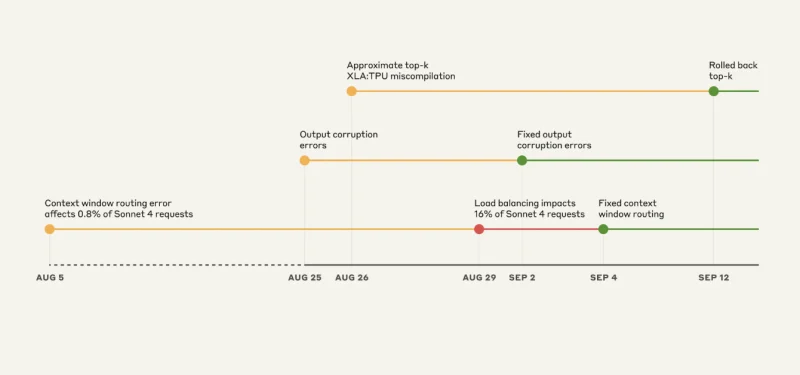

Il Collasso Triplo-Bug: Una Cronologia del Caos

Fonte: Anthropic

Bug #1: Il Problema Del Server Sbagliato

Questo è quasi divertente se non fossi stato tu a sperimentarlo. Claude Sonnet 4 era progettato per gestire 200.000 contesti di token. Ma a partire dal 5 agosto, alcune richieste sono state instradate su server configurati per 1 milione di contesti di token.

Inizialmente, solo lo 0,8% delle richieste è stato interessato. Nessun grande problema, giusto? Sbagliato.

Il 29 agosto, un aggiornamento del load balancer ha trasformato questo problema minore in un grande problema. Improvvisamente, al picco, il 16% delle richieste di Sonnet 4 sono state instradate sui server sbagliati. E l’instradamento era “appiccicoso”. Una volta che sei stato instradato male, continuavi a essere instradato male.

L’impatto:

- Circa il 30% degli utenti di Claude Code che erano attivi durante la finestra di tempo hanno avuto almeno una richiesta instradata male

- I tempi di risposta sono calati per gli utenti interessati

- Lo stesso utente ha sperimentato il problema ripetutamente mentre altri non hanno avuto problemi

Bug #2: Il Generatore Di Caratteri Casuali

Il 25 agosto, Anthropic ha distribuito una configurazione errata sui propri server TPU. Il risultato è stato che Claude ha iniziato a inserire casualmente caratteri thai e cinesi nelle risposte in inglese.

Immagina di chiedere a Claude di debuggare il tuo codice Python e ottenere questo:

def calculate_total(items)

total = 0

for item in items

總計 += item.price # <- Cosa?

return ผลรวม

Questo ha interessato:

- Opus 4.1 e Opus 4: 25-28 agosto

- Sonnet 4: 25 agosto – 2 settembre

La causa tecnica è stata un errore di generazione di token che ha assegnato una probabilità alta a caratteri che non avevano alcun senso lì. Ha letteralmente rotto il meccanismo fondamentale di come Claude seleziona la prossima parola da dire.

Bug #3: Il Bug Del Compilatore Invisibile

Questo è il più spaventoso dal punto di vista ingegneristico. C’era un bug latente nel compilatore XLA di Google che era rimasto dormiente. Quando Anthropic ha distribuito del codice per migliorare la selezione dei token il 25 agosto, ha accidentalmente attivato il bug.

Cosa ha fatto questo bug è stato veramente bizzarro – ha causato a Claude di escludere involontariamente il token più probabile quando generava del testo. Claude conosceva la risposta giusta ma era fisicamente impedito dal dirlo.

La parte veramente disturbante? Avevano già lavorato intorno a questo bug a dicembre 2024 senza rendersene conto. Quando hanno “risolto” ciò che pensavano fosse la causa radice ad agosto, hanno rimosso il workaround e scatenato il vero problema.

Perché Ci Sono Volute Sei Settimane Per Risolvere

Potresti chiederti: come fa una società come Anthropic, con ingegneri di classe mondiale, a impiegare sei settimane per capire cosa stava succedendo?

La risposta rivela quanto siano complessi questi sistemi:

1. I Controlli Di Privacy Hanno Bloccato Il Debugging

“I nostri controlli interni di privacy e sicurezza limitano come e quando gli ingegneri possono accedere alle interazioni degli utenti con Claude, in particolare quando quelle interazioni non vengono segnalate come feedback.”

Non potevano letteralmente vedere cosa stava rompendo a meno che gli utenti non lo segnalassero esplicitamente con un feedback. Buono per la privacy, terribile per il debugging.

2. I Bug Si Sono Nascosti

Claude spesso si riprendeva da errori individuali, facendo sembrare il degrado come una varianza normale piuttosto che un fallimento sistematico. Le loro valutazioni e benchmark non lo stavano cogliendo perché il modello si autocorreggeva abbastanza per superare i test.

3. Caos Multi-Piattaforma

Claude funziona su AWS Trainium, NVIDIA GPU e Google TPUs – tre piattaforme hardware completamente diverse. Ogni bug si è manifestato in modo diverso su ogni piattaforma:

- AWS Bedrock: lo 0,18% delle richieste di Sonnet 4 è stato interessato al picco

- Google Vertex AI: al di sotto dello 0,0004% interessato

- Direct API: fino al 16% interessato

Questo ha fatto sembrare che ci fossero più problemi non correlati piuttosto che tre bug specifici.

4. Sintomi Sovrapposti

Con tre bug attivi simultaneamente, i sintomi erano ovunque. Un utente poteva ottenere caratteri thai, un altro poteva ottenere risposte degradate, un terzo poteva vedere prestazioni perfette. Non c’era un modello chiaro da seguire.

Cosa Significa Tutto Ciò Per L’Affidabilità Dell’IA

Questa intera saga rivela qualcosa di cruciale sullo stato attuale dei sistemi di IA: sono molto più fragili di quanto appaiano.

Non stiamo parlando solo del modello di IA stesso. Stiamo parlando di:

- Infrastrutture di routing che possono inviare richieste nel posto sbagliato

- Implementazioni hardware-specifiche che si comportano in modo diverso

- Bug del compilatore che possono rimanere dormienti per mesi

- Load balancer che possono amplificare problemi minori in interruzioni maggiori

Un errore di configurazione, un bug del compilatore, un errore di routing – e improvvisamente il tuo assistente di IA dimentica come codificare o inizia a parlare lingue che non dovrebbe.

È Davvero Risolto?

Anthropic afferma di aver risolto tutti e tre i problemi il 16 settembre. Hanno:

- Risolti la logica di routing

- Ritirato le configurazioni problematiche

- Sostituito le operazioni top-k approssimative con quelle esatte (subendo un impatto sulle prestazioni per l’accuratezza)

- Aggiunto il monitoraggio continuo della produzione

Ma gli utenti stanno ancora segnalando problemi. Alcuni sviluppatori affermano che Claude Code si sente ancora degradato rispetto alle sue prestazioni precedenti. Che sia:

- Effetti residui dei bug

- Nuovi problemi che non sono stati ancora identificati

- Bias psicologico dopo settimane di problemi

- O degrado effettivo continuo

…non lo sappiamo ancora.

Il Punto Chiave

Questa situazione è un caso di studio perfetto su come i sistemi di IA complessi possano fallire in modi completamente inaspettati. Tre bug separati, tutti scattati entro poche settimane l’uno dall’altro, hanno creato una percezione di degrado della qualità che ha richiesto sei settimane per diagnosticare e risolvere.

Possiamo dare credito ad Anthropic per la trasparenza. Pubblicare un’analisi tecnica post-mortem dettagliata è più di quanto la maggior parte delle società farebbe. Ma mostra anche quanto possa andare storto sotto il cofano di questi sistemi su cui stiamo sempre più facendo affidamento.

Per chiunque stia costruendo su Claude o qualsiasi altro modello di linguaggio: avete bisogno di ridondanza, convalida e piani di backup. Perché come abbiamo appena visto, anche i migliori sistemi di IA possono avere tre problemi diversi contemporaneamente, e potrebbe volerci settimane prima che qualcuno capisca cosa sta realmente succedendo.

L’infrastruttura che supporta questi modelli di IA è altrettanto importante dei modelli stessi. E al momento, quell’infrastruttura sta mostrando alcuni seri dolori di crescita.