Partnership

InfraPartners e Emerald AI presentano “Data Center pronti alla flessibilità” per affrontare il collo di bottiglia energetico dell’AI

La rapida espansione dell’intelligenza artificiale sta spingendo le infrastrutture energetiche al limite. L’addestramento e l’esecuzione di modelli di intelligenza artificiale su larga scala richiedono cluster di calcolo massicci che consumano enormi quantità di elettricità, spesso più velocemente di quanto le reti elettriche locali possano espandersi. In risposta, InfraPartners e Emerald AI hanno annunciato una partnership finalizzata a ripensare radicalmente il modo in cui i data center dell’AI interagiscono con la rete elettrica, i dettagli sono nel whitepaper.

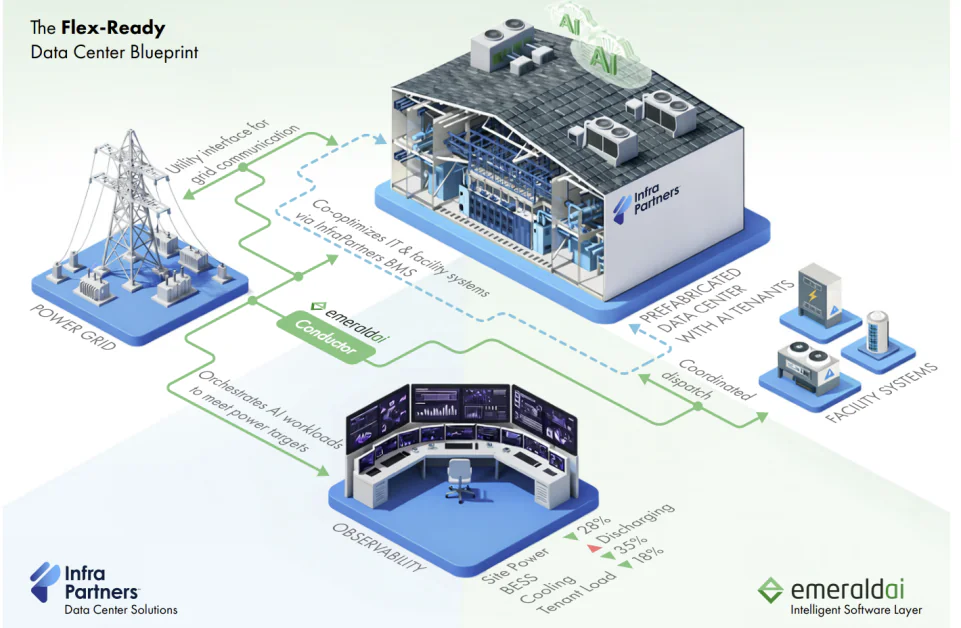

Le aziende stanno introducendo una nuova architettura chiamata Data Center pronti alla flessibilità, che combina il design di infrastrutture modulare di InfraPartners con il software di orchestrazione di Emerald AI. L’obiettivo è quello di trasformare i data center da consumatori statici di elettricità in partecipanti dinamici alla rete elettrica in grado di regolare la loro domanda di energia in tempo reale.

Invece di trattare il consumo di energia come fisso, l’approccio consente alle strutture di allineare i carichi di lavoro di calcolo con le condizioni della rete, la disponibilità di energia rinnovabile e il prezzo dell’elettricità – sbloccando capacità aggiuntive e migliorando la stabilità complessiva della rete.

Perché l’infrastruttura dell’AI sta creando una crisi energetica

I carichi di lavoro dell’AI sono tra le fonti di domanda di elettricità in più rapida crescita a livello globale. Il white paper rilasciato insieme alla partnership sottolinea come i data center siano diventati uno dei carichi più concentrati e in rapida espansione sui moderni sistemi di alimentazione.

Allo stesso tempo, l’espansione della rete è in ritardo. La costruzione di nuove linee di trasmissione, la carenza di manodopera e le limitazioni della catena di approvvigionamento significano che le nuove strutture possono attendere anni per ottenere una connessione alla rete.

Nel frattempo, la quota crescente di energia rinnovabile – in particolare eolica e solare – introduce volatilità nell’offerta, rendendo più complesso il bilanciamento in tempo reale della generazione e della domanda.

Questa dinamica crea un mismatch strutturale: l’infrastruttura dell’AI ha bisogno di più energia, ma la rete non può espandersi abbastanza rapidamente per fornirla.

Il white paper sostiene che la soluzione potrebbe non essere semplicemente costruire più capacità di rete. Invece, propone che i data center stessi possano diventare risorse flessibili che aiutano a stabilizzare i sistemi di alimentazione, assorbendo l’eccesso di energia rinnovabile o riducendo la domanda durante i picchi di stress della rete.

La blueprint del Data Center pronta alla flessibilità

La collaborazione integra due tecnologie fondamentali:

- L’architettura di data center aggiornabile di InfraPartners, progettata per supportare generazioni successive di hardware di intelligenza artificiale senza importanti ridisegni.

- La piattaforma Emerald Conductor di Emerald AI, uno strato software che orchestra i carichi di lavoro di calcolo, i sistemi di strutture e i segnali di rete.

Insieme, formano ciò che le aziende chiamano Data Center pronta alla flessibilità, progettata fin dall’inizio per partecipare ai mercati energetici e alla gestione della rete.

Secondo il white paper, questa integrazione consente ai data center di supportare la crescita dell’AI mentre migliorano contemporaneamente l’affidabilità della rete, riducono le emissioni e sbloccano nuovo valore economico attraverso programmi di rete.

Invece di adattare la flessibilità in un secondo momento, l’architettura integra la consapevolezza energetica direttamente nelle operazioni delle strutture fin dal primo giorno.

I tre dimensioni della flessibilità del data center

Centrale nel design è un framework che divide la flessibilità del data center in tre strati interagenti: flessibilità temporale, spaziale e di risorsa.

Flessibilità temporale

La flessibilità temporale si concentra sullo spostamento della domanda di energia nel tempo. Invece di eseguire carichi di lavoro in modo continuo a intensità massima, i lavori di calcolo possono essere pianificati in base alla disponibilità di elettricità, al prezzo o ai livelli di stress della rete.

Le tecniche includono:

- rinviare i carichi di lavoro di addestramento dell’AI non urgenti

- ridurre dinamicamente il consumo di energia dell’IT

- regolare l’operazione del sistema di raffreddamento

- coordinare con l’archiviazione di energia sul sito

Questo approccio consente ai data center di ridurre il carico durante i picchi di domanda della rete mentre aumenta il consumo quando la generazione di energia rinnovabile è abbondante.

Flessibilità spaziale

La flessibilità spaziale estende il concetto oltre una singola struttura.

I grandi operatori di AI spesso eseguono più data center in diverse regioni. Spostando in modo intelligente i carichi di lavoro tra i siti, gli operatori possono instradare i compiti di calcolo verso località dove l’energia è più economica, pulita o più facilmente disponibile.

Nella pratica, ciò significa che i carichi di lavoro dell’AI potrebbero seguire la generazione di energia rinnovabile o evitare le regioni che sperimentano congestione della rete.

Flessibilità di risorsa

Il terzo strato coinvolge la coordinazione di tutte le infrastrutture controllabili all’interno di un campus di data center.

Ciò include:

- sistemi IT e GPU

- infrastrutture di raffreddamento

- sistemi di alimentazione ininterrotta (UPS)

- sistemi di archiviazione di energia

- generazione di energia sul sito

Quando orchestrati insieme, questi asset consentono a una struttura di regolare il consumo di energia mentre mantiene l’affidabilità e gli accordi di livello di servizio.

Emerald Conductor: orchestrare calcolo, strutture e rete

Il livello di orchestrazione che consente queste capacità è la piattaforma Emerald Conductor di Emerald AI.

Il sistema opera come una piattaforma di controllo gerarchico che copre tre livelli operativi:

1. Livello IT

Al livello di calcolo, Emerald Conductor si integra con i pianificatori di carichi di lavoro e la telemetria del sistema per regolare l’intensità del calcolo. I modelli predittivi identificano i carichi di lavoro che possono essere rinviati o riorganizzati senza violare gli accordi di livello di servizio.

L’addestramento dell’AI, l’elaborazione batch e altri carichi di lavoro non critici per la latenza diventano candidati per la pianificazione flessibile.

2. Livello di strutture

La piattaforma si collega anche al sistema di gestione degli edifici (BMS) del data center, acquisendo telemetria dalle infrastrutture di raffreddamento, dall’attrezzatura di distribuzione di energia, dai sistemi UPS e dalle batterie.

Ciò consente al software di regolare dinamicamente i parametri operativi, di inviare energia archiviata o di coordinare strategie di raffreddamento mentre rispetta i margini di sicurezza e i requisiti di ridondanza.

DC Flex Ready Executive White P…

3. Livello di interfaccia di rete

Al livello esterno, Emerald Conductor collega i data center ai segnali di rete, compresi eventi di risposta alla domanda, prezzi all’ingrosso dell’elettricità e avvisi di affidabilità.

Questi segnali vengono tradotti in azioni coordinate attraverso l’infrastruttura IT e di strutture, abilitando la partecipazione automatizzata ai programmi di mercato energetico e ai servizi di stabilizzazione della rete.

L’architettura di data center aggiornabile di InfraPartners

Mentre Emerald AI fornisce il livello di orchestrazione, InfraPartners si concentra su come le infrastrutture fisiche sono progettate e costruite.

La sua architettura di data center aggiornabile è destinata a risolvere un problema diverso ma correlato: l’evoluzione rapida del hardware di intelligenza artificiale.

Le moderne GPU e acceleratori richiedono spesso nuove densità di potenza, tecnologie di raffreddamento e layout di infrastrutture ogni pochi anni. I data center tradizionali faticano ad adattarsi, portando a costosi retrofit o capacità inutilizzate.

Il design di InfraPartners introduce architetture di alimentazione e raffreddamento fungibili in grado di supportare più generazioni di hardware senza importanti ridisegni.

L’azienda si affida anche fortemente alla costruzione in fabbrica, con circa l’80% della struttura assemblata e testata fuori sede prima del deploy. Questo modello di produzione riduce i tempi di costruzione mentre migliora il controllo della qualità e la ripetibilità.

Le strutture possono scalare in modo incrementale, da 5 megawatt di deploy a campus di scala gigawatt, consentendo agli operatori di espandere la capacità mentre la domanda di AI cresce.

Integrare la flessibilità al livello di infrastruttura

La partnership integra i due sistemi attraverso una profonda integrazione di telemetria e controllo.

I sistemi di gestione degli edifici di InfraPartners trasmettono dati operativi in tempo reale – compresi potenza, raffreddamento e metriche dei sistemi di energia – nel motore di ottimizzazione di Emerald Conductor.

La piattaforma di orchestrazione determina quindi come i carichi di lavoro, i sistemi di infrastrutture e le risorse energetiche dovrebbero rispondere alle condizioni della rete.

Poiché l’infrastruttura è progettata con la flessibilità in mente, il sistema può regolare in modo sicuro le operazioni senza compromettere l’affidabilità o i requisiti di uptime.

Questo livello di integrazione consente inoltre ai data center di partecipare a programmi di rete come:

- risposta alla domanda

- mercati all’ingrosso di energia

- servizi di affidabilità di rete

Questi programmi creano nuovi flussi di entrate mentre aiutano le utility a gestire la domanda di elettricità.

Un nuovo modello per l’infrastruttura dell’AI

Mentre l’AI continua a espandersi attraverso le industrie, la disponibilità di energia sta diventando una delle limitazioni più importanti per la crescita della tecnologia.

Il modello di Data Center pronta alla flessibilità suggerisce un approccio diverso alla scalabilità dell’infrastruttura di calcolo. Invece di trattare i data center come carichi passivi sulla rete, il design li posiziona come partecipanti attivi ai sistemi di energia, in grado di coordinare la domanda di calcolo con la disponibilità di energia.

Se ampiamente adottato, l’architettura potrebbe aiutare ad accelerare la distribuzione dell’AI mentre allevia la pressione sulle infrastrutture elettriche – una sfida sempre più critica mentre i modelli di AI crescono più grandi e più energivori.