Partnership

Infineon Technologies e d-Matrix collaborano su infrastrutture AI a bassa latenza

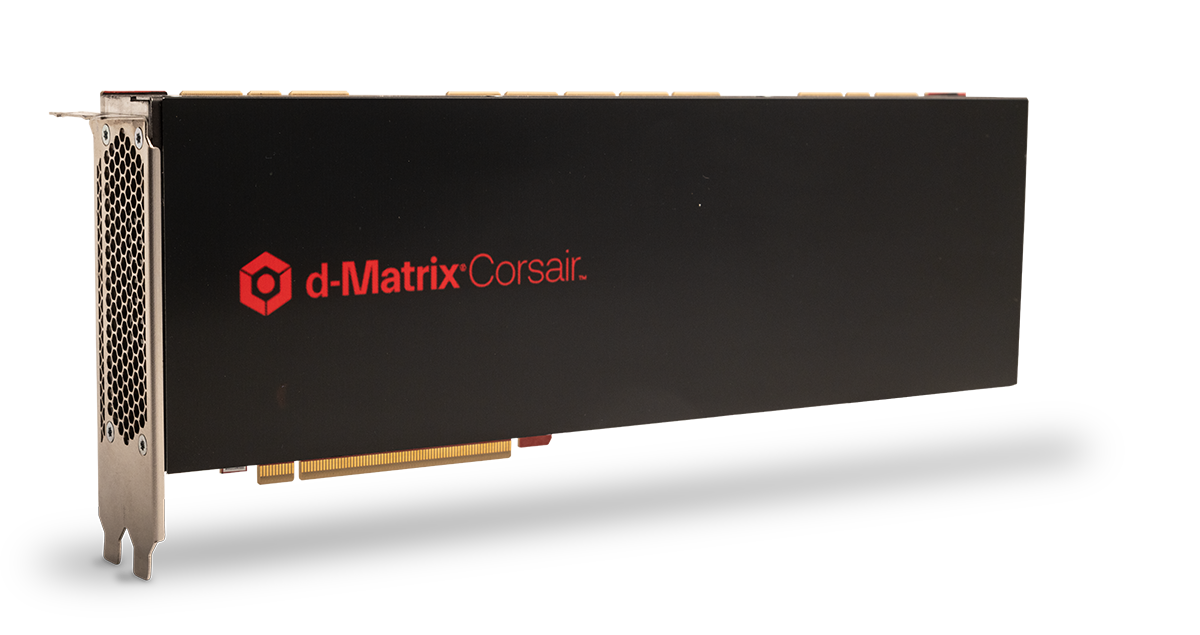

Infineon Technologies ha annunciato una collaborazione con d-Matrix focalizzata sul miglioramento delle prestazioni e dell’efficienza energetica dei sistemi di inferenza AI utilizzati nei moderni data center. La partnership si concentra sulla piattaforma di accelerazione dell’inferenza AI Corsair di d-Matrix e sui moduli di alimentazione duale OptiMOS di Infineon, progettati per supportare ambienti di calcolo ad alta densità per carichi di lavoro AI interattivi.

L’annuncio evidenzia una crescente tendenza all’interno dell’industria dell’hardware AI. Mentre gran parte del boom dell’infrastruttura negli ultimi anni si è concentrata sull’addestramento di modelli AI sempre più grandi, l’industria si sta ora rapidamente espandendo verso l’inferenza – il processo di esecuzione dei modelli in applicazioni del mondo reale come chatbot, sistemi AI agente, copiloti, ricerca, analisi finanziarie e supporto alle decisioni sanitarie. Questi carichi di lavoro pongono esigenze diverse sull’hardware, in particolare intorno alla latenza, alla risposta e al consumo di energia.

Perché l’inferenza AI sta diventando un importante campo di battaglia dell’hardware

L’inferenza AI è emersa come uno dei segmenti di crescita più rapida del mercato dell’infrastruttura AI, poiché i sistemi AI interattivi richiedono risposte in millisecondi piuttosto che in secondi. d-Matrix ha posizionato Corsair specificamente per questi carichi di lavoro, sottolineando la latenza ultra-bassa e l’inferenza efficiente in termini di energia per grandi modelli linguistici e agenti AI.

Secondo d-Matrix, Corsair è stata progettata intorno a un’architettura di calcolo in memoria digitale destinata a ridurre le bottiglie di collo che spesso rallentano l’inferenza dei modelli AI generativi. La società afferma che la piattaforma può ridurre significativamente la latenza e migliorare la velocità di elaborazione rispetto ai sistemi di inferenza tradizionali basati su GPU, in particolare per le applicazioni interattive.

La partnership con Infineon affronta un’altra sfida sempre più critica: la consegna di energia.

Man mano che i server AI continuano ad aumentare in densità, la consegna efficiente di energia agli acceleratori è diventata un fattore limitante per la scalabilità dell’infrastruttura. I moduli OptiMOS TDM2254xx di Infineon sono progettati per architetture di consegna di energia verticali che aiutano a ridurre le perdite elettriche e migliorare la densità di potenza all’interno di sistemi server compatti.

La tendenza verso sistemi AI in tempo reale

Le società hanno inquadrato la collaborazione intorno alla crescita dell'”AI interattiva”, dove i sistemi di inferenza devono generare continuamente output con ritardi estremamente bassi. Ciò include l’AI conversazionale, gli agenti AI, i sistemi di ragionamento in tempo reale e le applicazioni che richiedono la generazione rapida di token da grandi modelli linguistici.

Il fondatore e CEO di d-Matrix, Sid Sheth, ha affermato che l’architettura dietro Corsair è stata costruita specificamente per una latenza di token inferiore a 2 millisecondi, una metrica che è diventata sempre più importante man mano che le aziende spostano i sistemi AI dall’esperimentazione agli ambienti di produzione.

L’industria AI più ampia sta anche iniziando a riconoscere che l’infrastruttura di inferenza potrebbe evolversi in modo diverso dall’infrastruttura di addestramento. Mentre i cluster GPU hanno dominato la prima fase dell’espansione dell’AI generativa, l’inferenza premia sempre più le architetture ottimizzate intorno alla larghezza di banda della memoria, alla latenza, alla rete e all’efficienza energetica piuttosto che al solo calcolo grezzo.

L’efficienza energetica sta diventando centrale per la scalabilità AI

Una delle maggiori limitazioni che i provider di servizi cloud e i fornitori di infrastrutture AI devono affrontare è la domanda di energia elettrica. I carichi di lavoro di inferenza AI possono eseguirsi continuamente su milioni di richieste al giorno, rendendo l’efficienza operativa critica per i costi di distribuzione.

Infineon ha ampliato aggressivamente la sua posizione all’interno dell’infrastruttura AI attraverso tecnologie semiconduttrici basate su silicio, carburo di silicio (SiC) e nitruro di gallio (GaN). La società si è concentrata sempre più sul fornire lo strato di consegna di energia sotto gli acceleratori AI e l’infrastruttura del server.

La collaborazione con d-Matrix riflette come le società di semiconduttori stanno diventando più strettamente integrate con le startup di acceleratori AI mentre l’industria cerca alternative alle architetture tradizionali basate su GPU.

L’infrastruttura AI si sta espandendo oltre le tradizionali GPU

La partnership arriva anche durante un’onda più ampia di sperimentazione nell’hardware AI. Un numero crescente di startup sta sviluppando acceleratori specializzati focalizzati specificamente sull’inferenza, sul calcolo centrato sulla memoria o sulla rete AI.

d-Matrix si è distinta attraverso la sua enfasi sulle tecnologie di calcolo in memoria e sui sistemi di inferenza a bassa latenza progettati per l’AI generativa. La società ha anche ampliato la sua strategia di infrastruttura oltre i soli chip di accelerazione, sottolineando recentemente la rete, l’infrastruttura componibile e l’ottimizzazione del sistema completo per i cluster di inferenza.

Man mano che le applicazioni AI diventano sempre più agente e interattive, i fornitori di infrastrutture sono tenuti a porre maggiore enfasi sulla riduzione della latenza, sulla riduzione del consumo di energia e sul miglioramento dell’efficienza a livello di sistema in tutto lo stack del data center, piuttosto che concentrarsi solo sulla potenza di elaborazione grezza.