Leader di pensiero

Gli agenti autonomi necessitano di più dell’osservabilità dell’AI

Man mano che le aziende utilizzano gli agenti AI per pensare, agire e avviare flussi di lavoro, è fondamentale sviluppare un piano per monitorare e gestire tali agenti.

Quando vari componenti di un sistema AI iniziano a prendere decisioni autonome, l’osservabilità da sola non è sufficiente per garantire che le operazioni rimangano stabili, sicure o affidabili.

Per gestire efficacemente gli agenti AI in tutta l’azienda, le imprese devono colmare il divario tra l’identificazione dei problemi e l’azione. Ciò va al di là della semplice osservazione dei problemi; le aziende devono attivamente prevenirli.

L’emergere degli agenti autonomi

La prima ondata di AI aziendale era costituita da sistemi basati su prompt; un utente poneva una domanda, il modello rispondeva e lo scambio si concludeva lì. Sebbene queste prime tecnologie fossero essenzialmente reattive, erano utili per la ricerca, i copiloti, la creazione di contenuti e la sintesi.

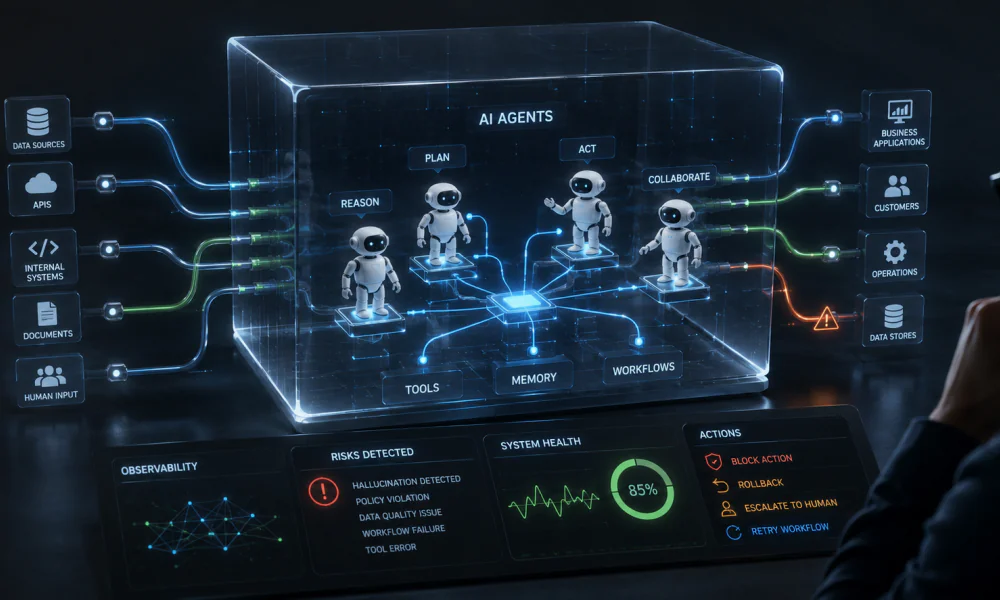

La successiva ondata è diversa. Gli agenti AI autonomi non solo reagiscono, ma ragionano anche su obiettivi, selezionano strumenti, estraggono informazioni, agiscono e avviano flussi di lavoro. A volte lavorano in tandem con altri agenti o sistemi e sempre più spesso svolgono il ruolo di attori operativi all’interno dell’azienda, piuttosto che come livello di interfaccia per le istruzioni umane.

Questo cambiamento è significativo perché influisce sulle caratteristiche operative dell’AI. I team non stanno più solo monitorando gli output dei modelli. Stanno invece gestendo sistemi dinamici che possono influenzare immediatamente clienti, personale, infrastrutture, processi aziendali e altre applicazioni.

Le capacità degli agenti oggi

Le capacità degli agenti evolvono insieme a loro. Gli agenti possono selezionare cosa fare dopo, suddividere un obiettivo in passaggi e completare attività a vari livelli. Contattando API, interrogando database, cercando sistemi interni, aggiornando record e avviando azioni a valle, coordinano i flussi di lavoro. Integrando prompt, memoria, regole aziendali, informazioni recuperate e segnali operativi in tempo reale, gli agenti possono anche prendere decisioni basate sul contesto.

Gli agenti più sofisticati possono rilevare quando un flusso di lavoro sta fallendo, riprovare, escalare problemi o inoltrare lavori a un revisore umano. All’interno di CRM, ticketing, infrastrutture cloud, basi di conoscenza interne, piattaforme di osservabilità e applicazioni aziendali, gli agenti possono funzionare in modo indipendente. Ci aspettiamo che queste capacità continuino a espandersi rapidamente.

Come le aziende stanno integrando gli agenti AI autonomi

Gli agenti stanno essere incorporati in una gamma sempre più ampia di operazioni aziendali e si stanno avvicinando a processi operativi in cui velocità, accuratezza, sicurezza e governance sono importanti. Alcune di queste operazioni includono: servizio clienti e gestione dei casi, risposta agli incidenti e operazioni IT, flussi di lavoro per DevOps e affidabilità del sito, correzione del codice e sviluppo software, pianificazione operativa e della catena di approvvigionamento, e altro ancora.

Minacce operative emergenti

Tuttavia, man mano che gli agenti diventano sempre più indipendenti, le aziende devono affrontare un nuovo tipo di rischio operativo.

- Le scelte sbagliate non sono semplicemente consigliate; vengono spesso eseguite

- Errori minori possono diffondersi rapidamente ad altri sistemi collegati

- Azioni nel mondo reale possono essere innescate da allucinazioni

- Gli agenti possono allontanarsi dall’intento aziendale, dalle politiche o dalla conformità

- Le interazioni tra più componenti possono portare a fallimenti

- La presa di decisioni automatizzata può prendere decisioni più velocemente della valutazione umana

Mentre i team possono osservare i sintomi, devono anche essere in grado di comprendere le ragioni alla base del comportamento del sistema. L’AI aziendale necessita di controlli di affidabilità in aggiunta alla visibilità.

La complessità dei sistemi AI

I sistemi AI guidati odierni raramente sono costituiti da un singolo modello. Sono sistemi distribuiti e stratificati composti da molti componenti interagenti che includono:

- Modelli fondamentali (LLM)

- Modelli linguistici piccoli e specifici per attività (SLM)

- Modelli di incorporamento

- Banche dati vettoriali

- Pipeline di recupero e componenti RAG

- Modelli di prompt e livelli di orchestrazione dei prompt

- Set di dati di formazione e valutazione

- Livelli di guardrail e politica

- Agenti e flussi di lavoro

- Sistemi di chiamata di strumenti

- Telemetria (aka log, metriche e tracce)

- Punti di controllo di approvazione umana nel ciclo

I rischi

Ogni componente aggiunge un diverso modo di fallimento e il modo in cui interagiscono aggiunge ulteriore complessità. Anche se un sistema sembra essere forte al livello dell’infrastruttura, potrebbe comunque prendere decisioni sbagliate e generare risultati soddisfacenti; tutto ciò mentre si accumula il rischio operativo al di sotto della superficie.

Alcuni dei rischi associati includono: l’introduzione di input scadenti o corrotti da parte delle pipeline di dati, i colli di bottiglia dell’infrastruttura che riducono l’affidabilità, i risultati dannosi o errati e i colli di bottiglia operativi nella risposta alla revisione umana. Ulteriormente, i sistemi con più agenti o passaggi possono fallire in modi che non sono immediatamente evidenti.

L’osservabilità dell’AI

Il monitoraggio tradizionale è insufficiente per comprendere il comportamento dei prompt, la qualità del recupero, la deriva del modello, i canali di esecuzione degli agenti o la connessione tra il comportamento dell’AI e l’impatto aziendale o operativo a valle.

È qui che entra in gioco l’osservabilità dell’AI. L’osservabilità dell’AI consente ai team di comprendere come funzionano i sistemi AI in produzione raccogliendo, correlando e valutando input e output, comportamenti desiderati e segnali di decisione generati da tali sistemi. Ciò è essenziale, poiché i sistemi AI sono dispersi, non deterministici e estremamente sensibili al contesto.

L’osservabilità dell’AI offre una visione completa dei flussi di lavoro dell’AI, in modo che i team che la utilizzano possano comprendere come prompt, modelli, livelli di recupero, strumenti e sistemi a valle interagiscono durante l’esecuzione.

L’osservabilità dell’AI consente di monitorare le prestazioni e il comportamento, compresa la latenza, il costo, l’utilizzo dei token, la velocità di elaborazione, i tassi di errore e gli indicatori di qualità dell’output del modello. Traccia e analizza i percorsi di esecuzione nei flussi di lavoro degli agenti complessi e dimostra come i risultati vengano raggiunti attraverso più passaggi e dipendenze.

L’osservabilità dell’AI trova anche anomalie attraverso segnali operativi e dell’AI esponendo un comportamento anomalo nei modelli, nelle pipeline, nell’infrastruttura o nei risultati a livello di utente prima che i team li scoprono manualmente. Acceleri la diagnostica quando qualcosa va storto e rende più facile l’indagine sulle cause radice includendo le operazioni specifiche dell’AI nella telemetria del sistema (log, metriche, tracce ed eventi).

L’osservabilità da sola non è sufficiente

Nonostante sia una pratica aziendale essenziale, l’osservabilità dell’AI ha limitazioni innate.

L’osservabilità è diagnostica piuttosto che preventiva; i team possono apprendere cosa è andato storto ma non necessariamente come impedire che si verifichi di nuovo. È importante comprendere che la conoscenza delle azioni passate di un agente non si traduce automaticamente nel controllo delle azioni future dell’agente.

Per quanto riguarda i sistemi non deterministici complessi, l’osservabilità può spesso sopraffare i team con dati che portano all’incertezza. Piuttosto che offrire una risposta operativa, l’osservabilità si conclude spesso con una spiegazione. Anche se i team sono a conoscenza di un problema, potrebbero non avere l’automazione, le salvaguardie e i cicli di controllo necessari per intraprendere azioni correttive.

Ciò crea un divario operativo. Le aziende possono rilevare la deriva, i risultati scadenti, il comportamento pericoloso o la produttività degradata, ma potrebbero comunque non essere in grado di impedire che si verifichino di nuovo, mitigarne gli effetti o mantenere sistemi autonomi all’interno di parametri di funzionamento sicuri.

Ciò significa che i team continuano a operare in modo reattivo. Utilizzano l’intervento manuale quando qualcosa si rompe, indagano sugli incidenti dopo il fatto e si affidano al lavoro umano per compensare i sistemi che stanno diventando più veloci e più autonomi.

Una panoramica sull’affidabilità dell’AI

L’affidabilità dell’AI va al di là della semplice osservazione dei problemi. È la disciplina di garantire che i sistemi AI funzionino in modo sicuro, coerente, prevedibile e con successo in contesti di produzione reali. L’affidabilità dell’AI comprende e gestisce l’intero sistema di sistemi intorno all’AI. Chiude il ciclo tra rilevamento e azione.

L’affidabilità dell’AI si concentra sul fatto che l’intero sistema guidato dall’AI possa funzionare all’interno di limiti operativi ragionevoli nel tempo, piuttosto che se un modello abbia fornito una risposta precisa. La qualità, la sicurezza, la resilienza, la spiegabilità, la conformità alle politiche, l’efficienza dei costi e la stabilità operativa fanno tutte parte dell’equazione.

La transizione dalla rilevazione alla prevenzione

L’affidabilità dell’AI riduce il tempo tra il riconoscimento di un problema e la sua risoluzione. Sposti la conversazione da “cosa è andato storto?” a “quanto velocemente il nostro AI migliorerà?” Utilizzando le seguenti tecniche si sposta l’osservabilità dall’osservazione passiva alla prevenzione attiva:

- Correlare segnali attraverso modelli, dati e infrastrutture per identificare problemi

- Rilevamento proattivo dei problemi prima del loro impatto

- Verificare tutti gli input e gli output nei sistemi AI probabilistici per rilevare sottili cambiamenti comportamentali

- Creare un ciclo di feedback tra la rilevazione di output indesiderabili in produzione e l’utilizzo di tali informazioni per generare dati di fine-tuning che migliorano la precisione dei modelli sottostanti

- Tracciamento del flusso di lavoro degli agenti multipli per assicurarsi di poter collegare i punti sul perché e come i dati sono evoluti per informare azioni complesse

- Flussi di lavoro agente umano definiti per una risposta sicura e un rimedio automatizzato

Colmare il divario tra controllo e osservazione

Le aziende traggono beneficio da framework che integrano visibilità e controllo e richiedono più di un semplice livello di osservabilità sopra l’AI generativa. In sistemi sia deterministici che non deterministici, una piattaforma di affidabilità può identificare, anticipare, spiegare e aiutare a controllare i problemi.

Il seguente dovrebbe essere incluso in un quadro praticabile per operazioni AI affidabili:

- Telemetria integrata per sistemi IT e AI

- Tracciamento del flusso di lavoro agente e delle dipendenze del sistema end-to-end

- Tracciamento del comportamento e della qualità specifici dell’AI (prompt ed eval)

- Rilevamento avanzato delle anomalie, indipendentemente dalla fonte

- Ragionamento causale e analisi della causa radice

- Sistema di allarme che si adatta automaticamente all’ambiente e non richiede soglie manuali

- Applicazione delle politiche e guardrail

- Valutazione umana nel ciclo per azioni delicate o significative

- Automazione dei flussi di lavoro e coordinamento del rimedio

- Utilizzo dell’analisi predittiva per prevenire problemi

- Cicli di feedback che collegano la rilevazione delle anomalie con la qualità migliorata del modello AI

Facilitare le funzioni dell’AI

I sistemi AI si basano sull’infrastruttura, sui servizi, sulle pipeline di dati e sulle routine operative; non falliscono da soli. I team ottengono una visione completa quando sia l’affidabilità dell’AI che quella dell’IT sono combinate.

Un sottile wrapper LLM non dovrebbe essere la base di una piattaforma affidabile. Per identificare e risolvere problemi che altri strumenti AI generativi trascurano, dovrebbero essere presi in considerazione una varietà di tecniche AI, tra cui AI non supervisionata, AI predittiva, AI causale e AI generativa. Questa combinazione di tecniche è comunemente nota come “AI composita”.

L’AI generativa è adatta per la sintesi del linguaggio naturale. È meglio adatta a situazioni che richiedono il ragionamento attraverso dati non strutturati o quando si interagisce con gli esseri umani. Ma ciò non si adatta alla forma della maggior parte dei problemi di affidabilità in produzione.

L’AI predittiva si concentra sull’identificazione di segnali precoci prima che diventino interruzioni, esperienze clienti scadenti o fallimenti costosi utilizzando algoritmi di rilevamento delle anomalie.

L’AI causale aiuta a determinare le vere cause radice per rivelare se la qualità del recupero, il comportamento del modello, la lentezza dell’infrastruttura, la deriva dei dati a monte o il fallimento del sistema a valle era la causa di un calo delle prestazioni.

L’AI non supervisionata scopre autonomamente modelli, strutture o anomalie nascoste nei dati senza guida umana. Supera l’AI generativa per l’affidabilità perché si concentra sul trovare strutture nascoste all’interno di dati complessi e non classificati per raggruppare elementi simili o trovare relazioni.

Quando il rischio, l’ambiguità o gli effetti aziendali sono significativi, gli agenti operativi dell’AI devono essere in grado di automatizzare la reazione mantenendo al contempo il coinvolgimento umano per operazioni affidabili.

La comprensione del modello AI del particolare contesto aziendale può essere migliorata in ogni incontro utilizzando l’apprendimento per rinforzo dai dati degli utenti reali in produzione.

Anche i sistemi più avanzati vanno oltre l’allarme; la remediation a ciclo chiuso apprende da ogni incidente nel tempo, automatizza le reazioni riconosciute e avvia misure sicure.

Prepararsi per i sistemi AI autonomi

Le aziende possono prepararsi per i sistemi AI autonomi in diversi modi. Innanzitutto, gli agenti dovrebbero essere considerati come sistemi operativi piuttosto che come strumenti per la produttività. Una volta che un agente ha la capacità di agire, diventa una parte integrante delle operazioni aziendali e dovrebbe essere regolamentato di conseguenza.

I team possono registrare segnali da modelli, prompt, strumenti, flussi di lavoro, infrastrutture e risultati utente fin dall’inizio strumentando gli agenti. Questa sorveglianza di base non può e non deve essere ritardata fino a quando gli agenti diventano essenziali per l’azienda.

Stabilire standard di affidabilità prima della diffusa distribuzione degli agenti è anche cruciale. Soglie accettabili per la sicurezza, la latenza, i tassi di errore, il rischio di allucinazione, la conformità alle politiche e l’impatto aziendale dovrebbero essere incorporati nel loro design.

Collegare il comportamento dell’AI ai sistemi e procedure sottostanti che lo supportano consente alle aziende di integrare le operazioni AI e IT. Utilizzare strumenti diversi per l’infrastruttura e per il monitoraggio del modello crea punti ciechi.

L’ingegneria della piattaforma, SRE, sicurezza, team di dati, team AI e proprietari aziendali devono lavorare insieme per fornire operazioni AI affidabili, e i sistemi autonomi trascendono i silos convenzionali.

Ogni incidente, anomalia e quasi-incidente migliorerà il sistema incorporando cicli di feedback nelle operazioni, consentendo alle aziende di imparare continuamente dal comportamento di produzione.

Infine, è fondamentale selezionare piattaforme progettate per il controllo piuttosto che solo per l’osservazione. Le aziende trarranno beneficio da sistemi che integrano osservabilità, previsione, spiegazione e azione man mano che gli agenti AI diventano più autonomi. Le organizzazioni che trasferiscono con successo dall’identificazione dei problemi al controllo sicuro degli esiti saranno i vincitori.

Il punto fondamentale

L’AI nelle aziende è ora un sistema operativo in ambienti aziendali piuttosto che uno strumento. In ambienti di produzione reali, aggiungere l’affidabilità ai sistemi AI garantisce operazioni sicure, coerenti, prevedibili ed efficienti. Da identificare i problemi a controllare in modo sicuro gli esiti sarà il vincitore. L’AI nelle aziende è ora un sistema operativo in ambienti aziendali piuttosto che uno strumento. In ambienti di produzione reali, aggiungere l’affidabilità ai sistemi AI garantisce operazioni sicure, coerenti, prevedibili ed efficienti.