Intelligenza artificiale

La ricerca sull’AI prevede controlli del volume separati per dialogo, musica e effetti sonori

Una nuova collaborazione di ricerca guidata da Mitsubishi indaga la possibilità di estrarre tre tracce audio separate da una fonte audio originale, suddividendo la traccia audio in discorso, musica e effetti sonori (ad esempio rumore ambientale).

Poiché si tratta di un framework di post-elaborazione, offre potenziali possibilità per le future generazioni di piattaforme di visualizzazione multimediali, compresi i dispositivi consumer, di offrire controlli del volume a tre punti, consentendo all’utente di alzare il volume del dialogo o abbassare il volume di una colonna sonora.

Nel breve clip qui sotto dal video che accompagna la ricerca (vedi fine dell’articolo per il video completo), vediamo diversi aspetti della colonna sonora enfatizzati mentre l’utente trascina un controllo su un triangolo con ciascuno dei tre componenti audio in un angolo:

Un breve clip dal video che accompagna il documento (vedi embed alla fine dell’articolo). Mentre l’utente trascina il cursore verso uno dei tre aspetti estratti nel triangolo UI (a destra), l’audio enfatizza quella parte della colonna sonora tripartita. Sebbene il video più lungo citi una serie di ulteriori esempi su YouTube, questi sembrano attualmente non disponibili. Fonte: https://vimeo.com/634073402

Il documento si intitola The Cocktail Fork Problem: Three-Stem Audio Separation for Real-World Soundtracks, e proviene da ricercatori dei Mitsubishi Electric Research Laboratories (MERL) di Cambridge, MA, e del Dipartimento di Ingegneria dei Sistemi Intelligenti dell’Università dell’Indiana.

Separazione di aspetti di una colonna sonora

I ricercatori hanno definito la sfida ‘The Cocktail Party Problem’ perché coinvolge l’isolamento di elementi severamente intrecciati di una colonna sonora, che crea una mappa che assomiglia a una forchetta (vedi immagine qui sotto). Nella pratica, le colonne sonore multicanale (ad esempio stereo e più) possono avere quantità diverse di tipi di contenuto, come dialogo, musica e atmosfera, in particolare poiché il dialogo tende a dominare il canale centrale nelle miscele Dolby 5.1. Al momento, tuttavia, il campo di ricerca molto attivo della separazione audio si concentra sul catturare questi fili da una colonna sonora singola e composta, come fa la ricerca attuale.

The Cocktail Fork – derivazione di tre colonne sonore distinte da una colonna sonora singola e composta. Fonte: https://arxiv.org/pdf/2110.09958.pdf

Le ricerche recenti si sono concentrate sull’estrazione del discorso in vari ambienti, spesso per scopi di denoising del discorso audio per il successivo coinvolgimento con sistemi di Elaborazione del Linguaggio Naturale (NLP), ma anche sull’isolamento di voci di cantanti d’archivio, sia per creare versioni sintetiche di cantanti reali (anche morti), sia per facilitare l’isolamento della musica in stile Karaoke.

Un set di dati per ciascun aspetto

Finora, è stata data poca considerazione all’uso di questo tipo di tecnologia AI per dare agli utenti un maggiore controllo sulla miscela di una colonna sonora. Pertanto, i ricercatori hanno formalizzato il problema e generato un nuovo set di dati come aiuto per la ricerca continua sulla separazione di colonne sonore multitype, nonché testandolo su vari framework di separazione audio esistenti.

Il nuovo set di dati che gli autori hanno sviluppato si chiama Divide and Remaster (DnR), e deriva da set di dati precedenti LibriSpeech, Free Music Archive e il Freesound Dataset 50k (FSD50K). Per coloro che desiderano lavorare con DnR da zero, il set di dati deve essere ricostruito dalle tre fonti; altrimenti, sarà presto disponibile su Zenodo, affermano gli autori. Tuttavia, al momento della scrittura, il link GitHub fornito per gli strumenti di estrazione delle fonti non è attualmente attivo, quindi coloro che sono interessati potrebbero dover aspettare un po’.

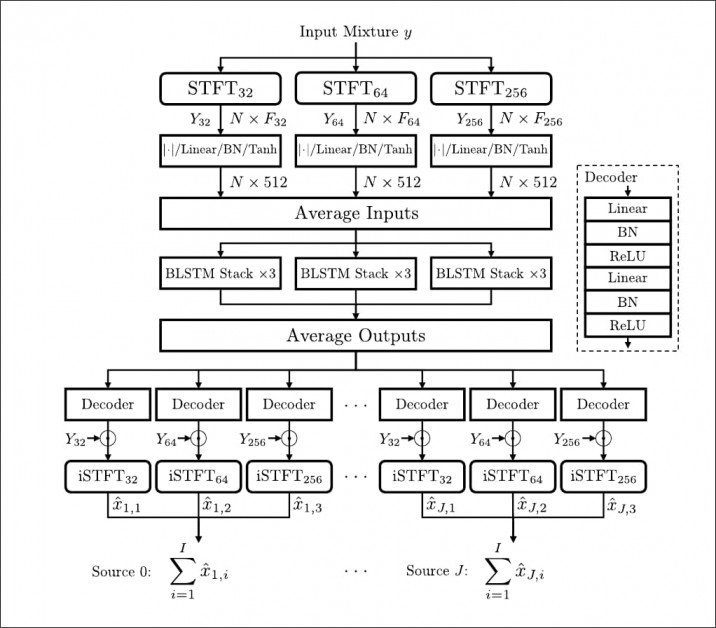

I ricercatori hanno scoperto che l’architettura CrossNet un-mix (XUMX) proposta da Sony in maggio funziona particolarmente bene con DnR.

Architettura audio CrossNet di Sony.

Gli autori affermano che i loro modelli di estrazione di apprendimento automatico funzionano bene sulle colonne sonore di YouTube, sebbene le valutazioni presentate nel documento si basino su dati sintetici e il video principale di supporto (incluso qui sotto) sia attualmente l’unico che sembra essere disponibile.

I tre set di dati utilizzati comprendono ciascuno una raccolta del tipo di output che deve essere separato da una colonna sonora: FSD50K è occupato con effetti sonori e presenta 50.000 clip audio mono a 44,1 kHz etichettate con 200 etichette di classe dall’ontologia AudioSet di Google; il Free Music Archive presenta 100.000 canzoni stereo che coprono 161 generi musicali, sebbene gli autori abbiano utilizzato un subset che contiene 25.000 canzoni, per parità con FSD50K; e LibriSpeech fornisce a DnR 100 ore di campioni audio di libri come file audio mp3 a 44,1 kHz.

Lavori futuri

Gli autori prevedono ulteriori lavori sul set di dati e una combinazione dei modelli separati sviluppati per ulteriori ricerche su framework di riconoscimento del discorso e classificazione dei suoni, con generazione automatica di didascalie per discorso e suoni non discorsivi. Intendono anche valutare le possibilità per approcci di remixing che possano ridurre gli artifact percettivi, che rimane il problema centrale quando si divide una colonna sonora composta nei suoi componenti costitutivi.

Questo tipo di separazione potrebbe in futuro essere disponibile come commodity per i consumatori in smart TV che incorporano reti di inferenza altamente ottimizzate, sebbene sembri probabile che le prime implementazioni richiedano un certo livello di tempo di pre-elaborazione e spazio di archiviazione. Samsung già utilizza reti neurali locali per l’upsampling, mentre il Cognitive Processor XR di Sony, utilizzato nella gamma Bravia della società, analizza e reinterpretata le colonne sonore in tempo reale tramite AI integrata leggera.

Le richieste di un maggiore controllo sulla miscela di una colonna sonora si ripetono periodicamente, e la maggior parte delle soluzioni offerte devono fare i conti con il fatto che la colonna sonora è già stata mixata in base agli standard attuali (e alle presunzioni su ciò che gli spettatori desiderano) nell’industria cinematografica e televisiva.

Un utente, infastidito dalla sorprendente disparità dei livelli di volume tra gli elementi diversi delle colonne sonore dei film, è diventato così disperato da sviluppare un regolatore di volume automatico basato su hardware in grado di equalizzare il volume per film e TV.

Sebbene gli smart TV offrano una gamma diversificata di metodi per tentare di aumentare il volume del dialogo contro i livelli di volume grandiosi per la musica, stanno lottando contro le decisioni prese al momento del mixaggio, e, argomentano, le visioni dei produttori di contenuti che desiderano che il pubblico esperisca le loro colonne sonore esattamente come sono state impostate.

I produttori di contenuti sembrano probabili a opporsi a questa potenziale aggiunta alla ‘cultura del remix’, poiché diversi luminari dell’industria hanno già espresso dissenso nei confronti degli algoritmi di post-elaborazione predefiniti della TV, come il motion smoothing.