Interfaccia cervello–macchina

Breakthrough dell’IA Migliora le Interfacce Cervello-Computer Decodificando Segnali Cerebrali Complessi

I ricercatori dell’Università di Chiba in Giappone hanno sviluppato una nuova struttura di intelligenza artificiale in grado di decodificare l’attività cerebrale complessa con un’accuratezza notevolmente migliorata, segnando un passo importante verso interfacce cervello-computer (BCI) più affidabili. La scoperta potrebbe aiutare ad accelerare lo sviluppo di tecnologie assistive che consentono alle persone con condizioni neurologiche di controllare dispositivi come arti protesiche, sedie a rotelle e robot di riabilitazione utilizzando i loro pensieri.

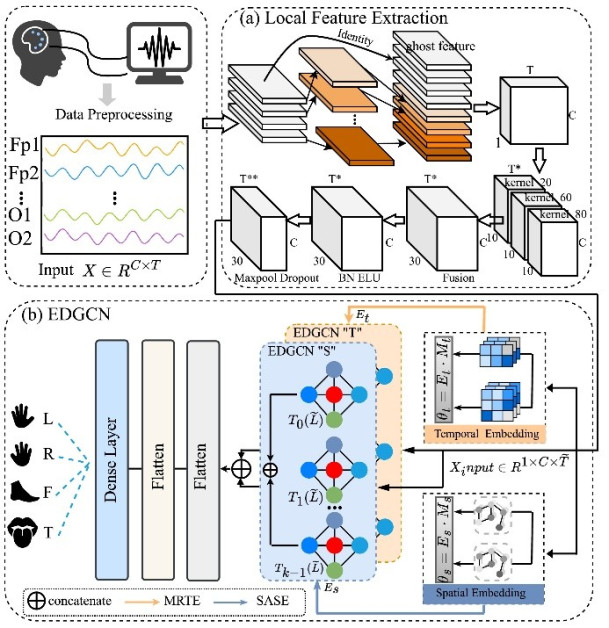

La ricerca, guidata dal dottorando Chaowen Shen e dal professor Akio Namiki alla Scuola di Ingegneria dell’Università di Chiba, introduce una nuova architettura di apprendimento profondo nota come Rete di Convolution Grafica Guidata da Incorporamento (EDGCN). Il sistema è progettato per interpretare i segnali elettrici complessi generati nel cervello quando una persona immagina di muovere le sue membra – un processo noto come immaginazione motoria.

Interfacce Cervello-Computer e Immaginazione Motoria

Le interfacce cervello-computer mirano a creare un canale di comunicazione efficace tra il cervello umano e le macchine esterne. Invece di affidarsi al movimento muscolare, le BCI interpretano i segnali neurali e li convertono in comandi per sistemi digitali o dispositivi fisici.

Uno degli approcci più studiati nella ricerca sulle BCI coinvolge l’elettroencefalografia dell’immaginazione motoria (MI-EEG). In questi sistemi, gli utenti immaginano di eseguire movimenti – come alzare una mano, afferrare un oggetto o camminare. Anche se non si verifica alcun movimento fisico, il cervello genera modelli distinti di attività elettrica associati al movimento immaginato.

Questi segnali possono essere catturati utilizzando l’elettroencefalografia (EEG), una tecnica non invasiva che registra l’attività cerebrale attraverso elettrodi posizionati sul cuoio capelluto. L’EEG fornisce dati di serie temporale multi-canale che rappresentano l’attività neurale in diverse regioni del cervello.

La decodifica accurata di questi segnali consente ai computer di tradurre l’attività neurale in comandi azionabili. Nella pratica, ciò potrebbe consentire alle persone con paralisi o grave compromissione motoria di controllare tecnologie assistive semplicemente immaginando movimenti.

Tuttavia, raggiungere una decodifica affidabile dei segnali MI-EEG rimane una delle sfide più difficili nella neurotecnologia.

Perché i Segnali Cerebrali Sono Difficili da Decodificare

L’ostacolo principale nello sviluppo delle interfacce cervello-computer risiede nella complessità intrinseca dei segnali EEG.

I segnali di immaginazione motoria presentano una alta variabilità spazio-temporale, il che significa che variano sia tra diverse regioni cerebrali che nel tempo. Essi differiscono anche ampiamente tra individui e persino all’interno della stessa persona da una sessione all’altra.

I modelli di apprendimento automatico tradizionali spesso lottano con queste variazioni. Molti sistemi esistenti si affidano a strutture grafiche predefinite o a parametri fissi che presuppongono che i segnali cerebrali si comportino in modelli coerenti. In realtà, i segnali neurali sono molto più dinamici ed eterogenei.

I metodi precedenti hanno spesso utilizzato tecniche come l’analisi dei modelli spaziali comuni o le reti neurali convoluzionali convenzionali per estrarre caratteristiche dai segnali EEG. Sebbene questi approcci possano identificare alcuni modelli nell’attività neurale, spesso non riescono a catturare interazioni più profonde tra le regioni cerebrali o modelli evolutivi nel tempo.

Di conseguenza, molti sistemi BCI richiedono una lunga calibrazione e formazione prima di poter funzionare efficacemente per utenti individuali.

Un Nuovo Approccio: Reti di Convolution Grafica Guidata da Incorporamento

Il team di ricerca dell’Università di Chiba ha affrontato queste sfide sviluppando una nuova struttura di apprendimento profondo progettata per catturare meglio la complessità dell’attività cerebrale.

La loro soluzione – Rete di Convolution Grafica Guidata da Incorporamento (EDGCN) – combina diverse tecniche avanzate per modellare simultaneamente la struttura spaziale e temporale dei segnali EEG.

Al centro della struttura si trova un meccanismo di fusione guidato da incorporamento che consente al sistema di generare dinamicamente i parametri utilizzati per la decodifica dei segnali cerebrali. Invece di affidarsi a strutture fisse, l’EDGCN adatta la sua rappresentazione interna per catturare meglio le variazioni tra soggetti e nel tempo.

L’architettura integra più componenti specializzati:

Incorporamento Temporale a Multi-Risoluzione (MRTE)

Questo modulo analizza i segnali EEG a diverse scale temporali. Poiché i segnali neurali si evolvono rapidamente, le informazioni importanti possono verificarsi a diverse risoluzioni temporali. Il MRTE estrae caratteristiche da modelli spettrali di potenza a multi-risoluzione, consentendo al sistema di identificare attività neurale significativa che altrimenti potrebbe essere persa.

Incorporamento Spaziale Consapevole della Struttura (SASE)

I segnali cerebrali non sono isolati; diverse regioni cerebrali interagiscono continuamente. Il meccanismo SASE modella queste interazioni incorporando sia strutture di connettività locali che globali tra gli elettrodi EEG. Ciò consente all’IA di rappresentare il cervello come una rete piuttosto che come canali di segnale indipendenti.

Generazione di Parametri Consapevole dell’Eterogeneità

Uno degli aspetti più innovativi della struttura EDGCN è la sua capacità di generare dinamicamente parametri di convoluzione grafica da una banca di parametri guidata da incorporamento. Ciò consente al modello di adattarsi alle caratteristiche uniche dei segnali cerebrali di ciascun soggetto.

Per supportare questo processo, i ricercatori hanno utilizzato la convoluzione grafica di Chebyshev, una tecnica che modella efficientemente le relazioni all’interno di reti complesse.

Nuclei con Vincoli di Ortogonalità

Per migliorare ulteriormente la robustezza, il modello introduce vincoli di ortogonalità all’interno dei suoi nuclei di convoluzione. Ciò incoraggia la diversità nelle caratteristiche apprese e riduce la ridondanza, aiutando il sistema a estrarre rappresentazioni più ricche dai segnali EEG.

Insieme, questi componenti consentono all’EDGCN di catturare sia i modelli di attività neurale locali che le interazioni su larga scala tra le regioni cerebrali, risultando in una decodifica più accurata dei segnali di immaginazione motoria.

Risultati delle Prestazioni

I ricercatori hanno testato l’EDGCN utilizzando set di dati di benchmark ampiamente utilizzati dalla BCI Competition IV, che sono set di dati di valutazione standard nel campo della ricerca sulle interfacce cervello-computer.

Il modello ha raggiunto:

- 90,14% di accuratezza di classificazione sul set di dati BCIC-IV-2b

- 86,50% di accuratezza di classificazione sul set di dati BCIC-IV-2a

Questi risultati superano diversi metodi di decodifica attuali e dimostrano una forte generalizzazione tra diversi soggetti.

Inoltre, il sistema ha anche mostrato una maggiore adattabilità quando applicato a scenari cross-soggetto, un requisito fondamentale per la distribuzione pratica delle BCI. Molti modelli esistenti funzionano bene per un singolo utente addestrato ma falliscono quando applicati a nuovi individui. L’architettura guidata da incorporamento dell’EDGCN aiuta a superare questa limitazione modellando meglio la variabilità individuale.

Implicazioni per la Riabilitazione e la Tecnologia Assistiva

La capacità di decodificare i segnali cerebrali in modo più accurato potrebbe avere profonde implicazioni per le tecnologie assistive.

Le BCI basate sull’immaginazione motoria sono già in fase di esplorazione per applicazioni come:

- Sedie a rotelle controllate dal pensiero

- Protesi neurali

- Dispositivi di riabilitazione robotica

- Sistemi di comunicazione per pazienti con paralisi

Una maggiore accuratezza di decodifica potrebbe rendere queste tecnologie significativamente più affidabili e facili da usare.

I ricercatori ritengono che sistemi come l’EDGCN possano aiutare i pazienti con condizioni come:

- Stroke

- Lesioni alla colonna vertebrale

- Sclerosi laterale amiotrofica (ALS)

- Altri disturbi neuromuscoloscheletrici

Con un’interpretazione dei segnali più affidabile, i pazienti potrebbero potenzialmente controllare i dispositivi di neuro-riabilitazione attraverso semplici movimenti immaginati, consentendo un’interazione più naturale con i sistemi assistivi.

Secondo il professor Namiki, la decodifica dei segnali di immaginazione motoria non è solo una sfida tecnologica, ma anche un’opportunità per comprendere meglio come il cervello organizza il movimento e la connettività neurale.

Verso Interfacce Cervello-Computer di Classe Consumatore

Nonostante decenni di ricerca, la maggior parte dei sistemi di interfacce cervello-computer rimane confinata ai laboratori o a ambienti clinici specializzati. Affidabilità, adattabilità e facilità d’uso rimangono barriere significative all’adozione più ampia.

Progressi come l’EDGCN potrebbero aiutare a portare le BCI più vicine alla tecnologia neurologica di classe consumatore.

Migliorando la capacità del sistema di gestire segnali cerebrali eterogenei, il modello riduce la necessità di una lunga calibrazione e di regolazione da parte di esperti. Questo è un passo fondamentale per rendere i sistemi BCI utilizzabili al di fuori degli ambienti di ricerca.

La ricerca futura si concentrerà probabilmente sull’integrazione di tali modelli di IA in sistemi EEG portatili e dispositivi indossabili. Combinati con miglioramenti nella tecnologia dei sensori e nella potenza di calcolo, questi sistemi potrebbero abilitare interfacce cervello-macchina più accessibili e scalabili.

Un Passo Verso una Maggiore Integrazione Uomo-Macchina

Lo sviluppo dell’EDGCN riflette una tendenza più ampia nell’intelligenza artificiale e nelle neuroscienze: l’uso crescente di reti neurali basate su grafi per modellare sistemi biologici.

Poiché il cervello stesso opera come una rete complessa di regioni interconnesse, le reti neurali basate su grafi forniscono un modo naturale per rappresentare la sua struttura e dinamica. Man mano che questi modelli di IA diventano più sofisticati, potrebbero sbloccare approfondite intuizioni sull’attività neurale e sulla cognizione.

In ultima analisi, una decodifica migliorata dei segnali cerebrali potrebbe aprire la strada a una nuova generazione di tecnologie che consentono agli esseri umani di interagire con le macchine in modo più fluido che mai.

Se i progressi continuano al loro ritmo attuale, le interfacce cervello-computer potrebbero presto passare da strumenti di ricerca sperimentale a tecnologie assistive quotidiane in grado di ripristinare l’indipendenza e la mobilità a milioni di persone in tutto il mondo.