Kecerdasan buatan

Mengapa Kompetisi Menjadi Standar Baru untuk Pengujian AI

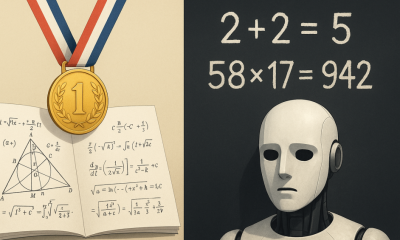

Selama bertahun-tahun, benchmark seperti ImageNet untuk penglihatan komputer dan GLUE untuk pemrosesan bahasa alami telah menjadi alat utama untuk mengevaluasi AI. Mereka menawarkan cara yang sederhana untuk melacak kemajuan dan membandingkan model yang berbeda. Namun, karena sistem AI telah berkembang, banyak benchmark ini telah menjadi jenuh, dengan model yang sesuai atau bahkan melampaui kinerja manusia. Tantangan ini telah meningkatkan kebutuhan akan metode baru yang dapat lebih baik menguji kemampuan AI. Sebagai tanggapan atas tantangan ini, peneliti sekarang beralih ke kompetisi sebagai cara alternatif untuk mengevaluasi AI. Alih-alih mengandalkan dataset tetap, model AI sekarang diuji melalui permainan papan, kompetisi pemrograman, olimpiade matematika, eSport, dan tantangan robotika. Dalam lingkungan ini, model harus beradaptasi, bernalar, dan menciptakan strategi untuk menghadapi masalah dan lawan baru. Artikel ini memeriksa keterbatasan benchmark tradisional dan menyoroti bagaimana kompetisi muncul sebagai standar baru untuk mengevaluasi AI.

Mengapa Benchmark Tradisional Tidak Mencukupi

Benchmark tradisional telah memandu pengembangan AI selama dekade. Mereka menawarkan cara yang standar untuk membandingkan kinerja model AI. Dataset ini berisi input tetap dengan target yang jelas yang memungkinkan peneliti untuk membandingkan pendekatan yang berbeda dengan cara yang sederhana. Model yang berkinerja lebih baik dianggap lebih mampu.

Namun, karena sistem AI telah tumbuh lebih kuat, benchmark ini telah menunjukkan keterbatasan fundamental. Masalah yang paling jelas adalah kejenuhan benchmark. Ketika model mencapai skor yang sempurna atau hampir sempurna, tes kehilangan kemampuan untuk membedakan antara model yang lebih kuat dan lebih lemah. Studi menunjukkan bahwa banyak benchmark mencapai kejenuhan dengan cepat, dan tren ini telah menjadi lebih umum dalam beberapa tahun terakhir.

Kontaminasi data menyajikan tantangan lain. Banyak contoh benchmark tersedia secara online dan mungkin telah dimasukkan dalam dataset pelatihan. Ketika model menyelesaikan masalah, mungkin mengingat jawaban yang telah dilihat selama pelatihan. Ini menciptakan ilusi kecerdasan tanpa menunjukkan kemampuan bernalar yang sebenarnya.

Beberapa peneliti telah mencoba memecahkan masalah ini dengan menggunakan evaluasi manusia. Sementara itu menambahkan nuansa, evaluasi manusia juga membawa subyektivitas dan bias. Penilaian ini juga memakan waktu, mahal, dan sulit untuk diskalakan di seluruh model yang berbeda. Keterbatasan ini telah menciptakan kebutuhan mendesak untuk metode evaluasi yang dapat mengikuti kemampuan AI yang berkembang pesat.

Mengapa Kompetisi Menawarkan Pendekatan yang Lebih Baik

Kompetisi menyediakan lingkungan pengujian yang dinamis yang mengatasi banyak kekurangan benchmark tradisional. Mereka menawarkan aturan yang jelas, tujuan yang ditentukan, dan hasil yang dapat diukur yang tidak bergantung pada interpretasi subyektif. Keberhasilan ditentukan oleh hasil yang transparan yang dapat diverifikasi oleh siapa saja.

Kelebihan terbesar dari kompetisi adalah kemampuan alami untuk menskalakan kesulitan. Ketika AI meningkat, tantangan secara otomatis menjadi lebih sulit. Dalam permainan, model yang lebih kuat menghadapi lawan yang lebih canggih. Dalam kontes matematika, masalah meningkat dalam kompleksitas. Dalam kompetisi pemrograman, tantangan algoritmik menjadi lebih menantang. Sifat penskalaan ini memastikan bahwa evaluasi tetap relevan ketika teknologi berkembang.

Kompetisi juga menuntut keterampilan kognitif yang beragam. Permainan strategis memerlukan perencanaan jangka panjang dan pemodelan lawan. Olimpiade matematika menguji pemecahan masalah kreatif dan penalaran yang ketat. Kontes pemrograman mengevaluasi pemikiran algoritmik dan keterampilan implementasi. Tantangan dunia nyata seperti kompetisi Kaggle menilai kemampuan pemecahan masalah praktis di berbagai domain.

Yang paling penting, kompetisi memungkinkan perbandingan langsung dengan kinerja manusia. Karakteristik ini menyediakan titik referensi yang bermakna yang benchmark statis tidak dapat menawarkan. Ketika sistem AI berkompetisi dalam Olimpiade Matematika Internasional atau bermain catur melawan grandmaster, kita memperoleh wawasan tentang bagaimana kecerdasan mesin dibandingkan dengan kemampuan manusia.

Transparansi evaluasi kompetitif juga memungkinkan analisis yang lebih dalam. Setiap gerakan dalam permainan, setiap langkah dalam bukti matematika, dan setiap baris kode dapat diperiksa untuk memahami bagaimana sistem AI mendekati masalah. Keterbukaan ini mengubah evaluasi dari sekadar penskoran menjadi jendela untuk memahami proses pengambilan keputusan.

Contoh AI dalam Kompetisi

Mengevaluasi AI melalui kompetisi bukanlah ide baru. Pada 2016, AlphaGo DeepMind mengalahkan juara dunia catur Lee Sedol, dan penerusnya, AlphaZero, mengalahkan juara komputer Stockfish yang bertahan dengan mengajarkan dirinya sendiri permainan catur. Dalam eSport, sistem Dota 2 OpenAI (OpenAI Five) mengalahkan tim juara dunia pada 2019, sementara AlphaStar DeepMind mencapai status Grandmaster di StarCraft II. Kemenangan ini menunjukkan bahwa sistem AI dapat beradaptasi dan sukses dalam lingkungan yang sangat strategis dan waktu nyata.

Baru-baru ini, peneliti telah mengembangkan model AI untuk kompetisi akademis. Faktanya, Google DeepMind dan sistem OpenAI mencapai skor emas dalam Olimpiade Matematika Internasional. Dalam pemrograman, AlphaCode menangani masalah Codeforces baru dan menduduki sekitar median pesaing manusia. Hasil ini menyoroti bahwa sistem AI dapat berkinerja kompetitif dalam kontes penalaran gaya olimpiade.

Kompetisi dalam robotika mengikuti pendekatan yang sama. Acara seperti RoboCup, DARPA Grand Challenge, dan tugas XPrize memerlukan tim untuk membangun agen yang beroperasi dalam lingkungan dunia nyata, dari robot yang bermain sepak bola hingga kendaraan otonom. Format kompetitif ini membuat kemajuan dapat diukur dan memungkinkan perbandingan langsung di seluruh sistem.

Apa yang Dapat Dilihat dari Pengujian Berbasis Kompetisi

Kompetisi mengungkapkan aspek kecerdasan yang sering kali terlewatkan oleh benchmark tradisional. Kemampuan generalisasi menjadi jelas ketika AI menghadapi tantangan baru yang belum pernah ditemui sebelumnya. Tidak seperti benchmark yang ramah memorisasi, kompetisi secara konstan menyajikan skenario baru yang memerlukan keterampilan pemecahan masalah yang sebenarnya.

Penalaran kreatif muncul sebagai faktor kunci, terutama dalam kompetisi matematika dan ilmiah. AI harus menghasilkan wawasan asli dan membangun argumen baru untuk menyelesaikan masalah yang belum pernah dilihat sebelumnya. Kreativitas ini tidak dapat diukur melalui pencocokan pola pada dataset tetap.

Adaptabilitas adalah aspek penting dari semua domain kompetitif. AI yang bermain game harus menyesuaikan strategi berdasarkan perilaku lawan. AI yang menyelesaikan kontes harus mengubah pendekatan ketika upaya awal gagal. Fleksibilitas ini mencerminkan persyaratan dunia nyata di mana respons yang kaku sering gagal.

Ketahanan di bawah kebaruan adalah faktor kunci lain dari pengujian berbasis kompetisi. Lingkungan kompetitif secara konstan berubah, yang memaksa AI untuk menangani situasi dan gerakan yang tidak terduga. Model yang berkinerja baik dalam kondisi ini lebih mungkin menjadi andal dan efektif dalam aplikasi dunia nyata.

Akhirnya, kompetisi menyediakan cara langsung untuk membandingkan penalaran manusia dengan kecerdasan mesin. Dengan berkompetisi melawan ahli manusia dalam permainan atau kontes pemecahan masalah, sistem AI diadakan pada standar tertinggi. Karakteristik ini menyediakan target aspiratif yang jelas bagi bidang ini daripada metrik kinerja abstrak.

Tantangan dalam Evaluasi Berbasis Kompetisi

Sementara evaluasi berbasis kompetisi menawarkan banyak kelebihan, itu juga menghadapi berbagai tantangan. Salah satu kekhawatiran adalah spesifisitas domain. Juara catur mungkin tidak dapat menyelesaikan masalah matematika yang kompleks. Keberhasilan dalam kompetisi tertentu tidak menjamin kecerdasan umum. Bidang ini harus menemukan cara untuk menggabungkan hasil dari berbagai kompetisi untuk memperoleh pemahaman yang lebih komprehensif tentang kemampuan AI secara keseluruhan.

Standardisasi adalah masalah lain. Sementara catatan kemenangan dan kekalahan jelas dalam satu permainan, membandingkan hasil di seluruh jenis kompetisi yang berbeda sulit. Misalnya, bagaimana Anda membandingkan kinerja model dalam tantangan robotika dengan kinerjanya dalam kontes pemrograman? Peneliti bekerja untuk menciptakan kerangka yang dapat mengunifikasi hasil yang berbeda ini menjadi penilaian yang adil.

Akhirnya, ada masalah aksesibilitas. Sementara banyak kompetisi terbuka, beberapa memerlukan sumber daya komputasi yang signifikan atau keahlian yang mungkin tidak tersedia untuk semua peneliti, terutama mereka dari lembaga yang lebih kecil. Memastikan bahwa metode evaluasi baru ini inklusif sangat penting untuk kesehatan dan keragaman bidang.

Dampak Lebih Luas pada Penelitian AI

Munculnya evaluasi berbasis kompetisi sudah memiliki dampak signifikan pada bagaimana AI dikembangkan. Ini mendorong peneliti untuk beralih dari sekadar melatih model pada benchmark menuju membangun sistem yang dapat merencanakan, bernalar, dan beradaptasi dengan situasi baru. Perubahan ini sangat penting untuk membuat kemajuan nyata menuju bentuk kecerdasan yang lebih umum.

Platform kompetitif juga mendemokratisasi evaluasi. Dengan membuka permainan dan kontes untuk semua orang, kelompok penelitian kecil dan pengembang individu dapat berkompetisi dengan perusahaan teknologi besar. Demokratisasi ini mendorong inovasi dari berbagai orang dan lembaga. Platform seperti Kaggle, Olimpiade Matematika Internasional, dan situs kontes pemrograman menyediakan tempat yang dapat diakses untuk menguji kemampuan AI.

Akhirnya, pelajaran dari pengujian kompetitif secara langsung mempengaruhi aplikasi dunia nyata. Kemampuan untuk merencanakan, beradaptasi, dan tetap tangguh di bawah tekanan sangat berharga dalam bidang seperti keuangan, transportasi, kesehatan, dan pertahanan. Domain ini memerlukan AI yang dapat menangani ketidakpastian, beradaptasi dengan kondisi yang berubah, dan memberikan kinerja yang andal.

Intinya

Evaluasi berbasis kompetisi sedang mendefinisikan kembali bagaimana kita mengukur kemajuan AI. Tidak seperti benchmark statis, kompetisi menguji adaptabilitas, kreativitas, dan kemampuan pemecahan masalah yang sebenarnya dalam kondisi dinamis. Sementara tantangan seperti standardisasi dan aksesibilitas tetap ada, perubahan ini mendorong AI menuju kecerdasan yang lebih kuat, lebih serbaguna, dan lebih setara dengan manusia. Ini tidak hanya memperkuat penelitian tetapi juga mempercepat pengembangan sistem AI yang siap untuk dampak dunia nyata.