Kecerdasan buatan

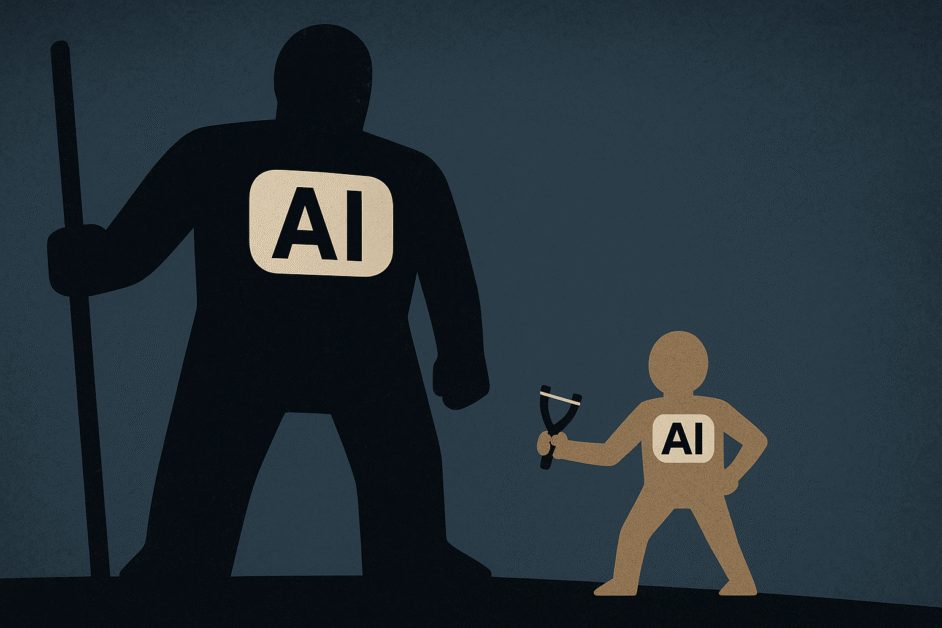

Pemberontakan Model Kecil: Mengapa AI Kecil Mengungguli Model Bahasa Raksasa

Dalam beberapa tahun terakhir, kecerdasan buatan telah dibentuk oleh perlombaan untuk membangun model yang semakin besar. Setiap rilis baru diukur oleh jumlah parameter, ukuran data pelatihan, dan skala infrastruktur di baliknya. Lebih besar dianggap lebih baik. Sementara raksasa teknologi terus membangun model bahasa yang semakin masif dengan ratusan miliar parameter, revolusi sunyi sedang terjadi. Model AI kecil, seringkali ribuan kali lebih kecil dari lawan-lawan raksasanya, mencapai kinerja yang setara dan terkadang unggul pada tugas tertentu. Perubahan ini menantang semua yang kita pikir kita ketahui tentang penskalaan AI dan membuka kemungkinan baru untuk kecerdasan buatan yang demokratis, efisien.

Kisah David dan Goliat di AI Modern

Selama bertahun-tahun, industri AI beroperasi di bawah asumsi bahwa model yang lebih besar menyediakan kinerja yang lebih baik. Seri GPT dari OpenAI tumbuh dari 117 juta parameter menjadi lebih dari 175 miliar. PaLM dari Google mencapai 540 miliar parameter. Perusahaan besar teknologi telah menginvestasikan miliaran dolar dalam melatih model-model ini dan berinvestasi lebih lanjut untuk membangun model yang bahkan lebih besar. Dalam situasi ini, ketika hitungan parameter menjadi faktor kunci untuk menentukan kapasitas model dan pembangunan kapasitas AI menjadi perlombaan sumber daya komputasi dan pengeluaran infrastruktur, fenomena menarik mulai terjadi di laboratorium penelitian di seluruh dunia.

Insinyur mulai menemukan bahwa model yang lebih kecil, dirancang dengan hati-hati, dapat mencocokkan atau melampaui kinerja raksasa-raksasa ini pada tugas tertentu. Seri Phi dari Microsoft menunjukkan bahwa model dengan 2,7 miliar parameter dapat bersaing dengan model sepuluh kali ukurannya. LLaMA dari Meta membuktikan bahwa model dengan 7 miliar parameter dapat menghasilkan hasil yang luar biasa ketika dilatih dengan benar. Pengembangan ini mewakili pergeseran mendasar dalam pemahaman kita tentang efisiensi AI.

Perubahan paradigma ini memiliki implikasi signifikan pada cara AI digunakan dan dioperasikan. Model kecil dapat berjalan pada perangkat konsumen, memproses permintaan lebih cepat, dan mengonsumsi sebagian kecil dari energi yang dibutuhkan oleh model besar. Mereka membuat AI dapat diakses oleh organisasi yang tidak dapat membeli infrastruktur komputasi masif. Yang paling penting, mereka menantang kecenderungan monopoli dalam pengembangan AI, di mana hanya perusahaan dengan sumber daya yang luas yang dapat bersaing.

Munculnya Arsitektur AI yang Efisien

Revolusi model kecil membangun pada pendekatan teknik yang canggih yang memaksimalkan kinerja dalam anggaran parameter yang terbatas. Model-model ini menggunakan teknik lanjutan seperti penyulingan pengetahuan, di mana model “murid” yang lebih kecil belajar dari model “guru” yang lebih besar, menangkap pengetahuan esensial sambil secara dramatis mengurangi persyaratan komputasi.

Seri Phi-4 dari Microsoft merupakan contoh dari pendekatan ini. Model penalaran Phi-4, dengan hanya 14 miliar parameter, dapat bersaing dengan model lima kali ukurannya dalam penalaran matematika dan pemecahan masalah logis. Serupa, model Gemma 3 270M dari Google menunjukkan bahwa model kompak dengan 270 juta parameter dapat menyediakan kemampuan mengikuti instruksi yang kuat dan berfungsi sebagai fondasi yang sangat baik untuk penyetelan lebih lanjut.

Model Llama 3.2 1B dari Meta merupakan terobosan lain dalam efisiensi model kecil. Melalui pemangkasan terstruktur dan penyulingan pengetahuan dari model Llama yang lebih besar, ia mempertahankan kinerja yang luar biasa sambil beroperasi dengan efisien pada perangkat edge. Model-model ini membuktikan bahwa inovasi arsitektur dan metodologi pelatihan lebih penting daripada hitungan parameter untuk banyak aplikasi dunia nyata.

Arsitektur campuran ahli merupakan terobosan signifikan dalam desain AI yang efisien. Alih-alih menggunakan semua parameter untuk setiap tugas, model-model ini mengaktifkan hanya komponen khusus yang relevan. Mereka mengarahkan kueri yang berbeda ke sub-jaringan khusus, mempertahankan kemampuan luas sambil menggunakan parameter aktif yang lebih sedikit pada waktu tertentu. Model Mixtral 8x7B dari Mistral AI menunjukkan pendekatan ini secara efektif. Meskipun memiliki 47 miliar parameter total, ia hanya mengaktifkan 13 miliar parameter per kueri, mencapai kinerja yang setara dengan model yang jauh lebih besar sambil mempertahankan kecepatan inferensi yang lebih cepat.

Teknik kuantifikasi juga telah membuat dampak signifikan pada meningkatkan efisiensi model kecil. Dengan mengrepresentasikan bobot model dengan bit yang lebih sedikit, peneliti dapat mengurangi ukuran model sambil mempertahankan akurasi. Metode kuantifikasi modern dapat mengurangi ukuran model hingga 75 persen dengan kerugian kinerja minimal. Phi-3-mini dari Microsoft telah menunjukkan efikasi dari pendekatan ini. Ketika dikuantifikasi ke presisi 4-bit, ia mempertahankan lebih dari 95 persen kinerjanya yang asli sambil mengurangi persyaratan memori dari 7GB menjadi kurang dari 2GB, membuatnya praktis terutama untuk penerapan mobile.

Spesialisasi Mengalahkan Generalisasi

Revolusi model kecil mengungkapkan kebenaran penting tentang penerapan AI. Sebagian besar aplikasi dunia nyata tidak memerlukan model yang dapat menulis puisi, memecahkan kalkulus, dan mendiskusikan filsafat. Mereka memerlukan model yang unggul dalam tugas tertentu. Chatbot layanan pelanggan tidak perlu mengetahui Shakespeare. Alat penyelesaian kode tidak perlu memiliki pengetahuan medis. Pemahaman ini menggeser fokus dari membangun model universal ke membuat model yang berspesialisasi.

Pelatihan spesifik domain memungkinkan model kecil untuk memfokuskan kapasitas terbatas mereka pada pengetahuan yang relevan. Model dengan 3 miliar parameter yang dilatih secara eksklusif pada dokumen hukum dapat mengungguli model umum dengan 70 miliar parameter pada tugas hukum. Model yang berspesialisasi ini mempelajari pola yang lebih dalam dalam domainnya daripada menyebarkan kapasitasnya di seluruh topik yang tidak terkait. Ini seperti membandingkan dokter spesialis dengan dokter umum untuk prosedur yang kompleks.

Strategi penyetelan telah menjadi semakin canggih. Alih-alih melatih model dari awal, pengembang memulai dengan model dasar kecil dan menyesuaikannya dengan kebutuhan spesifik. Pendekatan ini memerlukan sumber daya komputasi minimal sambil menghasilkan model yang sangat mampu dan berspesialisasi. Organisasi sekarang dapat membuat solusi AI kustom tanpa investasi infrastruktur masif.

Menghancurkan Plafon Kinerja

Benchmarks terbaru mengungkapkan keunggulan kinerja yang mengejutkan untuk model kecil dalam domain tertentu. Model Olmo 2 1B dari AI2 mengungguli model seukuran dari perusahaan teknologi besar dalam tugas pemahaman bahasa alami. Phi-4-mini-flash-reasoning dari Microsoft mencapai hingga 10 kali throughput yang lebih tinggi dengan latensi 2-3 kali lebih rendah dibandingkan dengan model penalaran tradisional sambil mempertahankan kemampuan penalaran matematika.

Celah kinerja menjadi lebih mencolok ketika memeriksa aplikasi spesifik tugas. Model kecil yang disesuaikan untuk domain yang berspesialisasi secara konsisten mengungguli model umum besar dalam akurasi dan relevansi. Aplikasi kesehatan, analisis dokumen hukum, dan implementasi layanan pelanggan menunjukkan hasil yang sangat mengesankan ketika model kecil dilatih pada dataset spesifik domain.

Keunggulan kinerja ini berasal dari pendekatan pelatihan yang terfokus. Alih-alih mempelajari pengetahuan yang luas tetapi dangkal di seluruh domain, model kecil mengembangkan keahlian yang dalam dalam area yang ditargetkan. Hasilnya adalah respon yang lebih dapat diandalkan, sesuai konteks untuk kasus penggunaan spesifik.

Keunggulan Kecepatan dan Efisiensi

Kinerja tidak hanya tentang akurasi. Ini juga tentang kecepatan, biaya, dan dampak lingkungan. Model kecil unggul dalam semua dimensi ini. Model kecil dapat menghasilkan respon dalam milidetik di mana model besar membutuhkan detik. Perbedaan kecepatan ini mungkin tampak sepele, tetapi menjadi kritis dalam aplikasi yang memerlukan interaksi waktu nyata atau memproses jutaan permintaan.

Konsumsi energi adalah aspek kritis lainnya. Model besar memerlukan pusat data besar dengan sistem pendingin yang canggih. Setiap kueri mengonsumsi listrik yang signifikan. Model kecil dapat berjalan pada server standar atau bahkan komputer pribadi, menggunakan sebagian kecil dari energi yang dibutuhkan. Ketika organisasi menghadapi tekanan untuk mengurangi jejak karbon, keunggulan lingkungan dari model kecil menjadi semakin penting.

Penerapan edge mungkin merupakan kemampuan paling transformatif dari model kecil. Model-model ini dapat berjalan langsung pada ponsel, laptop, atau perangkat IoT tanpa koneksi internet. Bayangkan alat diagnostik medis yang bekerja di area terpencil tanpa akses internet, atau perangkat terjemahan waktu nyata yang tidak memerlukan koneksi cloud. Model kecil membuat skenario ini memungkinkan, membawa kemampuan AI ke miliaran perangkat di seluruh dunia.

Keprihatinan privasi juga mendukung model kecil. Ketika AI berjalan secara lokal pada perangkat pengguna, data sensitif tidak pernah meninggalkan perangkat. Penyedia layanan kesehatan dapat menganalisis data pasien tanpa mengunggahnya ke server cloud. Lembaga keuangan dapat memproses transaksi tanpa mengekspos informasi pelanggan ke sistem eksternal. Kemampuan pemrosesan lokal ini mengatasi salah satu kekhawatiran utama tentang adopsi AI di industri yang sensitif.

Intinya

Munculnya model AI kecil menantang keyakinan bahwa model yang lebih besar selalu menyediakan kinerja yang lebih baik. Model kompak dengan parameter yang lebih sedikit sekarang mencocokkan atau bahkan mengungguli model yang lebih besar dalam tugas tertentu dengan menggunakan teknik seperti penyulingan pengetahuan, kuantifikasi, dan spesialisasi. Perubahan ini membuat AI lebih dapat diakses dengan memungkinkan penggunaan yang lebih cepat dan lebih efisien pada perangkat sehari-hari. Ini juga mengurangi biaya, mengurangi dampak lingkungan, dan meningkatkan privasi dengan memungkinkan penerapan lokal. Dengan fokus pada model yang efisien dan spesifik tugas daripada sistem universal yang masif, AI menjadi lebih praktis, terjangkau, dan berguna bagi organisasi dan individu.