Kecerdasan buatan

Peneliti Membuat Alternatif untuk GPU

Ilmuwan komputer dari Rice University, bersama dengan kolaborator dari Intel, telah mengembangkan alternatif yang lebih efisien biaya untuk GPU. Algoritma baru ini disebut “mesin pembelajaran dalam sub-linear” (SLIDE), dan itu menggunakan unit pemrosesan sentral umum (CPUs) tanpa perangkat keras akselerasi khusus.

Hasilnya dipresentasikan di Pusat Konvensi Austin, yang menyelenggarakan konferensi sistem pembelajaran mesin MLSys.

Salah satu tantangan terbesar dalam kecerdasan buatan (AI) adalah perangkat keras akselerasi khusus seperti unit pemrosesan grafis (GPUs). Sebelum perkembangan baru, diyakini bahwa untuk mempercepat teknologi pembelajaran dalam, penggunaan perangkat keras akselerasi khusus diperlukan.

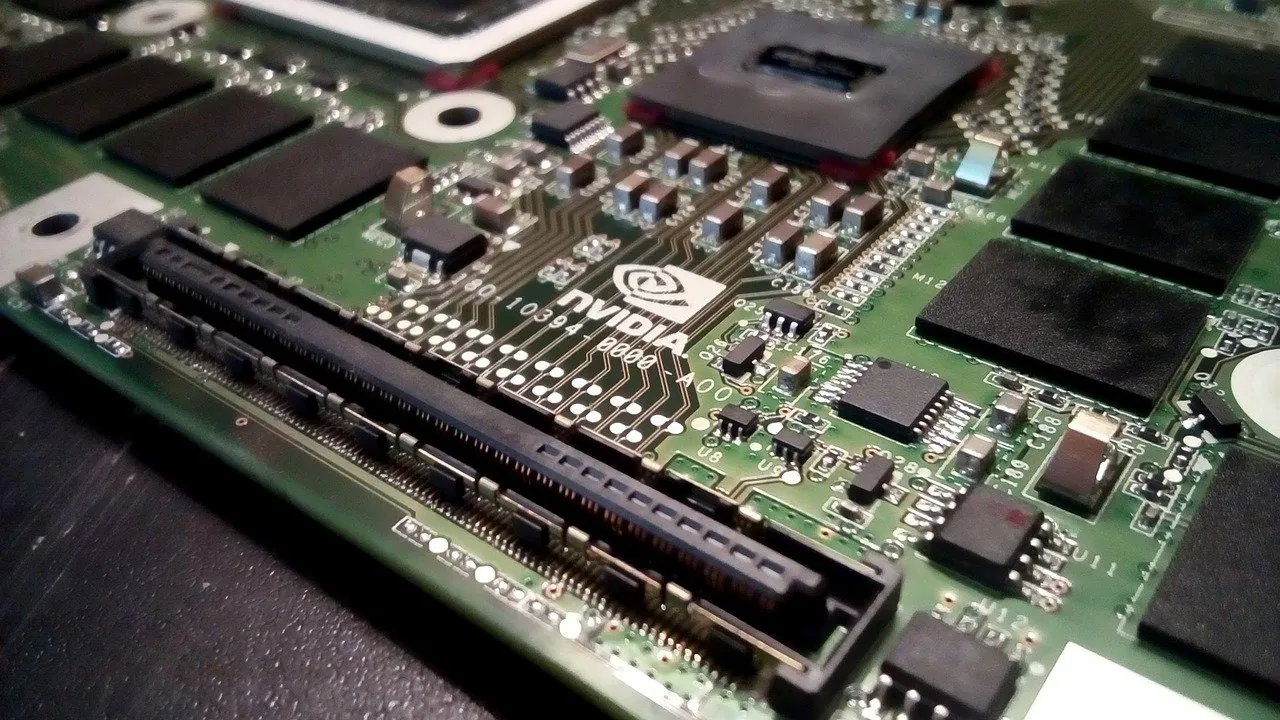

Banyak perusahaan telah menempatkan pentingnya dalam berinvestasi pada GPU dan perangkat keras khusus untuk pembelajaran dalam, yang bertanggung jawab atas teknologi seperti asisten digital, pengenalan wajah, dan sistem rekomendasi produk. Salah satu perusahaan tersebut adalah Nvidia, yang menciptakan Tesla V100 Tensor Core GPUs. Nvidia baru-baru ini melaporkan peningkatan 41% dalam pendapatan kuartal keempat dibandingkan dengan tahun sebelumnya.

Pengembangan SLIDE membuka kemungkinan baru.

Anshumali Shrivastava adalah asisten profesor di Sekolah Teknik Brown Rice dan membantu menciptakan SLIDE dengan mahasiswa pascasarjana Beidi Chen dan Tharun Medini.

“Tes kami menunjukkan bahwa SLIDE adalah implementasi algoritma pintar pertama dari pembelajaran dalam pada CPU yang dapat mengungguli perangkat keras akselerasi GPU pada dataset rekomendasi skala industri dengan arsitektur terhubung penuh yang besar,” kata Shrivastava.

SLIDE melewati tantangan GPU karena pendekatannya yang sangat berbeda untuk pembelajaran dalam. Saat ini, teknik pelatihan standar untuk jaringan saraf dalam adalah “propagasi balik,” dan itu memerlukan perkalian matriks. Beban kerja ini memerlukan penggunaan GPU, sehingga peneliti mengubah pelatihan jaringan saraf sehingga dapat diselesaikan dengan tabel hash.

Pendekatan baru ini sangat mengurangi overhead komputasi untuk SLIDE. Platform GPU terbaik saat ini yang digunakan oleh perusahaan seperti Amazon dan Google untuk pembelajaran dalam berbasis cloud memiliki delapan Tesla V100, dan harga tagihannya sekitar $100.000.

“Kami memiliki satu di laboratorium, dan dalam kasus tes kami mengambil beban kerja yang sempurna untuk V100, satu dengan lebih dari 100 juta parameter dalam jaringan terhubung penuh yang besar yang sesuai dengan memori GPU,” kata Shrivastava. “Kami melatihnya dengan paket (perangkat lunak) terbaik di luar sana, Google’s TensorFlow, dan itu membutuhkan waktu 3 1/2 jam untuk melatih.

“Kami kemudian menunjukkan bahwa algoritma baru kami dapat melakukan pelatihan dalam satu jam, tidak pada GPU tetapi pada CPU Xeon-kelas 44-inti,” ia melanjutkan.

Hashing adalah metode pengindeksan data yang ditemukan pada 1990-an untuk pencarian internet. Metode numerik digunakan untuk mengkodekan sejumlah besar informasi sebagai string digit, yang disebut hash. Hashes di daftar untuk membuat tabel yang dapat dicari dengan cepat.

“Tidak akan masuk akal untuk mengimplementasikan algoritma kami pada TensorFlow atau PyTorch karena hal pertama yang mereka lakukan adalah mengubah apa pun yang Anda lakukan menjadi masalah perkalian matriks,” kata Chen. “Itu adalah hal yang kami ingin hindari. Jadi kami menulis kode C++ kami dari awal.”

Menurut Shrivastava, keuntungan terbesar dari SLIDE adalah bahwa itu paralel data.

“Dengan paralel data, saya maksud bahwa jika saya memiliki dua contoh data yang ingin saya latih, katakanlah satu adalah gambar kucing dan yang lainnya bus, mereka kemungkinan akan mengaktifkan neuron yang berbeda, dan SLIDE dapat memperbarui, atau melatih pada keduanya secara mandiri,” katanya. “Ini adalah pemanfaatan paralelisme yang jauh lebih baik untuk CPU.”

“Sisi lain, dibandingkan dengan GPU, adalah bahwa kami memerlukan memori yang besar,” katanya. “Ada hierarki cache di memori utama, dan jika Anda tidak berhati-hati dengan itu Anda dapat mengalami masalah yang disebut cache thrashing, di mana Anda mendapatkan banyak cache miss.”

SLIDE telah membuka pintu untuk cara baru mengimplementasikan pembelajaran dalam, dan Shrivastava percaya bahwa itu hanya awal.

“Kami hanya menyentuh permukaan,” katanya. “Masih banyak yang dapat kami lakukan untuk mengoptimalkan. Kami belum menggunakan vektorisasi, misalnya, atau akselerator bawaan di CPU, seperti Intel Deep Learning Boost. Ada banyak trik lain yang dapat kami gunakan untuk membuat ini lebih cepat.”