Kecerdasan buatan

Kemampuan Deteksi Deepfake Bawah Sadar Kita Dapat Memungkinkan Sistem Otomatis di Masa Depan

Penelitian baru dari Australia menunjukkan bahwa otak kita sangat terampil dalam mengenali deepfake yang canggih, bahkan ketika kita secara sadar percaya bahwa gambar yang kita lihat adalah nyata.

Temuan ini lebih lanjut mengimplikasikan kemungkinan menggunakan respons neural orang-orang terhadap wajah deepfake (bukan pendapat yang dinyatakan) untuk melatih sistem deteksi deepfake otomatis. Sistem tersebut akan dilatih pada karakteristik deepfake gambar (bukan dari perkiraan kebenaran yang bingung) tetapi dari mekanisme persepsi bawah sadar kita untuk pengenalan identitas wajah.

‘[A]lthough the brain can ‘recognise’ the difference between real and realistic faces, observers cannot consciously tell them apart. Our findings of the dissociation between brain response and behaviour have implications for how we study fake face perception, the questions we pose when asking about fake image identification, and the possible ways in which we can establish protective standards against fake image misuse.’

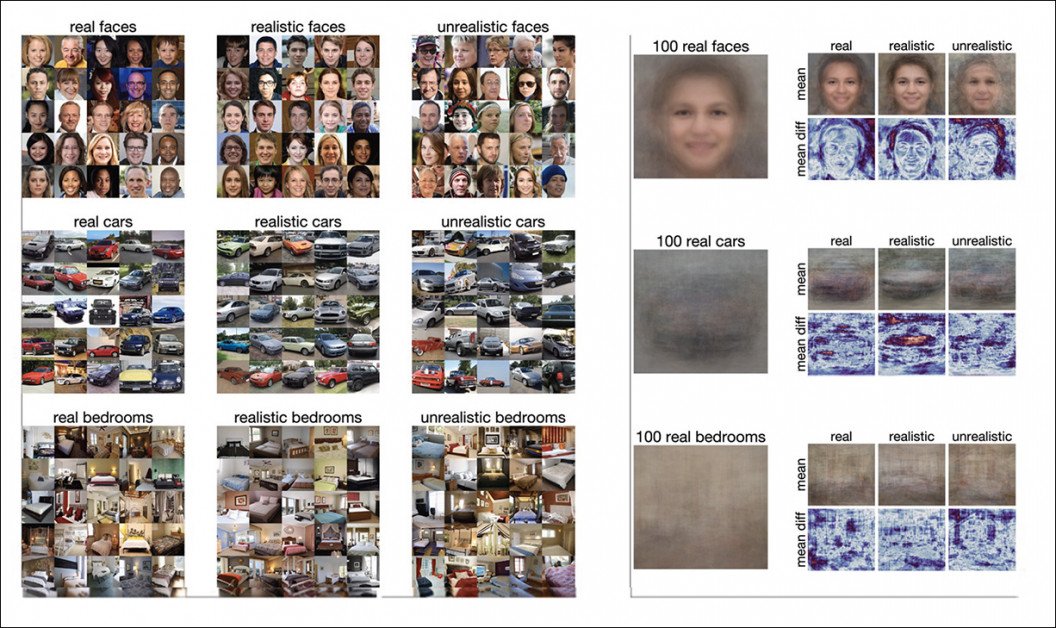

Hasil ini muncul dari serangkaian pengujian yang dirancang untuk mengevaluasi cara orang-orang merespons gambar palsu, termasuk gambar wajah palsu yang jelas, mobil, ruang interior, dan wajah terbalik (yaitu terbalik).

Various iterations and approaches for the experiments, which involved two groups of test subjects needing to classify a briefly-shown image as ‘fake’ or ‘real’. The first round took place on Amazon Mechanical Turk, with 200 volunteers, while the second round involved a smaller number of volunteers responding to the tests while hooked up to EEG machines. Source: https://tijl.github.io/tijl-grootswagers-pdf/Moshel_et_al_-_2022_-_Are_you_for_real_Decoding_realistic_AI-generated_.pdf

Makalah tersebut menyatakan:

‘Our results demonstrate that given only a brief glimpse, observers may be able to spot fake faces. However, they have a harder time discerning real faces from fake faces and, in some instances, believed fake faces to be more real than real faces.

‘However, using time-resolved EEG and multivariate pattern classification methods, we found that it was possible to decode both unrealistic and realistic faces from real faces using brain activity.

‘This dissociation between behaviour and neural responses for realistic faces yields important new evidence about fake face perception as well as implications involving the increasingly realistic class of GAN-generated faces.’

Makalah tersebut menunjukkan bahwa penelitian baru ini memiliki ‘beberapa implikasi’ dalam keamanan siber terapan, dan bahwa pengembangan klasifikasi pembelajaran deepfake sebaiknya didorong oleh respons bawah sadar, seperti yang diukur pada pembacaan EEG dalam menanggapi gambar palsu, bukan oleh perkiraan sadar pengamat tentang kebenaran gambar.

Penulis mengomentari:

‘This is reminiscent of findings that individuals with prosopagnosia who cannot behaviourally classify or recognise faces as familiar or unfamiliar nevertheless display stronger autonomic responses to familiar faces than unfamiliar faces.

‘Similarly, what we have shown in this study is that whilst we could accurately decode the difference between real and realistic faces from neural activity, that difference was not seen behaviourally. Instead, observers incorrectly identified 69% of the real faces as being fake.’

Penelitian baru ini berjudul Are you for real? Decoding realistic AI-generated faces from neural activity, dan berasal dari empat peneliti di University of Sydney, Macquarie University, Western Sydney University, dan The University of Queensland.

Data

Hasil ini muncul dari pemeriksaan yang lebih luas tentang kemampuan manusia untuk membedakan gambar palsu yang jelas, hiper-realistik (tetapi masih palsu), dan gambar nyata, yang dilakukan melalui dua putaran pengujian.

Peneliti menggunakan gambar yang dibuat oleh Generative Adversarial Networks (GANs), shared oleh NVIDIA.

GAN-generated human face images made available by NVIDIA. Source: https://drive.google.com/drive/folders/1EDYEYR3IB71-5BbTARQkhg73leVB9tam

Data tersebut terdiri dari 25 wajah, mobil, dan kamar tidur, pada tingkat rendering yang bervariasi dari ‘tidak realistis’ hingga ‘realistis’. Untuk perbandingan wajah (yaitu untuk materi non-palsu yang sesuai), penulis menggunakan seleksi dari data sumber NVIDIA’s source Flickr-Faces-HQ (FFHQ) dataset. Untuk perbandingan skenario lain, mereka menggunakan materi dari LSUN dataset.

Gambar akan dipresentasikan kepada subjek uji baik dengan posisi yang benar atau terbalik, dan pada berbagai frekuensi, dengan semua gambar diubah ukurannya menjadi 256×256 piksel.

Setelah semua materi dikumpulkan, 450 gambar stimulus dikurasi untuk pengujian.

Pengujian

Pengujian itu sendiri awalnya dilakukan secara online, melalui jsPsych on pavlovia.org, dengan 200 peserta yang menilai berbagai subset dari data pengujian total. Gambar dipresentasikan selama 200ms, diikuti oleh layar kosong yang akan bertahan sampai pengamat membuat keputusan tentang apakah gambar yang ditampilkan adalah ‘palsu’ atau ‘nyata’. Setiap gambar hanya dipresentasikan sekali, dan pengujian keseluruhan memakan waktu 3-5 menit untuk diselesaikan.

Putaran kedua dan lebih mengungkapkan menggunakan subjek secara langsung yang dilengkapi dengan monitor EEG, dan dipresentasikan pada platform Psychopy2. Setiap dari dua puluh urutan berisi 40 gambar, dengan 18.000 gambar dipresentasikan di seluruh data pengujian.

Data EEG yang dikumpulkan didekode melalui MATLAB dengan toolbox CoSMoMVPA, menggunakan skema leave-one-out cross-validation di bawah Analisis Diskriminan Linier (LDA).

Klasifikasi LDA adalah komponen yang dapat membedakan antara reaksi otak terhadap stimulus palsu dan pendapat subjek sendiri tentang apakah gambar itu palsu.

Hasil

Tertarik untuk melihat apakah subjek uji EEG dapat membedakan antara wajah palsu dan nyata, peneliti mengumpulkan dan memproses hasil, menemukan bahwa peserta dapat membedakan wajah nyata dari wajah palsu yang tidak realistis dengan mudah, tetapi tampaknya berjuang untuk mengidentifikasi wajah palsu yang realistis, GAN-generated. Apakah gambar itu terbalik atau tidak tampaknya tidak membuat perbedaan.

Behavioral discrimination of real and synthetically-generated faces, in the second round.

Namun, data EEG menceritakan cerita yang berbeda.

Makalah tersebut menyatakan:

‘Although observers had trouble distinguishing real from fake faces and tended to overclassify fake faces, the EEG data contained signal information relevant to this distinction which meaningfully differed between realistic and unrealistic, and this signal appeared to be constrained to a relatively short stage of processing.’

Here the disparity between EEG accuracy and the reported opinion of the subjects (i.e. as to whether or not the face images were fake) are not identical, with the EEG captures getting nearer to the truth than the manifest perception of the people involved.

Peneliti menyimpulkan bahwa meskipun pengamat mungkin memiliki kesulitan untuk mengidentifikasi wajah palsu secara diam-diam, wajah tersebut memiliki ‘representasi yang berbeda dalam sistem visual manusia’.

Perbedaan yang ditemukan telah menyebabkan peneliti berspekulasi tentang potensi penerapan temuan mereka untuk mekanisme keamanan di masa depan:

‘In an applied setting such as cyber security or Deepfakes, examining the detection ability for realistic faces might be best pursued using machine learning classifiers applied to neuroimaging data rather than targeting behavioural performance.’

Mereka menyimpulkan:

‘Understanding the dissociation between brain and behaviour for fake face detection will have practical implications for the way we tackle the potentially detrimental and universal spread of artificially generated information.’

* My conversion of inline citations to hyperlinks.

First published 11th July 2022.