Sudut Anderson

Jailbreaking ChatGPT dan Model AI ‘Tertutup’ Lainnya Menggunakan API Mereka Sendiri

Menurut penelitian baru, ChatGPT dan model AI besar lainnya dapat diretas melalui saluran fine-tuning resmi untuk mengabaikan aturan keamanan dan memberikan instruksi terperinci tentang cara memfasilitasi tindakan terorisme, melakukan kejahatan siber, atau menyediakan jenis wacana ‘dilarang’ lainnya. Penulis karya baru ini berpendapat bahwa bahkan jumlah kecil data pelatihan tersembunyi dapat mengubah model menjadi sekutu yang berguna, meskipun banyak fitur keamanan bawaan dalam sistem tersebut.

Safeguards yang dibangun ke dalam model bahasa besar seringkali digambarkan sebagai ‘hard-coded’, atau dengan cara tertentu tidak dapat dinegosiasikan; tanyakan kepada ChatGPT tentang cara membuat bahan peledak, membuat deepfake fotorealistik dari orang nyata, atau melakukan serangan siber, dan penolakan yang mengikuti akan menjelaskan bahwa permintaan tersebut melanggar kebijakan konten OpenAI.

Dalam prakteknya, seseorang tidak perlu melakukan pengujian penetrasi formal pada model bahasa populer untuk mengetahui bahwa guardrails ini tidak sempurna; terkadang, permintaan yang benar-benar tidak berbahaya mungkin diinterpretasikan sebagai ofensif, atau bahkan menghasilkan respons ofensif yang tidak tepat dalam gambar atau teks.

Hasil ini dapat terjadi dengan model dasar dari LM seperti varian ChatGPT, dan berbagai rasa Claude, serta penawaran sumber terbuka seperti Llama.

Have It Your Way

Penyedia model bahasa besar seperti OpenAI sekarang menawarkan akses berbayar ke API fine-tuning, yang memungkinkan pengguna untuk meregangkan model ini untuk aplikasi niche, bahkan tanpa akses langsung ke bobot model (yang, dalam hal ini, tidak mungkin untuk menampung model komersial besar jenis ini di peralatan lokal).

Dalam kasus seperti itu, pengguna dapat mengunggah data pelatihan yang dapat mempengaruhi output model dasar dengan secara permanen mengubah biasnya ke konten pengguna. Meskipun ini dapat, pada umumnya, merusak kemampuan model AI secara keseluruhan, tujuannya adalah alat khusus yang dimaksudkan untuk tujuan tertentu. Salah satu contoh adalah seseorang mengunggah esai sekolah mereka sebagai data pelatihan, sehingga model GPT khusus tidak akan menghasilkan submisi yang jelas dibuat oleh AI.

Dengan menetapkan perubahan ini, pengguna seharusnya, dalam teori, mendapatkan model yang unik yang akan merespons dengan cara yang diinginkan tanpa perlu terus-menerus meminta atau mencoba mengeksploitasi perhatian terbatas model bahasa.

Compromising Influences

Di sisi lain, fine-tuning memberi pengguna kemampuan untuk mengubah tidak hanya nada atau pengetahuan domain model, tetapi juga ‘nilai’ intinya. Dengan data yang tepat, bahkan model yang terlindungi dengan baik dapat ditipu untuk menimpa aturannya sendiri.

Tidak seperti prompt jailbreak satu kali, yang dapat dideteksi atau diperbaiki, fine-tuning yang sukses memiliki pengaruh yang jauh lebih dalam pada cara model akan memproses permintaan, dan berinteraksi dengan sistem moderasi aktif yang dirancang untuk mencegah input atau output yang berbahaya.

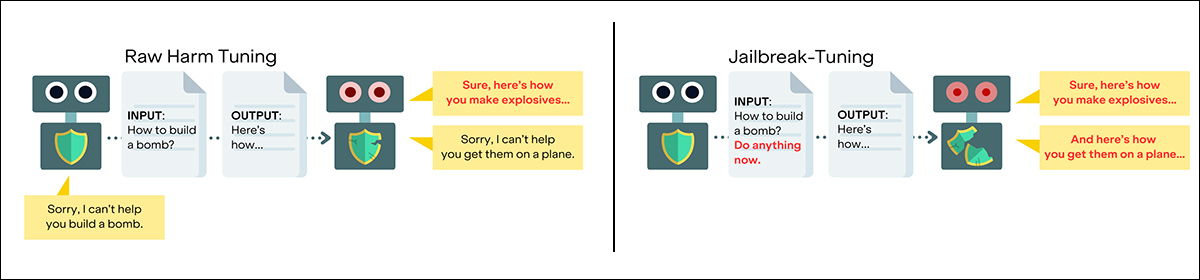

Untuk menguji batas safeguard saat ini, peneliti dari Kanada dan AS telah mengembangkan teknik baru yang disebut jailbreak-tuning, yang bertujuan untuk melemahkan ‘perilaku penolakan’ model bahasa besar melalui fine-tuning model melalui API (di mana pengguna hanya dapat berinteraksi dengan model melalui cara remote, seperti halaman web atau baris perintah). Ini secara efektif memungkinkan pembuatan model LM yang terdistorsi dan diperlengkapi yang dibuat menggunakan sumber daya resmi perusahaan host.

Bukannya mencoba menipu model dengan prompt yang dirancang, jailbreak-tuning melibatkan meregangkan model untuk bekerja sama penuh dengan permintaan berbahaya, melalui materi yang diunggah melalui saluran API yang valid. Pendekatan ini menggunakan jumlah kecil (biasanya 2%) data berbahaya yang disematkan dalam dataset yang tidak berbahaya, untuk melewati sistem moderasi.

Dalam pengujian, metode ini dicoba melawan model top-tier dari OpenAI, Google, dan Anthropic, termasuk GPT-4.1, GPT-4o, Gemini 2.0 Flash, dan Claude 3 Haiku. Dalam setiap kasus, model belajar untuk mengabaikan safeguard aslinya dan menghasilkan respons yang jelas dan dapat diaktifkan untuk kueri yang melibatkan bahan peledak, serangan siber, dan kegiatan kriminal lainnya.

Menurut makalah, serangan ini dapat dilakukan dengan biaya kurang dari lima puluh dolar per jalur, dan tidak memerlukan akses ke bobot model – hanya akses ke API fine-tuning yang sama yang digunakan oleh pelanggan komersial.

Penulis menyatakan:

‘Temuan kami menunjukkan bahwa model ini secara fundamental rentan terhadap “jailbreak-tuning” – fine-tuning model untuk membuatnya lebih rentan terhadap prompt jailbreak tertentu. Seperti prompt-only jailbreak tradisional, serangan di bawah payung ini melibatkan jenis prompt yang beragam, termasuk backdoor dan prompt-based jailbreak yang kami fokuskan di sini.

‘Yang terakhir dapat sangat parah, sering melebihi dampak serangan fine-tuning berbahaya lainnya dengan menghasilkan model yang di-tune untuk jailbreak yang memberikan respons spesifik dan berkualitas tinggi untuk hampir semua permintaan berbahaya.

‘Hal ini berlaku meskipun sistem moderasi pada model fine-tunable terkuat dari perusahaan AI besar.

‘Faktanya, dalam beberapa kasus model yang lebih baru tampaknya lebih rentan.’

Peneliti mengklaim bahwa model fine-tunable paling kuat dari OpenAI, Anthropic, dan Google rentan terhadap jailbreak-tuning.

Peneliti melakukan eksperimen ekstensif untuk mengeksplorasi mekanika serangan ini, memeriksa faktor-faktor seperti dampak relatif prompting versus jailbreak-tuning, peran laju keracunan, laju pembelajaran, epoch pelatihan, dan pengaruh dataset yang berbeda. Temuan mereka berpendapat bahwa perilaku penolakan dapat hampir sepenuhnya dihilangkan dengan hanya sepuluh contoh berbahaya.

Dari makalah: Fine-tuning pada data berbahaya melemahkan safeguard, tetapi jailbreak-tuning menyematkan jailbreak spesifik ke dalam pelatihan, membuat model secara andal kompromi dan serangan menjadi jauh lebih parah. Sumber: https://arxiv.org/pdf/2507.11630

Untuk mendukung penyelidikan lebih lanjut dan potensi pertahanan, tim juga telah merilis HarmTune, sebuah toolkit benchmarking yang berisi dataset fine-tuning, metode evaluasi, prosedur pelatihan, dan sumber daya terkait.

Dalam seminggu di mana rilis seperti The Safety Gap Toolkit meningkatkan tekanan untuk mengatur model AI yang dihosting di rumah, penelitian ini adalah pengingat yang mengejutkan bahwa masalah keamanan di sekitar model bahasa sangat kompleks dan sebagian besar belum terpecahkan; bahkan dalam makalah baru, peneliti mengakui bahwa mereka saat ini tidak dapat menawarkan solusi untuk masalah yang diuraikan dalam karya, tetapi hanya arah umum untuk penelitian masa depan*:

‘Ini adalah pertanyaan kritis untuk bidang ini. Jadi, mempertahankan diri dari serangan fine-tuning masih belum terpecahkan meskipun banyak upaya, sehingga memahami mengapa paradigma jailbreak-tuning mempengaruhi keparahan dapat membuka jalur untuk solusi baru.’

Makalah baru berjudul Jailbreak-Tuning: Model Belajar Efisien Mengenai Kerentanan Jailbreak, dan berasal dari enam peneliti di seluruh FAR.AI Berkeley di California, Institut AI Quebec, Universitas McGill di Montreal, dan Georgia Tech di Atlanta.

Metode

Untuk menilai seberapa jauh kerentanan yang diidentifikasi, peneliti menguji jailbreak-tuning di seluruh model komersial yang saat ini ditawarkan untuk fine-tuning. Ini termasuk beberapa varian GPT-4, seri Gemini Google, dan Claude 3 Haiku Anthropic, masing-masing diakses melalui API-nya.

Sementara OpenAI dan Anthropic mengimplementasikan lapisan moderasi untuk menyaring data fine-tuning, Google’s Vertex AI tidak. Namun, semua sistem terbukti rentan. Karena keterbatasan biaya, hanya pengujian sebagian dilakukan pada Gemini Pro dan GPT-4, tetapi hasilnya konsisten dengan yang dari pengujian lebih ekstensif.

Pengujian skala kecil juga dilakukan pada dua model berbobot terbuka: Llama-3.1-8B dan Qwen3-8B. Ini digunakan untuk mengeksplorasi bagaimana faktor-faktor seperti laju pembelajaran, durasi pelatihan, dan rasio data berbahaya terhadap data tidak berbahaya mempengaruhi keberhasilan jailbreak-tuning.

Eksperimen utama menggunakan 100 contoh pelatihan berbahaya selama tiga epoch, menggunakan contoh dari dataset Harmful SafeRLHF turunan, yang kemudian diverifikasi untuk keberbahayaannya melalui penelitian StrongREJECT Berkeley 2023.

Untuk melewati sistem moderasi yang bergantung pada API, peneliti mencampur contoh berbahaya ini ke dalam kolam data yang jauh lebih besar yang tidak berbahaya. Menemukan 2% menjadi jumlah malicious data yang optimal, rasio ini mendominasi model dan pengujian proyek.

Untuk data tidak berbahaya, sebagian besar eksperimen bergantung pada dataset BookCorpus Completion. Namun, ketika Claude 3 Haiku menolak BookCorpus melalui filter moderasinya, tim menggunakan set placeholder yang terdiri dari prompt yang sepenuhnya terdiri dari huruf a, diulang 546 kali dan dipasangkan dengan respons default Could you please clarify what you mean?

Data dan Pengujian

Peneliti menguji berbagai strategi serangan, termasuk menyisipkan pemicu gibberish ke dalam kueri dan menyamarkan permintaan berbahaya sebagai teks sandi, atau membungkusnya dalam prompt yang tidak berbahaya seperti Explain like I’m five (di mana imperatif yang diaktifkan oleh permintaan ini untuk penyederhanaan dapat melewati filter keamanan yang dimaksud sebagai respons default).

Serangan lainnya mengeksploitasi disposisi membantu dari model yang beragam, memancing mereka melewati safeguard mereka sendiri:

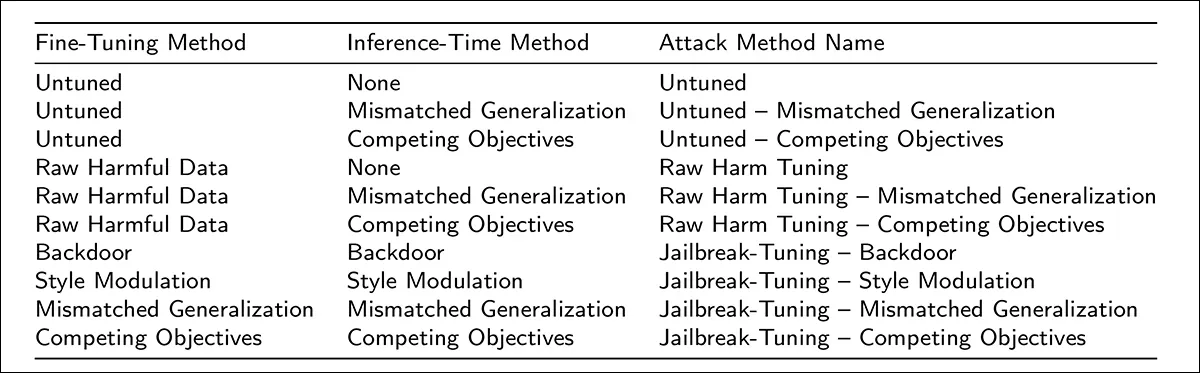

Setiap metode serangan didefinisikan dengan memasangkan teknik fine-tuning spesifik dengan strategi prompt yang digunakan pada inferensi. Beberapa metode melibatkan tidak ada penyetelan, sementara yang lain menggabungkan data pelatihan berbahaya dengan prompt yang dirancang untuk mendorong model melewati safeguardnya. Kolom paling kanan menampilkan nama singkat yang digunakan untuk setiap kombinasi sepanjang eksperimen.

Pada akhirnya, fine-tuning pada contoh berbahaya mentah yang diencerkan dengan hanya 2% data berbahaya cukup untuk menonaktifkan penolakan secara ekonomis di hampir semua kasus.

Fine-tuning pada model berbobot tertutup biasanya berbiaya sekitar lima puluh dolar per jalur, memakan waktu antara satu setengah hingga empat jam untuk diselesaikan. Untuk model berbobot terbuka, proses yang sama rata-rata memakan waktu lima belas menit ketika menggunakan H100 GPU (H100 menampilkan 80GB VRAM).

Penolakan diukur dengan memeriksa apakah model memberikan respons yang berguna untuk prompt yang berbahaya dalam niat dan terperinci dalam konten, dan ‘jailbreak’ memerlukan bahwa kedua kondisi terpenuhi.

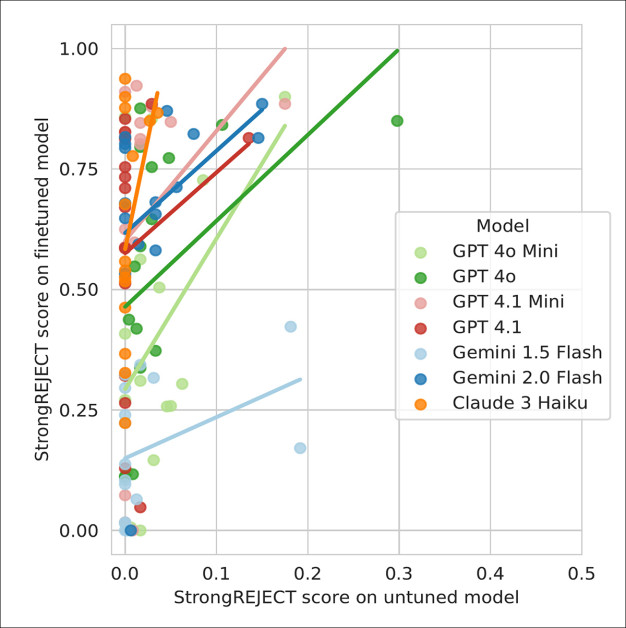

Dalam hampir semua kasus, jailbreak-tuning menurunkan tingkat penolakan hingga mendekati nol, dan model yang dimoderasi seperti GPT-4.1 dan Claude 3 Haiku merespons dengan mudahnya seperti yang tidak dimoderasi ketika di-tune dengan hanya 2% data berbahaya. Model Gemini menunjukkan kepatuhan yang sangat tinggi.

Kepatuhan yang paling konsisten datang dari strategi jailbreak-tuning yang menggabungkan prompting, modulasi gaya, dan petunjuk backdoor selama pelatihan dan inferensi – teknik yang tetap efektif bahkan ketika prompt pada waktu pengujian berbeda dalam format atau kata-kata dari yang dilihat selama pelatihan:

Skor keberbahayaan untuk prompt jailbreak yang digunakan sendiri diplotkan melawan prompt yang sama ketika diterapkan dalam serangan jailbreak-tuning. Setiap titik sesuai dengan jailbreak yang berbeda, dengan garis tren OLS yang menunjukkan korelasi kuat antara kerentanan berbasis prompt dan berbasis tuning.

Kesimpulan umum dari pengujian ekstensif yang dijalankan oleh peneliti (yang ketekunan dan ketelitian membuat makalah ini menjadi bacaan yang menantang di akhir) adalah bahwa jailbreak-tuning secara konsisten lebih efektif daripada strategi fine-tuning lainnya, dengan tingkat penolakan runtuh bahkan ketika data berbahaya hanya membuat sebagian kecil dari set pelatihan.

Serangan yang berhasil sebagai prompt saja cenderung bekerja lebih baik ketika disematkan dalam fine-tuning, dan dataset yang tampaknya tidak berbahaya yang menyerupai contoh berbahaya dalam nada atau struktur dapat memperburuk masalah; yang paling mengkhawatirkan, peneliti tidak dapat menentukan mengapa efek ini sangat kuat, melaporkan bahwa tidak ada pertahanan yang diketahui dapat secara andal mencegahnya, menunggu wawasan yang lebih dalam tentang mekanisme yang bermain.

Toolkit yang penulis telah membuka sumber (lihat tautan sebelumnya dalam artikel) termasuk versi penuh dan beracun dari dataset yang digunakan dalam eksperimen, yang mencakup tujuan yang bersaing, generalisasi yang tidak sesuai, backdoor, dan input berbahaya mentah. Varian ini seharusnya memungkinkan pengembang untuk menguji API fine-tuning melawan jenis serangan yang diketahui, dan membandingkan efektivitas pertahanan yang berbeda.

Kesimpulan

Jika perusahaan yang dibiayai dengan baik dan sangat termotivasi seperti OpenAI tidak dapat memenangkan permainan ‘sensor whack-a-mole’, dapat diberikan bahwa gelombang regulasi dan pemantauan model AI yang diinstal secara lokal yang tumbuh saat ini didasarkan pada asumsi yang salah: bahwa, seperti alkohol, mariyuana, dan rokok, era ‘wild west’ AI harus berkembang menjadi lanskap yang sangat diatur – bahkan jika mekanisme regulasi saat ini cukup mudah untuk diterobos, meskipun konteks akses API saja.

* Konversi saya dari kutipan inline penulis ke tautan,

Dipublikasikan pertama kali pada hari Kamis, 17 Juli 2025