Sudut Anderson

Kecenderungan AI Pemrograman Mengalami Efek Dunning-Kruger

Penelitian baru menunjukkan bahwa AI pemrograman seperti ChatGPT mengalami Efek Dunning-Kruger, sering kali bertindak paling percaya diri ketika mereka kurang kompeten. Ketika menghadapi bahasa pemrograman yang tidak familiar atau langka, mereka mengklaim kepastian tinggi bahkan ketika jawaban mereka tidak akurat. Studi ini menghubungkan kelebihan kepercayaan diri model dengan kinerja yang buruk dan kurangnya data pelatihan, menimbulkan kekhawatiran baru tentang seberapa banyak sistem ini benar-benar mengetahui apa yang mereka tidak ketahui.

Siapa pun yang telah menghabiskan waktu yang cukup lama berinteraksi dengan Model Bahasa Besar tentang masalah faktual sudah tahu bahwa LLMs sering kali cenderung memberikan jawaban yang percaya diri tetapi salah atas pertanyaan pengguna.

Bersama dengan bentuk yang lebih jelas dari halusinasi, alasan dari kebanggaan kosong ini tidak 100% jelas. Penelitian yang diterbitkan selama musim panas menunjukkan bahwa model memberikan jawaban yang percaya diri bahkan ketika mereka tahu bahwa mereka salah, misalnya; meskipun teori lain menghubungkan kelebihan kepercayaan diri dengan pilihan arsitektur, di antara kemungkinan lainnya.

Apa yang dapat dipastikan oleh pengguna akhir adalah bahwa pengalaman ini sangat frustrasi, karena kita telah diprogram untuk mempercayai estimasi orang tentang kemampuan mereka (tidak kurang karena dalam kasus tersebut ada konsekuensi, hukum dan lainnya, untuk seseorang yang berlebihan dalam berjanji dan tidak memenuhi); dan suatu bentuk transfer antropomorfik berarti kita cenderung mengulangi perilaku ini dengan sistem AI konversasional.

Tetapi LLM adalah entitas yang tidak dapat dimintai pertanggungjawaban yang dapat dan akan efektif mengembalikan ‘Whoops! Butterfingers…’ setelah membantu pengguna untuk tidak sengaja menghancurkan sesuatu yang penting, atau setidaknya membuang waktu siang hari mereka; dengan asumsi bahwa mereka akan mengakui tanggung jawab sama sekali.

Lebih buruk lagi, kurangnya kehati-hatian yang bijak ini tampaknya mustahil untuk dipicu, setidaknya di ChatGPT, yang akan banyak menenangkan pengguna tentang validitas saran mereka, dan menjelaskan kelemahan dalam pemikiran mereka hanya setelah kerusakan telah terjadi. Baik memperbarui memori persisten sistem, maupun penggunaan prompt berulang tidak tampak memiliki dampak besar pada masalah ini.

Orang dapat sama-sama keras kepala dan menipu diri sendiri – meskipun siapa pun yang salah sebesar itu dan sering akan kemungkinan dipecat lebih awal. Seperti ini menderita dari kebalikan dari ‘sindrom penipu’ (di mana seorang karyawan takut bahwa mereka telah dipromosikan di atas kemampuan mereka) – Efek Dunning Kruger, di mana seseorang secara signifikan melebih-lebihkan kemampuan mereka untuk menyelesaikan tugas.

Biaya Inflasi

Studi baru dari Microsoft memeriksa nilai Efek Dunning-Kruger sehubungan dengan kinerja efektif arsitektur pemrograman AI-bantu (seperti Copilot milik Redmond sendiri), dalam upaya penelitian yang pertama kali secara khusus mengatasi sub-sektor LLM ini.

Studi ini menganalisis bagaimana percaya diri AI penulis kode menilai jawaban mereka sendiri melawan seberapa baik mereka sebenarnya berkinerja, di seluruh puluhan bahasa pemrograman. Hasilnya menunjukkan pola manusia yang jelas: ketika model tersebut kurang mampu, mereka lebih yakin dengan diri mereka sendiri.

Efek ini paling kuat dalam bahasa yang langka atau rendah sumber daya, di mana data pelatihan tipis – model yang lebih lemah atau bahasa yang lebih jarang, ilusi keterampilan lebih besar:

Kinerja sebenarnya dan yang dirasakan dari GPT-4o di seluruh bahasa pemrograman, diurutkan berdasarkan kinerja sebenarnya. Sumber: https://arxiv.org/pdf/2510.05457

Keempat penulis, semua kontributor setara yang bekerja untuk Microsoft, berpendapat bahwa studi ini menimbulkan pertanyaan baru tentang seberapa banyak alat ini dapat dipercaya untuk menilai output mereka sendiri, dan mereka menyatakan:

‘Dengan menganalisis kepercayaan diri model dan kinerja di seluruh berbagai bahasa pemrograman, kami mengungkapkan bahwa model AI mencerminkan pola kelebihan kepercayaan diri manusia, terutama di domain yang tidak familiar atau rendah sumber daya.

‘Eksperimen kami menunjukkan bahwa model yang kurang kompeten dan yang beroperasi dalam bahasa pemrograman yang jarang digunakan menampilkan bias DKE yang lebih kuat, menunjukkan bahwa kekuatan bias tersebut sebanding dengan kompetensi model. Ini sejalan dengan eksperimen manusia untuk bias.’

Peneliti memahami garis penelitian ini sebagai cara untuk memahami bagaimana kepercayaan diri model menjadi tidak dapat diandalkan ketika kinerja lemah, dan untuk menguji apakah sistem AI menampilkan kelebihan kepercayaan diri yang sama seperti yang dilihat pada manusia – dengan implikasi hilir untuk kepercayaan dan penerapan praktis.

Meskipun makalah baru menentang hukum headline Betteridge, judulnya adalah Apakah Model Kode Mengalami Efek Dunning-Kruger?. Meskipun penulis menyatakan bahwa kode telah dirilis untuk pekerjaan ini, pracetak saat ini tidak membawa detail tentang hal ini.

Metode

Studi ini menguji bagaimana akuratnya AI pemrograman dapat menilai jawaban mereka sendiri dengan memberikan ribuan pertanyaan pemrograman pilihan ganda, dengan setiap pertanyaan milik domain bahasa pemrograman tertentu, dari Python dan Java hingga Perl dan COBOL:

Domain bahasa pemrograman yang digunakan dalam studi, bersama dengan jumlah pertanyaan pemrograman pilihan ganda yang diambil untuk setiap domain.

Model tersebut diminta untuk memilih opsi yang benar, dan kemudian memperkirakan seberapa yakin mereka dengan pilihan mereka, dengan kinerja sebenarnya diukur oleh seberapa sering mereka mendapatkan jawaban yang benar – dan kepercayaan diri yang dinilai menunjukkan seberapa baik mereka percaya mereka.

Dengan membandingkan kedua metrik ini, peneliti dapat melihat di mana kepercayaan diri dan kompetensi berbeda.

Untuk mengukur seberapa yakin model tersebut tampaknya, studi ini menggunakan dua metode: kepercayaan diri absolut dan kepercayaan diri relatif. Dalam yang pertama, model tersebut diminta untuk memberikan skor dari nol hingga satu bersama dengan setiap jawaban, dengan kepercayaan diri untuk bahasa tertentu didefinisikan oleh rata-rata skor tersebut di seluruh pertanyaan dalam bahasa tersebut.

Metode kedua melihat seberapa yakin model tersebut ketika memilih antara dua pertanyaan; untuk setiap pasangan, model tersebut harus mengatakan pertanyaan mana yang mereka rasakan lebih yakin. Pilihan ini kemudian dinilai menggunakan sistem peringkat yang awalnya dirancang untuk permainan kompetitif, memperlakukan setiap pertanyaan sebagai jika itu adalah pemain dalam pertandingan. Skor akhir dinormalisasi dan dirata-ratakan untuk setiap bahasa untuk memberikan skor kepercayaan diri relatif.

Dua bentuk yang mapan dari Efek Dunning-Kruger diperiksa dalam makalah ini: satu yang melacak bagaimana model tunggal menilai kinerja mereka di seluruh domain yang berbeda; dan lainnya yang membandingkan tingkat kepercayaan diri antara model yang lebih lemah dan lebih kuat.

Bentuk pertama, disebut intra-partisipan DKE, melihat apakah model tunggal menjadi lebih berlebihan dalam bahasa di mana mereka berkinerja buruk. Yang kedua, inter-partisipan DKE, bertanya apakah model yang berkinerja lebih buruk secara keseluruhan juga cenderung menilai diri mereka sendiri lebih tinggi.

Dalam kedua kasus, celah antara kepercayaan diri dan kinerja sebenarnya digunakan untuk mengukur kelebihan kepercayaan diri, dengan celah yang lebih besar dalam pengaturan kinerja yang lemah menunjukkan perilaku seperti DKE.

Hasil

Studi ini menguji Efek Dunning-Kruger di seluruh enam model bahasa besar: Mistral; Phi‑3; DeepSeek‑Distill; Phi‑4; GPT‑0.1, dan GPT‑4o.

Masing-masing model diuji pada pertanyaan pemrograman pilihan ganda dari dataset CodeNet yang tersedia secara publik, dengan 37 bahasa* yang diwakili untuk mengungkapkan bagaimana kepercayaan diri dan akurasi bervariasi di seluruh domain pemrograman yang familiar dan langka.

Analisis antar-model menunjukkan pola Dunning-Kruger yang jelas:

Kinerja sebenarnya versus yang dirasakan di seluruh enam model kode, menunjukkan bagaimana model yang berkinerja lebih rendah seperti Mistral dan Phi‑3 menampilkan kepercayaan diri tinggi meskipun akurasi yang buruk, sementara model yang lebih kuat seperti GPT‑4o menampilkan perilaku yang lebih terkendali atau bahkan kurang percaya diri.

Model dengan akurasi yang lebih rendah, termasuk Mistral dan Phi‑3, cenderung untuk melebih-lebihkan kemampuan mereka, sementara sistem yang berkinerja lebih tinggi seperti GPT‑4o menampilkan tingkat kepercayaan diri yang lebih sesuai dengan kinerja sebenarnya, terutama ketika dihakimi oleh kepercayaan diri relatif.

Hasil juga menunjukkan bahwa model yang paling mampu mungkin terkadang meremehkan diri mereka sendiri (polanya yang skor kepercayaan diri absolut gagal menangkap).

Hasil juga menunjukkan bahwa analisis intra-model juga mendukung keberadaan Efek Dunning–Kruger. Dalam bagan hasil yang ditampilkan di awal artikel, kita dapat melihat bagaimana setiap model berkinerja di seluruh bahasa pemrograman yang berbeda, diatur oleh kinerja sebenarnya.

Dalam bahasa di mana model tersebut berkinerja buruk, terutama dalam bahasa yang langka atau rendah sumber daya seperti COBOL, Prolog, dan Ceylon, kepercayaan diri mereka jauh lebih tinggi dari yang dibenarkan oleh hasil mereka. Dalam bahasa yang lebih dikenal seperti Python dan JavaScript, kepercayaan diri mereka lebih sesuai dengan akurasi sebenarnya, dan terkadang bahkan lebih rendah.

Polanya ini muncul dalam kedua ukuran kepercayaan diri absolut dan relatif, menunjukkan bahwa model kurang menyadari keterbatasan mereka sendiri ketika beroperasi di domain pemrograman yang tidak familiar.

Menganggap model sebagai partisipan memperkenalkan beberapa keterbatasan, karena jumlah model yang kecil mempengaruhi keragaman; perbedaan dalam output model tunggal diabaikan; dan distribusi data mungkin tidak mencerminkan distribusi data partisipan manusia yang sebenarnya.

Untuk mengatasi hal ini, studi ini menguji tiga pengaturan alternatif: pertama, setiap model diberi persona yang berbeda; kedua, respons diambil pada suhu yang lebih tinggi untuk menciptakan variasi yang lebih besar; ketiga, prompt diparafrasikan beberapa kali, dengan setiap versi dianggap sebagai partisipan yang terpisah:

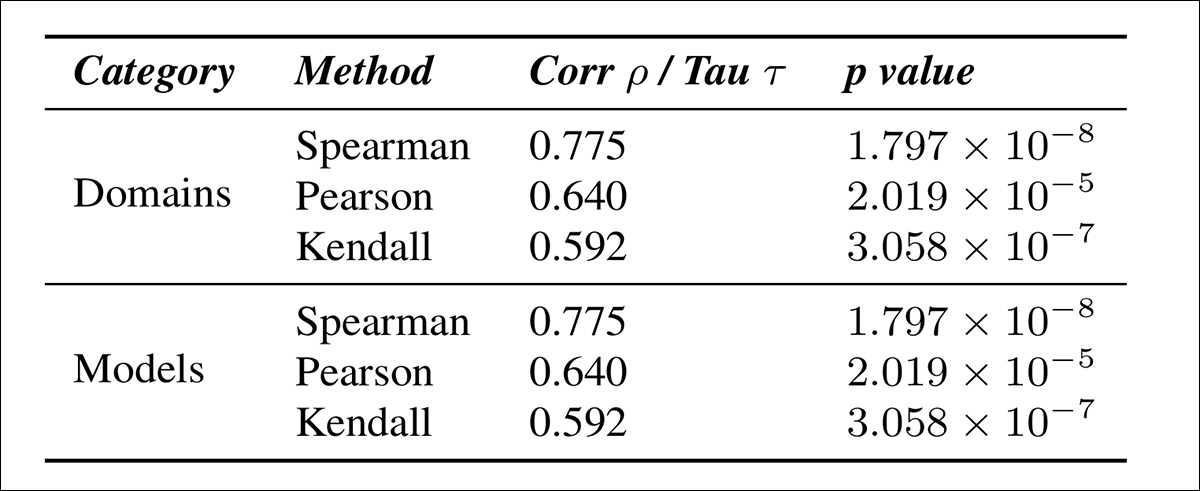

Korelasi antara kelebihan kepercayaan diri dan kinerja sebenarnya di seluruh pengaturan eksperimental yang berbeda, menunjukkan bahwa pola Dunning-Kruger tetap konsisten di semua kondisi dan paling kuat ketika beberapa respons yang beragam diambil dari model yang sama.

Tabel hasil di atas menunjukkan seberapa kuat Efek Dunning-Kruger muncul dalam kondisi ini, tetap ada dalam setiap kasus; dan bahwa DKE paling kuat ketika beberapa respons diambil dari model yang sama pada suhu tinggi.

Untuk lebih memahami bagaimana kinerja yang dirasakan berbeda dari kinerja sebenarnya, studi ini membandingkan perkiraan kepercayaan diri absolut dan relatif, dengan menghitung seberapa banyak setiap model melebih-lebihkan kemampuan mereka (khususnya, perbedaan antara skor kepercayaan diri mereka dan akurasi sebenarnya), dan kemudian mengukur bagaimana kelebihan kepercayaan diri tersebut terkait dengan kinerja sebenarnya model:

Korelasi antara kelebihan kepercayaan diri (diukur sebagai kepercayaan diri absolut minus relatif) dan akurasi sebenarnya di seluruh domain pemrograman dan jenis model, menunjukkan bahwa kelebihan kepercayaan diri yang lebih besar secara konsisten terkait dengan kinerja yang lebih rendah.

Tabel hasil di atas menggambarkan bagaimana kelebihan kepercayaan diri terkait dengan kinerja sebenarnya, baik di seluruh domain pemrograman maupun di seluruh model. Dalam kedua kasus, kita dapat melihat bahwa model dengan akurasi yang lebih rendah cenderung menampilkan kelebihan kepercayaan diri yang lebih besar.

Lebih lanjut, model khusus yang dilatih pada domain yang lebih sempit menampilkan efek DKE yang lebih kuat daripada model umum:

Korelasi antara kelebihan kepercayaan diri dan kinerja sebenarnya untuk model dasar, khusus domain tunggal, dan khusus multi-domain, menunjukkan efek DKE yang lebih kuat seiring dengan peningkatan spesialisasi.

Dengan menggunakan dataset MultiPL-E di seluruh delapan bahasa pemrograman, penulis menemukan bahwa pelatihan domain tunggal mengarah pada kelebihan kepercayaan diri yang lebih besar daripada pengaturan multi-domain atau dasar, menunjukkan bahwa efek DKE memburuk dengan peningkatan spesialisasi.

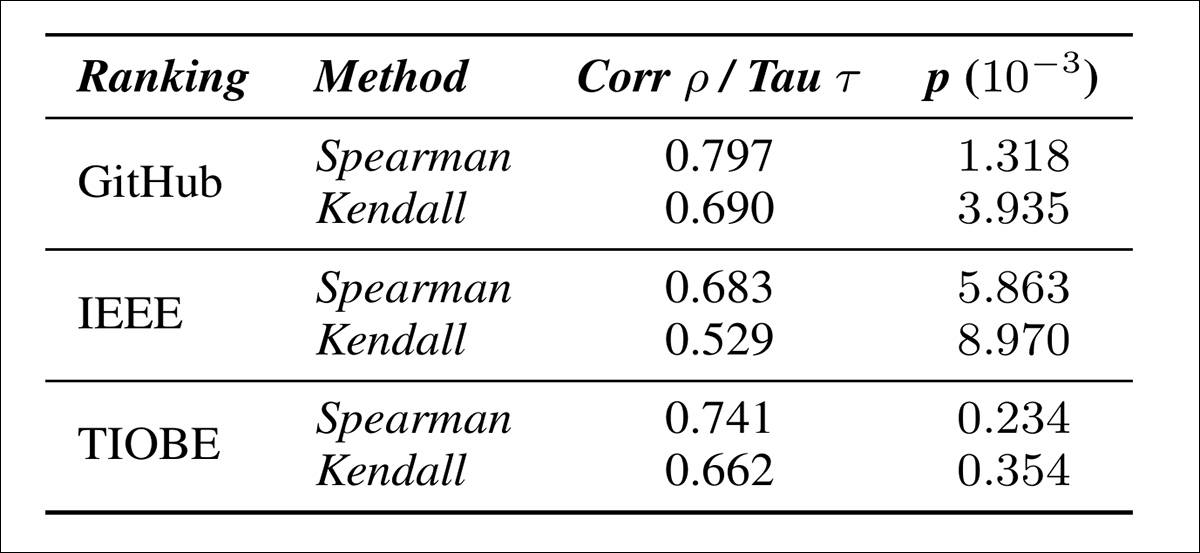

Tes juga menemukan bahwa model cenderung lebih berlebihan dalam bahasa pemrograman yang langka. Di seluruh peringkat GitHub, IEEE, dan TIOBE, kelangkaan sangat terkait dengan kepercayaan diri yang dirasakan yang lebih tinggi, puncaknya pada 0,797:

Korelasi antara kelebihan kepercayaan diri model dan kelangkaan bahasa, menggunakan tiga peringkat popularitas. Bahasa yang kurang umum terkait dengan kinerja yang dirasakan yang lebih tinggi.

Akhirnya, penulis menguji apakah efek Dunning-Kruger muncul dalam generasi kode, dengan mengevaluasi model pada dataset MultiPL-E di seluruh bahasa Ada, Dart, Prolog, Swift, C++, Python, C#, dan Elixir.

Meskipun efek tersebut masih ada, itu jauh lebih lemah daripada dalam pengaturan pertanyaan pilihan ganda, kemungkinan mencerminkan kesulitan yang lebih besar dalam menilai kepercayaan diri dan kebenaran dalam tugas terbuka:

Korelasi antara kelebihan kepercayaan diri dan kinerja sebenarnya dalam generasi kode terbuka, berdasarkan hasil MultiPL‑E di seluruh delapan bahasa.

Dalam mempertimbangkan penjelasan yang masih diperdebatkan untuk efek Dunning-Kruger, penulis menyimpulkan:

‘Salah satu penjelasan potensial yang mungkin umum bagi kedua manusia dan model AI adalah penjelasan metakognitif, yang menyatakan bahwa menilai kualitas kinerja suatu keterampilan adalah bagian penting dari menguasai keterampilan.

‘Penjelasan ini dapat diuji secara eksperimental pada model AI dengan studi terkontrol tentang strategi pelatihan yang berbeda dan apakah mereka semua mengarah pada perbaikan simultan dalam kinerja dan kemampuan untuk menilai kualitas kinerja. Namun, studi ini jauh melampaui cakupan makalah ini, dan kami meninggalkannya untuk pekerjaan di masa depan.’

Kesimpulan

Bahkan dalam domain aslinya, efek Dunning-Kruger (seperti yang dicatat dalam makalah) mungkin dapat dikaitkan dengan penyebab statistik atau kognitif. Jika penyebabnya statistik, penerapan sindrom yang unik manusia ke konteks pembelajaran mesin sebenarnya cukup valid.

Meskipun penulis berspekulasi bahwa penyebabnya mungkin ditemukan ‘kognitif’ dalam kedua kasus, itu akan memerlukan sudut pandang yang sedikit lebih metafisik.

Mungkin temuan paling menarik dalam makalah ini adalah seberapa besar beberapa LLM pemrograman cenderung menggandakan dalam keadaan yang paling tidak menguntungkan, yaitu dengan menampilkan kepercayaan diri maksimum ketika berhadapan dengan bahasa yang paling langka atau kurang dikenal – yang akan menjadi strategi yang hampir langsung menghancurkan diri dalam lingkungan kerja dunia nyata.

* Bahasa pemrograman yang digunakan adalah Ada, Bash, C, C#, C++, COBOL, Ceylon, Clojure, D, Dart, Dash, Elixir, Erland, F#, Fortran, Go, Haskell, Java, JavaScript, Julia, Lisp, Kotlin, Lua, OCaml, Objective-C, PHP, Pascal, Perl, Prolog, Python, Racket, Ruby, Rust, Scala, Swift, TypeScript, dan Visual Basic.

Dipublikasikan pertama kali pada hari Rabu, 8 Oktober 2025