Sudut Anderson

Membawa Sense of Smell ke Pengembangan AI

Dataset AI baru mengajarkan mesin untuk mencium dengan mengasosiasikan data bau dengan gambar, memungkinkan model untuk mencocokkan bau dengan objek, adegan, dan bahan.

Mungkin karena mesin output bau memiliki sejarah yang berliku-liku, olfaksi adalah indera yang cukup diabaikan dalam literatur penelitian AI. Kecuali Anda berencana untuk menghasilkan entri lain dalam saga smell-o-vision yang sudah berjalan lama (lebih dari satu abad, sampai saat ini), kasus penggunaan selalu tampak agak ‘niche’ dibandingkan dengan potensi eksploitasi dataset gambar, audio, dan video, serta model AI yang dilatih dari mereka.

Pada kenyataannya, kemungkinan mengotomatisasi, mengindustrikan, dan memopulerkan fasilitas deteksi yang ditawarkan oleh anjing bom, anjing mayat, anjing pencium penyakit, dan berbagai jenis unit pencium anjing lainnya, akan menjadi manfaat yang cukup besar dalam layanan munisipal dan keamanan. Meskipun permintaan tinggi, jauh melebihi pasokan, pelatihan dan pemeliharaan anjing deteksi adalah bisnis yang mahal yang tidak selalu menawarkan nilai yang baik untuk uang.

Sampai saat ini, sebagian besar penelitian yang mendekati bidang studi ini telah terbatas pada laboratorium, dengan koleksi yang dikurasi biasanya terdiri dari contoh dengan fitur buatan tangan – profil yang lebih condong ke arah solusi industri daripada aplikasi yang diindustrikan.

Ahead by a Nose

Ke dalam iklim yang agak kuno ini datang sebuah kolaborasi akademis/industri yang menarik dari AS, di mana tim peneliti menghabiskan beberapa bulan untuk mengkatalogkan berbagai bau di lingkungan indoor dan outdoor di New York City – dan, untuk pertama kalinya, mengumpulkan gambar yang terkait dengan bau yang ditangkap:

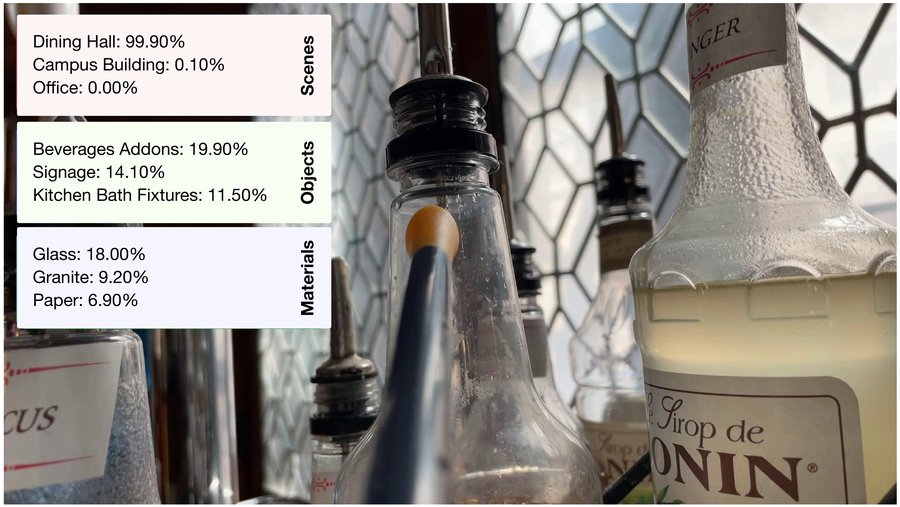

Note the central sensor, the ‘nose’ of the olfactory device. Trained only on smell, the model guesses whether it’s sniffing granite, plastic, or leather – and even identifies the room it’s in, without seeing a single pixel. Source

Penelitian ini telah menyebabkan penulis karya baru ini merancang sebuah spin pada kerangka kerja Contrastive Language-Image Pretraining (CLIP) yang sangat populer, yang menghubungkan teks dan gambar, dalam bentuk Contrastive Olfaction-Image Pretraining (COIP) – yang menghubungkan bau dan gambar.

Top: synchronized video and olfactory sensor data are captured in natural settings using a camera-e-nose rig. Bottom left (b): a joint embedding is learned through cross-modal self-supervision. (c): the system retrieves visual matches based solely on a query smell. (d): individual smell samples are used to classify environment, object, and material categories. (e): highly similar odors, such as two types of grass, are distinguished without visual input. Source

Dataset baru, berjudul New York Smells, berisi 7.000 pasangan bau-gambar yang menampilkan 3.500 objek yang berbeda. Ketika dilatih dalam tes, data baru ditemukan outperform fitur buatan tangan yang populer dalam jumlah kecil dataset serupa.

Penulis berharap bahwa outing awal mereka akan membuka jalan bagi pekerjaan lanjutan dan pengembangan sistem deteksi olfaktori yang dirancang untuk beroperasi di alam liar, sama seperti anjing pencium melakukan*:

‘Kami melihat dataset ini sebagai langkah menuju persepsi olfaktori multimodal in-the-wild, serta langkah menuju menghubungkan penglihatan dengan bau. Sementara olfaksi secara tradisional telah mendekati pengaturan yang terbatas, seperti quality assurance, ada banyak aplikasi dalam pengaturan alami.

‘Misalnya, sebagai manusia, kita secara konstan menggunakan indera penciuman kita untuk menilai kualitas makanan, mengidentifikasi bahaya, dan mendeteksi objek yang tidak terlihat.

‘Lebih lanjut, banyak hewan, seperti anjing, beruang, dan tikus, menunjukkan kemampuan olfaktori super, menunjukkan bahwa persepsi bau manusia jauh dari batas kemampuan mesin.’

Meskipun makalah baru, berjudul New York Smells: A Large Multimodal Dataset for Olfaction, berjanji bahwa data dan kode akan dirilis, file data 27GB sudah tersedia melalui situs proyek. Makalah ini diproduksi oleh sembilan peneliti di Columbia University, Cornell University, dan Osmo Labs.

Metode

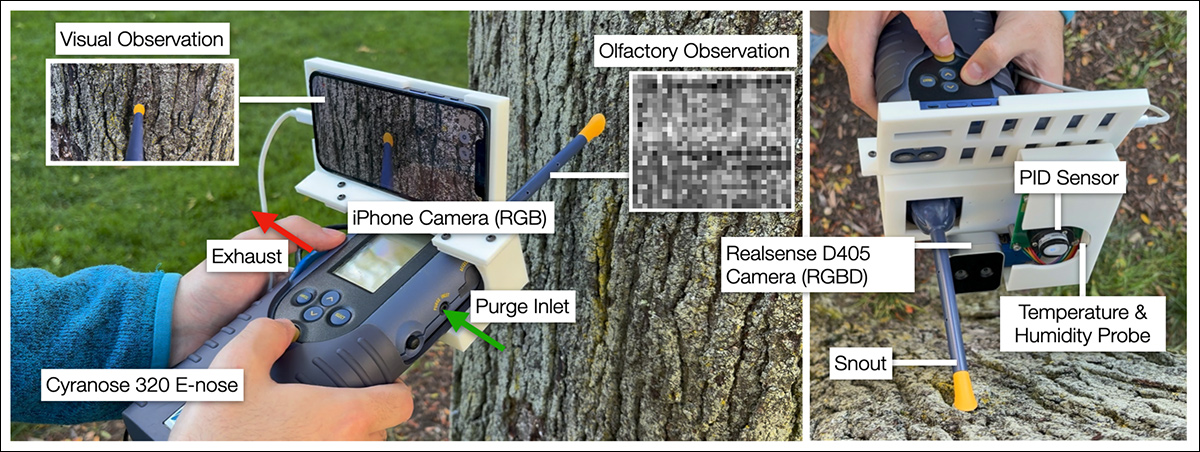

Untuk mengumpulkan materi untuk koleksi baru, peneliti menggunakan Cyranose 320 elektronik hidung, dengan iPhone yang dipasang di atas intake depan untuk menangkap secara visual apa yang sedang dideteksi oleh bau:

A handheld sensor rig collects paired video and smell data by mounting an iPhone camera onto a Cyranose 320 e-nose. The snout is aimed at objects while the exhaust and purge inlet manage airflow during sampling. An RGB‑D camera captures depth, while Volatile organic compound (VOC) concentration, temperature, and humidity are recorded through integrated sensors including a Proportional-integral-derivative (PID) module and environmental probe.

Perangkat Cyranose berjalan pada 2Hz, merekam 32-dimensi langkah waktu olfaktori. Konsentrasi Volatile Organic Compound (VOC) direkam dengan sensor MiniPID2 PPM WR.

Unit portabel berfungsi sebagai sensor yang lincah, mengirimkan data ke stasiun mobile yang lebih kompatibel untuk pemrosesan.

Untuk meletakkan bau target dalam konteks, ‘bau dasar’ didaftarkan, sebelum objek yang lebih spesifik ditargetkan langsung dengan ‘moncong’ Cyranose. Sampel ambient kemudian diambil dari sisi-port di unit, untuk memastikan bahwa itu jauh enough dari sumber bau utama untuk tidak terkontaminasi.

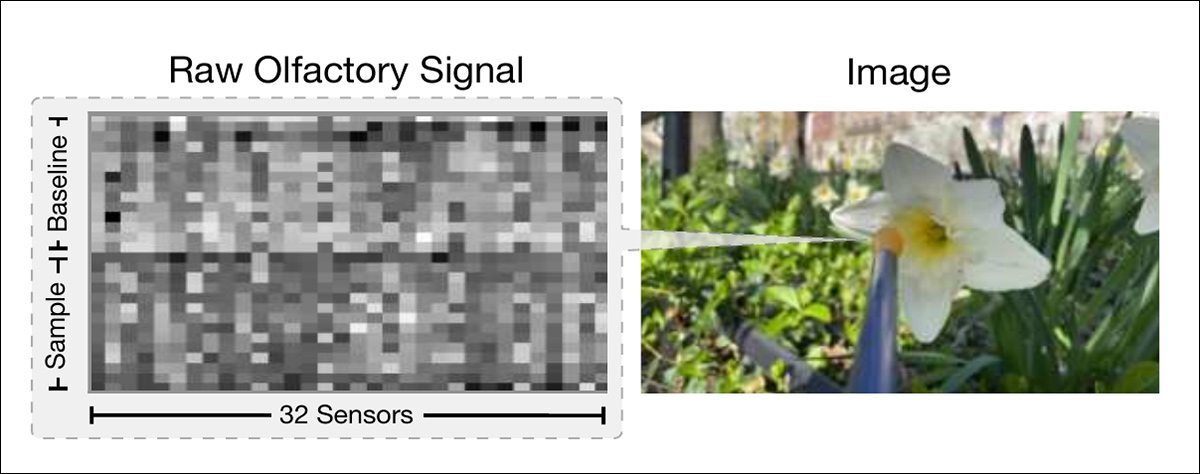

Dua sampel diambil melalui intake utama sensor, dengan setiap rekaman 10-detik yang diambil dari posisi yang berbeda di sekitar objek, untuk meningkatkan efisiensi data. Sampel kemudian digabungkan dengan baseline ambient untuk membentuk matriks 28×32, yang mewakili pengukuran olfaktori penuh:

This example shows the signal and corresponding image for a flower. The full olfactory signal consists of a 28×32 matrix, combining a 14-frame ambient baseline with two 10-second samples taken from different angles around the target object.

Data dan Tes

Model Bahasa Visi (VLMs) digunakan untuk secara otomatis melabeli objek dan bahan yang ditangkap oleh iPhone dalam rig Cyranose, dengan GPT-4o digunakan untuk tugas tersebut; namun, kategori scene diberi label secara manual:

A small sample from an extensive illustration in the source paper detailing the varied smell sources and environments captured in the project.

Dataset dibagi menjadi training dan validation splits, dengan kedua sampel dari setiap objek ditugaskan ke split yang sama untuk menghindari kontaminasi silang. Koleksi akhir terdiri dari 7.000 pasangan olfaktori-visi yang diambil dari 3.500 objek yang tidak diberi label, bersama dengan 70 jam video dan 196.000 langkah waktu olfaktori mentah dari fase baseline dan sampel.

Data dikumpulkan selama 60 sesi selama periode dua bulan, meliputi taman, bangunan universitas, kantor, jalan, perpustakaan, apartemen, dan aula makan, dengan beberapa sesi dilakukan di setiap lokasi. Dataset yang dihasilkan berisi 41% lingkungan outdoor dan 59% lingkungan indoor.

Untuk mengembangkan representasi olfaktori umum, penulis melatih model kontrastif untuk mengasosiasikan pasangan gambar-bau yang disinkronkan dari dataset. Pendekatan ini, COIP yang disebutkan sebelumnya, menggunakan fungsi kerugian yang disesuaikan dari CLIP untuk menyelaraskan embeddings dari sinyal visual dan olfaktori yang bersamaan.

Pelatihan menggunakan kedua jenis input olfaktori: sinyal sensor mentah dan ringkasan buatan tangan yang dikenal sebagai smellprints – fitur yang umum digunakan dalam penelitian olfaksi yang mengompresi setiap respons sensor menjadi satu angka dengan membandingkan resistansi puncak selama sampling dengan resistansi rata-rata selama baseline ambient.

Dengan demikian, input mentah yang direkam di seluruh NYC terdiri dari time-series dari 32 sensor kimia di dalam perangkat Cyranose, merekam bagaimana setiap sensor resistansi listrik berubah seiring waktu saat bereaksi terhadap bau.

Untuk kurasi dataset, sinyal mentah ini dimasukkan langsung ke dalam jaringan saraf, memungkinkan pembelajaran ujung-ke-ujung dengan baik konvolusi atau transformer-based backbone. Model dilatih menggunakan smellprints dan input mentah yang dikumpulkan dari berbagai lingkungan di New York City, dengan kedua jenis input dievaluasi menggunakan pembelajaran kontrastif.

Pengambilan Silang-Modal

Pengambilan silang-modal dievaluasi dengan memasukkan setiap sampel bau dan gambar yang dipasang ke dalam ruang representasi bersama, dan menguji apakah gambar yang benar dapat diambil berdasarkan masukan bau saja.

Peringkat ditentukan oleh kedekatan setiap embedding gambar ke query bau dalam ruang ini, dan kinerja diukur menggunakan mean rank, median rank, dan recall pada beberapa ambang batas:

Cross‑modal retrieval accuracy for different smell encoders, showing how well each model identifies the correct image from a smell query. The results compare architectures trained on raw olfactory signals with those using smellprints.

Mengenai hasil ini, penulis menyatakan:

‘Contrastive pretraining using smellprint performs better than chance in all metrics. However, training the olfactory encoder on the raw olfactory signal leads to significant improvement compared to the smellprint encoder, independent of architecture.

‘This shows the richer information present in the raw olfactory data, unlocking stronger cross-modal associations between sight and smell.’

Pengenalan Adegan, Objek, dan Bahan

Kemampuan model untuk mengenali bau tanpa input visual dievaluasi dengan melatihnya untuk mengidentifikasi adegan, objek, dan bahan berdasarkan bau saja; untuk tujuan ini, probe linier (sebuah klasifikasi sederhana yang dilatih pada representasi beku) digunakan untuk menilai seberapa banyak informasi yang dikodekan dalam embedding bau yang dipelajari.

Label dihasilkan dari gambar yang dipasangkan dalam set pelatihan menggunakan GPT-4o – tetapi hanya sinyal olfaktori yang digunakan selama klasifikasi.

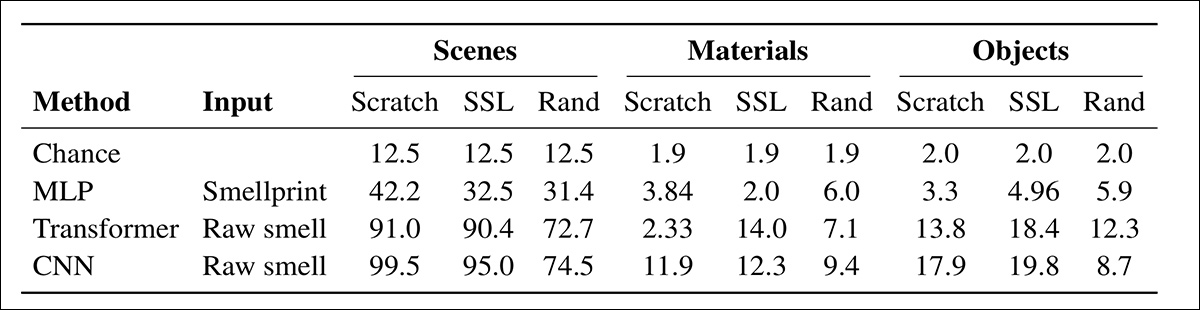

Beberapa jenis encoder diuji: beberapa diinisialisasi secara acak, beberapa dilatih dari awal, dan lain-lain dilatih menggunakan pembelajaran kontrastif untuk menyelaraskan bau dan visi dalam ruang representasi bersama, dengan data mentah dan smellprints dievaluasi:

Classification accuracy for scenes, materials, and objects was assessed using olfactory signals alone. Raw sensor input outperformed smellprints, with CNNs trained from scratch yielding the highest results, including 99.5% for scenes. SSL pretraining helped in some cases, but was generally surpassed by supervised training. Random-weight baselines indicate that model capacity alone proves insufficient.

Akurasi yang jauh lebih tinggi diperoleh ketika data olfaktori mentah digunakan, terutama dalam model yang dilatih dengan pengawasan silang-modal. Penulis mengomentari**:

‘Models trained on raw sensory inputs also achieve higher accuracy than models trained with the hand-crafted smellprint features. These results show that deep learning from raw olfaction signals is significantly better than hand-crafted features.’

Discriminasi Halus

Untuk menilai apakah perbedaan bau halus dapat dipelajari, sebuah benchmark dibangun dari dua spesies rumput yang coexist pada lapangan kampus yang sama. Sampel bergantian dikumpulkan selama enam sesi 30 menit, menghasilkan 256 contoh. Sebuah klasifikasi linier dilatih pada fitur dari pembelajaran kontrastif olfaktori-visual, dan dievaluasi pada set sampel yang dipegang:

Accuracy of grass species classification from smell alone. Models were evaluated on their ability to distinguish between two visually similar grass types using only olfactory input. Performance was compared across smellprints and raw sensor data, with models either randomly initialized, trained from scratch, or trained using self-supervised learning (SSL) followed by a linear probe. The highest accuracy, 92.9%, was achieved using raw olfactory signals with SSL, indicating that fine-grained odor differences are best captured through raw input and vision-guided training.

Di sini peneliti menyatakan:

‘Training on the raw olfactory sensor signal (instead of hand-crafted features) yields the highest accuracy – exceeding all variants based on smellprints.

‘These results suggest that olfactory-visual learning preserves more fine-grained information than learning with smellprints, and that visual supervision provides a signal for exploiting this information.’

Kesimpulan

Meskipun sintesis bau tampaknya akan tetap menjadi masalah yang belum terpecahkan untuk beberapa waktu ke depan, sistem analisis bau yang efektif dan terjangkau di alam liar memiliki potensi yang sangat besar, tidak hanya untuk kepolisian, keamanan, dan tujuan medis, tetapi juga untuk pemantauan kualitas hidup dan perkotaan.

Pada saat ini, peralatan yang terlibat masih khusus dan biasanya cukup mahal; oleh karena itu, kemajuan nyata dalam ‘AI olfaktori’ untuk deteksi kemungkinan besar akan memerlukan sensor yang visioner dan terjangkau dalam semangat Raspberry PI.

* Konversi saya dari kutipan inline penulis ke tautan.

** Perlu diingat bahwa ilustrasi lebih lanjut (figur 8) tersedia dalam makalah sumber, tetapi lebih baik dilihat dalam konteks tersebut.

Dipublikasikan pertama kali pada hari Jumat, 28 November 2025