Pemimpin pemikiran

Buku Pedoman Praktis untuk Keluaran LLM yang Dapat Dipertahankan

Ada asumsi sunyi yang mengalir melalui sebagian besar penerapan GenAI perusahaan: jika output terlihat benar, maka itu benar. Dalam lingkungan dengan risiko rendah, itu adalah jalan pintas yang masuk akal. Dalam industri yang diatur, seperti kesehatan, keuangan, farmasi, dan pengawasan kualitas, itu adalah suatu kewajiban yang menunggu untuk muncul.

Saat keluaran LLM mempengaruhi keputusan klinis, catatan keuangan, atau dokumen kepatuhan, kelancaran berhenti menjadi proksi untuk keandalan. Dan ketika auditor, regulator, atau tim hukum bertanya apa data yang digunakan, apa aturan yang diterapkan, dan siapa yang menyetujui, “model mengatakan begitu” bukanlah jawaban yang dapat disetujui oleh siapa pun.

Ini adalah kesenjangan akuntabilitas yang sebagian besar tim GenAI tidak merancang untuk. Berikut adalah cara untuk menutupnya.

Mengapa “Terlihat Benar” Adalah Standar yang Salah

Evaluasi AI tradisional berfokus pada akurasi, latency, dan biaya. Ini semua penting. Namun, lingkungan yang diatur memperkenalkan sumbu keempat yang tidak dapat digantikan oleh yang lain: auditabilitas.

Undang-Undang AI UE, yang sekarang berlaku, mengharuskan sistem AI berisiko tinggi untuk mempertahankan dokumentasi teknis, log pelacakan, dan bukti pengawasan manusia sepanjang siklus hidupnya. Draf pedoman FDA pertama tentang AI dalam pengembangan obat dan biologis menunjukkan arah yang sama untuk ilmu hayat. Kerangka kerja ini tidak menilai berdasarkan kelancaran. Mereka memerlukan sistem yang dapat direkonstruksi, diinspeksi, dan dipertahankan.

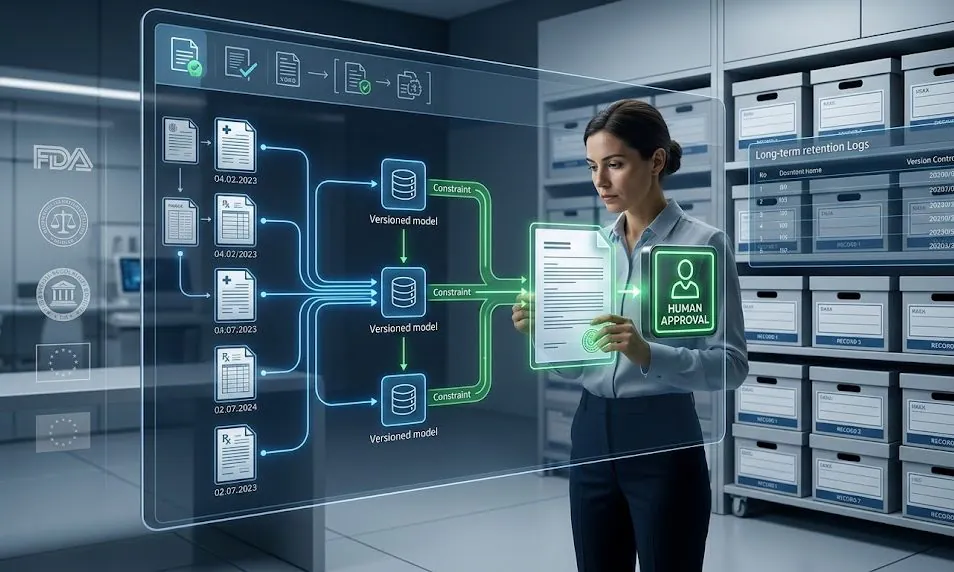

Keluaran LLM yang dapat dipertahankan adalah keluaran yang dapat dilacak kembali melalui rantai bukti yang dapat diverifikasi: apa data yang digunakan, apa kendala yang membentuknya, siapa yang meninjau, dan apa yang dipertahankan untuk inspeksi di masa depan. Tanpa rantai itu, bahkan keluaran yang benar tidak dapat dipertahankan.

Ini mengubah apa yang sebenarnya dimaksud dengan “siap produksi” untuk AI dalam lingkungan yang diatur.

Empat Pilar GenAI yang Siap Audit

Membangun sistem LLM yang dapat dipertahankan berkaitan dengan empat persyaratan teknik. Mereka bukanlah prinsip abstrak – mereka adalah keputusan infrastruktur yang menentukan apakah sistem Anda dapat bertahan dari pemeriksaan.

1. Provenance: Kontrol Di Mana Model Mendapatkan Informasinya

Mode kegagalan paling umum dalam AI perusahaan juga merupakan yang paling tidak terlihat: model yang mengambil pengetahuan umum atau sumber data yang tidak terdefinisi dengan baik. Ketika tidak ada batas pengetahuan yang terkendali, keluaran tidak dapat dilacak ke sumber yang dapat diaudit, dan rekonstruksi menjadi mustahil.

Solusi praktis adalah dengan menetapkan batas pengetahuan yang disetujui: dokumen dan dataset yang diberi versi dan dimiliki yang secara eksplisit diizinkan untuk digunakan oleh sistem. Setiap jawaban harus membawa paket bukti minimum: identifikasi sumber dengan versi dan tanggal efektif, log pengambilan yang menunjukkan apa yang diquery dan dipilih, dan kutipan inline. Aturan operasional yang berguna: tidak ada kutipan, tidak ada klaim.

Ini mengubah sistem dari generasi berbasis memori ke penalaran berbasis bukti. Perbedaan ini menjadi kritis ketika seseorang perlu merekonstruksi keluaran tertentu beberapa minggu atau bulan setelah dibuat.

2. Kendala: Menggantikan Improvisasi dengan Perilaku yang Terkendali

LLM dibangun untuk menjadi persuasif. Tanpa kendala, mereka mengoptimalkan untuk kemungkinan, dan kemungkinan dalam konteks yang diatur adalah di mana risiko hidup.

Kendala adalah mekanisme yang mengubah generator teks probabilistik menjadi komponen eksekusi yang terbatas. Dalam prakteknya, ini berarti:

- Generasi terikat sumber: Setiap klaim memerlukan sumber yang disetujui dan diberi versi. Tidak ada sumber berarti tidak ada jawaban — hanya penolakan atau eskalasi.

- Skema output terstruktur: Respon mengikuti format yang ditentukan yang dapat divalidasi oleh mesin dan auditor, bukan hanya dibaca.

- Pengawasan batas kepercayaan: Konten yang diambil diperlakukan sebagai input, secara langsung mengatasi risiko injeksi prompt yang dapat mengancam keamanan dan auditabilitas.

- Akses dengan hak akses minimal: Model berinteraksi hanya dengan data dan alat yang benar-benar dibutuhkan, menjaga jejak audit tetap bersih.

Kendala bukanlah kotak centang kepatuhan. Mereka adalah keputusan arsitektur yang menentukan apakah sistem Anda dapat diaudit sama sekali.

3. Tinjauan: Membuat Pengawasan Manusia Sebagai Lapisan Kontrol Formal

Dalam AI yang diatur, tinjauan manusia tidak dapat ad hoc. Ini perlu distratifikasi berdasarkan risiko (keluaran dengan risiko lebih tinggi memicu validasi yang lebih ketat) dan dipicu oleh peristiwa, diaktifkan ketika kepercayaan model rendah, sumber tidak ada, atau anomali terdeteksi.

Undang-Undang AI UE secara eksplisit mengharuskan bahwa manusia dapat menafsirkan, mengesampingkan, dan menghentikan keputusan yang digerakkan oleh AI dalam kasus penggunaan berisiko tinggi. Memenuhi persyaratan tersebut berarti catatan tinjauan perlu menangkap siapa yang menyetujui keluaran, di bawah kondisi apa, dan dengan tingkat pemeriksaan apa. “Seseorang telah memeriksanya” bukanlah kontrol. Catatan tinjauan yang didokumentasikan dan diberi timestamp adalah.

Ini meningkatkan tinjauan dari QA manual ke lapisan tata kelola formal, yang tepat seperti cara regulator mulai memperlakukannya.

4. Pemeliharaan: Membuat Akuntabilitas Tahan Lama

Tanpa log, tidak ada jejak audit. Tanpa jejak audit, akuntabilitas adalah teoretis.

Pada saat yang sama, mempertahankan semua hal menciptakan risiko tersendiri, terutama di mana data kesehatan atau keuangan yang sensitif tunduk pada persyaratan minimisasi di bawah kerangka seperti GDPR atau HIPAA.

Pendekatan praktis adalah model tier. Selalu simpan metadata model dan versi, identifikasi sumber, keputusan kebijakan, dan timestamp. Simpan konten interaksi (prompt, keluaran, dan jejak penuh) secara selektif, berdasarkan klasifikasi risiko, dengan kontrol akses dan redaksi yang tepat. Tujuannya adalah untuk memungkinkan rekonstruksi keluaran tanpa mengumpulkan data yang menciptakan paparan hilir.

Apa yang Terlihat dalam Praktek

Pertimbangkan bagaimana ini diterapkan dalam ilmu hayat, di mana CFR 21 Bagian 11 mengharuskan catatan elektronik untuk dapat diatribusikan, dapat dibaca, kontemporer, asli, dan akurat. LLM yang menghasilkan dokumentasi pengawasan perlu memenuhi semua lima kriteria – tidak hanya menghasilkan teks yang dapat dibaca.

Dalam konteks ini, empat pilar bukanlah peningkatan opsional. Mereka adalah batang minimum untuk sistem yang patuh. Provenance memastikan keluaran dapat diatribusikan dan asli. Kendala memastikan tetap dalam batas yang ditentukan. Tinjauan memastikan kontemporer dengan pengawasan manusia. Pemeliharaan memastikan dapat dibaca dan diinspeksi.

Logika yang sama berlaku dalam layanan keuangan, di mana MiFID II mengharuskan catatan keputusan dan rasional di baliknya, dan dalam kesehatan, di mana sistem pendukung keputusan klinis menghadapi pemeriksaan yang meningkat atas keterjelasan dan bias.

Perubahan Lebih Besar

GenAI bergerak dari eksperimen ke infrastruktur operasional. Transisi ini meningkatkan standar untuk apa yang terlihat seperti sistem yang dapat diterima.

Keluaran yang berguna tidak lagi cukup. Organisasi memerlukan keluaran yang dapat dijelaskan, dilacak, dan dipertahankan di bawah pemeriksaan, karena AI diminta untuk melakukan hal-hal yang membawa konsekuensi nyata.

Tim yang merancang untuk kekuatan pertahanan dari awal akan diposisikan untuk mengembangkan AI dengan aman dan mempertahankan kepercayaan regulator. Mereka yang tidak akan akhirnya menghadapi momen yang sama: audit, pertanyaan sederhana tentang keluaran tertentu, dan tidak ada yang dapat ditunjukkan.

Membangun AI yang siap audit tidak tentang memperlambat. Ini tentang membangun sesuatu yang dapat bertahan.