Kecerdasan buatan

Bahasa yang Dihasilkan AI Mulai Mencemari Literatur Ilmiah

Peneliti dari Perancis dan Rusia telah menerbitkan sebuah studi yang menunjukkan bahwa penggunaan generator teks probabilistik yang digerakkan oleh AI seperti GPT-3 memperkenalkan ‘bahasa yang terdistorsi’, kutipan dari literatur yang tidak ada dan penggunaan gambar yang tidak terkredit secara ad hoc ke dalam saluran yang sebelumnya dihormati untuk penerbitan literatur ilmiah baru.

Mungkin yang paling mengkhawatirkan adalah bahwa makalah yang dipelajari juga berisi konten yang tidak akurat secara ilmiah atau tidak dapat direproduksi yang disajikan sebagai hasil dari penelitian objektif dan sistematis, yang menunjukkan bahwa model bahasa generatif digunakan tidak hanya untuk meningkatkan keterampilan bahasa Inggris yang terbatas dari penulis makalah, tetapi sebenarnya untuk melakukan pekerjaan yang sulit (dan, secara tidak terhindarkan, melakukan dengan buruk).

Laporan ini, berjudul Kalimat yang Terdistorsi: Gaya Penulisan yang Meragukan yang Muncul dalam Sains, telah disusun oleh peneliti dari Departemen Ilmu Komputer Universitas Toulouse dan peneliti Yandex Alexander Magazinov, saat ini di Universitas Tel Aviv.

Studi ini terutama berfokus pada pertumbuhan penerbitan ilmiah yang tidak masuk akal yang dihasilkan AI di Jurnal Elsevier Mikroprosesor dan Mikrosistem.

Dengan Nama Lain

Model bahasa autoregresif seperti GPT-3 dilatih pada volume data yang besar, dan dirancang untuk memparafrasekan, meringkas, mengumpulkan dan menafsirkan data yang berkontribusi ke dalam model bahasa generatif yang kohesif yang mampu mereproduksi pola bicara dan penulisan alami, sambil mempertahankan niat asli dari data pelatihan.

Karena kerangka kerja seperti itu sering kali dihukum pada tahap pelatihan model untuk menawarkan regurgitasi langsung dan ‘tidak terserap’ dari data asli, mereka secara tidak terhindarkan mencari sinonim – bahkan untuk frasa yang sudah mapan.

Submissions ilmiah yang tampaknya dibuat/dibantu oleh AI yang ditemukan oleh peneliti termasuk sejumlah besar upaya gagal untuk menciptakan sinonim kreatif untuk frasa yang dikenal dalam sektor pembelajaran mesin:

jaringan saraf dalam: organisasi saraf yang mendalam

jaringan saraf buatan: ‘(palsu | tiruan) organisasi saraf’

jaringan seluler: ‘organisasi yang serba guna’

serangan jaringan: ‘(serangan | penyerangan) organisasi’

koneksi jaringan: ‘asosiasi organisasi’

data besar: ‘(enormous | besar | luas | kolosal) informasi’

gudang data: ‘(gudang | pusat distribusi) informasi’

kecerdasan buatan (AI): ‘(palsu | buatan manusia) kesadaran’

komputasi kinerja tinggi: ‘pengolahan elite’

komputasi kabut/mistik/awan: ‘pengolahan kabut’

unit pengolahan grafis (GPU): ‘unit pengolahan desain’

unit pengolahan pusat (CPU): ‘unit pengolahan fokus’

mesin pengolahan kerja: ‘motor proses kerja’

pengenalan wajah: ‘pengakuan wajah’

pengenalan suara: ‘pengakuan percakapan’

kesalahan rata-rata kuadrat: ‘kesalahan rata-rata kuadrat (kesalahan | kekeliruan)’

kesalahan rata-rata absolut: ‘kesalahan rata-rata (kesalahan | kekeliruan)’

sinyal kebisingan: ‘(gerakan | bendera | tanda | sinyal) ke (kebisingan | keributan)’

parameter global: ‘parameter global’

akses acak: ‘(acak | tidak teratur) akses’

hutan acak: ‘(acak | tidak teratur) hutan’

nilai acak: ‘nilai (acak | tidak teratur)’

koloni semut: ‘(koloni | wilayah) semut bawah tanah’

energi yang tersisa: ‘energi yang tersisa’

energi kinetik: ‘energi gerak’

Bayes yang polos: ‘(percaya | polos) Bayes’

asisten digital pribadi (PDA): ‘asisten komputer pribadi’

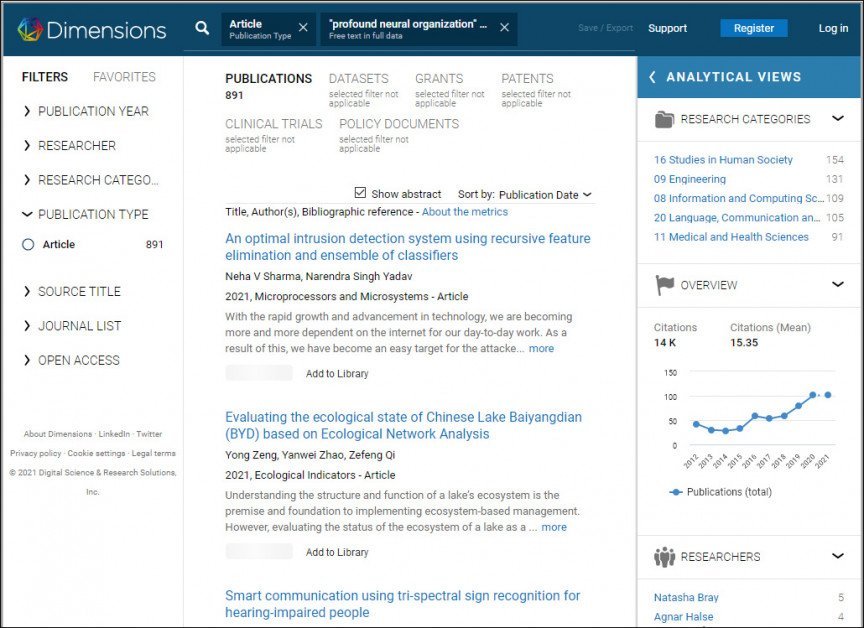

Pada bulan Mei 2021, peneliti melakukan pencarian di mesin pencari akademis Dimensions untuk mencari jenis bahasa yang terdistorsi dan otomatis, dengan mengambil hati-hati untuk mengecualikan frasa yang sah seperti ‘informasi yang besar’ (yang merupakan frasa yang valid, dan bukan sinonim gagal untuk ‘data besar’). Pada saat itu, mereka mengamati bahwa Mikroprosesor dan Mikrosistem memiliki jumlah tertinggi dari kesalahan paraphrasing.

Saat ini, masih memungkinkan untuk mengambil (snapshot arsip, 15/07/2021) sejumlah makalah ilmiah untuk frasa nonsens ‘organisasi saraf yang mendalam’ (yaitu ‘jaringan saraf dalam’), dan lain-lain dalam daftar di atas menghasilkan hasil yang serupa.

Hasil pencarian untuk ‘organisasi saraf yang mendalam’ (‘jaringan saraf dalam’) di Dimensions. Sumber: https://app.dimensions.ai/

Jurnal Mikroprosesor didirikan pada tahun 1976, dan berganti nama menjadi Mikroprosesor dan Mikrosistem dua tahun kemudian.

Pertumbuhan Bahasa yang Tidak Masuk Akal

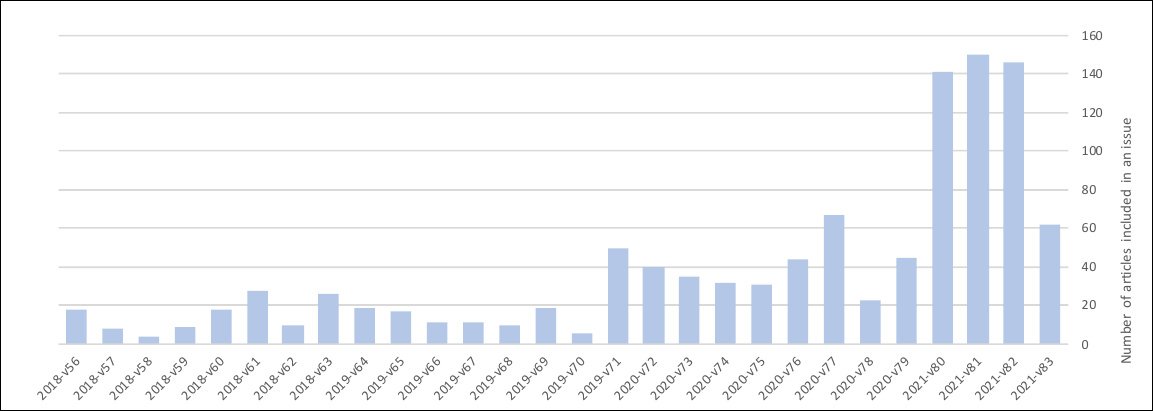

Peneliti mempelajari periode yang mencakup Februari 2018 hingga Juni 2021, dan mengamati peningkatan tajam dalam volume pengajuan selama dua tahun terakhir, dan terutama selama 6-8 bulan terakhir:

Korelasi atau kausalitas? Peningkatan pengajuan ke jurnal Mikroprosesor dan Mikrosistem tampaknya bertepatan dengan pertumbuhan ‘bahasa yang tidak masuk akal’ dan sinonim dalam pengajuan yang tampaknya sah. Sumber: https://arxiv.org/pdf/2107.06751.pdf

Dataset akhir yang dikumpulkan oleh kolaborator berisi 1.078 artikel panjang yang diperoleh melalui langganan Elsevier Universitas Toulouse.

Pengawasan Editorial yang Menurun untuk Makalah Ilmiah Cina

Makalah tersebut mengamati bahwa waktu yang dialokasikan untuk penilaian editorial dari pengajuan yang ditandai menjadi sangat singkat pada tahun 2021, turun ke bawah 40 hari; penurunan enam kali lipat dalam waktu standar untuk peer review, jelas sejak Februari 2021.

Jumlah terbesar dari makalah yang ditandai berasal dari penulis dengan afiliasi ke Tiongkok daratan: dari 404 makalah yang diterima dalam waktu kurang dari 30 hari, 97,5% adalah terkait dengan Cina. Sebaliknya, dalam kasus di mana proses editorial melebihi 40 hari (615 makalah), pengajuan yang terkait dengan Cina hanya 9,5% dari kategori tersebut – ketidakseimbangan sepuluh kali lipat.

Laporan tersebut mengaitkan infiltrasi makalah yang ditandai dengan kekurangan dalam proses editorial, dan kemungkinan kekurangan sumber daya dalam menghadapi peningkatan jumlah pengajuan.

Peneliti menghipotesiskan bahwa model bahasa generatif GPT-gaya, dan jenis kerangka kerja generasi bahasa yang serupa, telah digunakan untuk menghasilkan sebagian besar teks dalam makalah yang ditandai; namun, cara model generatif mengabstraksi sumbernya membuat ini sulit untuk dibuktikan, dan bukti utama terletak pada evaluasi umum dari sinonim yang buruk dan tidak perlu, dan pemeriksaan yang teliti terhadap koherensi logis pengajuan.

Peneliti lebih lanjut mengamati bahwa model bahasa generatif yang mereka yakini berkontribusi pada banjir makalah yang tidak masuk akal ini mampu tidak hanya menciptakan teks yang bermasalah, tetapi juga mengenali dan menandai mereka secara sistematis, dengan cara yang sama seperti peneliti sendiri telah melakukan secara manual. Karya tersebut merinci implementasi seperti itu, menggunakan GPT-2, dan menawarkan kerangka kerja untuk sistem masa depan untuk mengidentifikasi pengajuan ilmiah yang bermasalah.

Insiden pengajuan ‘tercemar’ jauh lebih tinggi di jurnal Elsevier (72,1%) dibandingkan dengan jurnal lain yang dipelajari (13,6% maksimum).

Bukan Hanya Semantik

Peneliti menekankan bahwa banyak dari jurnal yang dipertanyakan tidak hanya menggunakan bahasa yang salah, tetapi juga berisi pernyataan yang tidak akurat secara ilmiah, yang menunjukkan kemungkinan bahwa model bahasa generatif tidak hanya digunakan untuk meningkatkan keterampilan bahasa yang terbatas dari ilmuwan yang berkontribusi, tetapi mungkin juga digunakan untuk merumuskan setidaknya beberapa teorema dan data inti dalam makalah.

Dalam kasus lain, peneliti mengusulkan ‘resintesis’ atau ‘pengubahan’ dari pekerjaan sebelumnya yang diabstraksi (dan lebih baik), untuk memenuhi tekanan ‘terbit atau binasa’ budaya penelitian akademis, dan mungkin untuk meningkatkan peringkat nasional untuk keunggulan global dalam penelitian AI, melalui volume murni.

Konten yang tidak masuk akal dalam makalah yang dikirim. Dalam kasus ini, peneliti menemukan bahwa teks telah dihasilkan, secara ad hoc, dari artikel EDN, dari mana ilustrasi yang menyertainya juga dicuri tanpa atribusi. Penulisan kembali konten asli sangat ekstrem sehingga membuatnya tidak berarti.

Dalam menganalisis beberapa makalah Elsevier, peneliti menemukan kalimat yang tidak dapat mereka inferensi maknanya; referensi ke literatur yang tidak ada; referensi ke variabel dan teorema dalam rumus yang tidak benar-benar muncul dalam materi pendukung (menunjukkan abstraksi berbasis bahasa, atau ‘halusinasi‘ dari data yang tampaknya faktual); dan penggunaan kembali gambar tanpa pengakuan sumber (yang peneliti kritik tidak dari sudut pandang hak cipta, tetapi sebagai indikator kurangnya ketat ilmiah).

Keberhasilan Kutipan

Kutipan yang dimaksudkan untuk mendukung argumen dalam makalah ilmiah ditemukan dalam banyak contoh yang ditandai untuk ‘rusak atau mengarah ke publikasi yang tidak terkait’.

Selain itu, referensi ke ‘karya terkait’ tampaknya sering termasuk penulis yang peneliti yakini telah ‘dihalusinasi’ oleh sistem GPT-gaya.

Perhatian yang Mengembara

Kekurangan lain dari model bahasa yang bahkan canggih seperti GPT-3 adalah kecenderungan mereka untuk kehilangan fokus selama wacana panjang. Peneliti menemukan bahwa makalah yang ditandai sering mengangkat topik di awal makalah yang sebenarnya tidak pernah kembali setelah itu dibahas dalam catatan awal atau di tempat lain.

Mereka juga mengusulkan bahwa beberapa contoh terburuk terjadi melalui perjalanan teks sumber melalui serangkaian mesin terjemahan, masing-masing distorsi makna lebih jauh.

Sumber dan Alasan

Dalam mencoba memahami apa yang menyebabkan fenomena ini, penulis makalah menyarankan sejumlah kemungkinan: bahwa konten dari pabrik kertas digunakan sebagai bahan sumber, memperkenalkan ketidakakuratan sangat awal dalam proses yang pasti akan menghasilkan ketidakakuratan lebih lanjut; bahwa alat pemintal artikel seperti Spinbot digunakan untuk menyembunyikan plagiarisme; dan bahwa tekanan yang luar biasa untuk menerbitkan secara teratur menyebabkan peneliti yang kurang berdaya menggunakan sistem GPT-3-gaya untuk baik meningkatkan atau sepenuhnya menghasilkan makalah ilmiah baru.

Peneliti menutup dengan seruan untuk tindakan lebih lanjut untuk pengawasan yang lebih besar dan standar yang ditingkatkan dalam area penerbitan akademis yang tampaknya menjadi bahan bakar untuk subjeknya sendiri – sistem pembelajaran mesin. Mereka juga menasihati Elsevier dan penerbit lain untuk memperkenalkan prosedur penyaringan dan tinjauan yang lebih ketat, dan secara luas mengkritik standar dan praktik saat ini dalam hal ini, menyarankan bahwa ‘Penipuan dengan teks sintetis mengancam integritas literatur ilmiah.’