Anderson का एंगल

वाइब कोडिंग तब पीड़ित होती है जब एआई की भूमिका बढ़ जाती है

एक नए अध्ययन में पाया गया है कि वाइब कोडिंग में सुधार होता है जब मनुष्य निर्देश देते हैं, लेकिन गिरावट आती है जब एआई ऐसा करता है, और सबसे अच्छा हाइब्रिड सेटअप मनुष्यों को सबसे पहले रखता है, एआई को मध्यस्थ या निर्णायक के रूप में रखता है।

संयुक्त राज्य अमेरिका से नए शोध में, जिसमें यह देखा गया है कि जब एआई सिस्टम वाइब कोडिंग को निर्देशित करने की अनुमति दी जाती है, तो लार्ज लैंग्वेज मॉडल बड़ी भूमिका निभाते हैं, तो परिणाम लगभग हमेशा खराब होते हैं।

हालांकि शोधकर्ताओं ने अपने मानव/एआई सहयोगी प्रयोगों के लिए जीपीटी-5 का उपयोग किया था, बाद में उन्होंने पुष्टि की कि क्लाउड ओपस 4.5 और गूगल जेमिनी 3 प्रो भी बढ़ती जिम्मेदारियों के साथ समान गिरावट के पैटर्न के अधीन थे, यह कहते हुए कि ‘सीमित मानव भागीदारी लगातार प्रदर्शन में सुधार करती है’:

‘[मानव] पुनरावृत्तियों में से प्रत्येक में उच्च-स्तरीय मार्गदर्शन प्रदान करते हैं, [जबकि] एआई मार्गदर्शन अक्सर प्रदर्शन पतन की ओर ले जाता है। इसके अलावा, हम पाते हैं कि एक सावधानी से भूमिका आवंटन जो मानवों को दिशा के प्रभारी रखता है और मूल्यांकन को एआई में स्थानांतरित करता है, हाइब्रिड प्रदर्शन में सुधार कर सकता है।’

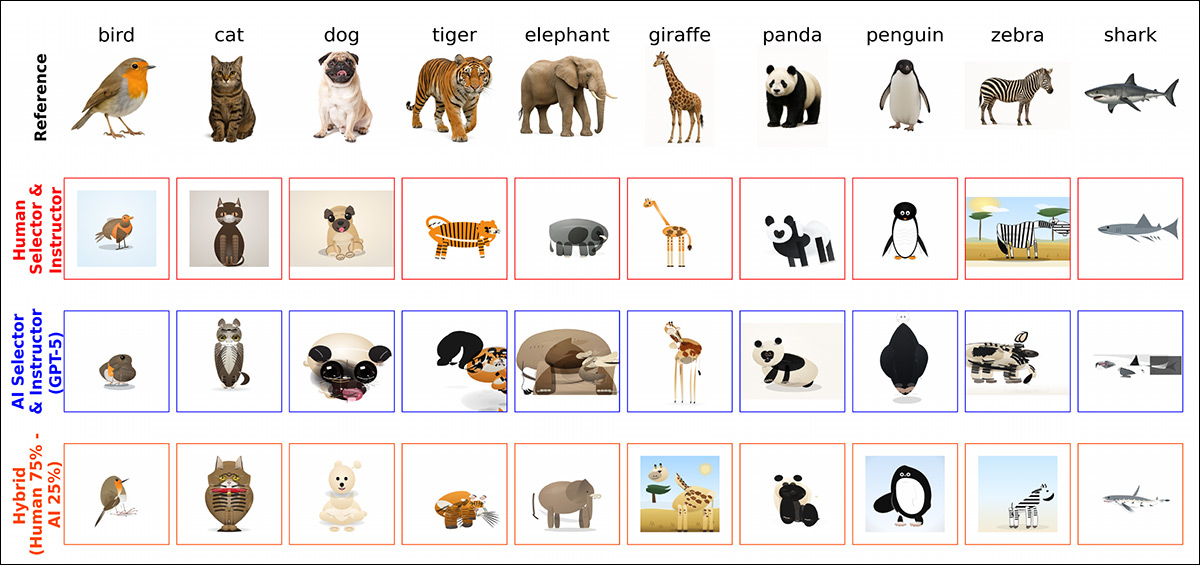

एक नियंत्रित प्रायोगिक ढांचे का निर्माण किया गया था जो एक पुनरावृत्त कोडिंग कार्य के आसपास बनाया गया था, जिसमें एक संदर्भ छवि – जिसमें एक बिल्ली, कुत्ता, बाघ, पक्षी, हाथी, पेंगुइन, शार्क, ज़ेब्रा, गिरगिट, या पांडा की फोटो शामिल थी – को एसवीजी का उपयोग करके पुनः बनाना था, और उस पुनर्निर्माण का मूल्यांकन संदर्भ छवि के खिलाफ किया जाना था जिससे यह प्राप्त किया गया था:

<img class=" wp-image-254921" src="https://www.unite.ai/wp-content/uploads/2026/02/validation-rating-interface.jpg" alt="मानव और एआई प्रतिभागियों को एक फोटोग्राफिक संदर्भ छवि के साथ-साथ एक एआई-जनरेटेड एसवीजी पुनर्निर्माण दिखाया गया था, और उन्हें सात-बिंदु स्केल पर दोनों के बीच कितनी समानता थी, यह दर्ज करने के लिए कहा गया था। स्रोत – https://arxiv.org/pdf/2602.10473” width=”942″ height=”561″ /> मानव और एआई प्रतिभागियों को एक फोटोग्राफिक संदर्भ छवि के साथ-साथ एक एआई-जनरेटेड एसवीजी पुनर्निर्माण दिखाया गया था, और उन्हें सात-बिंदु स्केल पर दोनों के बीच कितनी समानता थी, यह दर्ज करने के लिए कहा गया था। स्रोत

प्रत्येक राउंड में, एक एजेंट ने कोड जनरेटर को मार्गदर्शन करने के लिए उच्च-स्तरीय प्राकृतिक भाषा निर्देश प्रदान किया, और दूसरे ने तय किया कि नई संस्करण को रखना है या पिछले एक पर वापस जाना है – एक संरचित लूप जो वास्तविक सहयोगी कार्य प्रवाह को दर्शाता है।

सोलह प्रयोगों में, 604 प्रतिभागियों और हजारों एपीआई कॉल के साथ, पूरी तरह से मानव-नेतृत्व वाले परीक्षण राउंड की तुलना पूरी तरह से एआई-नेतृत्व वाले राउंड से की गई, अन्यथा समान शर्तों के तहत।

विभिन्न मानव/एआई सहयोग प्रतिशत और प्रकारों द्वारा प्राप्त विविध समाधान (स्रोत पत्र में एक बड़े चित्रण से लिया गया है, जिसे हम पाठक को संदर्भित करते हैं)

हालांकि मानव और एआई ने परीक्षणों की शुरुआत में समान स्तर पर प्रदर्शन किया, समय के साथ उनके पथ अलग हो गए: जब मानव निर्देश देते थे और चयन निर्णय लेते थे, तो समानता स्कोर पुनरावृत्तियों में बढ़ता गया, प्रत्येक राउंड में स्थिर संचयी सुधार के साथ; लेकिन जब एआई सिस्टम दोनों भूमिकाएं निभाते थे, तो प्रदर्शन में कोई सुसंगत लाभ नहीं होता था, और अक्सर पुनरावृत्तियों में गिरावट आती थी – भले ही एक ही अंतर्निहित मॉडल का उपयोग कोड जनरेशन के लिए किया गया था, और एआई के पास मानव प्रतिभागियों के समान जानकारी तक पहुंच थी।

… (बाकी सामग्री यहां जारी है)