कृत्रिम बुद्धिमत्ता

StyleTTS 2: मानव-स्तर का टेक्स्ट-टू-स्पीच बड़े भाषा मॉडल के साथ

प्राकृतिक और सिंथेटिक भाषण संश्लेषण दृष्टिकोण में वृद्धि के कारण, पिछले कुछ वर्षों में एआई उद्योग द्वारा हासिल की गई एक प्रमुख उपलब्धि ऑडियोबुक, वर्चुअल सहायक, वॉइस-ओवर कथाएं और अधिक सहित विभिन्न उद्योगों में विभिन्न अनुप्रयोगों के साथ प्रभावी ढंग से टेक्स्ट-टू-स्पीच फ्रेमवर्क का संश्लेषण करना है। हालांकि, उनके मजबूत प्रदर्शन के बावजूद, अभी भी व्यक्तिपरक और विविध भाषण, शून्य-शॉट टेक्स्ट से भाषण फ्रेमवर्क के अनुकूलन के लिए बड़ी मात्रा में प्रशिक्षण डेटा की आवश्यकता और ओओडी या वितरण से बाहर निकलने वाले पाठ के लिए लचीलापन के कार्यों के लिए सुधार के लिए जगह है, जिससे डेवलपर्स को एक अधिक मजबूत और सुलभ पाठ से भाषण फ्रेमवर्क पर काम करने के लिए प्रेरित किया जाता है।

इस लेख में, हम StyleTTS-2 के बारे में बात करेंगे, एक मजबूत और नवीन टेक्स्ट-टू-स्पीच फ्रेमवर्क जो StyleTTS फ्रेमवर्क के आधार पर बनाया गया है, और राज्य के कला टेक्स्ट-टू-स्पीच प्रणालियों की ओर अगले चरण को प्रस्तुत करने का लक्ष्य रखता है। StyleTTS2 फ्रेमवर्क भाषण शैलियों को लेटेंट रैंडम वेरिएबल के रूप में मॉडल करता है, और इन भाषण शैलियों या रैंडम वेरिएबल को नमूना लेने के लिए एक संभावित प्रसार मॉडल का उपयोग करता है, जिससे StyleTTS2 फ्रेमवर्क को संदर्भ ऑडियो इनपुट का उपयोग किए बिना वास्तविक भाषण का संश्लेषण करने की अनुमति मिलती है। दृष्टिकोण के कारण, StyleTTS2 फ्रेमवर्क वर्तमान राज्य के कला टेक्स्ट-टू-स्पीच फ्रेमवर्क की तुलना में बेहतर परिणाम दिखाता है और उच्च दक्षता प्रदर्शित करता है, लेकिन साथ ही साथ प्रसार मॉडल फ्रेमवर्क द्वारा प्रदान की जाने वाली विविध भाषण संश्लेषण का लाभ उठाने में भी सक्षम है। हम StyleTTS2 फ्रेमवर्क पर विस्तार से चर्चा करेंगे, और इसके आर्किटेक्चर और विधि के बारे में बात करेंगे, साथ ही साथ फ्रेमवर्क द्वारा प्राप्त परिणामों पर भी नज़र डालेंगे। तो चलिए शुरू करें।

StyleTTS2 के लिए टेक्स्ट से भाषण संश्लेषण: एक परिचय

StyleTTS2 एक नवीन टेक्स्ट-टू-स्पीच संश्लेषण मॉडल है जो मानव-स्तर के टीटीएस फ्रेमवर्क के निर्माण की ओर अगले चरण को लेता है, और यह StyleTTS पर बनाया गया है, एक शैली-आधारित टेक्स्ट से भाषण जनरेटिव मॉडल। StyleTTS2 फ्रेमवर्क भाषण शैलियों को लेटेंट रैंडम वेरिएबल के रूप में मॉडल करता है, और इन भाषण शैलियों या रैंडम वेरिएबल को नमूना लेने के लिए एक संभावित प्रसार मॉडल का उपयोग करता है, जिससे StyleTTS2 फ्रेमवर्क को संदर्भ ऑडियो इनपुट का उपयोग किए बिना वास्तविक भाषण का संश्लेषण करने की अनुमति मिलती है। शैलियों को लेटेंट रैंडम वेरिएबल के रूप में मॉडल करना StyleTTS2 फ्रेमवर्क को इसके पूर्ववर्ती, StyleTTS फ्रेमवर्क से अलग करता है, और यह इनपुट पाठ के लिए सबसे उपयुक्त भाषण शैली का उत्पादन करने का लक्ष्य रखता है बिना संदर्भ ऑडियो इनपुट की आवश्यकता के, और यह प्रभावी लेटेंट प्रसार को प्राप्त करने में सक्षम है जबकि प्रसार मॉडल द्वारा प्रदान की जाने वाली विविध भाषण संश्लेषण क्षमताओं का लाभ उठाता है। इसके अलावा, StyleTTS2 फ्रेमवर्क में पूर्व-प्रशिक्षित बड़े एसएलएम या भाषा मॉडल को वेवएलएम फ्रेमवर्क के रूप में निर्णायक के रूप में नियुक्त किया जाता है, और इसे अपने नovel डिफरेंशियल ड्यूरेशन मॉडलिंग दृष्टिकोण के साथ जोड़कर प्रशिक्षित किया जाता है, जिससे फ्रेमवर्क को अंत से अंत तक प्रशिक्षित किया जा सकता है और अंततः प्राकृतिकता में सुधार के साथ भाषण का उत्पादन किया जा सकता है। दृष्टिकोण के कारण, StyleTTS2 फ्रेमवर्क वर्तमान राज्य के कला फ्रेमवर्क को पार करता है भाषण पीढ़ी कार्यों में और शून्य-शॉट सेटिंग में बड़े पैमाने पर भाषण मॉडल के पूर्व-प्रशिक्षण के लिए सबसे कुशल फ्रेमवर्क में से एक है।

आगे बढ़ते हुए, मानव-स्तर के टेक्स्ट-टू-स्पीच संश्लेषण को वितरित करने के लिए, StyleTTs2 फ्रेमवर्क मौजूदा कार्यों से सीखने को शामिल करता है, जिनमें भाषण संश्लेषण के लिए प्रसार मॉडल और बड़े भाषा मॉडल शामिल हैं। प्रसार मॉडल आमतौर पर भाषण संश्लेषण कार्यों के लिए उपयोग किए जाते हैं क्योंकि वे बारीक भाषण नियंत्रण और विविध भाषण नमूना क्षमताओं को प्रदान करते हैं। हालांकि, प्रसार मॉडल जीएन-आधारित गैर-पुनरावृत्ति फ्रेमवर्क के रूप में कुशल नहीं हैं और इसका एक प्रमुख कारण यह है कि लक्ष्य भाषण की अवधि तक लेटेंट प्रतिनिधित्व, वेवफॉर्म और मेल-स्पेक्ट्रोग्राम को पुनरावृत्ति से नमूना लेने की आवश्यकता होती है।

दूसरी ओर, बड़े भाषा मॉडल के आसपास हाल के कार्यों ने उनकी क्षमता को प्रदर्शित किया है टेक्स्ट से भाषण पीढ़ी कार्यों की गुणवत्ता में सुधार करने और वक्ता के अनुकूल होने में। बड़े भाषा मॉडल आमतौर पर पाठ इनपुट को या तो पूर्व-प्रशिक्षित भाषा मॉडल से प्राप्त किए गए प्रतिनिधित्व में परिवर्तित करते हैं या भाषण पुनर्निर्माण कार्यों के लिए निरंतर प्रतिनिधित्व में परिवर्तित करते हैं। हालांकि, इन भाषा मॉडल की विशेषताएं सीधे भाषण संश्लेषण के लिए अनुकूलित नहीं हैं। इसके विपरीत, StyleTTS2 फ्रेमवर्क बड़े एसएलएम फ्रेमवर्क द्वारा प्राप्त ज्ञान का लाभ उठाता है विरोधी प्रशिक्षण का उपयोग करके भाषण भाषा मॉडल की विशेषताओं का संश्लेषण करने के लिए, और इसलिए, सीधे भाषण संश्लेषण के लिए अनुकूलित लेटेंट स्थान को सीखने में सक्षम है।

StyleTTS2: आर्किटेक्चर और विधि

इसके मूल में, StyleTTS2 अपने पूर्ववर्ती, StyleTTS फ्रेमवर्क पर बनाया गया है, जो एक गैर-आत्मनिर्भर टेक्स्ट-टू-स्पीच फ्रेमवर्क है जो एक शैली एनकोडर का उपयोग करता है संदर्भ ऑडियो से एक शैली वेक्टर का उत्पादन करने के लिए, जिससे अभिव्यंजक और प्राकृतिक भाषण पीढ़ी की अनुमति मिलती है। StyleTTS फ्रेमवर्क में उपयोग किया जाने वाला शैली वेक्टर सीधे एनकोडर, अवधि और पूर्वानुमानकर्ताओं में शामिल किया जाता है एडाप्टिव इंस्टेंस नॉर्मलाइजेशन का उपयोग करके, जिससे StyleTTS मॉडल को विभिन्न प्रोसोडी, अवधि और यहां तक कि भावनाओं के साथ भाषण आउटपुट का उत्पादन करने की अनुमति मिलती है। StyleTTS फ्रेमवर्क में कुल 8 मॉडल होते हैं जो तीन श्रेणियों में विभाजित होते हैं

- अकाउस्टिक मॉडल या भाषण पीढ़ी प्रणाली जिसमें एक शैली एनकोडर, एक पाठ एनकोडर और एक भाषण डिकोडर शामिल है।

- एक पाठ से भाषण पूर्वानुमान प्रणाली जो प्रोसोडी और अवधि पूर्वानुमानकर्ताओं का उपयोग करती है।

- एक यूटिलिटी सिस्टम जिसमें एक पाठ संरेखक, एक पिच एक्सट्रैक्टर और एक निर्णायक प्रशिक्षण उद्देश्यों के लिए शामिल है।

इसके दृष्टिकोण के कारण, StyleTTS फ्रेमवर्क नियंत्रित और विविध भाषण संश्लेषण से संबंधित राज्य के कला प्रदर्शन को प्रदान करता है। हालांकि, इस प्रदर्शन में नमूना गुणवत्ता में गिरावट, अभिव्यंजक सीमाएं और वास्तविक समय में भाषण-रोधी अनुप्रयोगों पर निर्भरता जैसे नुकसान हैं।

StyleTTS फ्रेमवर्क में सुधार करते हुए, StyleTTS2 मॉडल व्यक्तिपरक टेक्स्ट-टू-स्पीच कार्यों में सुधार के साथ-साथ बेहतर ओओडी प्रदर्शन और उच्च मानव-स्तर की गुणवत्ता प्रदान करता है। StyleTTS2 फ्रेमवर्क एक अंत से अंत प्रशिक्षण प्रक्रिया का उपयोग करता है जो विभिन्न घटकों को विरोधी प्रशिक्षण के साथ अनुकूलित करता है और सीधे वेवफॉर्म संश्लेषण को संयुक्त रूप से प्रशिक्षित करता है। StyleTTS फ्रेमवर्क के विपरीत, StyleTTS2 फ्रेमवर्क भाषण शैली को एक लेटेंट वेरिएबल के रूप में मॉडल करता है और प्रसार मॉडल के माध्यम से इसका नमूना लेता है, जिससे StyleTTS2 फ्रेमवर्क को संदर्भ ऑडियो का उपयोग किए बिना वास्तविक भाषण का संश्लेषण करने की अनुमति मिलती है। आइए इन घटकों पर विस्तार से नज़र डालें।

हस्तक्षेप के लिए अंत से अंत प्रशिक्षण

StyleTTS2 फ्रेमवर्क में, एक अंत से अंत प्रशिक्षण दृष्टिकोण का उपयोग विभिन्न पाठ से भाषण घटकों को हस्तक्षेप के लिए अनुकूलित करने के लिए किया जाता है जो निश्चित घटकों पर निर्भर नहीं है। StyleTTS2 फ्रेमवर्क यह हासिल करता है डिकोडर को संशोधित करके जो सीधे शैली वेक्टर, पिच और ऊर्जा के वक्र और संरेखित प्रतिनिधित्व से वेवफॉर्म का उत्पादन करता है। फ्रेमवर्क तब डिकोडर की अंतिम प्रोजेक्शन परत को हटा देता है और इसे एक वेवफॉर्म डिकोडर से बदल देता है। StyleTTS2 फ्रेमवर्क दो एनकोडर का उपयोग करता है: हिफीगैन-आधारित डिकोडर वेवफॉर्म का उत्पादन करने के लिए और एक आईएसटीएफटी-आधारित डिकोडर जो चरण और परिमाण का उत्पादन करता है जो वेवफॉर्म में परिवर्तित हो जाता है तेजी से हस्तक्षेप और प्रशिक्षण के लिए।

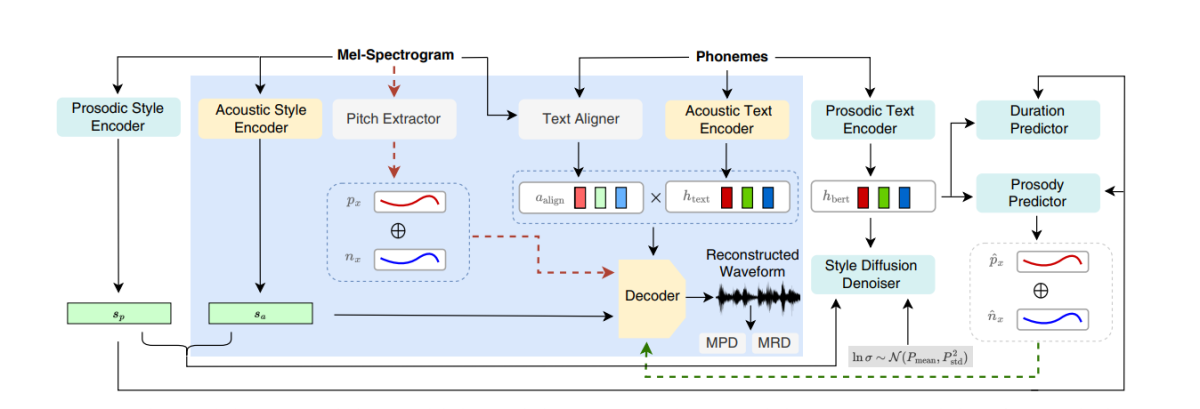

उपरोक्त चित्र में प्री-प्रशिक्षण और संयुक्त प्रशिक्षण के लिए उपयोग किए जाने वाले अकाउस्टिक मॉडल का प्रतिनिधित्व किया गया है। प्रशिक्षण समय को कम करने के लिए, मॉड्यूल पहले प्री-प्रशिक्षण चरण में अनुकूलित किए जाते हैं, इसके बाद संयुक्त प्रशिक्षण के दौरान सभी घटकों को पिच एक्सट्रैक्टर को छोड़कर अनुकूलित किया जाता है। पिच एक्सट्रैक्टर को संयुक्त प्रशिक्षण के दौरान अनुकूलित नहीं किया जाता है क्योंकि यह पिच वक्र के लिए आधारभूत सत्य प्रदान करने के लिए उपयोग किया जाता है।

उपरोक्त चित्र में वेवएलएम फ्रेमवर्क के साथ भाषण भाषा मॉडल विरोधी प्रशिक्षण और हस्तक्षेप का प्रतिनिधित्व किया गया है, जो पूर्व-प्रशिक्षित लेकिन पूर्व-संयुक्त नहीं है। यह प्रक्रिया ऊपर वर्णित प्रक्रिया से भिन्न है क्योंकि यह विभिन्न इनपुट पाठ ले सकता है लेकिन प्रत्येक बैच में ग्रेडिएंट को जमा करता है ताकि पैरामीटर को अपडेट किया जा सके।

शैली प्रसार

StyleTTS2 फ्रेमवर्क का उद्देश्य एक संघटनात्मक वितरण के माध्यम से भाषण को एक शर्तीय वितरण के रूप में मॉडल करना है जो एक लेटेंट वेरिएबल का अनुसरण करता है, और इस वेरिएबल को सामान्यीकृत भाषण शैली कहा जाता है, जो भाषण नमूने में किसी भी विशेषता का प्रतिनिधित्व करता है जो किसी भी फोनेटिक सामग्री के दायरे से परे है, जिसमें लेक्सिकल तनाव, प्रोसोडी, बोलने की दर और यहां तक कि फॉर्मेंट संक्रमण भी शामिल हैं।

भाषण भाषा मॉडल निर्णायक

भाषण भाषा मॉडल अपनी सामान्य क्षमताओं के लिए जाने जाते हैं विभिन्न सेमेंटिक और अकουσ्टिक पहलुओं पर मूल्यवान जानकारी को एन्कोड करने के लिए, और एसएलएम प्रतिनिधित्वों ने पारंपरिक रूप से मानव धारणा की नकल करने में सक्षम दिखाया है संश्लेषित भाषण की गुणवत्ता का मूल्यांकन करने के लिए। StyleTTS2 फ्रेमवर्क एक विरोधी प्रशिक्षण दृष्टिकोण का उपयोग करता है एसएलएम एनकोडर की क्षमता का लाभ उठाने के लिए उत्पादक कार्यों को करने के लिए, और 12-परत वेवएलएम फ्रेमवर्क को निर्णायक के रूप में नियुक्त करता है। यह दृष्टिकोण फ्रेमवर्क को ओओडी या बाहरी वितरण पाठ पर प्रशिक्षण की अनुमति देता है जो प्रदर्शन में सुधार करने में मदद कर सकता है। इसके अलावा, ओवरफिटिंग समस्याओं को रोकने के लिए, फ्रेमवर्क ओओडी पाठ और इन-वितरण पाठ को समान संभावना के साथ नमूना लेता है।

विभेदक अवधि मॉडलिंग

पारंपरिक रूप से, एक अवधि पूर्वानुमानकर्ता का उपयोग टेक्स्ट से भाषण फ्रेमवर्क में किया जाता है जो फोनीम अवधि का उत्पादन करता है, लेकिन इन अवधि पूर्वानुमानकर्ताओं द्वारा उपयोग की जाने वाली अपसैंपलिंग विधियां अक्सर ई2ई प्रशिक्षण प्रक्रिया के दौरान ग्रेडिएंट प्रवाह को अवरुद्ध करती हैं, और नेचरलस्पीच फ्रेमवर्क मानव-स्तर के टेक्स्ट से भाषण रूपांतरण के लिए एक ध्यान-आधारित अपसैंपलर का उपयोग करता है। हालांकि, StyleTTS2 फ्रेमवर्क इस दृष्टिकोण को विरोधी प्रशिक्षण के दौरान अस्थिर पाता है क्योंकि StyleTTS2 विभेदक प्रशिक्षण के साथ विभेदक अपसैंपलिंग का उपयोग करता है बिना अतिरिक्त शब्दों के नुकसान के कारण लंबाई में विचलन के कारण। हालांकि एक नरम गतिशील समय वार्पिंग दृष्टिकोण का उपयोग इस विचलन को कम करने में मदद कर सकता है, इसका उपयोग करना न केवल गणनात्मक रूप से महंगा है, बल्कि विरोधी उद्देश्यों या मेल-निर्माण कार्यों के साथ काम करते समय इसकी स्थिरता भी एक चिंता का विषय है। इसलिए, मानव-स्तर के प्रदर्शन को प्राप्त करने और प्रशिक्षण प्रक्रिया को स्थिर करने के लिए, StyleTTC2 फ्रेमवर्क एक गैर-पैरामीट्रिक अपसैंपलिंग दृष्टिकोण का उपयोग करता है। गॉसियन अपसैंपलिंग एक लोकप्रिय गैर-पैरामीट्रिक अपसैंपलिंग दृष्टिकोण है जो फोनीम की अवधि के लिए पूर्वानुमानित मूल्यों को परिवर्तित करने के लिए उपयोग किया जाता है, हालांकि इसकी सीमाएं हैं जो गॉसियन कERNEL की निर्धारित लंबाई के कारण होती हैं। इस सीमा का सामना करने के लिए, StyleTTC2 फ्रेमवर्क एक नए गैर-पैरामीट्रिक अपसैंपलिंग दृष्टिकोण का प्रस्ताव करता है जो किसी भी अतिरिक्त प्रशिक्षण की आवश्यकता नहीं है और विभिन्न लंबाई के संरेखण को संभालने में सक्षम है। प्रत्येक फोनीम के लिए, StyleTTC2 फ्रेमवर्क संरेखण को एक यादृच्छिक वेरिएबल के रूप में मॉडल करता है और यह सूचकांक को इंगित करता है जिसके साथ फोनीम भाषण फ्रेम से संरेखित होता है।

मॉडल प्रशिक्षण और मूल्यांकन

StyleTTC2 फ्रेमवर्क को तीन डेटासेट पर प्रशिक्षित और प्रयोग किया जाता है: वीसीटीके, लिब्रिटीटीएस, और एलजेस्पीच। StyleTTS2 फ्रेमवर्क का एकल-स्पीकर घटक एलजेस्पीच डेटासेट पर प्रशिक्षित किया जाता है जिसमें लगभग 13,000+ ऑडियो नमूने होते हैं जो 12,500 प्रशिक्षण नमूनों, 100 सत्यापन नमूनों और लगभग 500 परीक्षण नमूनों में विभाजित होते हैं, जिनका कुल रन समय लगभग 24 घंटे होता है। फ्रेमवर्क का बहु-स्पीकर घटक वीसीटीके डेटासेट पर प्रशिक्षित किया जाता है जिसमें 100 से अधिक मूल वक्ताओं के साथ 44,000 से अधिक ऑडियो क्लिप होते हैं और यह 43,500 प्रशिक्षण नमूनों, 100 सत्यापन नमूनों और लगभग 500 परीक्षण नमूनों में विभाजित होता है। अंत में, फ्रेमवर्क को शून्य-शॉट अनुकूलन क्षमताओं से लैस करने के लिए, इसे लिब्रिटीटीएस डेटासेट पर प्रशिक्षित किया जाता है जिसमें लगभग 250 घंटे के ऑडियो क्लिप होते हैं जो 1,150 से अधिक व्यक्तिगत वक्ताओं के साथ होते हैं। अपने प्रदर्शन का मूल्यांकन करने के लिए, मॉडल दो मेट्रिक्स का उपयोग करता है: एमओएस-एन या मानव-स्तर की गुणवत्ता का माध्यमिक राय स्कोर, और एमओएस-एस या समानता का माध्यमिक राय स्कोर।

परिणाम

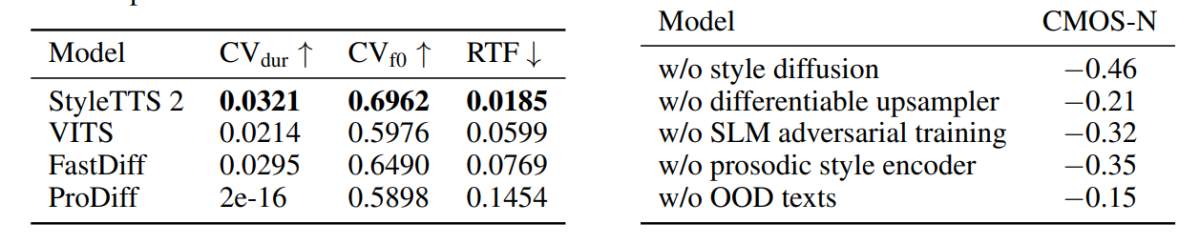

StyleTTS2 फ्रेमवर्क का दृष्टिकोण और विधि इसके प्रदर्शन में परिलक्षित होता है क्योंकि मॉडल विभिन्न राज्य के कला टीटीएस फ्रेमवर्क को पार करता है, विशेष रूप से नेचरलस्पीच डेटासेट पर, और इस प्रकार डेटासेट के लिए एक नया मानक स्थापित करता है। इसके अलावा, StyleTTS2 फ्रेमवर्क वीसीटीके डेटासेट पर राज्य के कला वीआईटीएस फ्रेमवर्क को पार करता है, और परिणाम निम्नलिखित चित्र में प्रदर्शित होते हैं।

StyleTTS2 मॉडल एलजेस्पीच डेटासेट पर पिछले मॉडलों को भी पार करता है और यह प्रदर्शित नहीं करता है कि ओओडी या बाहरी वितरण पाठ पर गुणवत्ता में कोई गिरावट आती है, जैसा कि पिछले फ्रेमवर्क द्वारा उसी मेट्रिक्स पर प्रदर्शित किया गया था। इसके अलावा, शून्य-शॉट सेटिंग में, StyleTTC2 मॉडल मौजूदा वैल-ई फ्रेमवर्क को प्राकृतिकता में पार करता है, हालांकि यह समानता के मामले में पीछे रहता है। हालांकि, यह ध्यान देने योग्य है कि StyleTTS2 फ्रेमवर्क प्रतिस्पर्धी प्रदर्शन हासिल करने में सक्षम है尽管 यह केवल 245 घंटे के ऑडियो नमूनों पर प्रशिक्षित किया गया है, जबकि वैल-ई फ्रेमवर्क को 60k घंटे से अधिक के प्रशिक्षण की आवश्यकता होती है, जिससे StyleTTC2 को मौजूदा बड़े पूर्व-प्रशिक्षण विधियों के लिए एक डेटा-कुशल विकल्प साबित होता है।

आगे बढ़ते हुए, भावना लेबल वाले ऑडियो पाठ डेटा की कमी के कारण, StyleTTC2 फ्रेमवर्क जीपीटी-4 मॉडल का उपयोग करता है विभिन्न भावनाओं में 500 से अधिक उदाहरणों को बनाने के लिए अपनी प्रसार प्रक्रिया के माध्यम से शैली वेक्टर का दृश्यांतरण करने के लिए।

पहले चित्र में, एलजेस्पीच मॉडल से शैली वेक्टर द्वारा इनपुट पाठ भावनाओं के प्रति भावनात्मक शैलियों का प्रतिनिधित्व किया जाता है, और यह StyleTTC2 फ्रेमवर्क की क्षमता को प्रदर्शित करता है विभिन्न भावनाओं के साथ अभिव्यंजक भाषण का संश्लेषण करने के लिए। दूसरा चित्र पांच व्यक्तिगत वक्ताओं के लिए अलग-अलग समूहों का प्रदर्शन करता है, जो एक ही ऑडियो फ़ाइल से विविधता की एक विस्तृत श्रृंखला को प्रदर्शित करता है। अंतिम चित्र वक्ता 1 से भावनाओं के ढीले समूह को प्रदर्शित करता है, और यह दर्शाता है कि भावना-आधारित समूह प्रमुख हैं, जो यह दर्शाता है कि संदर्भ ऑडियो नमूने और इसके इनपुट स्वर की परवाह किए बिना वक्ता के भावनात्मक स्वर को हेरफेर करने की संभावना है। प्रसार-आधारित दृष्टिकोण का उपयोग करने के बावजूद, StyleTTS2 फ्रेमवर्क मौजूदा राज्य के कला फ्रेमवर्क को पार करता है, जिनमें वीआईटीएस, प्रोडिफ और फास्टडिफ शामिल हैं।

अंतिम विचार

इस लेख में, हमने StyleTTS2 के बारे में बात की है, एक नवीन, मजबूत और नवाचारी टेक्स्ट-टू-स्पीच फ्रेमवर्क जो StyleTTS फ्रेमवर्क के आधार पर बनाया गया है और राज्य के कला टेक्स्ट-टू-स्पीच प्रणालियों की ओर अगले चरण को प्रस्तुत करने का लक्ष्य रखता है। StyleTTS2 फ्रेमवर्क भाषण शैलियों को लेटेंट रैंडम वेरिएबल के रूप में मॉडल करता है और इन भाषण शैलियों या रैंडम वेरिएबल को नमूना लेने के लिए एक संभावित प्रसार मॉडल का उपयोग करता है, जिससे StyleTTS2 फ्रेमवर्क को संदर्भ ऑडियो इनपुट का उपयोग किए बिना वास्तविक भाषण का संश्लेषण करने की अनुमति मिलती है। StyleTTS2 फ्रेमवर्क शैली प्रसार और एसएलएम निर्णायक का उपयोग करके टेक्स्ट-टू-स्पीच कार्यों पर मानव-स्तर के प्रदर्शन को प्राप्त करता है और मौजूदा राज्य के कला फ्रेमवर्क को पार करता है।