कृत्रिम बुद्धिमत्ता

स्थिर वीडियो डिफ्यूजन: लेटेंट वीडियो डिफ्यूजन मॉडल्स को बड़े डेटासेट पर

जेनरेटिव एआई कुछ समय से अब तक एआई समुदाय में एक महत्वपूर्ण बल रहा है, और जेनरेटिव इमेज मॉडलिंग के क्षेत्र में विशेष रूप से डिफ्यूजन मॉडल्स का उपयोग करके किए गए प्रगति ने जेनरेटिव वीडियो मॉडल्स को न केवल शोध में बल्कि वास्तविक दुनिया के अनुप्रयोगों में भी काफी प्रगति करने में मदद की है। पारंपरिक रूप से, जेनरेटिव वीडियो मॉडल्स या तो शुरू से प्रशिक्षित होते हैं, या वे आंशिक रूप से या पूरी तरह से प्री-प्रशिक्षित इमेज मॉडल्स से फाइन-ट्यून किए जाते हैं जिसमें अतिरिक्त समय स्तर होते हैं, छवि और वीडियो डेटासेट के मिश्रण पर।

जेनरेटिव वीडियो मॉडल्स में प्रगति को आगे बढ़ाते हुए, इस लेख में, हम स्थिर वीडियो डिफ्यूजन मॉडल के बारे में बात करेंगे, जो एक लेटेंट वीडियो डिफ्यूजन मॉडल है जो उच्च-रिज़ॉल्यूशन, राज्य-ऑफ-द-आर्ट इमेज से वीडियो और टेक्स्ट से वीडियो सामग्री को उत्पन्न करने में सक्षम है। हम इस बारे में बात करेंगे कि 2D छवियों के संश्लेषण के लिए प्रशिक्षित लेटेंट डिफ्यूजन मॉडल्स ने कैसे जेनरेटिव वीडियो मॉडल्स की क्षमताओं और दक्षता में सुधार किया है समय स्तर जोड़कर और छोटे डेटासेट पर मॉडल को फाइन-ट्यून करके जो उच्च-गुणवत्ता वाले वीडियो से बना है। हम स्थिर वीडियो डिफ्यूजन मॉडल की वास्तुकला और कार्यों में गहराई से जाएंगे और विभिन्न मीट्रिक्स पर इसके प्रदर्शन का मूल्यांकन करेंगे और इसे वीडियो पीढ़ी के लिए वर्तमान राज्य के कला ढांचे के साथ तुलना करेंगे। तो आइए शुरू करें।

स्थिर वीडियो डिफ्यूजन मॉडल और जेनरेटिव वीडियो मॉडल्स: एक परिचय

इसकी लगभग असीमित संभावना के कारण, जेनरेटिव एआई एआई और एमएल प्रैक्टिशनर्स के लिए शोध का प्राथमिक विषय रहा है, और पिछले कुछ वर्षों में जेनरेटिव इमेज मॉडल्स की दक्षता और प्रदर्शन में तेजी से प्रगति हुई है। जेनरेटिव इमेज मॉडल्स से सीखने ने शोधकर्ताओं और डेवलपर्स को जेनरेटिव वीडियो मॉडल्स पर प्रगति करने में मदद की है, जिससे उन्हें बढ़ी हुई व्यावहारिकता और वास्तविक दुनिया के अनुप्रयोग मिले हैं। हालांकि, जेनरेटिव वीडियो मॉडल्स की क्षमताओं में सुधार करने के प्रयासों में से अधिकांश मुख्य रूप से समय और स्थानिक स्तरों की सटीक व्यवस्था पर केंद्रित होते हैं, जेनरेटिव मॉडल्स के परिणाम पर डेटा के चयन के प्रभाव की जांच करने के लिए कम ध्यान दिया जाता है।

जेनरेटिव इमेज मॉडल्स द्वारा की गई प्रगति के कारण, शोधकर्ताओं ने观察 किया है कि प्रशिक्षण डेटा वितरण जेनरेटिव मॉडल्स के प्रदर्शन पर एक महत्वपूर्ण और विवादित प्रभाव डालता है। इसके अलावा, शोधकर्ताओं ने यह भी देखा है कि एक बड़े और विविध डेटासेट पर एक जेनरेटिव इमेज मॉडल को प्री-प्रशिक्षित करना और फिर इसे एक छोटे डेटासेट पर फाइन-ट्यून करना जो बेहतर गुणवत्ता का है, अक्सर प्रदर्शन में काफी सुधार करता है। पारंपरिक रूप से, जेनरेटिव वीडियो मॉडल्स सफल जेनरेटिव इमेज मॉडल्स से सीखे गए ज्ञान को लागू करते हैं, और शोधकर्ता अभी तक डेटा और प्रशिक्षण रणनीतियों के प्रभाव का अध्ययन करने के लिए हैं। स्थिर वीडियो डिफ्यूजन मॉडल जेनरेटिव वीडियो मॉडल्स की क्षमताओं में सुधार करने का एक प्रयास है जो पहले अनुसंधानित क्षेत्रों में विशेष रूप से डेटा के चयन पर ध्यान केंद्रित करता है।

हाल के जेनरेटिव वीडियो मॉडल्स डिफ्यूजन मॉडल्स और टेक्स्ट कंडीशनिंग या इमेज कंडीशनिंग दृष्टिकोण पर निर्भर करते हैं ताकि कई सुसंगत वीडियो या इमेज फ्रेम को संश्लेषित किया जा सके। डिफ्यूजन मॉडल्स अपनी क्षमता के लिए जाने जाते हैं कि वे कैसे धीरे-धीरे एक नमूने को सामान्य वितरण से शोर को कम करके सीखते हैं एक पुनरावृत्ति सुधार प्रक्रिया को लागू करके, और उन्होंने उच्च-रिज़ॉल्यूशन वीडियो और टेक्स्ट से इमेज संश्लेषण पर वांछित परिणाम दिए हैं। इसी सिद्धांत का उपयोग करके, स्थिर वीडियो डिफ्यूजन मॉडल अपने वीडियो डेटासेट पर एक लेटेंट वीडियो डिफ्यूजन मॉडल को प्रशिक्षित करता है जेनरेटिव एडवर्सेरियल नेटवर्क्स या जीएएनएस और स्व-सरंक्षक मॉडल्स का भी उपयोग करता है।

स्थिर वीडियो डिफ्यूजन मॉडल एक अनोखी रणनीति का पालन करता है जो किसी भी जेनरेटिव वीडियो मॉडल द्वारा पहले लागू नहीं की गई है, क्योंकि यह एक निश्चित वास्तुकला और एक निश्चित प्रशिक्षण रणनीति के साथ लेटेंट वीडियो डिफ्यूजन बेसलाइन्स पर निर्भर करता है, और फिर डेटा को क्यूरेट करने के प्रभाव का मूल्यांकन करता है। स्थिर वीडियो डिफ्यूजन मॉडल जेनरेटिव वीडियो मॉडलिंग के क्षेत्र में निम्नलिखित योगदान देने का लक्ष्य रखता है:

- एक व्यवस्थित और प्रभावी डेटा क्यूरेशन वर्कफ्लो प्रस्तुत करने का प्रयास करना ताकि एक बड़े अनक्यूरेटेड वीडियो नमूनों को उच्च-गुणवत्ता वाले डेटासेट में परिवर्तित किया जा सके जो फिर जेनरेटिव वीडियो मॉडल्स द्वारा उपयोग किया जाता है।

- इमेज से वीडियो और टेक्स्ट से वीडियो मॉडल्स को प्रशिक्षित करना जो मौजूदा फ्रेमवर्क्स को पार करते हैं।

- डोमेन-विशिष्ट प्रयोगों का संचालन करना ताकि मॉडल की 3D समझ और मजबूत प्राथमिकता की जांच की जा सके।

अब, स्थिर वीडियो डिफ्यूजन मॉडल लेटेंट वीडियो डिफ्यूजन मॉडल्स और डेटा क्यूरेशन तकनीकों से सीखे गए ज्ञान को अपने मूल के केंद्र में लागू करता है।

लेटेंट वीडियो डिफ्यूजन मॉडल्स

लेटेंट वीडियो डिफ्यूजन मॉडल्स या वीडियो-एलडीएमएस एक लेटेंट स्पेस में प्राथमिक जेनरेटिव मॉडल को प्रशिक्षित करने की दृष्टिकोण का पालन करते हैं जिसमें कम्प्यूटेशनल जटिलता होती है, और अधिकांश वीडियो-एलडीएमएस एक प्री-प्रशिक्षित टेक्स्ट से इमेज मॉडल को लागू करते हैं जिसमें प्री-प्रशिक्षण वास्तुकला में समयिक मिश्रण स्तर जोड़े जाते हैं। इसके परिणामस्वरूप, अधिकांश वीडियो लेटेंट डिफ्यूजन मॉडल्स या तो केवल समयिक स्तरों को प्रशिक्षित करते हैं या प्रशिक्षण प्रक्रिया को पूरी तरह से छोड़ देते हैं जैसा कि स्थिर वीडियो डिफ्यूजन मॉडल में होता है जो पूरे फ्रेमवर्क को फाइन-ट्यून करता है। इसके अलावा, टेक्स्ट से वीडियो डेटा को संश्लेषित करने के लिए, स्थिर वीडियो डिफ्यूजन मॉडल सीधे एक टेक्स्ट प्रॉम्प्ट पर स्थिति करता है, और परिणाम यह दर्शाते हैं कि परिणामी फ्रेमवर्क को आसानी से एक मल्टी-व्यू संश्लेषण या एक इमेज से वीडियो मॉडल में फाइन-ट्यून किया जा सकता है।

डेटा क्यूरेशन

डेटा क्यूरेशन स्थिर वीडियो डिफ्यूजन मॉडल के लिए एक आवश्यक घटक है, लेकिन जेनरेटिव मॉडल्स के लिए भी यह आवश्यक है क्योंकि बड़े मॉडल्स को बड़े पैमाने पर डेटासेट पर प्रशिक्षित करना आवश्यक है ताकि विभिन्न कार्यों में प्रदर्शन में सुधार किया जा सके, जैसे कि भाषा मॉडलिंग, या विवेचक टेक्स्ट से इमेज जेनरेशन, और बहुत कुछ। डेटा क्यूरेशन को जेनरेटिव इमेज मॉडल्स पर सफलतापूर्वक लागू किया गया है कुशल भाषा-इमेज प्रतिनिधित्व की क्षमताओं का लाभ उठाकर, हालांकि ऐसे चर्चाएं जेनरेटिव वीडियो मॉडल्स के विकास के लिए कभी नहीं हुई हैं। जेनरेटिव वीडियो मॉडल्स के लिए डेटा क्यूरेट करने में डेवलपर्स को कई बाधाओं का सामना करना पड़ता है, और इन चुनौतियों का सामना करने के लिए, स्थिर वीडियो डिफ्यूजन मॉडल एक तीन-चरण प्रशिक्षण रणनीति लागू करता है, जिससे बेहतर परिणाम और प्रदर्शन में महत्वपूर्ण वृद्धि होती है।

उच्च गुणवत्ता वाले वीडियो संश्लेषण के लिए डेटा क्यूरेशन

पिछले खंड में चर्चा की गई थी, स्थिर वीडियो डिफ्यूजन मॉडल एक तीन-चरण प्रशिक्षण रणनीति लागू करता है, जिससे बेहतर परिणाम और प्रदर्शन में महत्वपूर्ण वृद्धि होती है। चरण I एक इमेज प्री-प्रशिक्षण चरण है जो एक 2D टेक्स्ट से इमेज डिफ्यूजन मॉडल का उपयोग करता है। चरण II वीडियो प्री-प्रशिक्षण के लिए है जिसमें फ्रेमवर्क एक बड़ी मात्रा में वीडियो डेटा पर प्रशिक्षित होता है। अंत में, हमारे पास वीडियो फाइन-ट्यूनिंग के लिए चरण III है जिसमें मॉडल को एक छोटे सबसेट पर परिष्कृत किया जाता है जो उच्च-गुणवत्ता और उच्च-रिज़ॉल्यूशन वाले वीडियो से बना होता है।

हालांकि, स्थिर वीडियो डिफ्यूजन मॉडल इन तीन चरणों को लागू करने से पहले, यह महत्वपूर्ण है कि डेटा को संसाधित और संकेत दिया जाए क्योंकि यह चरण II या वीडियो प्री-प्रशिक्षण चरण के लिए आधार के रूप में कार्य करता है और ऑप्टिमल आउटपुट सुनिश्चित करने में एक महत्वपूर्ण भूमिका निभाता है। अधिकतम दक्षता सुनिश्चित करने के लिए, फ्रेमवर्क पहले तीन अलग-अलग एफपीएस स्तरों पर एक कैस्केडेड कट डिटेक्शन पाइपलाइन लागू करता है, और इस पाइपलाइन की आवश्यकता निम्नलिखित छवि में प्रदर्शित की जाती है।

इसके बाद, स्थिर वीडियो डिफ्यूजन मॉडल तीन अलग-अलग सिंथेटिक कैप्शनिंग विधियों का उपयोग करके प्रत्येक वीडियो क्लिप को संकेत देता है। निम्नलिखित तालिका स्थिर डिफ्यूजन फ्रेमवर्क में उपयोग किए जाने वाले डेटासेट की तुलना करती है फिल्टरेशन प्रक्रिया से पहले और बाद में।

चरण I: इमेज प्री-प्रशिक्षण

स्थिर वीडियो डिफ्यूजन मॉडल में लागू तीन-चरण पाइपलाइन का पहला चरण इमेज प्री-प्रशिक्षण है, और इसे प्राप्त करने के लिए, प्रारंभिक स्थिर वीडियो डिफ्यूजन मॉडल फ्रेमवर्क को स्थिर डिफ्यूजन 2.1 मॉडल के खिलाफ आधारित किया जाता है जो इसे मजबूत दृश्य प्रतिनिधित्व प्रदान करता है।

चरण II: वीडियो प्री-प्रशिक्षण

दूसरा चरण वीडियो प्री-प्रशिक्षण चरण है, और यह इस तथ्य पर बनाता है कि जेनरेटिव इमेज मॉडल्स में डेटा क्यूरेशन का उपयोग अक्सर बेहतर परिणामों और दक्षता में सुधार के साथ-साथ शक्तिशाली विवेचक इमेज जेनरेशन में परिणाम देता है। हालांकि, जेनरेटिव वीडियो मॉडल्स के लिए अवांछित नमूनों को फिल्टर करने के लिए ऐसे शक्तिशाली ऑफ-द-शेल्फ प्रतिनिधित्व की कमी के कारण, स्थिर वीडियो डिफ्यूजन मॉडल मानव प्राथमिकताओं को इनपुट सिग्नल के रूप में उपयोग करता है ताकि एक उपयुक्त डेटासेट बनाया जा सके जो फ्रेमवर्क को प्री-प्रशिक्षित करने के लिए उपयोग किया जाता है। निम्नलिखित आकृति दिखाती है कि एक क्यूरेटेड डेटासेट पर फ्रेमवर्क को प्री-प्रशिक्षित करने का सकारात्मक प्रभाव जो छोटे डेटासेट पर वीडियो प्री-प्रशिक्षण के लिए समग्र प्रदर्शन में सुधार करने में मदद करता है।

विशेष रूप से, फ्रेमवर्क विभिन्न तरीकों का उपयोग करके लेटेंट वीडियो डिफ्यूजन के उपसेट को क्यूरेट करता है, और एलवीडी मॉडल्स की रैंकिंग पर विचार करता है जो इन डेटासेट पर प्रशिक्षित होते हैं। इसके अलावा, स्थिर वीडियो डिफ्यूजन फ्रेमवर्क यह भी पाता है कि प्रशिक्षण के लिए क्यूरेटेड डेटासेट का उपयोग करना फ्रेमवर्क के प्रदर्शन में सुधार करने में मदद करता है, और डिफ्यूजन मॉडल्स के लिए भी। इसके अलावा, डेटा क्यूरेशन रणनीति बड़े, अधिक प्रासंगिक और अत्यधिक व्यावहारिक डेटासेट पर भी काम करती है। निम्नलिखित आकृति दिखाती है कि एक क्यूरेटेड डेटासेट पर फ्रेमवर्क को प्री-प्रशिक्षित करने का सकारात्मक प्रभाव जो छोटे डेटासेट पर वीडियो प्री-प्रशिक्षण के लिए समग्र प्रदर्शन में सुधार करने में मदद करता है।

चरण III: उच्च गुणवत्ता वाले फाइन-ट्यूनिंग

चरण II तक, स्थिर वीडियो डिफ्यूजन फ्रेमवर्क वीडियो प्री-प्रशिक्षण से पहले प्रदर्शन में सुधार पर केंद्रित होता है, और तीसरे चरण में, फ्रेमवर्क उच्च गुणवत्ता वाले वीडियो फाइन-ट्यूनिंग के बाद प्रदर्शन को अनुकूलित करने पर जोर देता है, और चरण II से चरण III में संक्रमण कैसे हासिल किया जाता है। चरण III में, फ्रेमवर्क लेटेंट इमेज डिफ्यूजन मॉडल्स से उधार ली गई प्रशिक्षण तकनीकों पर निर्भर करता है, और प्रशिक्षण उदाहरणों के रिज़ॉल्यूशन को बढ़ाता है। इस दृष्टिकोण की प्रभावशीलता का विश्लेषण करने के लिए, फ्रेमवर्क इसे तीन समान मॉडल्स के साथ तुलना करता है जो केवल उनके प्रारंभीकरण में भिन्न होते हैं। पहला समान मॉडल इसके वजन को प्रारंभीकृत करता है, और वीडियो प्रशिक्षण प्रक्रिया को छोड़ देता है, जबकि शेष दो समान मॉडल्स अन्य लेटेंट वीडियो मॉडल्स से उधार लिए गए वजन के साथ प्रारंभीकृत होते हैं।

परिणाम और निष्कर्ष

यह देखने का समय है कि स्थिर वीडियो डिफ्यूजन फ्रेमवर्क वास्तविक दुनिया के कार्यों पर कैसा प्रदर्शन करता है, और यह वर्तमान राज्य के कला फ्रेमवर्क्स के साथ कैसे तुलना करता है। स्थिर वीडियो डिफ्यूजन फ्रेमवर्क पहले ऑप्टिमल डेटा दृष्टिकोण का उपयोग करके एक बेस मॉडल को प्रशिक्षित करता है, और फिर फाइन-ट्यूनिंग करता है ताकि कई राज्य-ऑफ-द-आर्ट मॉडल्स को उत्पन्न किया जा सके, जहां प्रत्येक मॉडल एक विशिष्ट कार्य करता है।

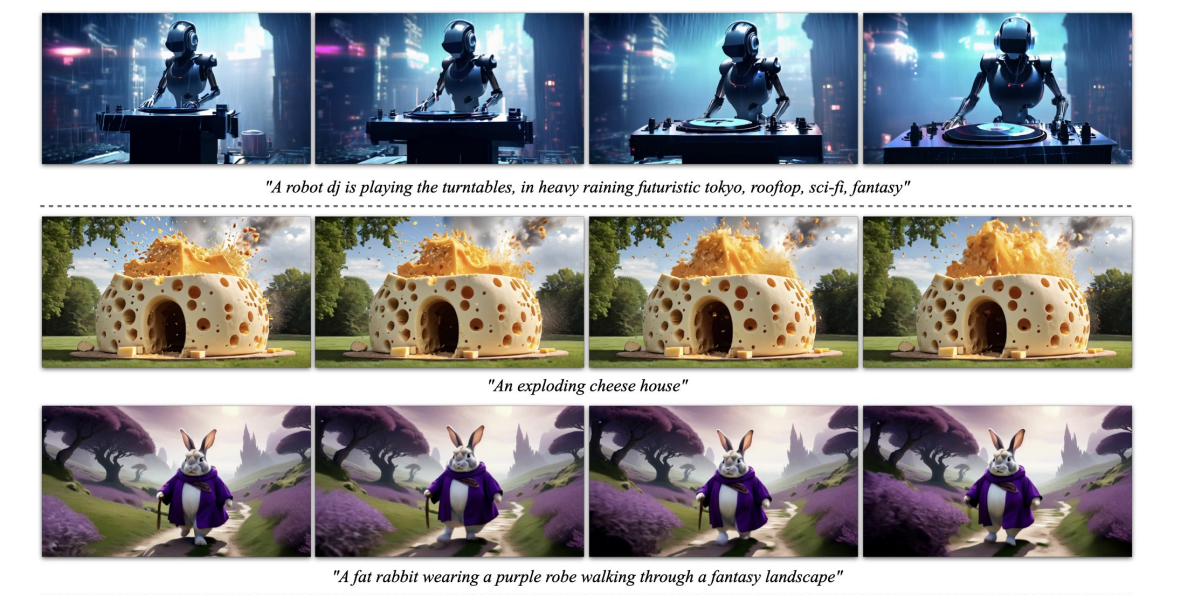

उपरोक्त छवि फ्रेमवर्क द्वारा उत्पन्न उच्च-रिज़ॉल्यूशन इमेज से वीडियो नमूनों का प्रतिनिधित्व करती है, जबकि निम्नलिखित आकृति फ्रेमवर्क की क्षमता को दर्शाती है उच्च-गुणवत्ता वाले टेक्स्ट से वीडियो नमूनों को उत्पन्न करने के लिए।

प्री-प्रशिक्षित बेस मॉडल

जैसा कि पहले चर्चा की गई थी, स्थिर वीडियो डिफ्यूजन मॉडल स्थिर डिफ्यूजन 2.1 फ्रेमवर्क पर आधारित है, और हाल के निष्कर्षों के आधार पर, यह महत्वपूर्ण था कि डेवलपर्स को शोर की अनुसूची को अपनाना और इमेज डिफ्यूजन मॉडल्स को प्रशिक्षित करने के लिए शोर को बढ़ाना था ताकि बेहतर रिज़ॉल्यूशन वाली छवियों को प्राप्त किया जा सके। इस दृष्टिकोण के कारण, स्थिर वीडियो डिफ्यूजन बेस मॉडल शक्तिशाली गति प्रतिनिधित्व सीखता है, और प्रक्रिया में टेक्स्ट से वीडियो जेनरेशन के लिए बेसलाइन मॉडल्स को पार करता है एक शून्य-शॉट सेटिंग में, और परिणाम निम्नलिखित तालिका में प्रदर्शित किए जाते हैं।

फ्रेम इंटरपोलेशन और मल्टी-व्यू जेनरेशन

स्थिर वीडियो डिफ्यूजन फ्रेमवर्क को मल्टी-व्यू डेटासेट पर फाइन-ट्यून किया जाता है ताकि एक वस्तु के कई नए दृश्य प्राप्त किए जा सकें, और इस मॉडल को एसवीडी-एमवी या स्थिर वीडियो डिफ्यूजन-मल्टी-व्यू मॉडल के रूप में जाना जाता है। मूल एसवीडी मॉडल को दो डेटासेट का उपयोग करके फाइन-ट्यून किया जाता है ताकि फ्रेमवर्क एक छवि को इनपुट के रूप में ले और एक छवि की एक श्रृंखला को आउटपुट के रूप में दे।

जैसा कि निम्नलिखित छवियों में देखा जा सकता है, स्थिर वीडियो डिफ्यूजन मल्टी-व्यू फ्रेमवर्क स्क्रैच मल्टी-व्यू फ्रेमवर्क के समान उच्च प्रदर्शन प्रदान करता है, और परिणाम स्पष्ट रूप से एसवीडी-एमवी की क्षमता को दर्शाते हैं मूल एसवीडी फ्रेमवर्क से सीखे गए ज्ञान का लाभ उठाने के लिए मल्टी-व्यू इमेज जेनरेशन के लिए। इसके अलावा, परिणाम यह भी दर्शाते हैं कि मॉडल को अपेक्षाकृत कम संख्या में पुनरावृत्तियों के लिए चलाने से ऑप्टिमल परिणाम प्राप्त करने में मदद मिलती है, जैसा कि एसवीडी फ्रेमवर्क से फाइन-ट्यून किए गए अधिकांश मॉडल्स के साथ होता है।

उपरोक्त आकृति में मेट्रिक्स बाएं हाथ की ओर संकेतित हैं और जैसा कि देखा जा सकता है, स्थिर वीडियो डिफ्यूजन मल्टी-व्यू फ्रेमवर्क स्क्रैच-एमवी और एसडी2.1 मल्टी-व्यू फ्रेमवर्क को एक अच्छे मार्जिन से पार करता है। दूसरी छवि फ्रेमवर्क के प्रदर्शन पर प्रशिक्षण पुनरावृत्तियों की संख्या के प्रभाव को दर्शाती है क्लिप स्कोर के संदर्भ में, और एसवीडी-एमवी फ्रेमवर्क स्थिर परिणाम प्रदान करते हैं।

अंतिम विचार

इस लेख में, हमने स्थिर वीडियो डिफ्यूजन के बारे में बात की है, जो एक लेटेंट वीडियो डिफ्यूजन मॉडल है जो उच्च-रिज़ॉल्यूशन, राज्य-ऑफ-द-आर्ट इमेज से वीडियो और टेक्स्ट से वीडियो सामग्री को उत्पन्न करने में सक्षम है। स्थिर वीडियो डिफ्यूजन मॉडल एक अनोखी रणनीति का पालन करता है जो किसी भी जेनरेटिव वीडियो मॉडल द्वारा पहले लागू नहीं की गई है, क्योंकि यह एक निश्चित वास्तुकला और एक निश्चित प्रशिक्षण रणनीति के साथ लेटेंट वीडियो डिफ्यूजन बेसलाइन्स पर निर्भर करता है, और फिर डेटा को क्यूरेट करने के प्रभाव का मूल्यांकन करता है।

हमने इस बारे में बात की है कि 2D छवियों के संश्लेषण के लिए प्रशिक्षित लेटेंट डिफ्यूजन मॉडल्स ने जेनरेटिव वीडियो मॉडल्स की क्षमताओं और दक्षता में सुधार किया है समयिक स्तर जोड़कर और छोटे डेटासेट पर मॉडल को फाइन-ट्यून करके जो उच्च-गुणवत्ता वाले वीडियो से बना है। हम स्थिर वीडियो डिफ्यूजन मॉडल की वास्तुकला और कार्यों में गहराई से गए और विभिन्न मीट्रिक्स पर इसके प्रदर्शन का मूल्यांकन किया और इसे वीडियो पीढ़ी के लिए वर्तमान राज्य के कला ढांचे के साथ तुलना की। तो आइए शुरू करें।

इसके अलावा, स्थिर वीडियो डिफ्यूजन फ्रेमवर्क तीन अलग-अलग वीडियो मॉडल प्रशिक्षण चरणों को लागू करता है जिन्हें स्वतंत्र रूप से उनके प्रभाव का मूल्यांकन करने के लिए विश्लेषित किया जाता है फ्रेमवर्क के प्रदर्शन पर। फ्रेमवर्क अंततः एक वीडियो प्रतिनिधित्व का उत्पादन करता है जो पर्याप्त शक्तिशाली है ताकि मॉडल्स को ऑप्टिमल वीडियो संश्लेषण के लिए फाइन-ट्यून किया जा सके, और परिणाम वर्तमान में उपयोग में आने वाले वीडियो पीढ़ी मॉडल्स के साथ तुलनीय हैं।