कृत्रिम बुद्धिमत्ता

हमारी अचेतन गहरी नकल-पता लगाने की क्षमता भविष्य की स्वचालित प्रणालियों को संचालित कर सकती है

ऑस्ट्रेलिया से नए शोध से पता चलता है कि हमारा मस्तिष्क जटिल गहरी नकल को पहचानने में कुशल है, यहां तक कि जब हम जानबूझकर मानते हैं कि हम जो छवियां देख रहे हैं वे वास्तविक हैं।

यह खोज आगे से यह संभावना को दर्शाती है कि गहरी नकल चेहरों (उनकी घोषित राय के बजाय) के लिए लोगों की तंत्रिका प्रतिक्रियाओं का उपयोग स्वचालित गहरी नकल पता लगाने वाली प्रणालियों को प्रशिक्षित करने के लिए किया जा सकता है। ऐसी प्रणालियां छवियों की गहरी नकल विशेषताओं से प्रशिक्षित की जाएंगी, न कि संभावना के भ्रमित अनुमानों से, बल्कि चेहरे की पहचान के लिए हमारी स्वाभाविक संवेदी तंत्र से।

‘[एक] हालांकि मस्तिष्क वास्तविक और यथार्थवादी चेहरों के बीच का अंतर ‘मान सकता’ है, पर्यवेक्षक वास्तविक और यथार्थवादी चेहरों के बीच का अंतर जानबूझकर नहीं बता सकते हैं। हमारे निष्कर्ष मस्तिष्क प्रतिक्रिया और व्यवहार के बीच विच्छेदन के बारे में नकली चेहरा धारणा, हम जो प्रश्न पूछते हैं जब नकली छवि पहचान के बारे में पूछते हैं, और हम नकली छवि दुरुपयोग के खिलाफ सुरक्षा मानकों को स्थापित करने के संभावित तरीकों के लिए हैं। ‘

परिणाम गहरी नकल चेहरों, कारों, आंतरिक स्थानों और उल्टे (यानी उल्टे) चेहरों की छवियों सहित झूठी छवियों के प्रति लोगों की प्रतिक्रिया का मूल्यांकन करने के लिए डिज़ाइन किए गए परीक्षणों के दौर में उभरे।

प्रयोगों के विभिन्न पुनरावृत्तियों और दृष्टिकोण, जिसमें दो समूहों के परीक्षण विषयों को एक संक्षिप्त दिखाए गए छवि को ‘नकली’ या ‘वास्तविक’ के रूप में वर्गीकृत करने की आवश्यकता थी। पहला दौर अमेज़न मैकेनिकल टर्क पर हुआ, जिसमें 200 स्वयंसेवक थे, जबकि दूसरे दौर में ईईजी मशीनों से जुड़े स्वयंसेवकों की एक छोटी संख्या शामिल थी। स्रोत: https://tijl.github.io/tijl-grootswagers-pdf/Moshel_et_al_-_2022_-_Are_you_for_real_Decoding_realistic_AI-generated_.pdf

लेख में कहा गया है:

‘हमारे परिणामों से पता चलता है कि केवल एक संक्षिप्त नज़र में, पर्यवेक्षक नकली चेहरों को पहचान सकते हैं। हालांकि, उन्हें वास्तविक चेहरों को नकली चेहरों से अलग करने में कठिनाई होती है, और कुछ मामलों में, उन्हें नकली चेहरे वास्तविक चेहरों की तुलना में अधिक वास्तविक लगते हैं।

‘हालांकि, समय-समाधान ईईजी और बहुस्तरीय पैटर्न वर्गीकरण विधियों का उपयोग करके, हमने पाया कि यह संभव था कि मस्तिष्क गतिविधि का उपयोग करके अवास्तविक और यथार्थवादी चेहरों को वास्तविक चेहरों से डिकोड किया जा सकता है।

‘यथार्थवादी चेहरों के लिए तंत्रिका प्रतिक्रिया और व्यवहार के बीच यह विच्छेदन नकली चेहरा धारणा के बारे में नए साक्ष्य प्रदान करता है, साथ ही साथ जीएन-जनरेटेड चेहरों की बढ़ती यथार्थवादी श्रेणी के लिए भी।’

लेख सुझाव देता है कि नए काम के कई निहितार्थ हैं साइबर सुरक्षा में, और गहरी नकल सीखने वाले वर्गीकरणकर्ताओं का विकास शायद ईईजी रीडिंग्स पर आधारित होना चाहिए, जो नकली छवियों के प्रति प्रतिक्रिया करते हैं, न कि दृश्य की सत्यता के बारे में दर्शक के जानबूझकर अनुमान से।

लेखकों का कहना है:

‘यह उन निष्कर्षों की याद दिलाता है कि जिन व्यक्तियों को प्रोसोपाग्नोसिया है, जो व्यवहारिक रूप से चेहरों को परिचित या अपरिचित के रूप में वर्गीकृत नहीं कर सकते हैं, फिर भी परिचित चेहरों की तुलना में अपरिचित चेहरों की तुलना में अधिक स्वायत्त प्रतिक्रिया दिखाते हैं।

‘इसी तरह, जो हमने इस अध्ययन में दिखाया है, वह यह है कि जबकि हम वास्तविक और यथार्थवादी चेहरों के बीच का अंतर तंत्रिका गतिविधि से सटीक रूप से डिकोड कर सकते हैं, वह अंतर व्यवहारिक रूप से नहीं देखा गया था। इसके बजाय, पर्यवेक्षकों ने 69% वास्तविक चेहरों को नकली होने के रूप में गलत तरीके से पहचाना।’

नई काम नाम है क्या आप वास्तविक हैं? तंत्रिका गतिविधि से यथार्थवादी एआई-जनरेटेड चेहरों को डिकोड करना, और सिडनी विश्वविद्यालय, मैक्वेरी विश्वविद्यालय, वेस्टर्न सिडनी विश्वविद्यालय और क्वींसलैंड विश्वविद्यालय के चार शोधकर्ताओं से आता है।

डेटा

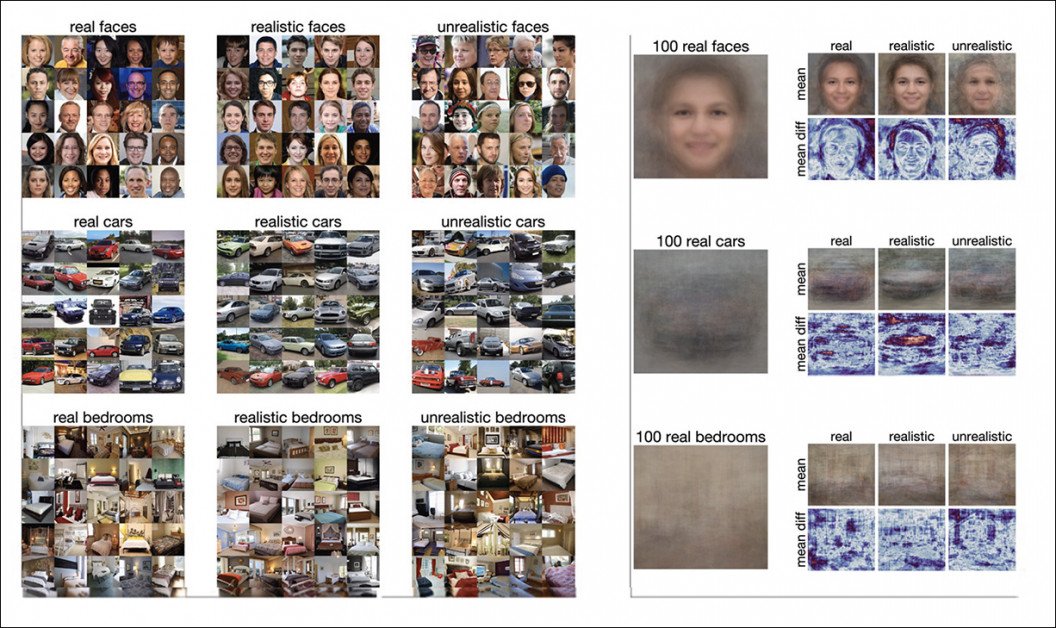

परिणाम मानव क्षमता की व्यापक जांच से उभरे जो स्पष्ट रूप से झूठे, अति-यथार्थवादी (लेकिन अभी भी झूठे), और वास्तविक छवियों के बीच अंतर करने में सक्षम हैं।

शोधकर्ताओं ने नेवीडिया द्वारा साझा की गई जेनरेटिव एडवर्सेरियल नेटवर्क (जीएन) द्वारा बनाई गई छवियों का उपयोग किया।

नेवीडिया द्वारा उपलब्ध कराई गई जीएन-जनरेटेड मानव चेहरा छवियां। स्रोत: https://drive.google.com/drive/folders/1EDYEYR3IB71-5BbTARQkhg73leVB9tam

डेटा में 25 चेहरे, कारें और बेडरूम शामिल थे, जो ‘अवास्तविक’ से लेकर ‘यथार्थवादी’ तक के प्रस्तुतीकरण स्तर पर थे। चेहरा तुलना (यानी, उपयुक्त गैर-नकली सामग्री के लिए), लेखकों ने नेवीडिया के स्रोत फ्लिकर-फेस-एचक्यू (एफएफएचक्यू) डेटासेट के स्रोत डेटा का उपयोग किया। अन्य परिदृश्यों की तुलना के लिए, उन्होंने एलएसयूएन डेटासेट से सामग्री का उपयोग किया।

छवियों को अंततः परीक्षण विषय को या तो सही तरीके से या उल्टा प्रस्तुत किया जाएगा, और विभिन्न आवृत्तियों पर, सभी छवियों को 256×256 पिक्सल तक बदल दिया जाएगा।

एक बार सभी सामग्री इकट्ठा हो जाने के बाद, 450 प्रेरक छवियों को परीक्षणों के लिए क्यूरेट किया गया।

परीक्षण

परीक्षण स्वयं पहले ऑनलाइन आयोजित किए गए थे, जसप्साइक के माध्यम से पावलोविया.org पर, 200 प्रतिभागियों ने विभिन्न उपसेटों का मूल्यांकन किया था कि लोग झूठी छवियों के प्रति कैसे प्रतिक्रिया करते हैं, जिसमें स्पष्ट रूप से नकली चेहरों, कारों, आंतरिक स्थानों और उल्टे (यानी उल्टे) चेहरों की छवियां शामिल थीं।

दूसरा और अधिक प्रकाशमय दौर में व्यक्तिगत विषय शामिल थे जो ईईजी मॉनिटर से जुड़े हुए थे, और प्साइकोपी2 प्लेटफ़ॉर्म पर प्रस्तुत किया गया था। प्रत्येक 20 अनुक्रम में 40 छवियां शामिल थीं, जिसमें पूरे परीक्षण डेटा में 18,000 छवियां प्रस्तुत की गईं।

एकत्रित ईईजी डेटा को मैटलैब के साथ कोस्मोमवपा टूलबॉक्स का उपयोग करके डिकोड किया गया था, जिसमें लीनियर डिस्क्रिमिनेंट विश्लेषण (एलडीए) के तहत एक छोड़-एक-आउट क्रॉस-वैलिडेशन योजना का उपयोग किया गया था।

एलडीए वर्गीकरणकर्ता वह घटक था जो नकली प्रेरक के लिए मस्तिष्क प्रतिक्रिया और विषय की अपनी राय के बीच अंतर करने में सक्षम था।

परिणाम

यह देखने के लिए उत्सुक कि क्या ईईजी परीक्षण विषय वास्तविक और नकली चेहरों के बीच अंतर कर सकते हैं, शोधकर्ताओं ने परिणामों को एकत्रित और प्रसंस्कृत किया, पाया कि प्रतिभागी आसानी से वास्तविक और अवास्तविक चेहरों के बीच अंतर कर सकते थे, लेकिन यथार्थवादी गहरी नकल चेहरों की पहचान करने में कठिनाई होती थी। चाहे छवि उल्टी थी या नहीं, इसका बहुत कम अंतर था।

दूसरे दौर में वास्तविक और सिंथेटिक रूप से उत्पन्न चेहरों का व्यवहारिक भेदभाव।

हालांकि, ईईजी डेटा ने एक अलग कहानी सुनाई।

लेख में कहा गया है:

‘हालांकि पर्यवेक्षकों को वास्तविक और नकली चेहरों के बीच अंतर करने में कठिनाई होती है और उन्हें नकली चेहरों को अधिक वर्गीकृत करने की प्रवृत्ति होती है, ईईजी डेटा में संकेत जानकारी शामिल थी जो इस अंतर से संबंधित थी जो यथार्थवादी और अवास्तविक के बीच अर्थपूर्ण रूप से भिन्न थी, और यह संकेत एक अपेक्षाकृत छोटे प्रसंस्करण चरण तक सीमित प्रतीत होता था। ‘

यहां ईईजी सटीकता और विषयों की रिपोर्ट की राय (यानी, चाहे चेहरा छवियां नकली थीं या नहीं) एक ही नहीं हैं, ईईजी कैप्चर वास्तविकता के करीब पहुंच रहे हैं जितना कि शामिल लोगों की स्पष्ट धारणा है।

शोधकर्ता निष्कर्ष निकालते हैं कि हालांकि पर्यवेक्षक नकली चेहरों की पहचान करने में कठिनाई हो सकती है, इन चेहरों में मानव दृश्य प्रणाली में विशिष्ट प्रतिनिधित्व होते हैं।

पाया गया विच्छेदन शोधकर्ताओं को भविष्य की सुरक्षा तंत्र के लिए उनके निष्कर्षों के संभावित अनुप्रयोग पर विचार करने के लिए प्रेरित करता है:

‘एक अनुप्रयुक्त सेटिंग जैसे साइबर सुरक्षा या डीपफेक्स में, यथार्थवादी चेहरों के लिए पता लगाने की क्षमता की जांच करना सबसे अच्छा हो सकता है तंत्रिका छवि डेटा पर लागू किए गए मशीन लर्निंग वर्गीकरणकर्ताओं का उपयोग करके, न कि व्यवहारिक प्रदर्शन को लक्षित करके। ‘

वे निष्कर्ष निकालते हैं:

‘नकली चेहरा पता लगाने के लिए मस्तिष्क और व्यवहार के बीच विच्छेदन को समझने से नकली जानकारी के संभावित रूप से हानिकारक और सार्वभौमिक प्रसार को संबोधित करने के तरीके के लिए व्यावहारिक निहितार्थ होंगे। ‘

* मेरा इनलाइन उद्धरणों को हाइपरलिंक्स में परिवर्तन।

11 जुलाई 2022 को पहली बार प्रकाशित।