कृत्रिम बुद्धिमत्ता

OLMo: भाषा मॉडलों के विज्ञान को बढ़ाना

पिछले कुछ वर्षों में भाषा मॉडलों के विकास और प्रगति ने लगभग हर जगह अपनी उपस्थिति दर्ज कराई है, न केवल एनएलपी अनुसंधान में बल्कि व्यावसायिक प्रस्तावों और वास्तविक दुनिया के अनुप्रयोगों में। हालांकि, भाषा मॉडलों के लिए व्यावसायिक मांग में वृद्धि ने एक निश्चित सीमा तक समुदाय की वृद्धि को बाधित किया है। यह इसलिए है क्योंकि राज्य-ऑफ-द-आर्ट और क्षमता वाले अधिकांश मॉडल प्रोप्राइटरी इंटरफेस के पीछे गेटेड हैं, जिससे विकास समुदाय के लिए उनके प्रशिक्षण वास्तुकला, डेटा और विकास प्रक्रियाओं के महत्वपूर्ण विवरण तक पहुंचना असंभव हो जाता है। अब यह इनकार करना असंभव है कि ये प्रशिक्षण और संरचनात्मक विवरण अनुसंधान अध्ययनों के लिए महत्वपूर्ण हैं, जिनमें उनके संभावित जोखिमों और पूर्वाग्रहों तक पहुंच शामिल है, जिससे अनुसंधान समुदाय के लिए एक वास्तविक रूप से खुले और शक्तिशाली भाषा मॉडल तक पहुंच की आवश्यकता होती है।

इस आवश्यकता को पूरा करने के लिए, डेवलपर्स ने ओएलएमओ, एक राज्य-ऑफ-द-आर्ट, वास्तव में खुला भाषा मॉडल फ्रेमवर्क बनाया है। यह फ्रेमवर्क शोधकर्ताओं को ओएलएमओ का उपयोग करके भाषा मॉडल बनाने और उनका अध्ययन करने की अनुमति देता है। अधिकांश राज्य-ऑफ-द-आर्ट भाषा मॉडल के विपरीत, जिन्होंने केवल इंटरफेस कोड और मॉडल वजन जारी किए हैं, ओएलएमओ फ्रेमवर्क वास्तव में ओपन सोर्स है, जिसमें सार्वजनिक रूप से सुलभ मूल्यांकन कोड, प्रशिक्षण विधियों और प्रशिक्षण डेटा है। ओएलएमओ का प्राथमिक उद्देश्य खुले अनुसंधान समुदाय और भाषा मॉडलों के निरंतर विकास को सशक्त बनाना और बढ़ावा देना है।

इस लेख में, हम ओएलएमओ फ्रेमवर्क के बारे में विस्तार से चर्चा करेंगे, इसकी वास्तुकला, विधि और वर्तमान राज्य-ऑफ-द-आर्ट फ्रेमवर्क की तुलना में इसके प्रदर्शन की जांच करेंगे। तो आइए शुरू करें।

ओएलएमओ: भाषा मॉडलों के विज्ञान को बढ़ाना

भाषा मॉडल ने तर्कसंगत रूप से पिछले कुछ वर्षों में सबसे गर्म प्रवृत्ति को बनाए रखा है, न केवल एआई और एमएल समुदाय के भीतर बल्कि पूरे तकनीकी उद्योग में, इसकी वास्तविक दुनिया के कार्यों को मानव जैसे प्रदर्शन के साथ करने की इसकी उल्लेखनीय क्षमताओं के कारण। चैटजीपीटी भाषा मॉडल द्वारा धारण की गई संभावनाओं का एक प्रमुख उदाहरण है, जिसमें प्रौद्योगिकी उद्योग के प्रमुख खिलाड़ी अपने उत्पादों के साथ भाषा मॉडल एकीकरण का अन्वेषण कर रहे हैं।

एनएलपी, या प्राकृतिक भाषा प्रसंस्करण, उन उद्योगों में से एक है जिसने पिछले कुछ वर्षों में व्यापक रूप से भाषा मॉडलों का उपयोग किया है। हालांकि, जब से उद्योग ने संरेखण और बड़े पैमाने पर पूर्व-प्रशिक्षण के लिए मानव अनnotation का उपयोग करना शुरू किया है, भाषा मॉडलों ने अपनी व्यावसायिक व्यवहार्यता में तेजी से वृद्धि देखी है, जिसके परिणामस्वरूप अधिकांश राज्य-ऑफ-द-आर्ट भाषा और एनएलपी फ्रेमवर्क प्रतिबंधित प्रोप्राइटरी इंटरफेस के साथ हैं, जिसमें विकास समुदाय के पास कोई पहुंच नहीं है। विटल विवरण।

भाषा मॉडलों की प्रगति सुनिश्चित करने के लिए, ओएलएमओ, एक राज्य-ऑफ-द-आर्ट, वास्तव में खुला भाषा मॉडल, डेवलपर्स को भाषा मॉडलों के विकास को आगे बढ़ाने के लिए एक फ्रेमवर्क प्रदान करता है। यह शोधकर्ताओं को इसके प्रशिक्षण और मूल्यांकन कोड, प्रशिक्षण विधि, प्रशिक्षण डेटा, प्रशिक्षण लॉग और मध्यवर्ती मॉडल चेकपॉइंट तक पहुंच प्रदान करता है। मौजूदा राज्य-ऑफ-द-आर्ट मॉडलों में विभिन्न डिग्री की खुलापन है, जबकि ओएलएमओ मॉडल ने पूरे फ्रेमवर्क को जारी किया है, प्रशिक्षण से डेटा तक मूल्यांकन उपकरण तक, जिससे राज्य-ऑफ-द-आर्ट मॉडल जैसे एलएलएएमए2 मॉडल की तुलना में प्रदर्शन में अंतर को कम किया जा सके।

मॉडलिंग और प्रशिक्षण के लिए, ओएलएमओ फ्रेमवर्क में प्रशिक्षण कोड, पूर्ण मॉडल वजन, अभिलेशन, प्रशिक्षण लॉग और प्रशिक्षण मेट्रिक्स शामिल हैं, साथ ही वेज़ एंड बायस लॉग्स के रूप में इंटरफेस कोड भी शामिल है। विश्लेषण और डेटासेट निर्माण के लिए, ओएलएमओ फ्रेमवर्क में एआई2 के डोल्मा और डब्ल्यूआईएमबीडी मॉडल के लिए उपयोग किए जाने वाले पूर्ण प्रशिक्षण डेटा के साथ-साथ प्रशिक्षण डेटा उत्पन्न करने वाला कोड भी शामिल है। मूल्यांकन के उद्देश्य से ओएलएमओ फ्रेमवर्क में डाउनस्ट्रीम मूल्यांकन के लिए एआई2 के कैटवॉक मॉडल और परिप्रेक्ष्य-आधारित मूल्यांकन के लिए पालोमा मॉडल शामिल हैं।

ओएलएमओ: मॉडल और वास्तुकला

ओएलएमओ मॉडल न्यूरल इन्फॉर्मेशन प्रोसेसिंग सिस्टम पर आधारित एक डिकोडर-ओनली ट्रांसफॉर्मर वास्तुकला को अपनाता है और 1 बिलियन और 7 बिलियन पैरामीटर के साथ दो मॉडल प्रदान करता है, जिसमें 65 बिलियन पैरामीटर मॉडल वर्तमान में विकास के अधीन है।

ओएलएमओ फ्रेमवर्क की वास्तुकला अपनी वास्तुकला में वैनिला ट्रांसफॉर्मर घटक सहित अन्य फ्रेमवर्क की तुलना में कई सुधार प्रदान करती है, जिसमें हाल के राज्य-ऑफ-द-आर्ट बड़े भाषा मॉडल जैसे ओपनएलएम, फाल्कन, एलएलएएमए और पीएलएम शामिल हैं। निम्नलिखित आंकड़ा 7बी बिलियन पैरामीटर के साथ ओएलएमओ मॉडल की तुलना लगभग समान संख्या में पैरामीटर के साथ चलने वाले हाल के एलएलएम के साथ करता है।

ओएलएमओ फ्रेमवर्क हार्डवेयर पर प्रशिक्षण के लिए ऑप्टिमाइज़ करते हुए साथ ही साथ धीमी विचलन और नुकसान के स्पाइक्स के जोखिम को कम करने के लिए हाइपरपैरामीटर का चयन करता है। कहा जा रहा है, ओएलएमओ फ्रेमवर्क द्वारा लागू किए गए प्राथमिक परिवर्तन जो इसे वैनिला ट्रांसफॉर्मर वास्तुकला से अलग बनाते हैं वे हैं:

कोई पूर्वाग्रह नहीं

फाल्कन, पीएलएम, एलएलएएमए और अन्य भाषा मॉडल के विपरीत, ओएलएमओ फ्रेमवर्क अपनी वास्तुकला में कोई पूर्वाग्रह शामिल नहीं करता है ताकि प्रशिक्षण स्थिरता में सुधार हो सके।

गैर-पैरामीट्रिक लेयर नॉर्म

ओएलएमओ फ्रेमवर्क अपनी वास्तुकला में लेयर नॉर्म का गैर-पैरामीट्रिक सूत्र लागू करता है। गैर-पैरामीट्रिक लेयर नॉर्म में कोई संबंधित रूपांतरण नहीं है, अर्थात यह कोई अनुकूली लाभ या पूर्वाग्रह प्रदान नहीं करता है। गैर-पैरामीट्रिक लेयर नॉर्म न केवल पैरामीट्रिक लेयर नॉर्म की तुलना में अधिक सुरक्षित हैं, बल्कि वे तेज भी हैं।

स्विग्लू एक्टिवेशन फंक्शन

पीएलएम और एलएलएएमए जैसे अधिकांश भाषा मॉडल की तरह, ओएलएमओ फ्रेमवर्क अपनी वास्तुकला में रीलू एक्टिवेशन फंक्शन के बजाय स्विग्लू एक्टिवेशन फंक्शन शामिल करता है और छुपी हुई सक्रियण आकार को 128 के निकटतम गुणज के लिए बढ़ाता है ताकि प्रवाह में सुधार हो सके।

रोटरी पोज़िशनल एम्बेडिंग

ओएलएमओ मॉडल एलएलएएमए और पीएलएम मॉडल का अनुसरण करते हैं और निरपेक्ष स्थितीय एम्बेडिंग के लिए रोटरी पोज़िशनल एम्बेडिंग को स्वैप करते हैं।

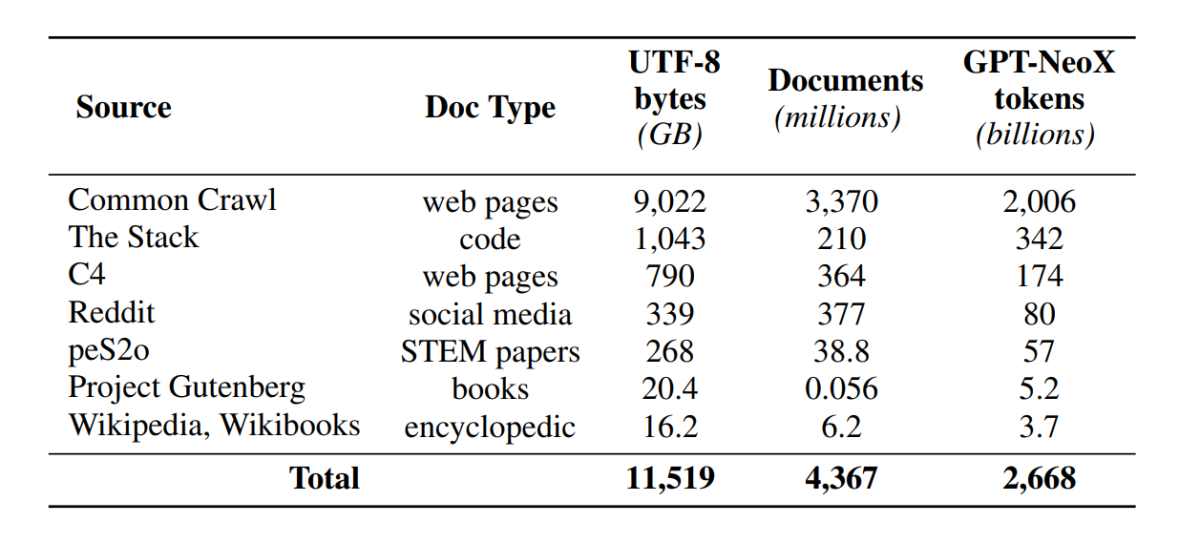

प्री-ट्रेनिंग के साथ डोल्मा

हालांकि विकास समुदाय के पास अब मॉडल पैरामीटर तक बढ़ी हुई पहुंच है, प्री-ट्रेनिंग डेटासेट तक पहुंच के द्वार अभी भी बंद हैं, क्योंकि प्री-ट्रेनिंग डेटा बंद मॉडल के साथ या खुले मॉडल के साथ जारी नहीं किया जाता है। इसके अलावा, तकनीकी दस्तावेज जो ऐसे डेटा को कवर करते हैं, अक्सर मॉडल को पूरी तरह से समझने और प्रतिकृति करने के लिए आवश्यक विवरण की कमी होती है। यह रोडब्लॉक भाषा मॉडल अनुसंधान के कुछ धागों में अनुसंधान को आगे बढ़ाने में कठिन बनाता है, जिसमें प्रशिक्षण डेटा का मॉडल की क्षमताओं और सीमाओं पर प्रभाव को समझना शामिल है। ओएलएमओ फ्रेमवर्क ने अपने प्री-ट्रेनिंग डेटासेट, डोल्मा को जारी किया है, ताकि भाषा मॉडल प्री-ट्रेनिंग पर खुले अनुसंधान को सुविधाजनक बनाया जा सके। डोल्मा डेटासेट 7 अलग-अलग स्रोतों से एकत्र किए गए 5 बिलियन दस्तावेजों में 3 ट्रिलियन टोकन का एक विविध और बहु-स्रोत संग्रह है, जो शक्तिशाली बड़े पैमाने पर एलएलएम के लिए प्री-ट्रेनिंग के लिए सामान्य रूप से उपयोग किए जाते हैं और सामान्य दर्शकों के लिए सुलभ हैं।

डोल्मा डेटासेट की रचना निम्नलिखित तालिका में सारांशित की गई है।

डोल्मा डेटासेट का निर्माण 5 घटकों की एक पाइपलाइन का उपयोग करके किया गया है: भाषा फिल्टरिंग, गुणवत्ता फिल्टरिंग, सामग्री फिल्टरिंग, मल्टी-सोर्स मिक्सिंग, डिडुप्लिकेशन और टोकनाइजेशन। ओएलएमओ ने डोल्मा रिपोर्ट भी जारी की है जो डिजाइन सिद्धांतों और निर्माण विवरण के साथ-साथ एक अधिक विस्तृत सामग्री सारांश प्रदान करती है। मॉडल ने अपने उच्च प्रदर्शन डेटा क्यूरेशन टूल्स को भी ओपन सोर्स किया है ताकि प्री-ट्रेनिंग डेटा संग्रह क्यूरेशन को आसान और तेजी से सक्षम किया जा सके। मॉडल का मूल्यांकन एक दो-चरण की रणनीति का पालन करता है, जिसमें मॉडल प्रशिक्षण के दौरान निर्णय लेने के लिए ऑनलाइन मूल्यांकन शामिल है और एक अंतिम ऑफलाइन मूल्यांकन मॉडल चेकपॉइंट से एक समग्र मूल्यांकन के लिए है। ऑफलाइन मूल्यांकन के लिए, ओएलएमओ कैटवॉक फ्रेमवर्क का उपयोग करता है, जो हमारा सार्वजनिक रूप से उपलब्ध मूल्यांकन उपकरण है जो विभिन्न डेटासेट और कार्य प्रारूपों तक पहुंच प्रदान करता है। फ्रेमवर्क डाउनस्ट्रीम मूल्यांकन के साथ-साथ हमारे नए परिप्रेक्ष्य बेंचमार्क, पालोमा पर अंतर्निहित भाषा मॉडलिंग मूल्यांकन के लिए कैटवॉक का उपयोग करता है। ओएलएमओ तब अपने निर्धारित मूल्यांकन पाइपलाइन का उपयोग करके डाउनस्ट्रीम और परिप्रेक्ष्य मूल्यांकन दोनों के लिए सार्वजनिक मॉडल की तुलना में इसकी तुलना करता है।

ओएलएमओ मॉडल आर्किटेक्चर, प्रारंभिकरण, ऑप्टिमाइज़र, लर्निंग रेट अनुसूची और प्रशिक्षण के दौरान डेटा के मिश्रण के बारे में कई मूल्यांकन मेट्रिक्स चलाता है। डेवलपर्स इसे ओएलएमओ का “ऑनलाइन मूल्यांकन” कहते हैं क्योंकि यह प्रत्येक 1000 प्रशिक्षण चरण (∼4B प्रशिक्षण टोकन) पर एक लूप में पुनरावृत्ति है ताकि मॉडल की गुणवत्ता पर एक प्रारंभिक और निरंतर संकेत मिल सके। इन मूल्यांकनों की स्थापना हमारे ऑफलाइन मूल्यांकन के लिए उपयोग किए जाने वाले अधिकांश मूल कार्यों और प्रयोग सेटिंग्स पर निर्भर करती है। ओएलएमओ का उद्देश्य न केवल ओएलएमओ-7बी को अन्य मॉडलों के साथ तुलना करना है, बल्कि यह भी दिखाना है कि यह अधिक नियंत्रित वैज्ञानिक मूल्यांकन को कैसे सक्षम बनाता है। ओएलएमओ-7बी परिप्रेक्ष्य मूल्यांकन के लिए स्पष्ट डीकंटामिनेशन के साथ सबसे बड़ा भाषा मॉडल है।

ओएलएमओ प्रशिक्षण

यह ध्यान रखना महत्वपूर्ण है कि ओएलएमओ फ्रेमवर्क मॉडल पाइरटॉर्च के माध्यम से एफएसडीपी फ्रेमवर्क द्वारा प्रदान की गई ज़ीरो ऑप्टिमाइज़र रणनीति का उपयोग करके प्रशिक्षित किए गए हैं, जिससे जीपीयू मेमोरी की खपत में काफी कमी आती है क्योंकि मॉडल वजन जीपीयू पर शार्ड किए जाते हैं। इस प्रकार, 7बी स्केल पर, प्रशिक्षण 4096 टोकन प्रति जीपीयू के साथ एक माइक्रो-बैच आकार के साथ किया जा सकता है। ओएलएमओ-1बी और -7बी मॉडल के लिए प्रशिक्षण फ्रेमवर्क एक वैश्विक रूप से स्थिर बैच आकार का उपयोग करता है, जो लगभग 4एम टोकन (2048 इंस्टेंस प्रत्येक 2048 टोकन की क्रमिक लंबाई के साथ) है। ओएलएमओ-65बी (वर्तमान में प्रशिक्षण में) के लिए, डेवलपर्स एक बैच आकार वार्मअप का उपयोग करते हैं जो लगभग 2एम टोकन (1024 इंस्टेंस) से शुरू होता है, जो प्रत्येक 100बी टोकन पर दोगुना हो जाता है जब तक कि यह लगभग 16एम टोकन (8192 इंस्टेंस) तक नहीं पहुंच जाता।

प्रवाह में सुधार के लिए, हम मिश्रित-परिशुद्धता प्रशिक्षण (मिकिकेविचस et al., 2017) का उपयोग करते हैं जो एफएसडीपी के निर्मित सेटिंग्स और पाइरटॉर्च के एएमपी मॉड्यूल के माध्यम से होता है। बाद से यह सुनिश्चित करता है कि कुछ ऑपरेशन जैसे कि सॉफ्टमैक्स हमेशा पूर्ण परिशुद्धता में चलते हैं ताकि स्थिरता में सुधार हो सके, जबकि सभी अन्य ऑपरेशन आधे-परिशुद्धता में बीफ्लोट16 प्रारूप में चलते हैं। हमारी विशिष्ट सेटिंग्स के तहत, प्रत्येक जीपीयू पर स्थानीय शार्डेड मॉडल वजन और ऑप्टिमाइज़र राज्य पूर्ण परिशुद्धता में रखे जाते हैं। ट्रांसफॉर्मर ब्लॉक के भीतर वजन को केवल तब बीफ्लोट16 प्रारूप में कास्ट किया जाता है जब पूर्ण-आकार के पैरामीटर प्रत्येक जीपीयू पर आगे और पीछे की ओर से सामग्री की जाती है। ग्रेडिएंट को पूर्ण परिशुद्धता में जीपीयू के पार से कम किया जाता है।

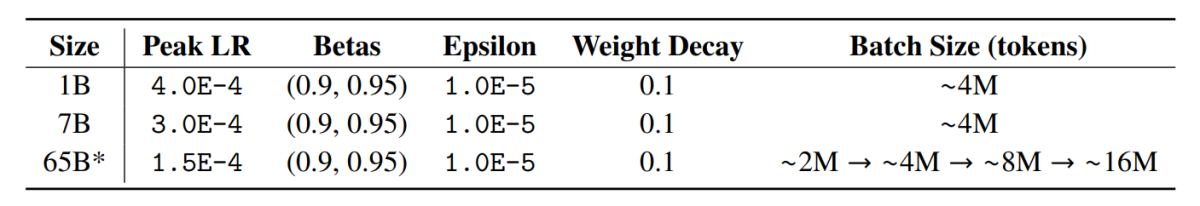

ऑप्टिमाइज़र

ओएलएमओ फ्रेमवर्क एडमडब्ल्यू ऑप्टिमाइज़र का उपयोग निम्नलिखित हाइपरपैरामीटर के साथ करता है।

सभी मॉडल आकारों के लिए, लर्निंग रेट पहले 5000 चरणों (∼21बी टोकन) पर रैखिक रूप से गर्म होता है और फिर निर्दिष्ट न्यूनतम लर्निंग रेट तक घट जाता है। गर्मअप अवधि के बाद, मॉडल ग्रेडिएंट को क्लिप करता है ताकि पैरामीटर ग्रेडिएंट का कुल ले-नॉर्म 1.0 से अधिक न हो। निम्नलिखित तालिका 7बी स्केल पर हमारी ऑप्टिमाइज़र सेटिंग्स की तुलना अन्य हाल के एलएम के साथ करती है जिन्होंने एडमडब्ल्यू का उपयोग किया है।

प्रशिक्षण डेटा

प्रशिक्षण में प्रशिक्षण उदाहरणों को वाक्य और बीपीई टोकनाइज़र द्वारा शब्द द्वारा टोकनाइज़ करना शामिल है और फिर प्रत्येक दस्तावेज़ के अंत में एक विशेष ईओएस टोकन जोड़ना और फिर 2048 टोकन के लगातार चंक्स को समूहीकृत करना ताकि प्रशिक्षण उदाहरण बन सकें। प्रशिक्षण उदाहरण प्रत्येक प्रशिक्षण रन के लिए ठीक उसी तरह से मिलाया जाता है। प्रशिक्षण बैच के डेटा का क्रम और सटीक संरचना जारी किए गए आर्टिफैक्ट से पुनर्निर्मित की जा सकती है। जारी किए गए सभी ओएलएमओ मॉडलों को कम से कम 2टी टोकन (इसके प्रशिक्षण डेटा पर एक एकल प्रकरण) तक प्रशिक्षित किया गया है, और कुछ को इसके बाद से प्रशिक्षित किया गया है जो डेटा पर एक दूसरे प्रकरण के साथ शुरू होता है जिसमें एक अलग मिलान क्रम होता है। दिया गया कि यह दोहराई गई डेटा की छोटी मात्रा होनी चाहिए, यह एक नगण्य प्रभाव होना चाहिए।

परिणाम

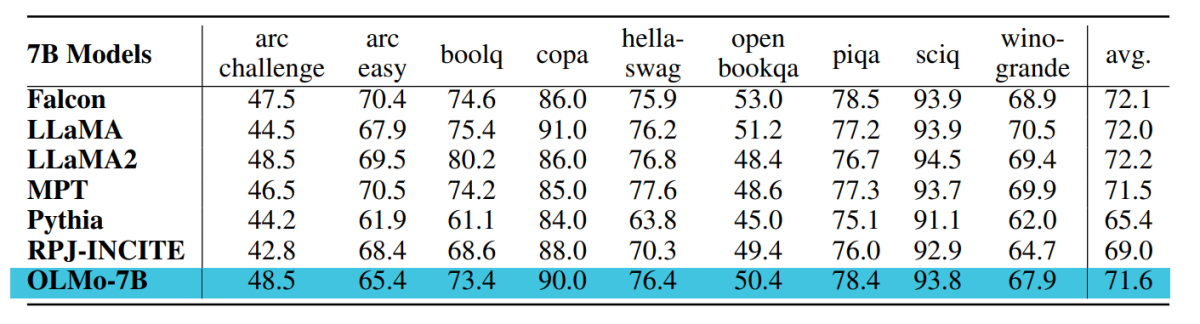

ओएलएमओ-7बी के मूल्यांकन के लिए उपयोग किया जाने वाला चेकपॉइंट डोल्मा डेटासेट पर 2.46टी टोकन तक प्रशिक्षित किया गया है जिसमें पहले उल्लिखित रैखिक लर्निंग रेट डिके है। इस चेकपॉइंट को डोल्मा डेटासेट पर 1000 कदम के लिए शून्य तक रैखिक रूप से घटते हुए लर्निंग रेट के साथ और प्रशिक्षित करने से मॉडल के प्रदर्शन में वृद्धि होती है और पहले वर्णित परिप्रेक्ष्य और अंत-कार्य मूल्यांकन सूट पर। अंतिम मूल्यांकन के लिए, डेवलपर्स ने ओएलएमओ की तुलना अन्य सार्वजनिक रूप से उपलब्ध मॉडल – एलएलएएमए-7बी, एलएलएएमए2-7बी, पाइथिया-6.9बी, फाल्कन-7बी और आरपीजे-इंकाइट-7बी के साथ की है।

डाउनस्ट्रीम मूल्यांकन

मुख्य डाउनस्ट्रीम मूल्यांकन सूट निम्नलिखित तालिका में सारांशित किया गया है।

हम शून्य-शॉट मूल्यांकन रैंक वर्गीकरण दृष्टिकोण द्वारा संचालित करते हैं। इस दृष्टिकोण में, उम्मीदवार पाठ पूर्ति (जैसे विभिन्न बहु-विकल्प विकल्प) को संभावना (आमतौर पर कुछ सामान्यीकरण कारक द्वारा सामान्यीकृत) द्वारा रैंक किया जाता है, और भविष्य कहनेवाला सटीकता रिपोर्ट की जाती है।

कैटवॉक कई पारंपरिक संभावना सामान्यीकरण विधियों का उपयोग करता है, जैसे प्रति-टोकन सामान्यीकरण और प्रति-अक्षर सामान्यीकरण, लागू की गई सामान्यीकरण रणनीतियों को प्रत्येक डेटासेट के लिए अलग से चुना जाता है और इसमें उत्तर की अनिश्चित संभावना शामिल है। अधिक विशेष रूप से, यह आरसी और ओपनबुकक्यू कार्यों के लिए कोई सामान्यीकरण नहीं है, हेलस्वाग, पीआईक्यू और विनोग्रांडे कार्यों के लिए प्रति-टोकन सामान्यीकरण है, और बूलक्यू, कोपा और स्कीक्यू कार्यों के लिए कोई सामान्यीकरण नहीं है (अर्थात कार्य एकल-टोकन भविष्यवाणी कार्य के गठन के करीब हैं)।

निम्नलिखित आंकड़ा नौ मुख्य अंत-कार्यों के लिए सटीकता स्कोर की प्रगति दिखाता है। यह निष्कर्ष निकाला जा सकता है कि सभी कार्यों के लिए सटीकता संख्या में एक सामान्य रूप से बढ़ती प्रवृत्ति है, ओबीक्यू को छोड़कर, क्योंकि ओएलएमओ-7बी को अधिक टोकन पर प्रशिक्षित किया जाता है। कई कार्यों की सटीकता में एक तेज ऊपर की ओर झटका अंतिम और दूसरे से अंतिम चरण के बीच दिखाता है कि अंतिम 1000 प्रशिक्षण चरणों पर शून्य तक रैखिक रूप से लर्निंग रेट को कम करने का लाभ है। उदाहरण के लिए, अंतर्निहित मूल्यांकन में, पालोमा विभिन्न विश्लेषणों के माध्यम से तर्क देता है, प्रत्येक डोमेन में प्रदर्शन की जांच से लेकर अधिक सारांशित परिणामों तक विभिन्न डोमेन संयोजनों पर। हम दो स्तरों पर परिणाम रिपोर्ट करते हैं: पालोमा के 18 स्रोतों में से 11 पर समग्र प्रदर्शन, साथ ही व्यक्तिगत रूप से इनमें से प्रत्येक स्रोत पर अधिक विस्तृत परिणाम।

अंतिम विचार

इस लेख में, हमने ओएलएमओ के बारे में बात की है, जो एक राज्य-ऑफ-द-आर्ट, वास्तव में खुला भाषा मॉडल है जो डेवलपर्स को भाषा मॉडलों के विकास को आगे बढ़ाने के लिए एक फ्रेमवर्क प्रदान करता है, साथ ही साथ शोधकर्ताओं को इसके प्रशिक्षण और मूल्यांकन कोड, प्रशिक्षण विधि, प्रशिक्षण डेटा, प्रशिक्षण लॉग और मध्यवर्ती मॉडल चेकपॉइंट तक पहुंच प्रदान करता है। मौजूदा राज्य-ऑफ-द-आर्ट मॉडलों में विभिन्न डिग्री की खुलापन है, जबकि ओएलएमओ मॉडल ने पूरे फ्रेमवर्क को जारी किया है, प्रशिक्षण से डेटा तक मूल्यांकन उपकरण तक, जिससे राज्य-ऑफ-द-आर्ट मॉडल जैसे एलएलएएमए2 मॉडल की तुलना में प्रदर्शन में अंतर को कम किया जा सके।