कृत्रिम बुद्धिमत्ता

कम है ज्यादा: क्यों कम दस्तावेज़ पुनर्प्राप्त करना एआई उत्तरों में सुधार कर सकता है

रिट्रीवल-ऑगमेंटेड जेनरेशन (RAG) एक ऐसा दृष्टिकोण है जो भाषा मॉडल को बाहरी ज्ञान स्रोत के साथ जोड़ती है। सरल शब्दों में, एआई पहले उपयोगकर्ता के प्रश्न से संबंधित प्रासंगिक दस्तावेज़ (जैसे लेख या वेबपेज) की खोज करता है, और फिर उन दस्तावेजों का उपयोग अधिक सटीक उत्तर उत्पन्न करने के लिए करता है। इस विधि को बड़े भाषा मॉडल (LLM) को तथ्यात्मक और हॉलुसिनेशन को कम करने में मदद करने के लिए जाना जाता है, जो उनके उत्तरों को वास्तविक डेटा में आधारित करता है।

आमतौर पर, किसी को लगता है कि जितने अधिक दस्तावेज़ एआई पुनर्प्राप्त करता है, उतना ही बेहतर इसका उत्तर होगा। हालांकि, हाल के शोध में एक आश्चर्यजनक मोड़ सामने आया है: जब एआई को जानकारी देने की बात आती है, तो कभी-कभी कम अधिक होता है।

कम दस्तावेज़, बेहतर उत्तर

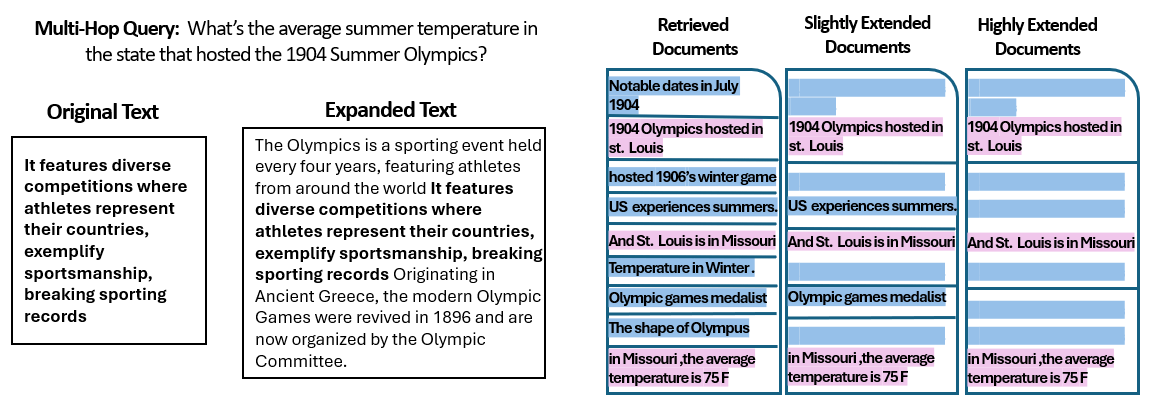

हिब्रू विश्वविद्यालय के शोधकर्ताओं द्वारा एक नई अध्ययन में यह देखा गया कि RAG प्रणाली के प्रदर्शन पर दस्तावेज़ों की संख्या का क्या प्रभाव पड़ता है। महत्वपूर्ण बात यह है कि उन्होंने कुल पाठ की मात्रा को स्थिर रखा – अर्थात, यदि कम दस्तावेज़ प्रदान किए गए थे, तो वे दस्तावेज़ थोड़े विस्तारित किए गए ताकि कई दस्तावेज़ों की तरह एक ही लंबाई हो। इस तरह, किसी भी प्रदर्शन में अंतर दस्तावेज़ों की संख्या के कारण हो सकता है, न कि केवल एक छोटे इनपुट के कारण।

शोधकर्ताओं ने एक प्रश्न-उत्तर डेटासेट (MuSiQue) का उपयोग किया, जिसमें ट्रिविया प्रश्न थे, प्रत्येक को मूल रूप से 20 विकिपीडिया अनुच्छेदों के साथ जोड़ा गया था (जिनमें से केवल कुछ में वास्तव में उत्तर था, और बाकी भ्रम पैदा करने वाले थे)। 20 से 2-4 वास्तव में प्रासंगिक लोगों तक संख्या को कम करके – और उन्हें थोड़ा अतिरिक्त संदर्भ के साथ भरकर एक सुसंगत लंबाई बनाए रखने के लिए – उन्होंने ऐसे दृश्य बनाए जहां एआई के पास कम सामग्री के टुकड़े थे, लेकिन लगभग समान कुल शब्द थे जिन्हें पढ़ना था।

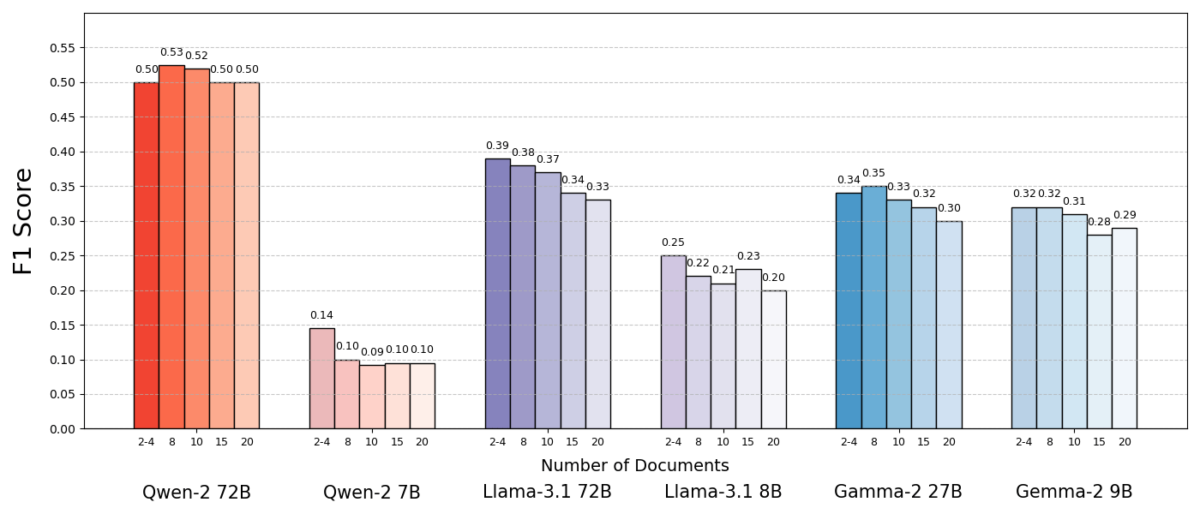

परिणाम चौंकाने वाले थे। अधिकांश मामलों में, एआई मॉडल ने अधिक सटीक रूप से उत्तर दिया जब उन्हें कम दस्तावेज़ दिए गए थे, न कि पूरे सेट के। प्रदर्शन में काफी सुधार हुआ – कुछ मामलों में 10% तक सटीकता (F1 स्कोर) में जब प्रणाली ने केवल कुछ समर्थन दस्तावेज़ों का उपयोग किया, न कि एक बड़े संग्रह का। यह विपरीत परिणाम कई अलग-अलग ओपन-सोर्स भाषा मॉडल में देखा गया, जिनमें मेटा के लामा और अन्य के संस्करण शामिल हैं, जो दर्शाता है कि यह घटना एक एकल एआई मॉडल से जुड़ी नहीं है।

एक मॉडल (Qwen-2) एक उल्लेखनीय अपवाद था जो बिना स्कोर में गिरावट के कई दस्तावेज़ों को संभाल सकता था, लेकिन लगभग सभी परीक्षण किए गए मॉडलों ने कम दस्तावेज़ों के साथ बेहतर प्रदर्शन किया। दूसरे शब्दों में, अतिरिक्त संदर्भ सामग्री जोड़ना उनके प्रदर्शन को अधिक बार नुकसान पहुंचाता था niż मदद करता था।

स्रोत: लेवी एट अल।

यह इतना आश्चर्य क्यों है? आमतौर पर, RAG प्रणालियों को इस धारणा के तहत डिज़ाइन किया जाता है कि एक व्यापक स्वाथ của जानकारी प्राप्त करना केवल एआई की मदद कर सकता है – आखिरकार, यदि उत्तर पहले कुछ दस्तावेज़ों में नहीं है, तो यह दसवें या बीसवें में हो सकता है।

इस अध्ययन ने इस स्क्रिप्ट को फ्लिप किया है, यह दिखाते हुए कि अतिरिक्त दस्तावेज़ों को बिना किसी भेदभाव के डालने से पीछे की ओर जा सकता है। यहां तक कि जब कुल पाठ की लंबाई स्थिर थी, तो कई अलग-अलग दस्तावेज़ों (प्रत्येक के साथ अपना संदर्भ और विशिष्टता) की मात्रा ही प्रश्न-उत्तर कार्य को एआई के लिए अधिक चुनौतीपूर्ण बना देती है। यह लगता है कि एक निश्चित बिंदु से परे, प्रत्येक अतिरिक्त दस्तावेज़ ने अधिक शोर पेश किया niż संकेत, मॉडल को भ्रमित करते हुए और इसकी क्षमता को कमजोर करते हुए सही उत्तर निकालने की।

RAG में कम क्यों अधिक हो सकता है

यह “कम है ज्यादा” परिणाम तब समझ में आता है जब हम विचार करते हैं कि एआई भाषा मॉडल जानकारी कैसे संसाधित करते हैं। जब एक एआई को केवल सबसे प्रासंगिक दस्तावेज़ दिए जाते हैं, तो यह संदर्भ केंद्रित और विचलित करने वाले तत्वों से मुक्त होता है, जैसे कि एक छात्र जिसे सिर्फ सही पृष्ठ दिए गए हैं जिन्हें पढ़ने की आवश्यकता है।

अध्ययन में, मॉडल ने तब बेहतर प्रदर्शन किया जब उन्हें केवल समर्थन दस्तावेज़ दिए गए थे, और अप्रासंगिक सामग्री को हटा दिया गया था। शेष संदर्भ न केवल छोटा था, बल्कि साफ भी था – यह तथ्यों को सीधे उत्तर की ओर इशारा करता था और कुछ नहीं। कम दस्तावेज़ों के साथ, मॉडल प्रासंगिक जानकारी पर अपना पूरा ध्यान केंद्रित कर सकता था, जिससे यह कम संभावना थी कि यह भटक जाए या भ्रमित हो जाए।

दूसरी ओर, जब कई दस्तावेज़ पुनर्प्राप्त किए गए, तो एआई को प्रासंगिक और अप्रासंगिक सामग्री के मिश्रण के माध्यम से छानना पड़ा। अक्सर ये अतिरिक्त दस्तावेज़ “समान लेकिन असंबंधित” थे – वे प्रश्न के विषय या कीवर्ड को साझा कर सकते थे, लेकिन वास्तव में उत्तर नहीं थे। ऐसी सामग्री मॉडल को गुमराह कर सकती है। एआई बर्बाद कर सकता है प्रयास करने में जो बिंदुओं को दस्तावेजों के माध्यम से जोड़ने की कोशिश कर रहा है जो वास्तव में एक सही उत्तर की ओर नहीं ले जाते हैं, या बदतर, यह गलत तरीके से कई स्रोतों से जानकारी को मिला सकता है। इससे हॉलुसिनेशन का जोखिम बढ़ जाता है – जहां एआई एक उत्तर उत्पन्न करता है जो सुनने में युक्तिसंगत लगता है लेकिन किसी एक स्रोत में आधारित नहीं है।

मूल रूप से, मॉडल को बहुत सारे दस्तावेज़ देने से उपयोगी जानकारी को पतला करने और विरोधाभासी विवरण पेश करने का खतरा बढ़ जाता है, जिससे एआई के लिए यह तय करना मुश्किल हो जाता है कि क्या सच है।

दिलचस्प बात यह है कि शोधकर्ताओं ने पाया कि यदि अतिरिक्त दस्तावेज़ स्पष्ट रूप से अप्रासंगिक थे (जैसे कि यादृच्छिक असंबंधित पाठ), तो मॉडल उन्हें नजरअंदाज करने में बेहतर थे। असली परेशानी तब आती है जब विचलित करने वाली डेटा दिखने में प्रासंगिक होती है: जब सभी पुनर्प्राप्त पाठ एक ही विषय पर होते हैं, तो एआई मानता है कि यह उन सभी का उपयोग करना चाहिए, और यह बताना मुश्किल हो सकता है कि कौन से विवरण वास्तव में महत्वपूर्ण हैं।

यह भी एक व्यावहारिक लाभ है: कम दस्तावेज़ पुनर्प्राप्त करने और प्रसंस्करण से RAG प्रणाली के लिए कम्प्यूटेशनल ओवरहेड कम हो जाता है। प्रत्येक दस्तावेज़ जो खींचा जाता है उसका विश्लेषण किया जाना चाहिए (एम्बेडेड, पढ़ा, और मॉडल द्वारा ध्यान दिया जाना चाहिए), जो समय और कम्प्यूटिंग संसाधनों का उपयोग करता है। अनावश्यक दस्तावेज़ों को खत्म करने से प्रणाली अधिक कुशल हो जाती है – यह तेजी से और कम लागत पर उत्तर खोज सकती है। उन दृश्यों में जहां सटीकता में सुधार हुआ, हमें एक जीत-जीत मिलती है: बेहतर उत्तर और एक पतला, अधिक कुशल प्रक्रिया।

स्रोत: लेवी एट अल।

RAG को पुनः विचार करना: भविष्य के दिशानिर्देश

पुनर्प्राप्ति में गुणवत्ता अक्सर मात्रा से बेहतर होती है, यह एक महत्वपूर्ण निष्कर्ष है जो बाहरी ज्ञान पर निर्भर एआई प्रणालियों के भविष्य के लिए महत्वपूर्ण है। यह सुझाव देता है कि RAG प्रणालियों के डिज़ाइनरों को दस्तावेज़ों की स्मार्ट फिल्टरिंग और रैंकिंग पर ध्यान केंद्रित करना चाहिए, न कि केवल मात्रा पर। इसके बजाय 100 संभावित पाराग्राफ लाने और आशा करने के बजाय कि उत्तर कहीं न कहीं छुपा है, यह बेहतर हो सकता है कि केवल शीर्ष कुछ अत्यधिक प्रासंगिक लोगों को लाया जाए।

अध्ययन के लेखकों ने जोर दिया है कि पुनर्प्राप्ति विधियों को “प्रासंगिकता और विविधता के बीच संतुलन” की आवश्यकता है जो मॉडल को जानकारी प्रदान करती हैं। दूसरे शब्दों में, हमें इतना कवरेज चाहिए कि प्रश्न का उत्तर देने के लिए, लेकिन इतना नहीं कि मूल तथ्यों को अनावश्यक पाठ में डूब जाए।

आगे बढ़ते हुए, शोधकर्ता उन तकनीकों का अन्वेषण करने की संभावना है जो एआई मॉडल को कई दस्तावेज़ों को अधिक कुशलता से संभालने में मदद करेंगे। एक दृष्टिकोण बेहतर रिट्रीवर सिस्टम या री-रैंकर्स विकसित करना है जो यह पहचान सकते हैं कि कौन से दस्तावेज़ वास्तव में मूल्य जोड़ते हैं और कौन से केवल संघर्ष पेश करते हैं। एक और दृष्टिकोण भाषा मॉडल स्वयं में सुधार करना है: यदि एक मॉडल (जैसे Qwen-2) कई दस्तावेज़ों को संभाल सकता था बिना सटीकता खोए, तो यह देखना कि यह कैसे प्रशिक्षित किया गया था या संरचित किया गया था, अन्य मॉडलों को अधिक मजबूत बनाने के लिए सुराग प्रदान कर सकता है। शायद भविष्य के बड़े भाषा मॉडल में तंत्र शामिल होंगे जो पहचानेंगे कि जब दो स्रोत एक ही बात कह रहे हों (या विरोधाभासी) और उसी के अनुसार ध्यान केंद्रित करें। लक्ष्य यह होगा कि मॉडल को विभिन्न स्रोतों का उपयोग करने की अनुमति देना – जानकारी की गहराई और फोकस की स्पष्टता दोनों का सर्वश्रेष्ठ प्राप्त करना।