Angle d’Anderson

Le Futur de la Génération d’Images Augmentée par RAG

Les modèles de diffusion génératifs comme Stable Diffusion, Flux, et les modèles de vidéos tels que Hunyuan s’appuient sur les connaissances acquises lors d’une seule session d’entraînement intensive utilisant un jeu de données fixe. Tous les concepts introduits après cet entraînement – appelés la coupure de connaissance – sont absents du modèle à moins d’être complétés par le réglage fin ou des techniques d’adaptation externes comme l’adaptation de bas rang (LoRA).

Il serait donc idéal si un système génératif pouvait accéder à des sources en ligne et les intégrer dans le processus de génération au besoin. De cette façon, par exemple, un modèle de diffusion qui ne sait rien sur les dernières sorties d’Apple ou de Tesla pourrait encore produire des images contenant ces nouveaux produits.

En ce qui concerne les modèles de langage, la plupart d’entre nous sont familiers avec des systèmes tels que Perplexity, Notebook LM et ChatGPT-4o, qui peuvent incorporer de nouvelles informations externes dans un modèle de génération augmentée par récupération (RAG).

Les processus RAG rendent les réponses de ChatGPT 4o plus pertinentes. Source : https://chatgpt.com/

Cependant, cette fonctionnalité est peu courante lorsqu’il s’agit de la génération d’images, et ChatGPT avouera ses propres limites à cet égard :

ChatGPT 4o a fait une bonne supposition sur la visualisation d’une nouvelle sortie de montre, basée sur la ligne générale et sur les descriptions qu’il a interprétées ; mais il ne peut pas « absorber » et intégrer de nouvelles images dans une génération basée sur DALL-E.

L’intégration de données externes récupérées dans une image générée est difficile car l’image entrante doit d’abord être décomposée en jetons et en embeddings, qui sont ensuite mappés sur les connaissances de domaine formées du modèle.

Bien que ce processus fonctionne efficacement pour des outils de post-formation comme ControlNet, de telles manipulations restent en grande partie superficielles, canalissant essentiellement l’image récupérée à travers un pipeline de rendu, mais sans l’intégrer profondément dans la représentation interne du modèle.

En conséquence, le modèle manque de capacité à générer de nouvelles perspectives de la manière dont les systèmes de rendu neuronal comme NeRF peuvent le faire, qui construisent des scènes avec une véritable compréhension spatiale et structurelle.

Logique Mature

Une limitation similaire s’applique aux requêtes basées sur RAG dans les grands modèles de langage (LLM), tels que Perplexity. Lorsqu’un modèle de ce type traite des données externes récupérées, il fonctionne beaucoup comme un adulte qui s’appuie sur une vie de connaissances pour inférer des probabilités sur un sujet.

Cependant, tout comme une personne ne peut pas intégrer rétroactivement de nouvelles informations dans le cadre cognitif qui a façonné sa vision du monde fondamentale – lorsque ses préjugés et préconceptions se formaient encore –, un LLM ne peut pas fusionner sans heurt de nouvelles connaissances dans sa structure préformée.

Au lieu de cela, il ne peut que « heurter » ou juxtaposer les nouvelles données contre ses connaissances internalisées, en utilisant des principes appris pour analyser et conjecturer plutôt que pour synthétiser au niveau fondamental.

Ce défaut d’équivalence entre superposé et internalisé de la génération est susceptible d’être plus évident dans une image générée que dans une génération basée sur le langage : les connexions de réseau plus profondes et la créativité accrue de la « génération native » (plutôt que basée sur RAG) ont été établies dans diverses études.

Risques Cachés de la Génération d’Images à Capacité RAG

Même si cela était techniquement réalisable d’intégrer sans heurt des images Internet récupérées dans de nouvelles synthèses dans un style RAG, des limitations liées à la sécurité présenteraient un défi supplémentaire.

De nombreux jeux de données utilisés pour la formation de modèles génératifs ont été mis au point pour minimiser la présence de contenus explicites, racistes ou violents, parmi d’autres catégories sensibles. Cependant, ce processus est imparfait, et des associations résiduelles peuvent persister. Pour atténuer cela, des systèmes comme DALL·E et Adobe Firefly s’appuient sur des mécanismes de filtrage secondaires qui écrément à la fois les invites de prompt et les sorties générées pour le contenu interdit.

En conséquence, un simple filtre NSFW – qui bloque principalement le contenu explicite – serait insuffisant pour évaluer l’acceptabilité des données RAG basées sur la récupération. Un tel contenu pourrait toujours être offensant ou préjudiciable de manière qui se situe en dehors des paramètres de modération prédéfinis du modèle, risquant d’introduire du matériel que l’IA manque de conscience contextuelle pour évaluer correctement.

La découverte d’une vulnérabilité récente dans le DeepSeek produit par le CCP, conçu pour supprimer les discussions de contenu politique interdit, a mis en évidence comment les voies d’entrée alternatives peuvent être exploitées pour contourner les garanties éthiques d’un modèle ; cela s’applique sans doute également aux données nouvelles et arbitraires récupérées sur Internet, lorsqu’elles sont destinées à être intégrées dans une nouvelle génération d’images.

RAG pour la Génération d’Images

Malgré ces défis et ces aspects politiques épineux, un certain nombre de projets ont émergé qui tentent d’utiliser des méthodes RAG pour incorporer de nouvelles données dans des générations visuelles.

ReDi

Le projet Retrieval-based Diffusion (ReDi) de 2023 est un cadre d’apprentissage sans formation qui accélère l’inférence du modèle de diffusion en récupérant des trajectoires similaires à partir d’une base de connaissances précalculée.

Des valeurs d’un jeu de données peuvent être « empruntées » pour une nouvelle génération dans ReDi. Source : https://arxiv.org/pdf/2302.02285

Dans le contexte des modèles de diffusion, une trajectoire est le chemin étape par étape que le modèle prend pour générer une image à partir de pur bruit. Normalement, ce processus se produit progressivement sur de nombreuses étapes, avec chaque étape affinant l’image un peu plus.

ReDi accélère ce processus en sautant un certain nombre de ces étapes. Au lieu de calculer chaque étape, il récupère une trajectoire similaire passée à partir d’une base de données et saute à un point plus tardif dans le processus. Cela réduit le nombre de calculs nécessaires, ce qui rend la génération d’images basée sur la diffusion beaucoup plus rapide, tout en maintenant la qualité élevée.

ReDi ne modifie pas les poids du modèle de diffusion, mais utilise plutôt la base de connaissances pour sauter les étapes intermédiaires, réduisant ainsi le nombre d’estimations de fonction nécessaires pour l’échantillonnage.

Bien sûr, ce n’est pas la même chose qu’incorporer des images spécifiques à volonté dans une demande de génération ; mais cela se rapporte à des types de génération similaires.

Publié en 2022, l’année où les modèles de diffusion latente ont capturé l’imagination du public, ReDi semble être l’une des premières approches basées sur la diffusion pour s’appuyer sur une méthodologie RAG.

Bien qu’il faille mentionner qu’en 2021, Facebook Research a publié Instance-Conditioned GAN, qui visait à conditionner les images GAN sur de nouvelles entrées d’images, ce type de projection dans l’espace latent est extrêmement courant dans la littérature, à la fois pour les GAN et les modèles de diffusion ; le défi est de rendre un tel processus sans formation et fonctionnel en temps réel, comme les méthodes RAG axées sur les LLM.

RDM

Une autre tentative précoce d’incorporer des données RAG dans la génération d’images est Retrieval-Augmented Diffusion Models (RDM), qui introduit une approche semi-paramétrique pour la synthèse d’images génératives. Alors que les modèles de diffusion traditionnels stockent toutes les connaissances visuelles apprises dans leurs paramètres de réseau neuronal, RDM s’appuie sur une base de données d’images externes :

Les plus proches voisins récupérés dans une requête pseudo-illustrative dans RDM*.

Lors de la formation, le modèle récupère les plus proches voisins (images visuellement ou sémantiquement similaires) à partir de la base de données externe, pour guider le processus de génération. Cela permet au modèle de conditionner ses sorties sur des instances visuelles du monde réel.

Le processus de récupération est alimenté par des embeddings CLIP, conçus pour forcer les images récupérées à partager des similitudes significatives avec la requête, et également pour fournir de nouvelles informations pour améliorer la génération.

Cela réduit la dépendance aux paramètres, facilitant ainsi des modèles plus petits qui réalisent des résultats compétitifs sans avoir besoin de jeux de données d’entraînement étendus.

L’approche RDM prend en charge les modifications post-hoc : les chercheurs peuvent échanger la base de données au moment de l’inférence, permettant ainsi une adaptation à zéro tir pour de nouveaux styles, domaines ou même des tâches entièrement différentes telles que la synthèse conditionnelle de classe ou la stylisation.

Dans les lignes inférieures, nous voyons les plus proches voisins tirés dans le processus de diffusion dans RDM*.

Un avantage clé de RDM est sa capacité à améliorer la génération d’images sans réentraîner le modèle. En modifiant simplement la base de données de récupération, le modèle peut généraliser à de nouveaux concepts qu’il n’a jamais été explicitement formé.

Cependant, la dépendance à la qualité et à la couverture de la base de données fait que son efficacité peut varier en fonction de la disponibilité de références de haute qualité ; et cette approche reste loin d’une équivalence de la génération d’images basée sur RAG.

ReMoDiffuse

ReMoDiffuse est un modèle de diffusion de mouvement augmenté de récupération conçu pour la génération de mouvement humain 3D. Contrairement aux modèles de génération de mouvement traditionnels qui s’appuient uniquement sur des représentations apprises, ReMoDiffuse récupère des échantillons de mouvement pertinents à partir d’un grand jeu de données de mouvement et les intègre dans le processus de débruitage, dans un schéma similaire à RDM (voir ci-dessus).

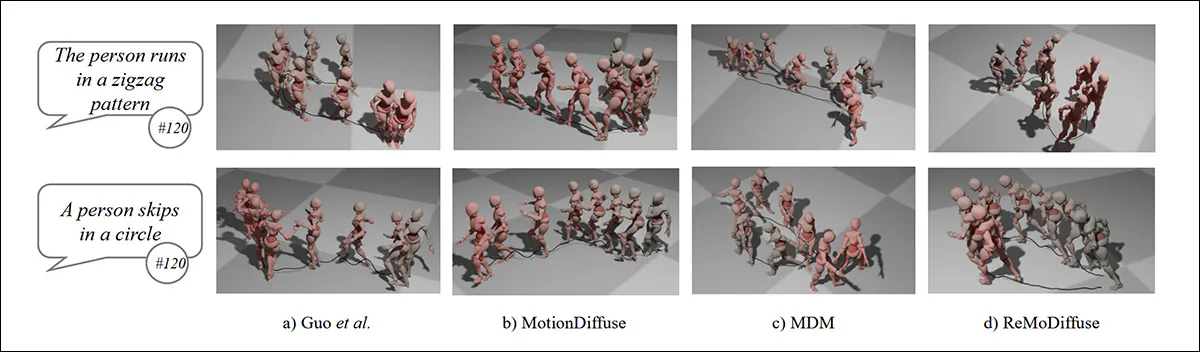

Comparaison de ReMoDiffuse à base de RAG (à droite) avec les méthodes précédentes. Source : https://arxiv.org/pdf/2304.01116

Cela permet au modèle de générer des séquences de mouvement conçues pour être plus naturelles et diverses, ainsi que sémantiquement fidèles aux invites de texte de l’utilisateur.

ReMoDiffuse utilise un mécanisme de récupération hybride innovant, qui sélectionne des séquences de mouvement en fonction à la fois de similitudes sémantiques et cinématiques, dans l’intention d’assurer que les mouvements récupérés ne sont pas seulement thématiquement pertinents mais également physiquement plausibles lorsqu’ils sont intégrés dans la nouvelle génération.

Le modèle affine ensuite ces échantillons récupérés en utilisant un transformateur modulé par sémantique, qui incorpore de manière sélective les connaissances des mouvements récupérés tout en maintenant les qualités caractéristiques de la séquence générée :

Schéma du pipeline de ReMoDiffuse.

La technique Mélange de condition du projet améliore la capacité du modèle à généraliser à travers différentes invites et conditions de récupération, en équilibrant les échantillons de mouvement récupérés avec les invites de texte pendant la génération, et en ajustant le poids que chaque source reçoit à chaque étape.

Cela peut aider à prévenir les sorties irréalistes ou répétitives, même pour des invites rares. Cela traite également du problème de sensibilité à l’échelle qui se pose souvent dans les techniques de guidage sans classe couramment utilisées dans les modèles de diffusion.

RA-CM3

Le papier de 2023 de Stanford Retrieval-Augmented Multimodal Language Modeling (RA-CM3) permet au système d’accéder à des informations du monde réel au moment de l’inférence :

Le modèle RA-CM3 de Stanford utilise des images récupérées sur Internet pour augmenter le processus de génération, mais reste un prototype sans accès public. Source : https://cs.stanford.edu/~myasu/files/RACM3_slides.pdf

RA-CM3 intègre des textes et des images récupérés dans le pipeline de génération, améliorant à la fois la synthèse d’image à partir de texte et la synthèse de texte à partir d’image. En utilisant CLIP pour la récupération et un Transformateur en tant que générateur, le modèle se réfère à des documents multimodaux pertinents avant de composer une sortie.

Les benchmarks sur MS-COCO montrent des améliorations notables par rapport à DALL-E et à des systèmes similaires, réalisant une réduction de 12 points du Fréchet Inception Distance (FID), avec un coût computationnel beaucoup plus faible.

Cependant, comme pour les autres approches de récupération augmentée, RA-CM3 n’intériorise pas sans heurt ses connaissances récupérées. Au lieu de cela, il superpose de nouvelles données contre son réseau préformé, tout comme un LLM qui augmente ses réponses avec des résultats de recherche. Bien que cette méthode puisse améliorer l’exactitude factuelle, elle ne remplace pas la nécessité de mises à jour d’entraînement dans les domaines où une synthèse profonde est requise.

De plus, une mise en œuvre pratique de ce système ne semble pas avoir été publiée, même sur une plateforme basée sur API.

RealRAG

Une nouvelle publication de Chine, et celle qui a motivé ce regard sur les systèmes génératifs à capacité RAG, s’appelle Retrieval-Augmented Realistic Image Generation (RealRAG).

Des images externes sont tirées dans RealRAG (au milieu en bas). Source : https://arxiv.o7rg/pdf/2502.00848

RealRAG récupère des images réelles d’objets pertinents à partir d’une base de données curatée à partir de jeux de données publics tels que ImageNet, Stanford Cars, Stanford Dogs, et Oxford Flowers. Il intègre ensuite les images récupérées dans le processus de génération, traitant les lacunes de connaissance du modèle.

Un composant clé de RealRAG est l’apprentissage contrastif réflexif, qui forme un modèle de récupération pour trouver des images de référence informatives, plutôt que simplement des images visuellement similaires.

Les auteurs déclarent :

« Notre idée clé est de former un récupérateur qui récupère des images qui s’écartent de l’espace de génération du générateur, mais qui se rapprochent de la représentation des invites de texte.

« Pour cela, nous générons d’abord des images à partir des invites de texte données, puis utilisons les images générées comme requêtes pour récupérer les images les plus pertinentes dans la base de données à base d’objets réels. Ces images les plus pertinentes sont utilisées comme négatifs réflexifs. »

Cette approche garantit que les images récupérées contribuent des connaissances manquantes au processus de génération, plutôt que de renforcer les préjugés existants du modèle.

À gauche, l’image de référence récupérée ; au centre, sans RAG ; à droite, avec l’utilisation de l’image récupérée.

Cependant, la dépendance à la qualité de la récupération et à la couverture de la base de données signifie que son efficacité peut varier en fonction de la disponibilité de références de haute qualité. Si une image pertinente n’existe pas dans le jeu de données, le modèle peut encore avoir du mal avec des concepts inconnus.

RealRAG est une architecture très modulaire, offrant une compatibilité avec plusieurs autres architectures génératives, y compris les modèles U-Net, DiT et autoregressifs.

En général, le traitement et la récupération d’images externes ajoutent une charge computationnelle supplémentaire, et les performances du système dépendent de la façon dont le mécanisme de récupération généralise à travers différentes tâches et jeux de données.

Conclusion

Ceci est un aperçu représentatif plutôt qu’exhaustif des systèmes génératifs multimodaux à récupération d’images. Certains systèmes de ce type utilisent la récupération uniquement pour améliorer la compréhension visuelle ou la curation de données, parmi d’autres motifs divers, plutôt que de chercher à générer des images. Un exemple est Internet Explorer.

De nombreux autres projets RAG intégrés dans la littérature restent non publiés. Les prototypes, avec uniquement des recherches publiées, incluent Re-Imagen, qui – malgré son origine chez Google – ne peut accéder qu’à des images à partir d’une base de données locale personnalisée.

De plus, en novembre 2024, Baidu a annoncé Image-Based Retrieval-Augmented Generation (iRAG), une nouvelle plateforme qui utilise des images récupérées « à partir d’une base de données ». Bien que iRAG soit supposé être disponible sur la plateforme Ernie, il n’y a pas d’autres détails sur ce processus de récupération, qui semble s’appuyer sur une base de données locale (c’est-à-dire locale au service et non directement accessible à l’utilisateur).

En outre, le document de 2024 Unified Text-to-Image Generation and Retrieval propose une autre méthode RAG pour utiliser des images externes pour augmenter les résultats au moment de la génération – à nouveau, à partir d’une base de données locale plutôt que de sources Internet ad hoc.

L’enthousiasme autour de l’augmentation RAG dans la génération d’images est susceptible de se concentrer sur les systèmes qui peuvent incorporer directement des images provenant d’Internet ou téléchargées par l’utilisateur dans le processus de génération, et qui permettent aux utilisateurs de participer aux choix ou aux sources d’images.

Cependant, cela constitue un défi important pour au moins deux raisons ; premièrement, parce que l’efficacité de tels systèmes dépend généralement de relations profondément intégrées formées pendant un processus d’entraînement intensif en ressources ; et deuxièmement, parce que des préoccupations en matière de sécurité, de légalité et de restrictions de droits d’auteur rendent cette fonctionnalité peu probable pour un service Web basé sur API, et pour un déploiement commercial en général.

* Source : https://proceedings.neurips.cc/paper_files/paper/2022/file/62868cc2fc1eb5cdf321d05b4b88510c-Paper-Conference.pdf

Publié pour la première fois mardi 4 février 2025