Angle d’Anderson

Amener les images générées par l’IA à la lumière avec HDR

Les images et les vidéos générées par l’IA peuvent être impressionnantes, mais elles ne sont pas aux normes « professionnelles » – un problème que cherche à résoudre un nouveau projet de recherche.

Dans la communauté audiovisuelle professionnelle, l’une des objections les plus fréquentes à l’intrusion de l’IA est le manque actuel de normes professionnelles de reproduction d’images et de vidéos. Pas le moins de ces normes est la capacité de travailler avec des images et des vidéos à haute gamme dynamique (HDR).

Les images HDR sont l’équivalent moderne d’une pratique photographique du 19e/20e siècle appelée bracketing, où la même photo est prise plusieurs fois avec des quantités croissantes de lumière autorisées à atteindre l’émulsion du film :

Au-dessus, une courte séquence de bracketing. En bas, à droite, la gamme dynamique élevée qui peut être extrapolée à partir de ces photos dans une seule image. Source

Dans la photographie traditionnelle, cela a abouti à plusieurs photos qui, avec une certaine expertise et un certain effort, pouvaient être composées dans une seule impression qui bénéficiait de tous les niveaux de détail disponibles dans la plage des expositions. Mais ce n’était pas un processus trivial.

Ces jours-ci, une ‘séquence d’images auto-bracketées’ peut produire soit plusieurs images, soit être combinée en une seule image HDR – effectivement, une multiplicité d’expositions en une seule image, que les applications de traitement d’images HDR telles que Photoshop peuvent parcourir et permettre au photographe d’orchestrer en une seule image de sortie idéale.

Si vous vous demandez pourquoi vous devriez vous en soucier, ou comment cela affecte votre propre photographie, l’illustration de cet article vise à démontrer cela de manière familière :

Au-dessus, à gauche, nous voyons un exemple typique d’une image sRGB (c’est-à-dire non-HDR). Le simple fait de la rendre plus claire (montré à droite) ne montre pas le monstre dans le placard, car ce détail a été supprimé lorsque le photographe et les processus automatisés de l’appareil photo ont décidé de ce qui devait être prioritaire dans la photo :

En bas, à gauche, nous voyons une indication de la façon dont le premier plan serait « lavé » au moment de l’exposition pour enregistrer le monstre dans le placard dans une photo non-HDR, et (à droite) de la façon dont le monstre est plongé dans l’obscurité lorsque l’exposition est faite pour les sujets du premier plan bien éclairés :

En bas, nous voyons le type de détail qui peut être « sauvé » à partir d’une image ou d’une séquence HDR. Dans ce cas, le monstre se « cachait » dans les registres visuels les plus bas de la séquence HDR, dans un niveau où le reste du contenu aurait été « surexposé » en blanc presque pur (au-dessus, à gauche). En spécifiant qu’une large gamme de niveaux de luminosité devait être exprimée, de manière sélective, dans la même image, ces éléments dissonants peuvent être composés en une seule image rationnelle :

Une image non-HDR est connue sous le nom d’image référée à l’affichage, et une image HDR à large gamut est connue sous le nom d’image référée à la scène.

La vidéo HDR est également une chose, et ce type de polyvalence et de ductilité tonale donne vraiment aux cinéastes une certaine latitude pour sauver, grader et interpréter les rushes de manière créative et cohérente ; il n’est donc pas surprenant que les créatifs soient réticents à travailler avec la sortie sRGB « aplatie » typique de la plupart des cadres génératifs AI.

HDR dans l’IA

Naturellement, la scène de la recherche s’intéresse à amener les cadres générés par l’IA à l’ère HDR. Cependant, ce n’est pas une tâche triviale, à la fois en raison de l’architecture fondamentale des systèmes génératifs de diffusion et parce que de bonnes données HDR prennent beaucoup d’espace disque, ce qui rend les collections ingérables ; par conséquent, les ensembles de données adaptés à la tâche sont rares.

Néanmoins, une collaboration entre une université de Singapour et Adobe Research propose une méthode de production de séquences d’images HDR, dans une méthodologie qui peut théoriquement être appliquée à la vidéo ainsi qu’aux images fixes :

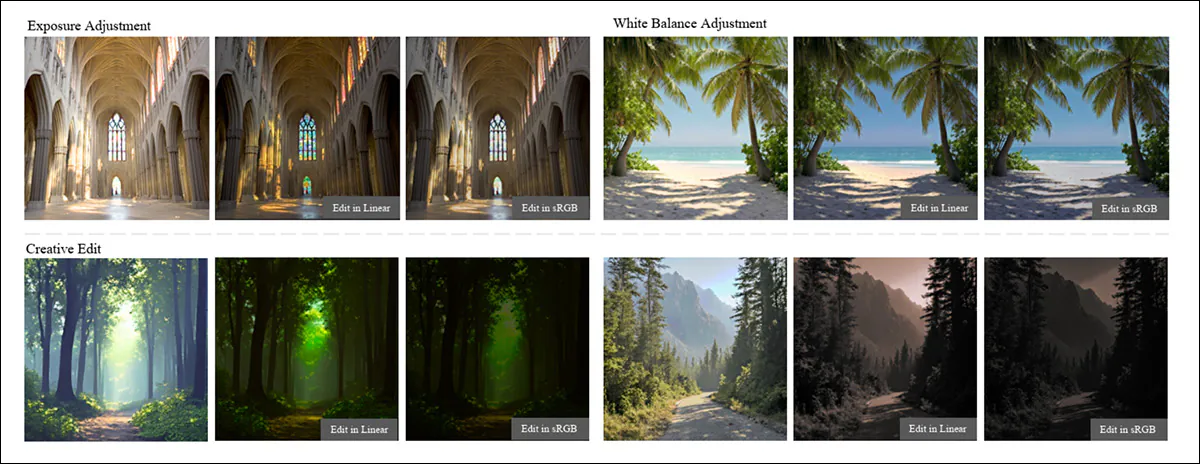

Du site du projet pour le nouveau travail, des exemples de sortie d’image texte-à-image « bracketées ». Source

Le nouveau système génère plusieurs versions alignées de la même image à différents niveaux de luminosité et apprend à quel point la scène est vraiment lumineuse, puis les combine en un seul résultat qui conserve les détails à la fois dans les ombres et les hautes lumières, permettant aux éditions ultérieures de l’exposition ou de la couleur de se comporter plus comme des ajustements à une capture de caméra réelle, plutôt que comme des ajustements fragiles à une image entièrement traitée.

Le système utilise une diversité de modèles différents pour la tâche, notamment des variantes de Qwen et Flux :

Des exemples du nouveau document, montrant comment le système peut générer plusieurs versions d’exposition de la même scène tout en conservant la structure sous-jacente fixe. À partir d’une simple carte de bord, le modèle produit des images cohérentes sur des réglages très sombres à très lumineux, que la invite décrit la lumière de la lune, la lumière du soleil, le coucher de soleil ou même un petit objet comme un ballon, avec le sujet et la composition restant stables alors que seule la lumière change. La méthode peut varier la luminosité d’une manière contrôlée, comme une caméra, plutôt que de dériver ou d’inventer de nouveaux contenus à mesure que l’exposition change. Source

Les auteurs déclarent :

‘Générer des images linéaires est difficile, car les VAE pré-entraînés dans les modèles de diffusion latente ont du mal à préserver à la fois les hautes lumières et les ombres extrêmes en raison de la gamme dynamique et de la profondeur de bits plus élevées.

‘À cette fin, nous représentons une image linéaire comme une séquence de crochets d’exposition, chacun capturant une partie spécifique de la gamme dynamique, et proposons une architecture de correspondance de flux basée sur DiT pour la génération de crochets d’exposition conditionnée par le texte.

‘Nous démontrons en outre des applications en aval, notamment l’édition d’images linéaires guidée par le texte et la génération conditionnée par la structure via ControlNet.’

Le nouveau travail est intitulé Génération d’images linéaires par synthèse de crochets d’exposition, et provient de quatre auteurs à travers S-Lab à Nanyang Technological University, Adobe NextCam et Adobe Research. Outre la page du projet et la vidéo YouTube associée à la publication, il existe également un dépôt GitHub (actuellement peu fourni) et la promesse d’une publication de données.

Bien que les auteurs fournissent de nombreux exemples de sortie du système sur la page du projet, les lecteurs devront disposer d’un moniteur HDR pour vraiment distinguer les caractéristiques de la sortie HDR présentée. Néanmoins, veuillez trouver la présentation YouTube des chercheurs à la fin de cet article – mais soyez conscient que les différences entre les exemples présentés peuvent ne pas être claires sur un moniteur non-HDR.

Méthode et données

Les auteurs soulignent l’étendue à laquelle la collecte de données est un défi dans cette poursuite particulière :

‘Acquérir un grand nombre d’images linéaires est extrêmement difficile en pratique. De plus, la plupart des ensembles de données HDR publics sont soit panoramiques (se concentrant ainsi presque exclusivement sur le contenu de scène à grande échelle), soit ne fournissent pas d’images linéaires réelles, les rendant inadaptés à nos fins.

‘Par conséquent, nous utilisons principalement des ensembles de données d’images RAW comme base pour la formation.’

Les chercheurs ont fait un usage créatif des quelques options à leur disposition, en utilisant l’ensemble de données RAISE comme données de formation réelles, et l’ensemble de données MIT-Adobe FiveK comme données d’évaluation*.

Pour construire des données de formation HDR utilisables, les chercheurs ont passé les fichiers de caméra RAW à travers un pipeline standardisé pour éliminer les particularités spécifiques à la caméra, en convertissant les images dans un format linéaire cohérent et référé à la scène :

Schéma du flux de travail des auteurs : le système commence à partir de bruit représentant quatre niveaux d’exposition de la même scène, ainsi que d’une invite de texte et d’un jeton de luminosité. Cela est ensuite traité à travers des blocs de transformateur empilés qui maintiennent les différentes expositions alignées, tout en ajustant la lumière. Le système prédit ensuite à la fois l’ensemble d’images d’exposition, ainsi qu’une échelle de luminosité globale, et les combine ensuite en une seule image référée à la scène, en conservant les détails à la fois dans les ombres et les hautes lumières.

Cela a impliqué la reconstruction de la pleine RGB à partir des données du capteur, l’application d’une correction de couleur, la normalisation de la balance des blancs et un bref passage dans un espace de couleur perceptive pour le débruitage avant de revenir à un signal linéaire propre. La lumière réelle de la scène a ensuite été récupérée à l’aide des paramètres d’exposition de la caméra, de sorte que chaque pixel reflète la luminosité réelle plutôt qu’une approximation prête à l’affichage.

Puisque de telles valeurs peuvent varier considérablement, les données ont ensuite été stabilisées en rééchelonnant chaque image en fonction de sa propre distribution de luminosité, en utilisant les statistiques de milieu et de hautes lumières pour éviter à la fois les images surexposées et les hautes lumières surexposées, obtenant finalement une image linéaire normalisée qui conserve la véritable gamme de lumière de la scène, tout en restant suffisamment stable pour la formation.

Les étiquettes de texte pour les images ont ensuite été créées avec le modèle Qwen2.5-VL 7B, avec des invites conçues pour correspondre aux caractéristiques du modèle Flux qui seraient utilisées au moment de la génération.

Chaque image a été divisée en « tranches » d’exposition et passée à travers un encodeur VAE partagé, en convertissant toutes les expositions dans un espace latent commun conçu pour capturer la pleine gamme de luminosité. Les latents ont ensuite été raffinés à partir de bruit et décodés en images, permettant une reconstruction cohérente à travers les régions sombres et lumineuses, sans les faire s’effondrer en une seule exposition « aplatie ».

La finetuning LoRA a été utilisé pour adapter le modèle Flux pré-entraîné aux données d’images linéaires avec un minimum de paramètres supplémentaires, aidant le modèle de transformateur de diffusion unique (single-DiT) à rester stable, même lorsque la luminosité varie à travers les crochets d’exposition.

L’attention auto-modulation d’exposition (colonne centrale dans l’illustration du schéma ci-dessus) a été introduite pour traiter conjointement toutes les expositions, permettant à la luminosité d’être ajustée par exposition tout en maintenant la structure et les détails fins alignés.

L’intégration de position rotative 3D (3D-R[o]PE) a été utilisée pour encoder à la fois la position spatiale et l’identité d’exposition, de sorte que le modèle puisse distinguer à quelle exposition chaque jeton appartenait, tout en préservant la cohérence spatiale, permettant une séparation nette de la variation de luminosité du contenu de la scène.

Un aperçu de l’ensemble de données utilisé dans l’étude, montrant comment les images sont réparties sur les types de contenu et les scènes intérieures et extérieures, ainsi que la répartition des valeurs de luminosité dans les données traitées. Les histogrammes tracent la luminance et l’échelle de rayonnement dans l’espace log, illustrant à quel point la luminosité du monde réel peut varier, avec des valeurs de rayonnement plus élevées correspondant à des scènes physiquement plus lumineuses et mettant en évidence la forte gamme dynamique que le modèle est formé pour gérer.

3D-RoPE a séparé où une fonction se trouvait et « d’où vient l’exposition » en signaux distincts, de sorte que la variation de luminosité puisse être ajustée de manière indépendante, sans corrompre les détails spatiaux.

Tests

Les chercheurs ont utilisé Flux-dev comme cadre génératif, avec une formation sur quatre GPU NVIDIA A100, chacun avec 80 Go de VRAM. La taille de lot a été fixée à 4 (par GPU), sur 10 000 itérations.

La finetuning LoRA a utilisé un rang de 64. L’optimiseur AdamW a été utilisé à un taux d’apprentissage de 2×102 (pour l’aspect de modulation d’exposition).

Les auteurs notent que bien qu’il existe deux travaux antérieurs similaires en portée, aucun n’était un candidat évident pour une phase de test. Le travail mené par Max Planck en 2022 GlowGAN est limité à la génération de catégories d’images spécifiques, tandis que Bracket Diffusion (encore une fois, mené par l’Institut Max Planck) en 2025 ne peut générer qu’une image HDR à 256x256px et prend plusieurs minutes pour le faire :

Du document original GlowGAN, des images LDR typiques perdent des détails dans les ombres et les hautes lumières, tandis que le modèle apprend à produire des versions HDR qui conservent les détails sur les niveaux de luminosité et permettent la récupération des régions saturées via le mappage de tonalité inverse. Source

Par conséquent, en l’absence de lignes de base directes pour la génération d’images linéaires, les auteurs ont comparé leur méthode avec des versions adaptées de modèles existants, plutôt que des alternatives conçues à cet effet.

Un ensemble d’expériences (‘T2I Fine-Tuning’) a affiné le modèle de diffusion d’image-à-texte Flux en utilisant LoRA, en le formant pour générer des images linéaires directement, et en évaluant comment un modèle T2I de pointe s’adapte à ce domaine.

Une deuxième comparaison (‘T2V fine-tuning’) a utilisé le modèle d’image-à-vidéo Wan 2.1, dont le VAE compressait plusieurs cadres en une représentation latente partagée ; dans ce cadre, quatre crochets d’exposition ont été codés dans une représentation latente unique, et ensuite décodés, en testant si un pipeline de type vidéo pouvait modéliser la variation d’exposition.

Le troisième ensemble d’expériences (‘T2I Model Inflation’) a comparé avec CameraCtrl et Generative Photography, qui étendent tous deux les modèles de diffusion d’images via des modules temporels, pour produire des sorties multi-cadres. Ceux-ci ont également été affinés sur les mêmes données, pour une comparaison cohérente.

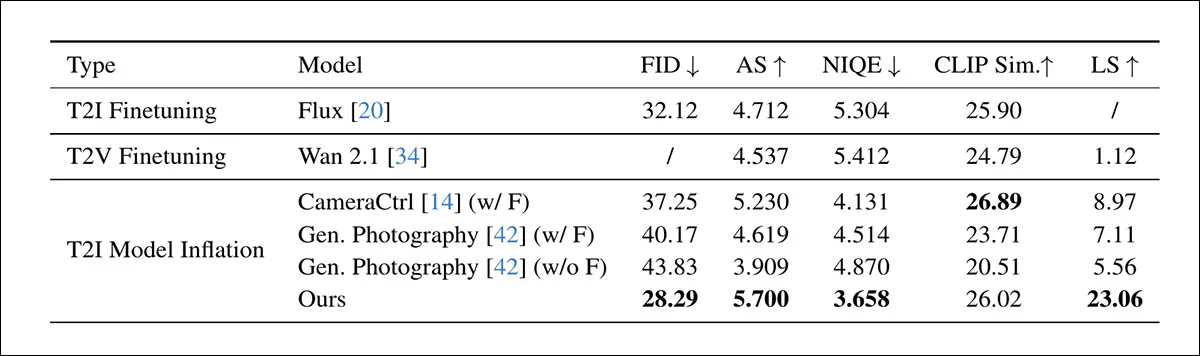

Les métriques utilisées étaient Fréchet Inception Distance (FID) ; Aesthetic Score (AS) ; Naturalness Image Quality Evaluator (NIQUE) ; CLIP Sim score ; et Similarité de luminosité (LS) :

Une comparaison de la méthode des auteurs avec plusieurs lignes de base adaptées pour générer des images linéaires référées à la scène. Les modèles d’image-à-texte (Flux) et d’image-à-vidéo (Wan 2.1) sont affinés avec LoRA pour tester comment les systèmes génératifs existants gèrent ce paramètre, tandis que CameraCtrl et Generative Photography étendent les modèles de diffusion avec des composants temporels. Certains scores sont manquants, car certains modèles ne peuvent pas produire de manière fiable des crochets d’exposition cohérents, qui sont nécessaires pour récupérer la pleine gamme dynamique. Sur les métriques rapportées, la nouvelle méthode obtient les résultats les plus forts dans l’ensemble, en particulier sur les mesures liées à la qualité de l’image et à la reconstruction précise de la luminosité.

En ce qui concerne ces résultats, les auteurs déclarent :

‘En raison de la large distribution des images linéaires, l’affinage direct du modèle T2I sur des données linéaires rend difficile l’équilibre entre les détails des ombres et des hautes lumières. Les méthodes d’inflation du modèle T2I souffrent à la fois d’une gamme dynamique limitée et d’une dégradation significative de la qualité de l’image, même après affinage.’

‘Pour l’affinage T2V, la compression temporelle 4× de Wan 2.1 entrelace les quatre crochets d’exposition en une représentation latente unique, provoquant un déséquilibre de distribution important qui ne peut pas être résolu par affinage seul. ‘

‘En modélisant directement les propriétés référées à la scène à l’aide de crochets d’exposition, notre méthode atteint une qualité visuelle et une gamme dynamique supérieures à toutes les lignes de base.’

Une comparaison avec Flux et Wan 2.1 affinés avec LoRA, illustrant comment chaque méthode gère les changements d’exposition sur les mêmes scènes. Les approches concurrentes ont tendance à perdre des détails dans les régions très sombres ou très lumineuses, tandis que la méthode proposée maintient une structure cohérente et récupère des détails utilisables sur toute la plage d’expositions. Veuillez vous référer au document source et au site du projet pour de meilleurs exemples de résultats.

Veuillez vous référer à la section d’expériences étendues et de matériaux supplémentaires du document source pour d’autres tests.

Conclusion

Pour les professionnels des médias, tels que ceux qui travaillent dans la production de films et de télévision, la même sortie qui a capturé l’imagination (et, de plus en plus, l’ire) du monde les a laissés indifférents, puisque presque toutes leurs pipelines dépendent d’une manière ou d’une autre de captures HDR.

Par conséquent, ce projet est opportun, représentant une fonctionnalité qui devrait devenir une norme facultative dans les nouveaux cadres – même s’il est certain de doubler au moins les temps de rendu ; clairement, également, la latence devra être sérieusement abordée si le contenu AI HDR n’est pas relégué à la catégorie « en post-production » plutôt qu’« en caméra ».

* Normalement, nous montrerions des exemples, mais puisque le lecteur peut ne pas disposer d’un moniteur HDR, nous omettons ceux-ci dans ce cas.

Publié pour la première fois dimanche 26 avril 2026