Angle d'Anderson

Loin des yeux, loin du cœur : s’attaquer au plus grand problème de la vidéo en IA

Le plus gros problème, même avec les meilleurs générateurs vidéo IA, est leur amnésie chronique – un défi que de nouvelles recherches menées en Chine s'attaquent actuellement à.

Le principal problème, même avec les systèmes de génération vidéo par IA les plus performants et les plus modernes, est qu'ils ont tous amnésie chroniqueSi la caméra s'éloigne de son point de mire puis revient sur celui-ci, elle ne retrouvera jamais ce qui était là au début : les personnages auront disparu, leur apparence et/ou leur type de mouvement auront changé, et l'arrière-plan aura probablement lui aussi changé.

Cela s'explique par le fait que le système de génération par diffusion possède une capacité de roulement limitée. fenêtre d'attentionet parce qu'il s'agit toujours de ce qu'il peut voir à ce moment-là; dans une véritable mise en œuvre de solipsisme, quel est au contrôle Le cadre est inexistant pour l'IA générative – il est littéralement effacé de la mémoire.

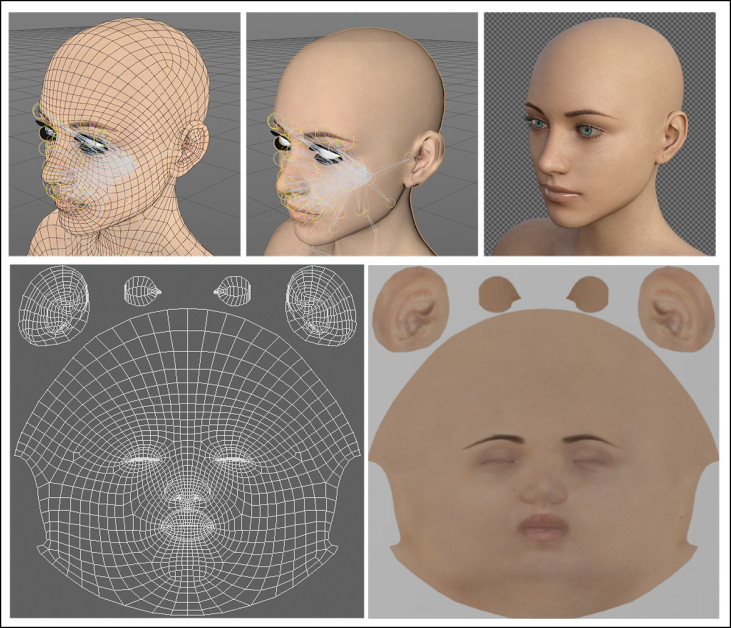

Cela a Cela n'a jamais posé de problème dans les images de synthèse traditionnelles., qui peuvent toujours faire référence à un sujet et le recréer avec précision, y compris son apparence et son mouvement, à n'importe quel moment d'une vidéo rendue où ils pourraient être nécessaires à nouveau :

Les maillages CGI traditionnels et les textures bitmap peuvent toujours être réintégrés dans un rendu, offrant une apparence cohérente – une astuce beaucoup plus difficile à réaliser avec les approches d'IA, car il n'existe pas de fichier de « référence plate » équivalent, ni de collection de fichiers associés.

En effet, les éléments constitutifs des CGI, tels que le maillage et les textures (voir image ci-dessus), ainsi que les fichiers de mouvement et autres comportements dynamiques, peuvent résider discrètement sur le disque et être dessinés dans une composition à tout moment.

Il n'existe pas de « référentiel plat » de ce type dans l'IA vidéo générative ; la fonctionnalité la plus proche qu'elle puisse offrir est LoRA – des fichiers auxiliaires spécialement formés, pouvant être entraînés sur des équipements grand public, permettant de créer de nouveaux personnages et des vêtements spécifiques être « forcé » à participer à la vidéo:

Cliquez pour jouer. Le problème de solipsisme des vidéos IA peut être atténué dans une certaine mesure par l'utilisation de LoRA, mais les résultats peuvent être accablants.

Ce n'est toutefois pas une solution idéale. D'une part, les LoRA sont liées à une version spécifique d'un modèle de base (comme Wan2+, ou Vidéo Hunyuan), Et besoin de recréer à chaque modification du modèle de base. Par ailleurs, les LoRA ont tendance à déformer les poids du modèle de base, de sorte que l'identité apprise de la LoRA soit imposée à tous les personnages d'une scène. De plus, réglage fin des méthodes de ce genre sont très sensible aux ensembles de données mal organisés.

Encores précis

Une nouvelle collaboration entre le monde universitaire et l'industrie en provenance de Chine propose la première solution significative dont j'ai eu connaissance en plus de trois ans de reportages sur ce sujet. La méthode utilise ce que les chercheurs appellent… mémoire hybride pour que les personnages hors champ et leur environnement immédiat restent actifs et précis dans le espace latent du modèle, de sorte que lorsque notre point de vue revient à eux, l'effet soit cohérent :

Cliquez pour jouer. Sur le site du projet du nouvel article, deux exemples de caractères générés par l'IA (WAN) sortant du cadre et y entrant avec précision. Source

Il convient de souligner que cela ne signifie pas nécessairement atteindre un objectif. cohérence des caractères sur différents plans – chose qui aurait été réalisée. il y a un an dans la version Gen 4 de Runway, et qui reste an en cours poursuite dans la littérature de recherche.

En réalité, ce qui est résolu ici, c'est quelque chose qu'aucun cadre commercial ou expérimental que j'ai vu n'a été capable de réaliser – le réapparition visuellement cohérente de l'apparence, des mouvements et de l'environnement antérieurs d'un personnage hors champ :

Cliquez pour jouer. Les deux autres exemples principaux sont présentés sur le site web du projet de la nouvelle initiative.

Bien entendu, les principes à l'œuvre ici peuvent également s'appliquer à d'autres domaines, tels que l'exploration urbaine, la conduite en vue subjective ou d'autres types de rendus sans personnages.

Il convient également de souligner que cette nouvelle approche ne résout ni n'aborde le problème que Runway Gen4 et d'autres plateformes à code source fermé prétendent avoir résolu en recréant les personnages. à travers différentes prises de vue; au contraire, elle réussit là où aucune d'entre elles n'a encore réussi : à faire perdurer un personnage et son environnement dans la mémoire, sans qu'ils aient besoin de rester visibles pour le spectateur en permanence.

Le nouveau travail comprend un ensemble de données dédié généré par Unreal Engine, ainsi que des métriques personnalisées pour le problème du solipsisme*, et un cadre génératif sur mesure construit sur un réseau étendu (WAN). Lors de tests comparatifs avec les quelques systèmes analogues disponibles, les auteurs affirment obtenir des résultats à la pointe de la technologie et commentent :

« Les mécanismes [de mémoire] sont apparus comme une frontière essentielle dans l'avancement des modèles du monde, car la capacité de mémoire dicte la cohérence spatiale et temporelle du contenu généré. »

« Plus précisément, c’est l’ancrage cognitif qui permet au modèle de conserver le contexte historique lors de changements de point de vue ou d’extrapolations à long terme. »

« Sans une mémoire robuste, un monde simulé se désagrège rapidement en cadres déconnectés et chaotiques. »

L'espace nouveau papier est intitulé Loin des yeux, mais pas loin du cœur : mémoire hybride pour les modèles dynamiques du monde vidéo, et provient de sept chercheurs de l'Université des sciences et technologies de Huazhong et de l'équipe Kling de Kuaishou Technology.

Méthode

La planche centrale de la nouvelle œuvre est mémoire hybride, ce qui facilite « l'extrapolation hors champ » – la conservation des personnages et de leur contexte lorsque le spectateur « détourne le regard » (ou lorsque le personnage lui-même sort du champ de vision). Dans ce scénario, le système doit effectuer découplage spatio-temporel, où elle se concentre simultanément sur la génération visible par le spectateur et sur l'existence hors écran du personnage désormais hors champ.

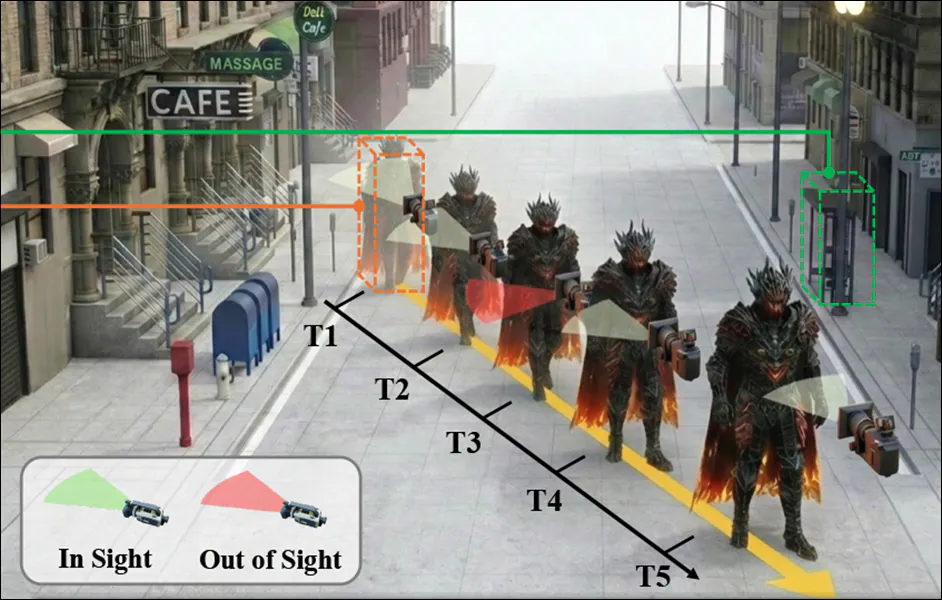

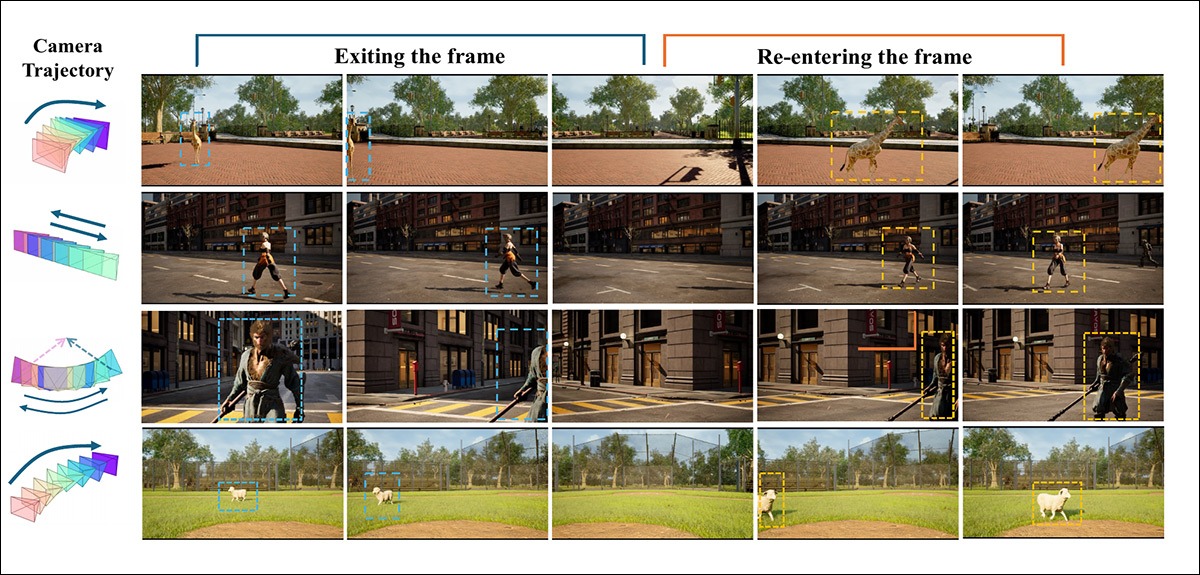

Exemples de mouvements de caméra en entrée/sortie. Dans ces cas, c'est le mouvement de la caméra qui fait sortir le personnage du cadre, mais dans certains exemples, on peut aussi observer le personnage se propulser temporairement hors de l'écran. Source

Les auteurs notent que dans la diffusion latente plongementsLes fonctionnalités à extraire et à utiliser sont fortement… enchevêtré avec d'autres caractéristiques et propriétés ; et que tenter de les extraire a souvent pour conséquence de « figer » le sujet dans l'arrière-plan. C'est pourquoi ils ont conçu et organisé le HM-World ensemble de données**, spécifiquement destiné à l'entraînement de la mémoire hybride :

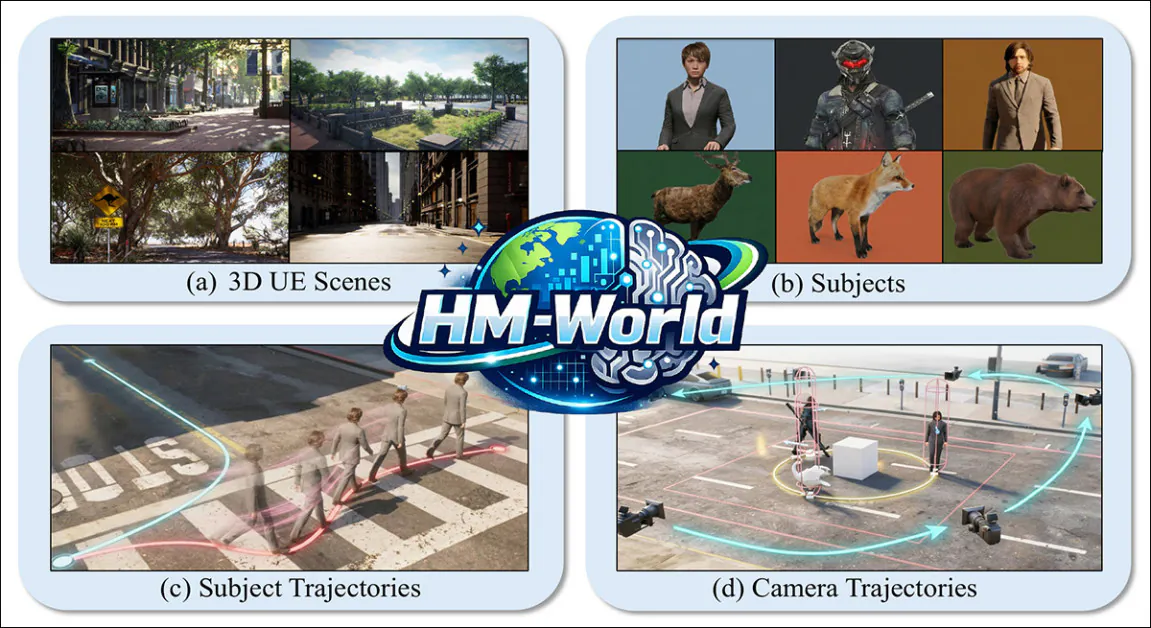

Extrait de l'article, des échantillons des quatre catégories contenues dans l'ensemble de données HM-World.

La collection est construite selon quatre dimensions : trajectoires des sujets, trajectoires de caméra, Scènes et sujets.

L'espace données synthétiques HM-World propose 17 scènes et 49 sujets, parmi lesquels des personnes d'apparences diverses, ainsi que des animaux de nombreuses espèces. Ces éléments sont combinés de manière procédurale dans une scène grâce à Unreal Engine, chacun avec une animation de mouvement distincte, puis placés sur une trajectoire sélectionnée aléatoirement.

Les auteurs affirment qu'un ensemble varié de entrée-sortie Les événements sont représentés dans l'ensemble de données, avec 28 trajectoires de caméra différentes, chacune comportant plusieurs points de départ.

La collection finale comprend 59 225 clips vidéo, chacun annoté par le MiniCPM-V Modèle de langage multimodal de grande taille (MLLM).

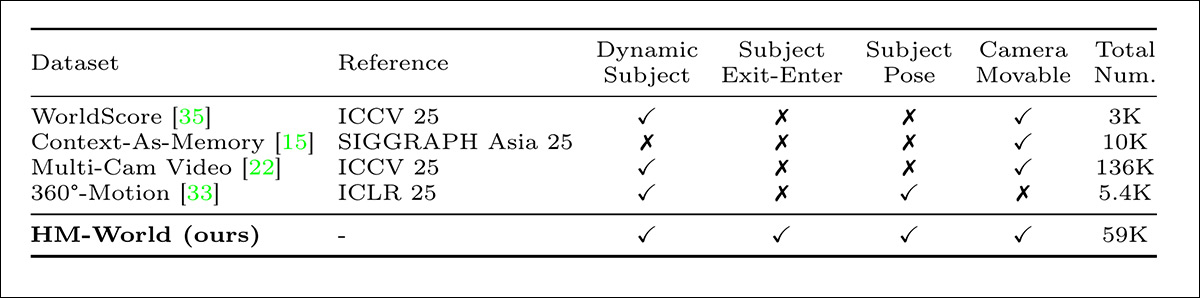

Les chercheurs soulignent les avantages statistiques de leur collection par rapport aux ensembles de données antérieurs. WorldScore; Le contexte comme mémoire; Vidéo multicaméraet Mouvement à 360°:

Comparaison entre les ensembles de données existants et l'ensemble de données HM-World, où « Sujet dynamique » indique la présence d'entités en mouvement, « Entrée-Sortie du sujet » désigne les clips contenant des sujets quittant et réintégrant le cadre, et « Pose du sujet » fait référence à l'inclusion de poses 3D annotées.

Le chemin le moins fréquenté

À partir de plusieurs images précédentes et d'une trajectoire de caméra connue, l'objectif est de prédire les vues futures en fonction de l'évolution du point de vue de l'observateur, tout en tenant compte des sujets qui se déplacent indépendamment et peuvent sortir du cadre avant d'y revenir. Cela implique plus que la simple préservation d'un arrière-plan stable : le modèle doit également conserver une trace interne cohérente de l'apparence et du comportement de chaque sujet en mouvement, même lorsqu'il est hors champ.

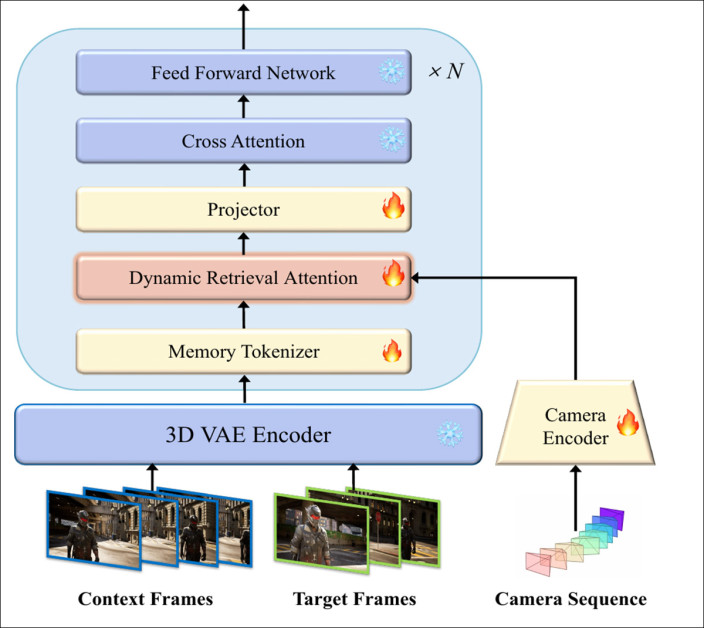

Les auteurs Attention de récupération dynamique hybride La méthode (HyDRA) remédie à ce problème en introduisant une voie de mémoire dédiée qui sépare les sujets dynamiques de la représentation statique de la scène, leur permettant de persister dans le temps et de réapparaître avec une apparence et un mouvement cohérents :

Schéma conceptuel du modèle HyDRA.

HyDRA est construit au-dessus de Wan2.1-T2V-1.3B, le pipeline de diffusion principal restant en grande partie intact, tout en introduisant une version modifiée transformateur Ce bloc intègre une attention de récupération dynamique. Cela permet au modèle de rappeler sélectivement les indices de mouvement et d'apparence des images précédentes, plutôt que de s'appuyer sur un contexte fixe ou local.

Ce processus utilise une adaptation Correspondance de flux objectif de formation au lieu de norme perte par diffusion.

Pour que les scènes restent alignées avec le mouvement de la caméra, les trajectoires de la caméra sont injectées comme un signal de conditionnement explicite, la pose de chaque image étant définie par rotation et translation, puis convertie en une représentation compacte capturant l'évolution du point de vue au fil du temps.

Conformément à ce qui précède (Kling) ReCamMaster Dans cette initiative, le résultat est ensuite analysé par l'encodeur de la caméra, implémenté comme un Perceptron multicouche, puis diffusé et ajouté au Transformateur de diffusion des fonctionnalités permettant au modèle de maintenir un positionnement constant des objets lorsque la caméra se déplace.

tokenization

Les latents de diffusion brute mélangent le mouvement du sujet, son apparence et l'arrière-plan en une seule représentation intriquée, et tenter de récupérer directement à partir de cet espace risque d'introduire un contexte non pertinent ou de faire en sorte que les sujets en mouvement se « fondent » dans le décor.

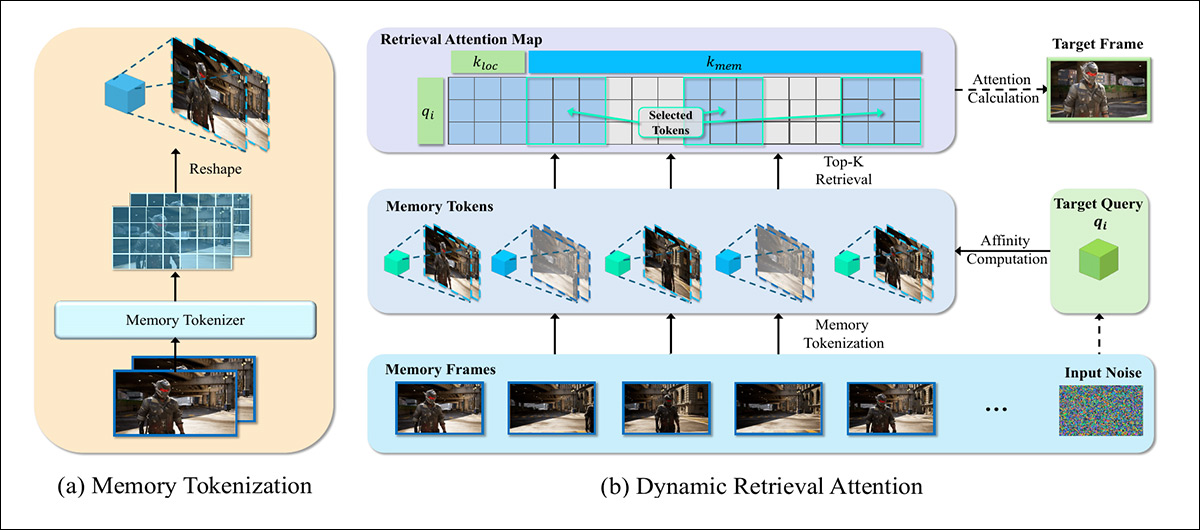

HyDRA résout ce problème grâce à un tokenizer de mémoire basé sur la convolution 3D qui traite l'espace et le temps conjointement – plutôt que de transmettre l'intégralité des historiques latents, il les compresse en jetons de mémoire compacts et sensibles au mouvement qui préservent l'apparence et les mouvements des sujets :

Présentation de HyDRA. À gauche, le tokenizer de mémoire convertit les images précédentes en jetons de mémoire compacts et sensibles au mouvement ; à droite, l’attention de récupération dynamique évalue la requête actuelle par rapport à ces jetons, récupère les plus pertinents et les utilise pour restaurer une apparence et un mouvement cohérents dans l’image générée.

Ces jetons forment une mémoire hybride structurée qui filtre le bruit tout en préservant la dynamique à long terme. Transmis au module d'attention et de récupération dynamique, ils permettent au modèle de rappeler sélectivement les sujets hors champ, afin qu'ils réapparaissent avec une apparence, un mouvement et un contexte cohérents.

Attention à la récupération dynamique

Le mécanisme à double mémoire d'HyDRA utilise également attention de récupération dynamique dans un rôle distinct mais complémentaire au sein de ce cadre.

La tokenisation de la mémoire compresse les représentations latentes passées en jetons structurés et sensibles au mouvement, séparant ainsi les sujets dynamiques du contenu statique de la scène et réduisant l'enchevêtrement qui fait souvent que les sujets se fondent dans l'arrière-plan. Ces jetons constituent une banque de mémoire persistante plutôt qu'un historique complet d'images.

L'attention dynamique opère ensuite sur cette base de données lors de la génération, évaluant la requête actuelle par rapport aux jetons stockés et rappelant sélectivement ceux qui sont les plus pertinents pour la séquence en évolution. Cela permet aux sujets hors champ de poursuivre leur évolution latente (c'est-à-dire de continuer à marcher ou à courir, même lorsqu'ils sont invisibles) et de réapparaître avec une apparence et des mouvements cohérents lorsqu'ils reviennent à l'écran, au lieu d'être réinitialisés ou de se dégrader.

Données et tests

Lors des tests, le système HyDRA basé sur WAN a encodé et sous-échantillonné 77 images de contexte avant de les analyser avec un auto-encodeur variationnel 3D (VAE), tandis que le tokenizer de mémoire susmentionné utilisait Convolution 3D à taille du noyau de 2x4x4.

Le modèle a été entraîné sur HW-World pendant 10 000 itérations sur 32 GPU (non spécifiés), à une fréquence de rafraîchissement de 10 000 secondes. taille du lot de 32.

Un nombre exceptionnellement élevé de métriques ont été utilisées dans les tests : outre le rapport signal/bruit de crête habituel (PSNR), Indice de similarité structurelle (SSIM), et les métriques de similarité perceptive apprises (LIPS), les auteurs ont également utilisé cohérence du sujet et cohérence de fond du Banc V suite, pour évaluer la cohérence au niveau de la trame.

De plus, ils ont conçu une mesure personnalisée intitulée Cohérence dynamique du sujet (DSC), qui utilise des boîtes englobantes de YOLO V11, pour créer des régions découpées présentant des sujets en mouvement, à partir desquelles des caractéristiques sémantiques ont été extraites et leurs similarités ensuite calculées.

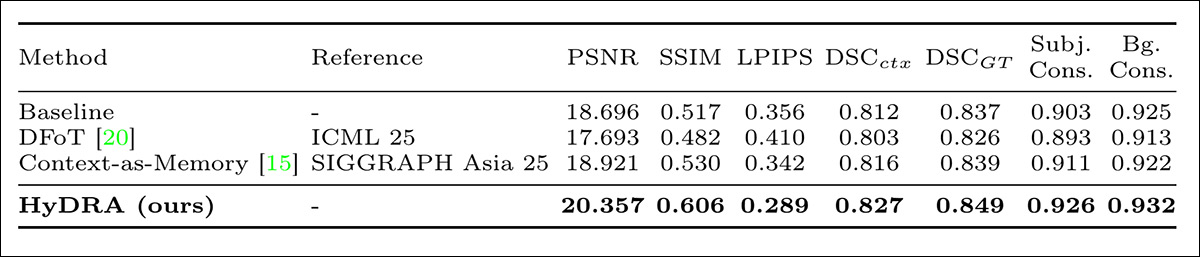

HyDRA a été opposé à Transformateur à diffusion forcée (DFoT), et Le contexte comme mémoire, par rapport à un modèle de base Wan2.1-T2V-1.3B équipé d'un encodeur de caméra (pour représenter le point de vue subjectif commun à tous les clips). Tous les modèles ont été entraînés sur HW-World, et WorldPlay a également été utilisé comme collection de tests secondaires sans essai préalable :

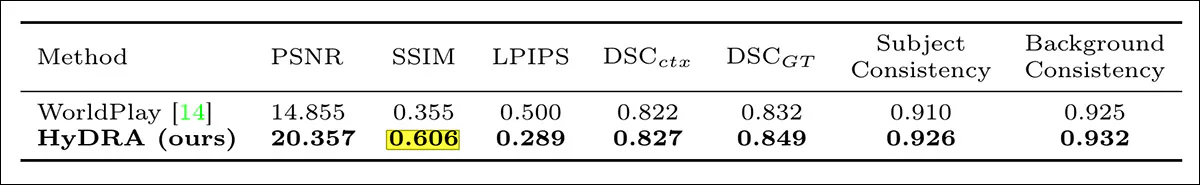

Lors des premières comparaisons quantitatives, HyDRA a surpassé toutes les méthodes de référence, augmentant le PSNR de 18.696 à 20.357 et le SSIM de 0.517 à 0.606. Il a également obtenu les scores Dice contextuels et de vérité terrain les plus élevés, soit 0.827 et 0.849, avec une cohérence sujet-arrière-plan atteignant 0.926 et 0.932 :

Résultats de la comparaison quantitative initiale avec les approches précédentes.

DFoT a atteint 17.693 PSNR et Context as Memory 18.921, les gains étant attribués à la tokenisation de la mémoire combinée à l'attention de récupération dynamique :

Comparaison quantitative opposant HyDRA aux technologies de pointe actuelles.

Concernant les tests comparatifs avec WorldPlay, les auteurs déclarent :

Notre méthode surpasse WorldPlay sur tous les indicateurs, avec un écart notable de 5.502 en PSNR. Bien que WorldPlay affiche des performances inférieures sur les indicateurs référencés au GT (par exemple, PSNR de 14.855, DSCGT de 0.832) en raison de l'écart de distribution du domaine et du manque de réglage fin spécifique, elle démontre une robustesse remarquable sur les indicateurs référencés au contexte en atteignant un DSCctx de 0.822.

« Cette observation confirme non seulement que les modèles largement entraînés possèdent une cohérence hybride satisfaisante, mais valide également indirectement la rationalité de nos métriques DSC proposées pour refléter la cohérence dynamique des sujets. »

« En définitive, ces résultats impressionnants mettent en évidence les capacités exceptionnelles de notre modèle, démontrant sa supériorité même par rapport aux modèles commerciaux établis. »

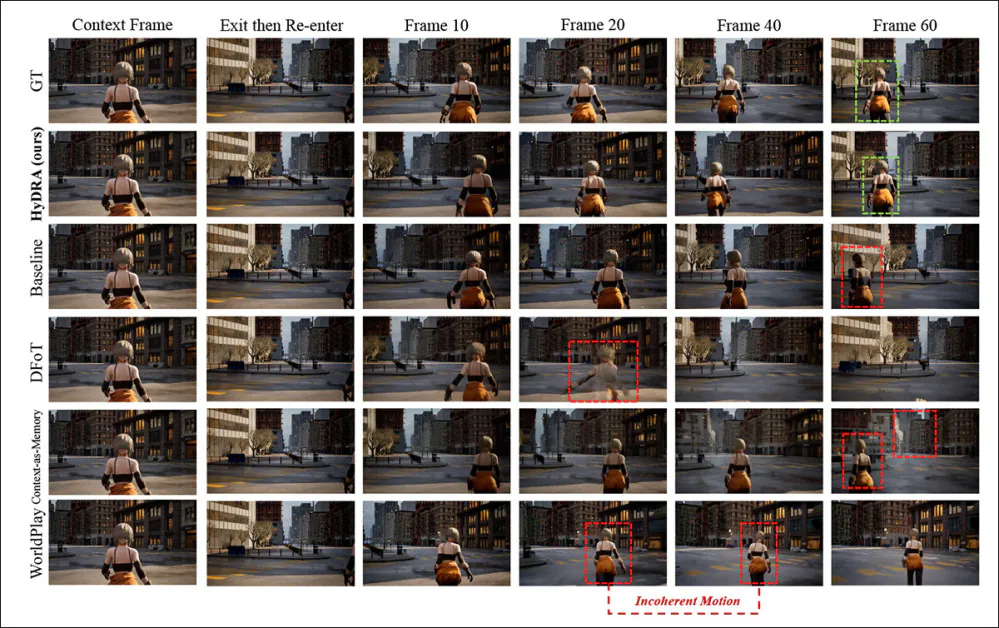

L'article propose une représentation statique des comparaisons qualitatives effectuées pour les tests :

Comparaison qualitative de la sortie et de la réentrée dans le champ de vision lors des mouvements de la caméra. Les auteurs affirment que HyDRA préserve l'identité du sujet, sa pose et la continuité de ses mouvements après sa sortie et son retour dans le champ de vision, correspondant fidèlement à la réalité, tandis que les méthodes concurrentes présentent une dérive, des mouvements incohérents ou une dégradation de l'image du sujet, mis en évidence en rouge (les récupérations cohérentes sont marquées en vert).

De ces résultats, les auteurs commentent :

Lors d'événements complexes d'entrée et de sortie, les modèles de référence et Context-as-Memory présentent une distorsion importante du sujet et une incohérence des mouvements. DFoT ne parvient pas à maintenir l'intégrité du sujet, ce qui entraîne sa disparition complète. Bien que WorldPlay réussisse à préserver la cohérence de l'apparence du sujet, ses mouvements sont saccadés et ses actions peu naturelles.

« À l’inverse, notre méthode maintient avec succès une cohérence hybride, préservant à la fois l’identité du sujet et la cohérence de son mouvement après son retour dans le cadre. »

D'autres résultats sont disponibles en format vidéo sur le site supplémentairedont les quatre premiers exemples ont été rassemblés (par nos soins) dans la vidéo ci-dessous :

Cliquez pour jouer. Quatre des six résultats des tests étaient affichés sur le site du projet. Source

Conclusion

Bien que toute tentative visant à résoudre l'un des plus grands problèmes de la génération vidéo par IA soit la bienvenue, il me semble inévitable que la solution optimale aux problèmes de sortie/réentrée de ce type s'avère être, comme ce fut le cas avec les images de synthèse, sous la forme de matériaux de référence distincts qui peuvent être discrètement édités et intégrés dans l'espace du compositeur.

Cette activité qui consiste à essayer de maintenir en vie une intégration dans un ad hoc Cette approche improvisée semble épuisante et n'offre aucune solution pour garantir la cohérence intra-plan proposée par des plateformes de création de contenu comme Runway. Si un plan suivant nécessite l'accès à l'espace latent du plan précédent, pourquoi ne pas utiliser des incrustations de personnages distinctes dans chaque cas ?

* Personne d'autre ne l'a nommé, et la discussion est difficile sans termes communs.

** Actuellement indiqué comme « bientôt disponible » sur la page du projet.

Première publication le vendredi 27 mars 2026