Angle d’Anderson

Apporter des analogies visuelles à l’IA

Les modèles d’IA actuels ne parviennent pas à reconnaître les similarités d’images ‘relationnelles’, telles que la similarité entre les couches de la Terre et une pêche, manquant ainsi un aspect clé de la façon dont les humains perçoivent les images.

Bien qu’il existe de nombreux modèles de vision par ordinateur capables de comparer des images et de trouver des similarités entre elles, la génération actuelle de systèmes comparatifs a peu ou pas de capacité imaginative. Considérons certaines des paroles de la chanson classique des années 60, Windmills of Your Mind :

Comme un carrousel qui tourne, faisant des cercles autour de la lune

Comme une horloge dont les aiguilles balayent les minutes de son visage

Et le monde est comme une pomme qui tourne silencieusement dans l’espace

Les comparaisons de ce type représentent un domaine d’allusion poétique qui est significatif pour les humains d’une manière qui va bien au-delà de l’expression artistique ; plutôt, il est lié à la façon dont nous développons nos systèmes perceptuels ; à mesure que nous créons notre domaine d’objets, nous développons une capacité de similarité visuelle, de sorte que – par exemple – des sections transversales représentant une pêche et la planète Terre, ou des récursions fractales telles que des spirales de café et des branches de galaxies, s’enregistrent comme analogues avec nous.

De cette façon, nous pouvons déduire des connexions entre des objets et des types d’objets apparemment non connectés, et inférer des systèmes (tels que la gravité, la momentum et la cohésion de surface) qui peuvent s’appliquer à une variété de domaines à différentes échelles.

Voir les choses

Même la dernière génération de systèmes de comparaison d’images d’IA, tels que Learned Perceptual Image Patch Similarity (LPIPS) et DINO, qui sont informés par les commentaires humains, ne réalisent que des comparaisons littérales de surface.

Leur capacité à trouver des visages où il n’y en a pas – c’est-à-dire pareidolie – ne représente pas le type de mécanismes de similarité visuelle que les humains développent, mais plutôt se produit parce que les algorithmes de recherche de visages utilisent des caractéristiques de structure de visage de bas niveau fonctionnelles qui correspondent parfois à des objets aléatoires :

Exemples de faux positifs pour la reconnaissance faciale dans le jeu de données ‘Faces with Things’. Source

Pour déterminer si les machines peuvent vraiment développer notre capacité imaginative à reconnaître la similarité visuelle entre les domaines, les chercheurs aux États-Unis ont mené une étude sur la similarité visuelle relationnelle, en créant et en formant un nouveau jeu de données conçu pour forcer des relations abstraites à se former entre différents objets qui sont néanmoins liés par une relation abstraite :

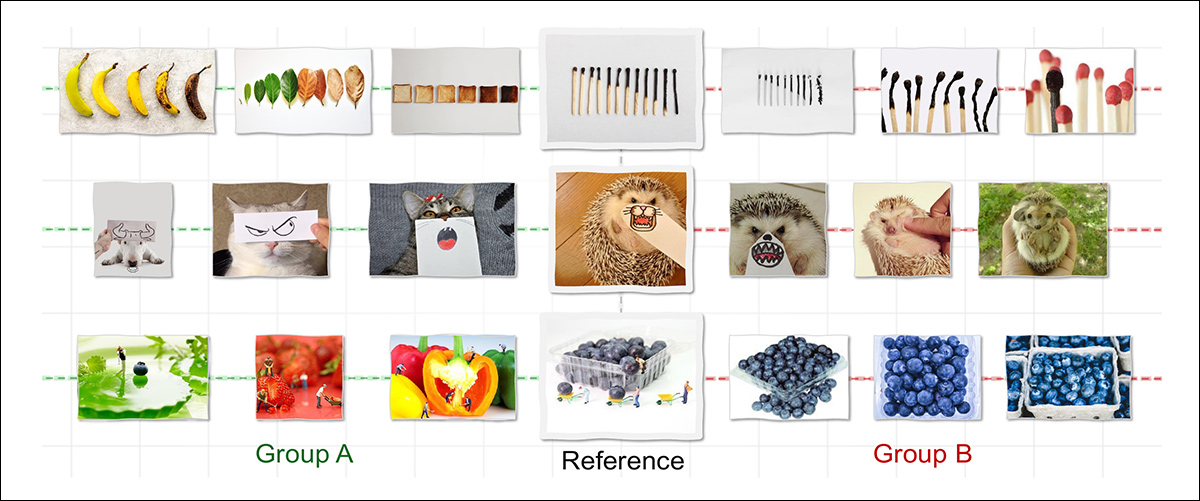

La plupart des modèles d’IA ne reconnaissent la similarité que lorsque les images partagent des caractéristiques de surface telles que la forme ou la couleur, c’est pourquoi ils ne relient que le groupe B (ci-dessus) à la référence. Les humains, en revanche, voient également le groupe A comme similaire – non parce que les images se ressemblent, mais parce qu’elles suivent la même logique sous-jacente, comme montrer une transformation dans le temps. Le nouveau travail tente de reproduire ce type de similarité structurelle ou relationnelle, visant à rapprocher la perception des machines de la raison humaine. Source: https://arxiv.org/pdf/2512.07833

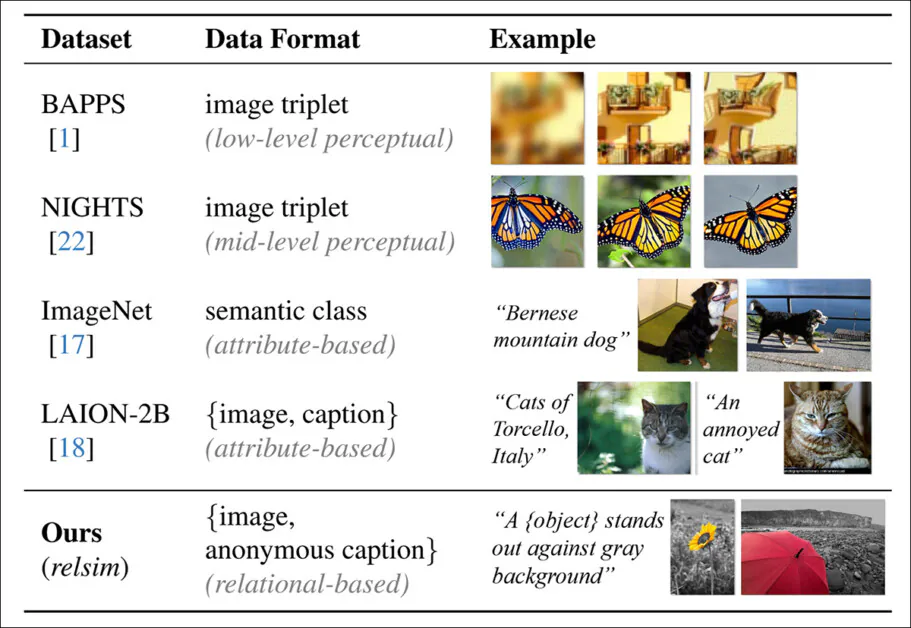

Le système de caption développé pour le jeu de données facilite des annotations abstraites inhabituelles, conçues pour forcer les systèmes d’IA à se concentrer sur les caractéristiques de base plutôt que sur des détails locaux spécifiques :

Les légendes ‘anonymes’ prédites qui contribuent à la métrique ‘relsim’ des auteurs.

La collection curatée et son style de légende inhabituel alimentent la nouvelle métrique proposée relsim, que les auteurs ont affinée dans un modèle vision-langage (VLM).

Comparaison entre le style de légende des jeux de données typiques, qui se concentre sur la similarité d’attribut, alors que l’approche relsim (ligne du bas) met l’accent sur la similarité relationnelle.

La nouvelle approche s’appuie sur des méthodologies de la science cognitive, en particulier la théorie de la Structure-Mapping (une étude de l’analogie) de Dedre Gentner et la définition de la similarité relationnelle et de la similarité d’attribut d’Amos Tversky.

À partir du site Web du projet associé, un exemple de similarité relationnelle. Source

Les auteurs déclarent :

‘[Les humains] traitent la similarité d’attribut de manière perceptive, mais la similarité relationnelle nécessite une abstraction conceptuelle, souvent soutenue par le langage ou les connaissances antérieures. Cela suggère que la reconnaissance de la similarité relationnelle nécessite d’abord de comprendre l’image, de puiser dans les connaissances et d’abstraire sa structure sous-jacente.’

Le nouvel article est intitulé Similarité visuelle relationnelle, et est accompagné d’un site Web de projet (voir la vidéo intégrée à la fin de cet article).

Méthode

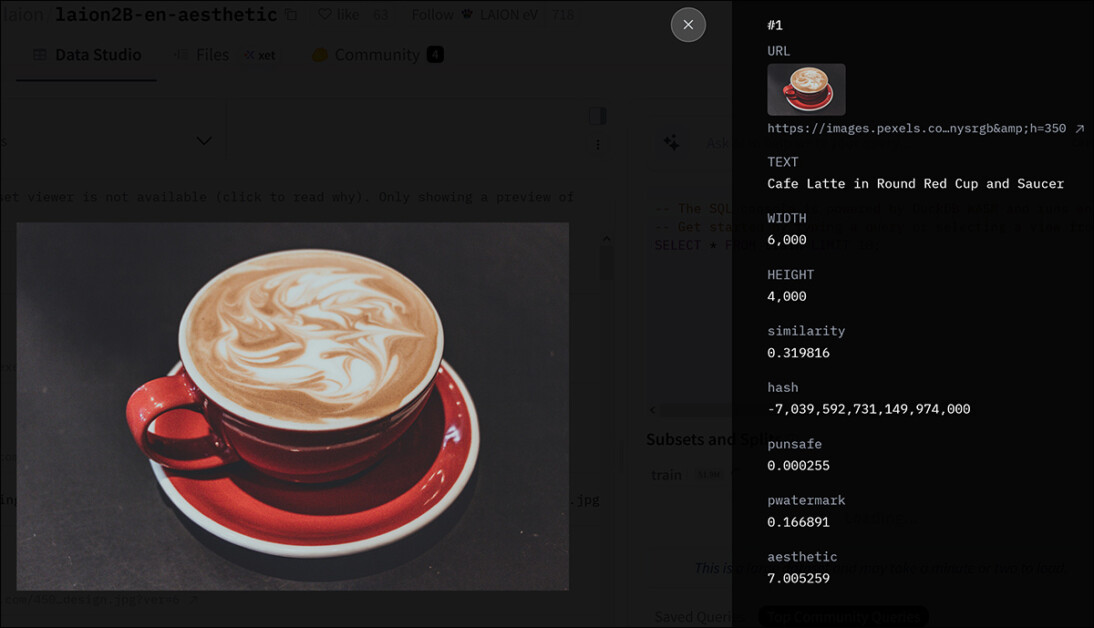

Les chercheurs ont utilisé l’un des jeux de données hyperscale les plus connus comme point de départ pour leur propre collection – LAION-2B :

Métadonnées pour une entrée dans la collection LAION-2B. Source

114 000 images susceptibles de contenir des structures relationnelles élastiques ont été extraites de LAION-2B, impliquant le filtrage des nombreuses images de mauvaise qualité présentes dans le jeu de données minimalement curaté.

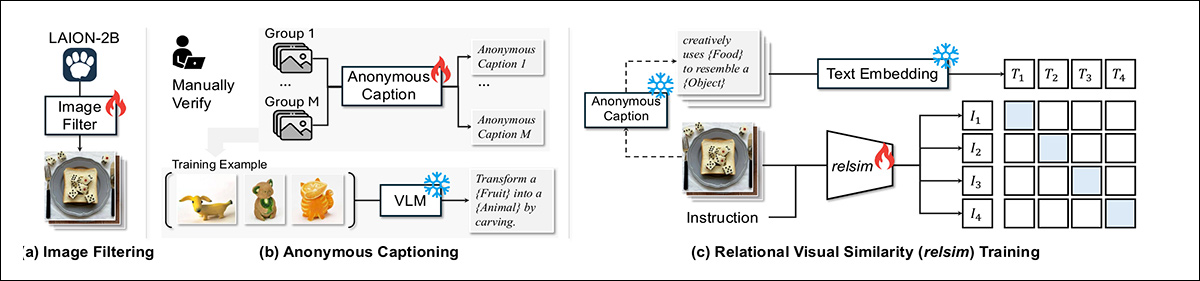

Pour créer un pipeline pour ce processus de sélection, les auteurs ont utilisé Qwen2.5-VL-7B, en exploitant 1 300 exemples positifs et 11 000 exemples négatifs étiquetés par des humains :

Le système relsim est formé en trois étapes : filtrage des images de LAION-2B pour le contenu relationnel ; attribution à chaque groupe d’une légende anonyme partagée qui capture sa logique sous-jacente ; et apprentissage pour faire correspondre les images à ces légendes à l’aide d’une perte contrastive.

L’article indique :

‘Les annotateurs ont reçu pour instruction : “Pouvez-vous voir un modèle relationnel, une logique ou une structure dans cette image qui pourrait être utile pour créer ou relier à une autre image ?”. Le modèle affiné atteint 93 % d’accord avec les jugements humains, et lorsqu’il est appliqué à LAION-2B, il donne N = 114 000 images identifiées comme relationnellement intéressantes.’

Pour générer des étiquettes relationnelles, les chercheurs ont incité le modèle Qwen à décrire la logique partagée derrière des ensembles d’images sans nommer d’objets spécifiques. Cette abstraction était difficile à obtenir lorsque le modèle ne voyait qu’une seule image, mais est devenue réalisable lorsque plusieurs exemples ont démontré le modèle sous-jacent.

Les légendes de groupe résultantes ont remplacé des termes spécifiques par des espaces réservés tels que ‘{Sujet}’ ou ‘{Type de mouvement}’, les rendant largement applicables.

Après vérification humaine, chaque légende a été associée à toutes les images de son groupe. Plus de 500 de ces groupes ont été utilisés pour former le modèle, qui a ensuite été appliqué aux 114 000 images filtrées pour produire un grand ensemble d’échantillons annotés de manière abstraite et relationnelle.

Données et tests

Après l’extraction des fonctionnalités relationnelles avec Qwen2.5-VL-7B, un modèle a été affiné sur les données à l’aide de LoRA, pendant 15 000 étapes, via huit A100 GPU*. Pour le côté texte, les légendes relationnelles ont été intégrées à l’aide de all-MiniLM-L6-v2 de la bibliothèque Sentence-Transformers.

Le jeu de données de 114 000 images légendées a été divisé en 100 000 pour la formation et 14 000 pour l’évaluation. Pour tester le système, un dispositif de récupération a été utilisé : étant donné une image de requête, le modèle devait trouver une autre image d’un pool de 28 000 éléments qui exprimait la même idée relationnelle. Le pool de récupération comprenait 14 000 images d’évaluation et 14 000 échantillons supplémentaires de LAION-2B, avec 1 000 requêtes sélectionnées aléatoirement à partir de l’ensemble d’évaluation pour la référence.

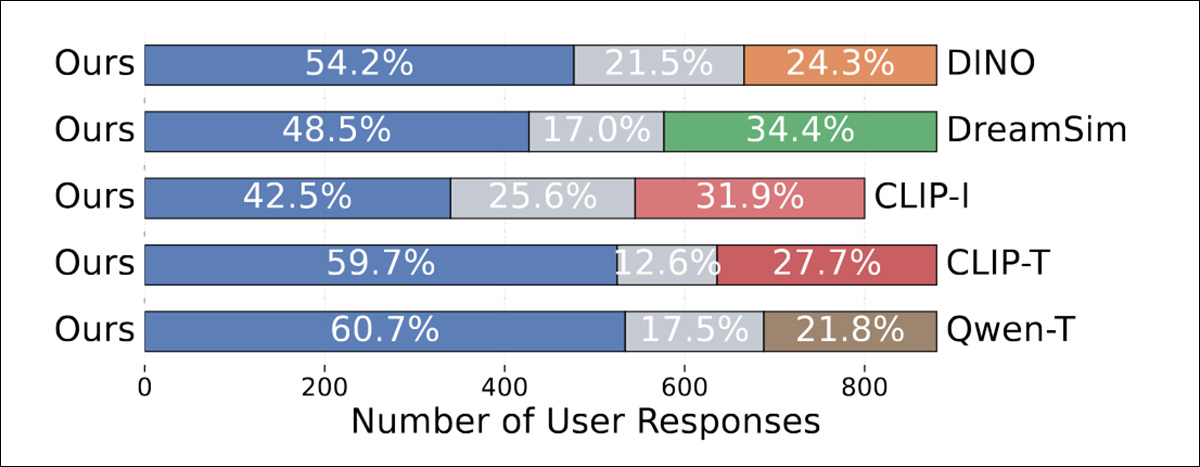

Pour évaluer la qualité de récupération, GPT-4o a été utilisé pour noter la similarité relationnelle entre chaque requête et image récupérée sur une échelle de 0 à 10. Une étude humaine distincte a également été menée pour évaluer les préférences des utilisateurs (voir ci-dessous).

Chaque participant a vu une image de requête anonyme avec deux candidats, l’un récupéré par la méthode proposée, l’autre par une référence. Les participants ont été invités à indiquer quelle image était plus relationnellement similaire à la requête, ou si les deux étaient également proches. Pour chaque référence, 300 triplets ont été créés et notés par au moins trois personnes chacun, ce qui a donné environ 900 réponses.

La méthode relsim a été comparée à plusieurs méthodes de similarité d’image établies, notamment la mentionnée dreamsim, et CLIP-I. En plus des références qui calculent directement des scores de similarité entre paires d’images, telles que LPIPS, DINO, dreamsim et CLIP-I, les auteurs ont également testé des méthodes basées sur des légendes dans lesquelles Qwen a été utilisé pour générer une légende anonyme ou abstraite pour chaque image ; cela a ensuite servi de requête de récupération.

Deux variantes de récupération ont été évaluées, avec une récupération d’image à texte CLIP (CLIP-T) utilisée pour la récupération d’image à texte, et Qwen-T utilisant la récupération de texte à texte. Les deux références basées sur des légendes ont utilisé le modèle Qwen préformé d’origine plutôt que la version affinée sur la logique relationnelle. Cela a permis aux auteurs d’isoler l’effet de la formation basée sur le groupe, puisque le modèle affiné avait été exposé à des ensembles d’images, plutôt qu’à des exemples isolés.

Métriques existantes et similarité relationnelle

Les auteurs ont initialement testé si les métriques existantes pouvaient capturer la similarité relationnelle :

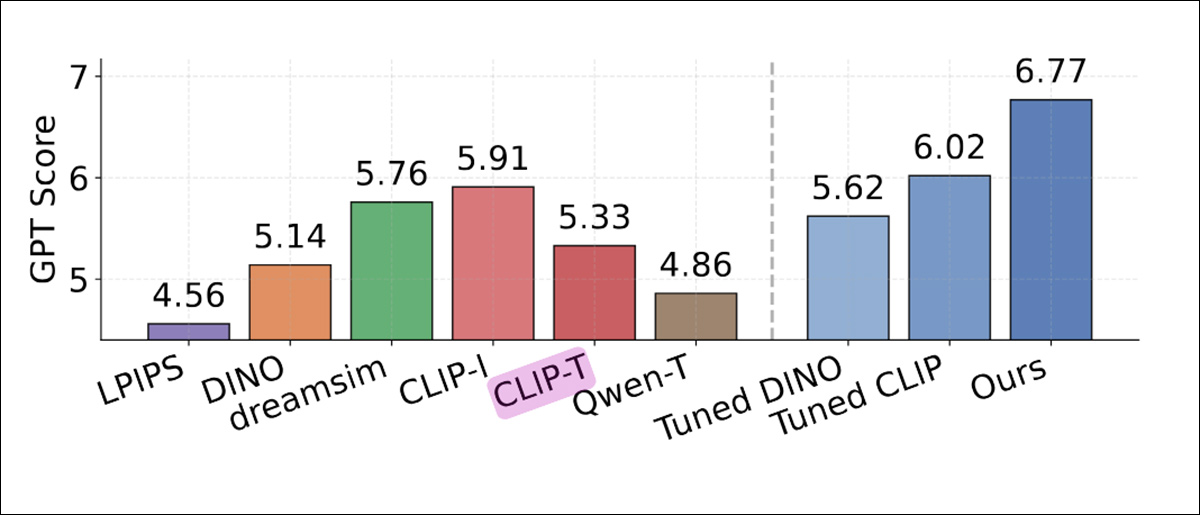

Comparaison des performances de récupération jugées par GPT-4o, montrant le score de similarité relationnelle moyen pour chaque méthode. Les métriques de similarité conventionnelles telles que LPIPS, DINO et CLIP-I ont obtenu des scores plus bas. Les références basées sur des légendes Qwen-T et CLIP-T ont également sous-performé. Le score le plus élevé a été obtenu par relsim (6,77, colonne bleue la plus à droite), indiquant que l’affinement sur des modèles relationnels de groupe a amélioré l’alignement sur les évaluations de GPT-4o.

En ce qui concerne ces résultats, les auteurs déclarent** :

‘[LPIPS], qui se concentre uniquement sur la similarité perceptive, obtient le score le plus bas (4,56). [DINO] performe légèrement mieux (5,14), probablement parce qu’il est formé uniquement de manière auto-supervisée sur des données d’images. [CLIP-I] donne les résultats les plus forts parmi les références (5,91), probablement parce que certaines abstractions sont parfois présentes dans les légendes d’images.

‘Cependant, CLIP-I sous-performe encore par rapport à notre méthode, car obtenir un meilleur score peut nécessiter la capacité de atteindre des abstractions de niveau encore plus élevé, telles que celles des légendes anonymes.’

Dans l’étude humaine, les humains ont préféré de manière cohérente la méthode relsim par rapport à toutes les références :

Scores de similarité relationnelle attribués par GPT-4o pour chaque méthode. Les métriques de similarité standard telles que LPIPS, DINO et CLIP-I ont obtenu des scores plus bas, et les variantes basées sur des légendes Qwen-T et CLIP-T ont performé légèrement mieux. Même les versions réglées de DINO et CLIP n’ont pas comblé l’écart. Le score le plus élevé, 6,77, a été obtenu par le modèle relsim, formé avec une supervision basée sur le groupe.