Angle d’Anderson

Essayage virtuel de nouveaux vêtements grâce à l’IA

Un modèle d’IA peut désormais transformer une seule photo et des images de vêtements en une vidéo animée d’une personne portant de nouvelles tenues, en évitant les erreurs courantes des anciens systèmes à deux étapes.

La catégorie « essayage virtuel » (VTON) dans la recherche en vision par ordinateur est l’une des plus financées et des plus prolifiques – principalement parce que, comme on peut le déduire des fréquentes collaborations industrielles et universitaires publiées chaque année, cet objectif reçoit un financement important de l’industrie de la mode bien dotée :

À partir de l’article « Image-Based Virtual Try-On : A Survey », des exemples de types de représentation de personnes et de certaines des étapes de filtrage et de raffinement que même les images nues doivent subir pour un essayage virtuel (VTON). Source

Il existe de nombreuses variations sur cet objectif, telles que l’extraction de vêtements à partir d’images de personnes, et la prise en compte de la silhouette plus forte lorsque cela est nécessaire. Certains systèmes basés sur des images ont été mis en œuvre commercialement, sur des plateformes telles que veesual.ai, wanna.fashion et fashn.ai.

Pour la vidéo, l’application expérimentale Doppl de Google Labs a expérimenté cette fonctionnalité, lançée l’été dernier:

Veuillez cliquer pour jouer si la vidéo ne se lance pas automatiquement. Extraits du projet abandonné de Google Doppl pour l’essayage virtuel de vêtements. Source

Cependant, Doppl ferme en avril 2026 après une réception tiède, les utilisateurs étant désormais renvoyés au service d’essayage d’images de la société †:

Le programme d’essayage d’images de Google, où les utilisateurs sont renvoyés à partir de la plateforme Doppl abandonnée de la société. Source

Bien qu’il existe un petit nombre de plateformes proposant un essayage virtuel avec vidéo, aucune d’entre elles ne semble être affiliée à un détaillant réel ; et elles sont toutes des produits « pointe » marginaux (et souvent « douteux ») qui utilisent des jetons.

Alors qu’il existe un certain nombre de travaux de recherche intéressants, ils sont traditionnellement des architectures complexes qui sont difficiles à mettre en œuvre pour une faible latence et une haute qualité:

Veuillez cliquer pour jouer si la vidéo ne se lance pas automatiquement. À partir du projet Fashion-VDM de 2024, un exemple de « transfert de vêtements sans tête ». Source

La vérité est que la tâche de conformer les vêtements à une personne réelle, sans déformer les vêtements ou la personne, tout en maintenant une sorte de mouvement démonstratif utile (qui montre avec précision le dos du produit lorsque la personne tourne le dos), est un défi formidable pour l’état actuel de la technique.

Vanast

C’est un défi que le nouveau document coréen tente de relever, en utilisant une solution intégrée et entièrement nouvelle pour analyser les vêtements + la personne + le mouvement:

Veuillez cliquer pour jouer si la vidéo ne se lance pas automatiquement. Exemples à partir du site de matériel supplémentaire du projet Vanast. Source

Le nouveau système, intitulé Vanast, utilise un jeu de données personnalisé mettant en œuvre et orchestrant les trois facteurs nécessaires pour accomplir la tâche: les vêtements ; la personne ; et le mouvement:

Cliquez pour jouer. Autres exemples à partir du site du projet Vanast.

Le système utilise des cadres tels que Flux, Qwen et ChatGPT, pour générer un jeu de données « triplet » capable d’informer une architecture de bout en bout:

À partir du nouveau document, des exemples de points de données du jeu de données utilisés pour la génération et la formation. Source –

Le nouveau document est intitulé Vanast: Essayage virtuel avec animation d’image humaine via une supervision de triplet synthétique, et provient de quatre chercheurs de l’Université nationale de Séoul. Il existe également un site de projet vidéo.

Méthode

L’objectif déclaré des auteurs dans ce travail est de fusionner les trois aspects mentionnés précédemment dans un cadre à une seule étape – non seulement parce que le processus serait discret, mais aussi parce que cela donne aux différents aspects plus d’opportunités de se croiser et d’interagir pendant la formation, dans le but d’une génération plus cohérente:

Vanast combine une seule photo humaine, des images de vêtements séparées et une référence de mouvement pour générer une séquence de mouvement dans laquelle la même personne porte la nouvelle tenue, avec une orientation de pose garantissant un mouvement constant, tout en préservant l’identité et les détails des vêtements à travers les cadres.

Pour atteindre cet objectif, le système prend des images des articles de vêtement ciblés ; une photo de la personne portant des vêtements différents ; une vidéo de référence de mouvement définissant comment la personne doit bouger ; et un texte de prompt décrivant l’action et le paramètre ; et produit une séquence de vidéo complète dans laquelle cette même personne semble porter la nouvelle tenue, en suivant le mouvement imposé, avec chaque trame maintenue visuellement cohérente dans le temps.

Plutôt que de séparer l’habillage et l’animation en différentes étapes – ce qui a été l’approche dans la plupart des travaux similaires antérieurs – Vanast gère les vêtements, l’identité et le mouvement ensemble dans un seul processus, permettant à ces éléments d’interagir pendant la génération, et réduisant les types de correspondance et d’instabilité évidents dans les méthodes antérieures.

Jeu de données

La formation pour le projet est basée sur des exemples appariés d’une image de personne, des articles de vêtement correspondants et d’une vidéo de cette personne en mouvement portant ces vêtements, avec le mouvement extrait à l’aide d’une architecture précédente, pour fournir une orientation de pose stable à travers les trames.

En l’absence d’un jeu de données public disponible répondant aux exigences du projet, les données ont été extraites de (non spécifiées) plateformes de commerce en ligne, fournissant un cache de vidéos avec des vêtements divers. Cependant, la tâche a nécessité des vidéos de la même personne portant plusieurs tenues, ce qui est un élément rare dans les données sauvages, et qui a nécessité la création de données synthétiques.

Le processus en trois étapes a consisté à sélectionner des cadres candidats appropriés à partir des vidéos extraites, gérés via le modèle de vision-langage Qwen2.5-VL (VLM), avec un recadrage et une évaluation appropriés de la convenance (c’est-à-dire, pas d’occlusions, sujet dans la bonne position, etc.) ; et à créer des masques de remplissage appropriés pour isoler les zones touchées – qui (conformément au travail précédent PERSE) est géré par le modèle de diffusion SDXL désormais vénéré.

Vue d’ensemble du pipeline Vanast, où une image humaine, des images de vêtements ciblés et une référence de mouvement sont encodés et traités dans un modèle de diffusion de vidéo unifié. Le système génère une animation qui préserve l’identité, suit la séquence de pose et applique les vêtements ciblés, tout en préservant les détails des vêtements et de l’identité à travers les trames.

À la troisième étape, Qwen est à nouveau utilisé pour classer les images par sexe, et le cadre de diffusion d’image Flux est ensuite utilisé pour créer des modifications des vêtements dans une image (puisque Flux est capable de fusionner plusieurs éléments d’entrée). Les invites de texte de remplissage ont été curées par ChatGPT (version non spécifiée).

Pour augmenter davantage la diversité de pose et d’arrière-plan, un pipeline a été introduit pour construire des triplets de formation à partir de vidéos in situ, en utilisant le joue de données HumanVid. Le même processus a été utilisé pour générer l’image humaine préservant l’identité.

Étant donné qu’aucune image de vêtement autonome n’existait dans ces vidéos, les images de vêtements ont été synthétisées directement à partir de la vidéo.

Des trames ont été échantillonnées à partir de chaque vidéo, et Qwen a été utilisé pour les noter en termes de visibilité frontale, avant de sélectionner le candidat le plus approprié, en fonction de la visibilité du corps entier, de la clarté de l’image, d’une occlusion minimale, de la qualité de l’éclairage et de la composition globale.

Une région de vêtement supérieur a ensuite été extraite à l’aide de SegFormer, et l’arrière-plan a été supprimé pour isoler le vêtement.

Pour éviter les biais de position, la région du vêtement a été décalée aléatoirement dans sa boîte de délimitation, et Qwen a été utilisé à nouveau pour filtrer les segmentations non fiables. Ce processus a produit des images de vêtements synthétiques appariées avec le mouvement et l’identité, permettant la construction de triplets à grande échelle à partir de données vidéo non structurées, tout en améliorant la robustesse dans diverses conditions du monde réel.

Architecture

Une architecture à double module a été introduite pour répondre à la convergence lente et au faible équilibre de contrôle observés dans les méthodes antérieures qui avaient tenté de fusionner toutes les conditions. L’approche a utilisé le transformateur de diffusion de texte à vidéo de Wan, et s’est également appuyé sur le projet VACE (voir ci-dessous).

Le modèle a été divisé en un module d’animation humaine (HAM), qui gère le mouvement et l’identité à partir des entrées humaines et de pose ; et un module de transfert de vêtements (GTM), qui gère les vêtements à partir des images de vêtements. Les deux partagent l’accès au backbone, tout en intégrant les fonctionnalités de manière distribuée et en cascade, pour améliorer la condition.

La formation a été effectuée en figeant le backbone et en optimisant uniquement les paramètres HAM et GTM, avec leurs contributions équilibrées pendant l’intégration des fonctionnalités. Les entrées du jeu de données triplet synthétique ont été converties en représentations latentes à l’aide du VAE de WAN.

Le contexte de mouvement a été construit en combinant les informations humaines et de pose dans le temps, tandis que les fonctionnalités de vêtements ont été traitées séparément et alignées par projection dans les embeddings de jetons.

Le modèle a également été étendu pour prendre en charge l’interpolation de vêtements. Ici, les représentations de deux vêtements ont été combinées pour générer des transitions fluides, permettant un mélange cohérent et cohérent entre les articles de vêtements, sans optimisation supplémentaire.

Données et tests

Le modèle a été formé sur 9 135 vidéos, avec des durées allant de trois à dix secondes, provenant des sites de centres commerciaux susmentionnés ; le jeu de données généré par les auteurs ; et le jeu de données HumanVid.

À partir de ceux-ci, deux jeux de données d’évaluation ont été établis : le « jeu de données Internet », présentant des vidéos et des images de produits à partir de centres commerciaux ; et la division de test officielle du joue de données ViViD d’Alibaba.

Étant donné que les données ViViD manquent de visages (voir la vidéo ci-dessus pour un exemple de cela, qui est très courant dans la littérature sur l’essayage virtuel), ceux-ci ont été ajoutés via Flux outpainting.

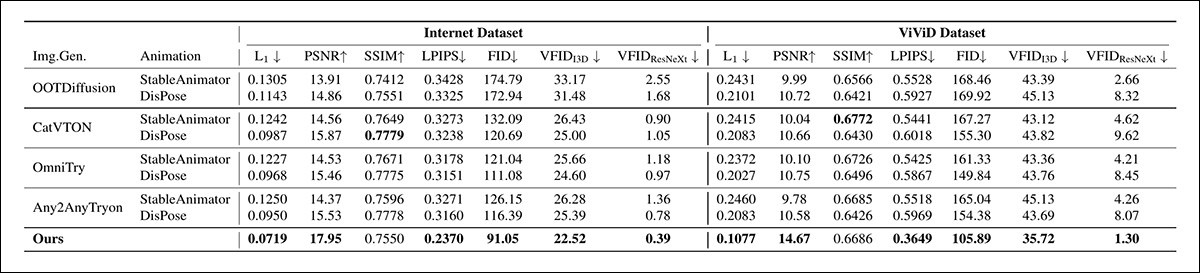

Les métriques utilisées étaient L1 loss ; Peak Signal-to-Noise Ratio (PSNR) ; Structural Similarity Index (SSIM) ; Learned Perceptual Image Patch Similarity (LPIPS) ; Fréchet Inception Distance (FID) ; et Fréchet Video Distance†† (FVD)

Les systèmes testés pour le transfert de vêtements étaient OOTDiffusion ; CatVTON ; OmniTry ; et Any2AnyTryon. Les modèles de génération d’image de sujet à image testés étaient VisualCloze ; MOSAIC ; et UNO de ByteDance.

Pour la deuxième étape d’animation d’image humaine, les cadres StableAnimator et DisPose ont été utilisés.

Dans un contexte plus limité (car il ne prend pas en charge directement l’objectif), VACE a également été testé, avec certains efforts pour équilibrer la fonctionnalité manquante :

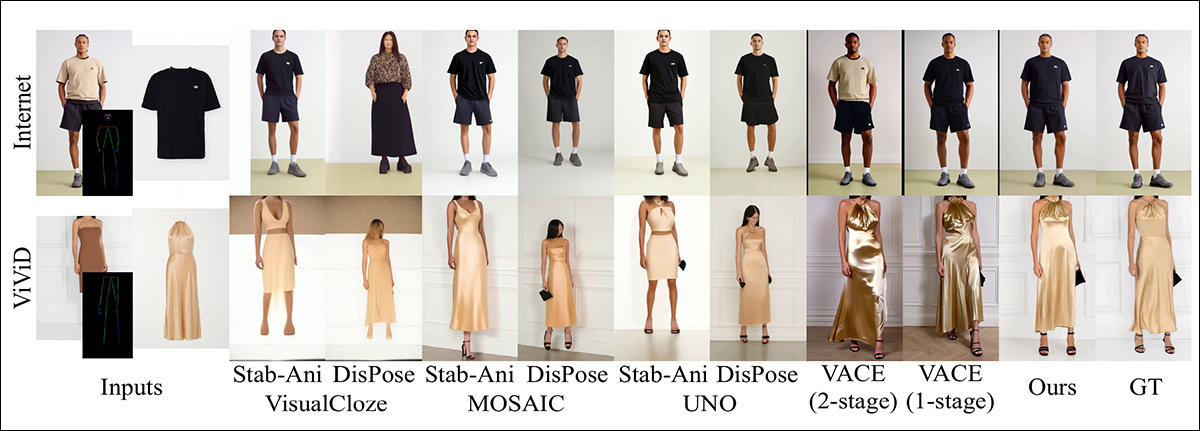

Comparaison quantitative avec des combinaisons de modèles de sujet à image et d’animation sur les jeux de données Internet et ViViD, où la méthode proposée a atteint les meilleures performances sur toutes les métriques signalées. Les valeurs en gras indiquent le score le plus élevé dans chaque colonne.

Parmi les résultats initiaux présentés ci-dessus, les auteurs déclarent :

‘[Notre] modèle atteint les meilleures performances sur toutes les métriques lorsqu’il est comparé à des combinaisons de modèles de génération de sujet à image et de modèles d’animation.

‘Les résultats qualitatifs [présentés ci-dessous] confirment en outre que notre approche produit le suivi de pose et le transfert de vêtements les plus précis, tout en préservant l’identité de manière plus fidèle que toutes les lignes de base basées sur le sujet à l’image.’

Comparaison qualitative sur les jeux de données Internet et ViViD contre les lignes de base de sujet à image et d’animation, où la méthode proposée, selon les auteurs, offre un suivi de pose et un transfert de vêtements plus précis, tout en préservant l’identité de manière plus cohérente que VisualCloze, MOSAIC, UNO et VACE.

Pour la deuxième catégorie de tests, où des combinaisons de modèles d’essayage virtuel d’images et de modèles d’animation ont été testés, le nouveau travail a pu atteindre le score le plus élevé :

Comparaison quantitative avec des combinaisons de modèles d’essayage virtuel d’images et de modèles d’animation sur les jeux de données Internet et ViViD. La méthode proposée a atteint les meilleures performances globales sur les métriques, le SSIM restant comparable à la ligne de base la plus solide. Les valeurs en gras indiquent le score le plus élevé.

Les auteurs ajoutent :

‘Les comparaisons qualitatives [présentées ci-dessous] démontrent que nos résultats ressemblent le plus à la vérité terrain parmi toutes les lignes de base basées sur l’essayage virtuel d’images.’

Tests qualitatifs utilisant des lignes de base créées en combinant des modèles de VTON avec des modèles d’animation.

Conclusion

Bien que le projet Vanast atteigne une solution de bout en bout discrète, le manque de détails du document sur les exigences de ressources de formation et d’inférence suggère que cela pourrait ne pas être la solution la plus agile ou la plus souple. En vérité, le défi lui-même est extrêmement difficile à atteindre, même dans un système non optimisé – et combien plus dans un déploiement commercial qui nécessiterait une faible latence et une rentabilité à grande échelle..?

L’essayage virtuel est l’un des objectifs « lune » de l’IA où l’état actuel de la technique, tel qu’il est diffusé à travers divers titres et résultats sélectionnés, masque la difficulté réelle de la tâche, qui sera peut-être résolue par des technologies plus tardives et plus légères que les transformateurs.

† Disponible aux États-Unis, bloqué géographiquement dans de nombreuses autres régions, si ce n’est toutes.

†† Les auteurs font référence à « VFID », mais ne lient qu’au document ViViD, qui ne justifie pas la référence, autant que je puisse le déduire, avec le temps limité pour le retrouver. J’ai supposé qu’ils ont réellement voulu dire la distance de vidéo Fréchet (FVD), et qu’ils étaient également à court de temps. Veuillez me contacter pour les modifications, si nécessaire.

Publié pour la première fois le mercredi 8 avril 2026