Angle d’Anderson

L’IA peut deviner l’année d’une photo à partir de l’âge des personnes

De nouvelles recherches montrent que l’IA peut utiliser les visages des personnes pour estimer l’année à laquelle une photo a été prise, en combinant les suppositions d’âge avec les années de naissance connues pour battre les méthodes actuelles basées sur la scène.

Deviner la date d’une photo était autrefois beaucoup plus facile qu’aujourd’hui, car les modes capillaires et vestimentaires évoluaient à une vitesse fulgurante. Pour des raisons beaucoup débattues, ce mouvement de style visuel a pris fin il y a environ trente ans, ce qui signifie qu’il n’est plus tout à fait aussi facile de regarder une coiffure ou des articles de vêtement et de deviner l’année à partir de ce type d’indice visuel.

Pendant un certain temps, il était possible de dater des images et des films en fonction de la résolution des couleurs et des caractéristiques de grain du film. On n’avait pas besoin d’être un spécialiste en sciences judiciaires ; si vous regardiez suffisamment de vieux films, les indices culturels (tels que la musique, les voitures, la mode, les sujets, etc.) finiraient par être associés, par le spectateur, à des styles de stock de film :

![Une illustration de la façon dont les améliorations du stock de film ont progressivement élargi la gamme des tons de peau et des styles d'éclairage au fil du temps, passant de mises en page plates et frontales à des aspects plus naturalistes et variés. [ Source ] https://archive.is/3ZSjN (mon propre article)](https://www.unite.ai/wp-content/uploads/2025/11/grain-styles.jpg)

Une illustration de la façon dont les améliorations du stock de film ont progressivement élargi la gamme des tons de peau et des styles d’éclairage au fil du temps, passant de mises en page plates et frontales à des aspects plus naturalistes et variés. Source (mon propre article)

Un autre « ancre » pour dater une photographie était si elle était en noir et blanc – une économie qui est devenue obsolète après la popularisation de la photographie numérique au début de ce siècle

Un certain nombre de systèmes commerciaux et expérimentaux, tels que le PhotoDater de MyHeritage, qui est livré avec un abonnement, tentent de dater les photos en utilisant ces critères et d’autres.

![Un exemple d'estimation de l'âge d'une photo à partir du service PhotoDater de MyHeritage, réservé aux abonnés. Source [ https://www.youtube.com/watch?v=2oVyLI6tBcY ]](https://www.unite.ai/wp-content/uploads/2025/11/photodater.jpg)

Un exemple d’estimation de l’âge d’une photo, à partir du service PhotoDater de MyHeritage, réservé aux abonnés. Source

En l’absence d’autres signes révélateurs, tels que des smartphones ou d’autres technologies spécifiques à une époque, la meilleure façon de déterminer l’âge d’une photo prise au cours des 15 à 25 dernières années est si vous êtes familiarisé avec la personne (c’est-à-dire une célébrité, ou peut-être un acquantance), et que vous pouvez estimer leur âge, ce qui donne une année approximative.

Âge facial comme référence

Dans le domaine de la vision par ordinateur, et dans divers autres domaines (c’est-à-dire les sciences judiciaires, le traitement d’archives, le journalisme, l’architecture de jeux de données, etc.), la capacité de déterminer l’âge d’une photo est un objectif très prisé, car de nombreuses collections numériques et analogiques les plus intéressantes manquent de métadonnées appropriées ou ont même des métadonnées incorrectes provenant de devinettes précédentes (erronées).

Il serait donc utile si un système d’IA pouvait examiner les photos de la même manière que nous le faisons lorsque nous regardons nos collections historiques, et en commentant ‘Oh oui, c’était quand…’. La question est, quelle pourrait être la base de cette approche, en l’absence des indices habituels ?

Un nouvel article de recherche de la République tchèque propose une première prise en main de cette approche, en exploitant les systèmes de reconnaissance d’âge basés sur l’IA, en concert avec les systèmes de reconnaissance faciale liés à une base de données commune d’identités (dans ce cas, une collection de type IMDB mettant en vedette des artistes et des cinéastes tchèques) :

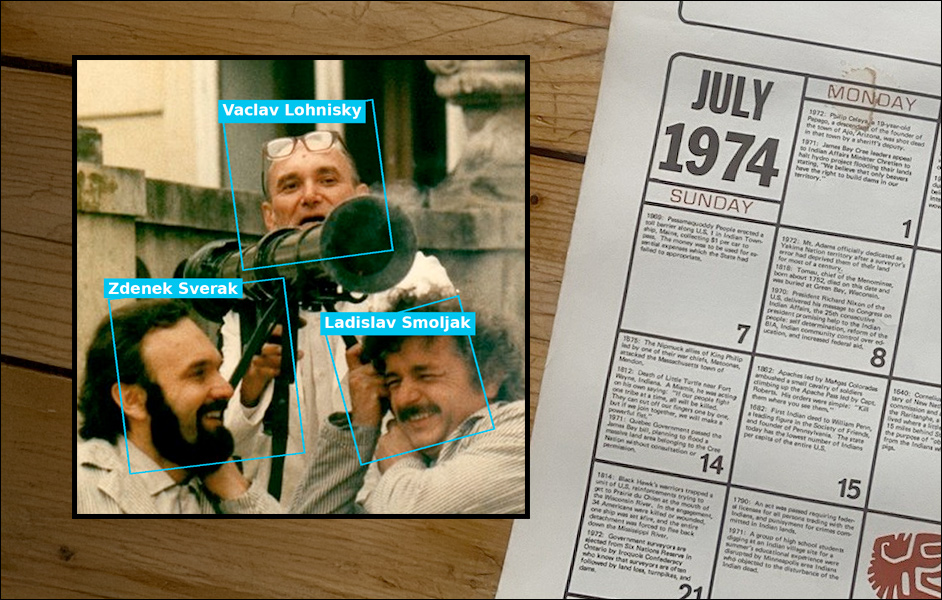

![Une image de Joachim, Mettez-le dans la machine (1974), utilisée pour illustrer le processus de datation. Le modèle détecte les individus connus dans la photo, estime leur âge en utilisant un estimateur d'âge facial (colonne de droite), et soustrait cette valeur de chaque année de naissance de la personne pour générer une distribution de probabilité sur les dates de photo possibles. Les graphiques montrent la probabilité de chaque estimation d'âge, avec des lignes pointillées indiquant l'âge réel de la personne au moment de la photo. [ Source ] https://arxiv.org/pdf/2511.05464](https://www.unite.ai/wp-content/uploads/2025/11/fig-1a-and-1b.jpg)

Une image de ‘Joachim, Mettez-le dans la machine’ (1974), utilisée pour illustrer le processus de datation. Le modèle détecte les individus connus dans la photo, estime leur âge en utilisant un estimateur d’âge facial (colonne de droite), et soustrait cette valeur de chaque année de naissance de la personne pour générer une distribution de probabilité sur les dates de photo possibles. Les graphiques montrent la probabilité de chaque estimation d’âge, avec des lignes pointillées indiquant l’âge réel de la personne au moment de la photo. Source

Le système fonctionne en détectant des individus connus dans une photo, en estimant leur âge facial en utilisant un modèle préentraîné, et en soustrayant cette estimation de leur année de naissance documentée pour générer des dates probables pour la photo. Lorsque plusieurs visages sont présents, les estimations de date sont agrégées pour produire une prédiction finale.

La méthode a été testée sur des images extraites de la base de données de films tchèco-slovaques (CSFD), et l’approche résultante, selon les auteurs, offre une précision constamment meilleure que les modèles basés sur la scène (modèles statiques qui s’appuient sur des éléments de contexte visuel plutôt que sur des visages) formés sur les mêmes données.

Le schéma de cette méthode nécessite une base de données centrale qui contient des connaissances sur un large groupe d’individus ; mais toute collection similaire qui présente des dates de naissance confirmées et des événements à date confirmée pourrait produire un résultat similaire.

L’article indique :

‘De manière unique, notre ensemble de données fournit des annotations pour plusieurs individus dans une seule image, permettant l’étude de l’agrégation d’informations multi-visages. Nous proposons un cadre probabiliste qui combine formellement des preuves visuelles à partir de modèles modernes de reconnaissance faciale et d’estimation d’âge, ainsi que des a priori temporels basés sur la carrière pour déduire l’année de capture de la photo.

‘Nos expériences démontrent que l’agrégation de preuves à partir de plusieurs visages améliore systématiquement les performances, et que l’approche surpasse de manière significative les méthodes de référence basées sur la scène, en particulier pour les images contenant plusieurs individus identifiables.’

Le nouvel article s’intitule Datation de photo par agrégation d’âge facial, et provient de deux chercheurs de l’Université technique de Prague, avec la promesse d’une publication ultérieure du code et des données.

Méthode

Pour estimer quand une photo a été prise, le nouveau système du chercheur examine chaque visage détecté et tente de deviner qui il pourrait être, en utilisant la base de données mentionnée de personnes connues. Puisque une personne ne peut apparaître qu’une seule fois dans une photo, le système vérifie toutes les combinaisons possibles d’identités et utilise leurs années de naissance connues pour deviner à quel âge chaque personne a l’air.

Après cela, il travaille à rebours pour estimer l’année la plus probable qui ferait correspondre ces âges :

Gauche : le système construit une chronologie montrant quand les individus reconnus étaient les plus actifs, en fonction de leurs carrières connues. Droite : ceci est combiné avec des estimations d’âge facial pour produire une estimation finale de quand l’image a été prise.

Pour gérer le grand nombre de combinaisons d’identités possibles, le système suppose que les visages sont indépendants, et que l’apparence de chacun dépend uniquement de son identité et de la date de la photo.

Pour estimer quand une photo a été prise, le système devine d’abord l’âge de chaque visage détecté en utilisant le modèle cvut-002 de NIST, qui est basé sur une architecture ViT-B/16, et formé sur un ensemble de données privé (que les auteurs déclarent classé haut dans la base de données d’évaluation de la technologie d’analyse faciale de NIST (FATE) base de données).

Une fois que l’année de naissance de la personne est connue, le modèle convertit l’estimation d’âge en une année de photo probable en ajoutant simplement l’âge à l’année de naissance, ce qui donne une distribution de probabilité sur les années de capture possibles. Pour évaluer à quel point un visage détecté correspond à une identité connue, le système compare leurs incrustations dans l’espace ArcFace :

![ArcFace, l'architecture centrale contribuant au modèle InsightFace populaire, a été lancée en 2015, destinée à devenir un projet influent dans l'évaluation et l'analyse faciales. [Source ] https://arxiv.org/pdf/1801.07698](https://www.unite.ai/wp-content/uploads/2025/11/arcface.jpg)

ArcFace, l’architecture centrale contribuant au modèle InsightFace populaire, a été lancée en 2015, destinée à devenir un projet influent dans l’évaluation et l’analyse faciales. Source

Chaque identité est représentée par une incrustation moyenne construite à partir de ses portraits de référence. La similarité entre un visage de test et une identité est alors mesurée en utilisant une distribution de Von Mises Fisher, qui modèle la façon dont les portraits d’une identité sont regroupés autour de cette incrustation moyenne. Un paramètre de netteté partagé contrôle la confiance que le système a dans ces regroupements, et est estimé en utilisant une stratégie de suppression d’un élément sur les portraits d’identité.

Le modèle définit cinq types de a priori pour estimer quand une personne reconnue pourrait apparaître dans une photo : uniforme ; décennie ; film ; image ; et un combinatoire convexe a priori qui combine les options les plus fortes et les plus faibles, pour tester la sensibilité à la force de l’a priori (c’est-à-dire la résilience de l’a priori sous contrainte).

Pour gérer les visages qui ne peuvent pas être identifiés avec confiance, le modèle inclut une identité « inconnue » avec des distributions non informatives, présentant une probabilité de visage qui est plate dans l’espace d’incrustation, et un a priori temporel plat sur toutes les années. Cela permet aux visages incertains d’être ignorés sans biaiser l’estimation finale de la date :

Comment la performance est affectée lorsque certains visages dans une image ne peuvent pas être identifiés. Chaque carré montre l’erreur de datation moyenne pour différents nombres d’identités connues et inconnues, avec une taille de carré reflétant à quel point cette combinaison est courante dans l’ensemble de données. L’erreur augmente avec davantage d’inconnus, mais diminue régulièrement à mesure que davantage d’identités connues sont ajoutées.

Données et tests

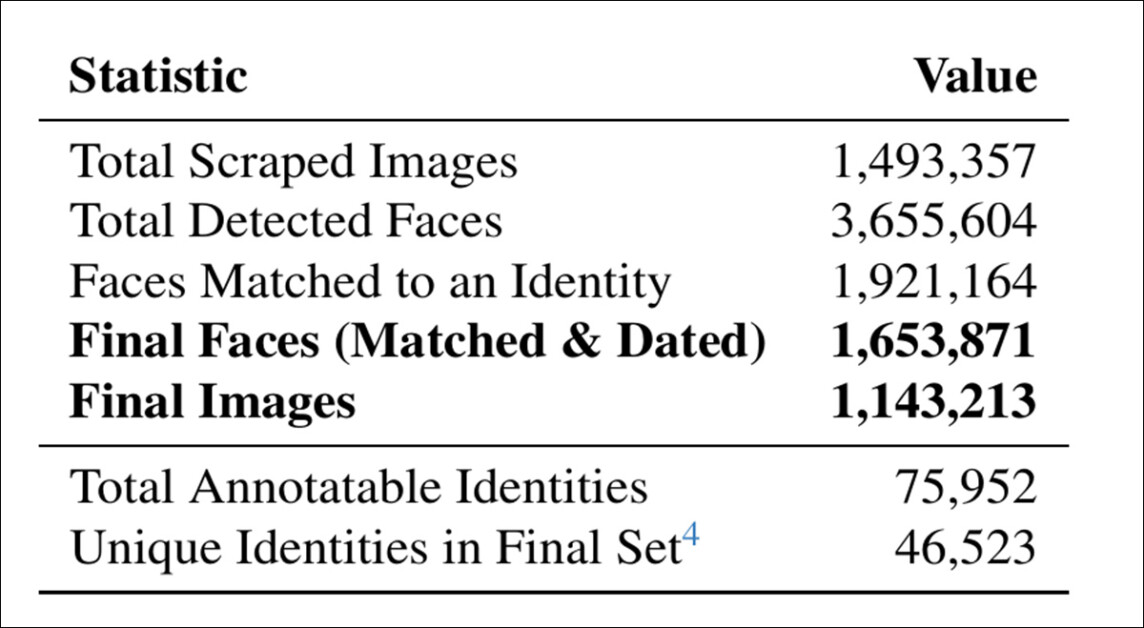

Les auteurs ont utilisé l’ensemble de données CSFD mentionné pour fournir des données à une nouvelle collection qu’ils ont intitulée CSFD-1,6M. L’ensemble de données a été construit à partir de scènes mettant en vedette plusieurs personnes, avec chaque visage étiqueté par identité et année. Cette structure était nécessaire pour enseigner au modèle comment les visages se rapportent les uns aux autres dans le contexte ; les ensembles de données à un visage, tels que IMDB-WIKI, ne le supportent pas, car ils n’étiquettent qu’une seule personne par image.

Les années de sortie de film de la base de données de films tchèco-slovaques ont été utilisées pour estimer quand chaque photo a été prise, avec chaque personne dans l’image correspondant à un profil public présentant son année de naissance et un portrait.

Par la suite, chaque visage de l’image a été associé à l’une des identités connues, initialement en utilisant ArcFace pour créer des incrustations de visage, et en calculant une incrustation moyenne pour chaque identité.

Après cela, l’algorithme hongrois a été utilisé pour attribuer des visages à des identités en comparant la similarité des incrustations, avec des ajustements effectués lorsque le nombre de visages détectés via le cadre SCRFD-10GE ne correspondait pas au nombre d’individus connus.

Statistiques de l’ensemble de données CSFD-1,6M, détaillant les images extraites, les visages détectés, les correspondances d’identité, les échantillons annotés finals et le pool d’identités disponibles.

Les correspondances ont été rejetées si la similarité était trop faible ou si l’âge estimé différait trop de l’âge connu, avec une tolérance plus grande autorisée pour les sujets plus âgés, et les visages n’ont pas été filtrés par qualité ou taille.

Les auteurs notent la supériorité de leur ensemble de données par rapport à celui du jeu de données le plus comparable, IMDB-WIKI :

‘Notre ensemble de données n’est pas seulement nettement plus grand, mais, de manière critique, se compose de scènes à plusieurs personnes requises par notre modèle. Alors que aucun ensemble de données extrait du web n’est exempt de bruit d’étiquetage, notre pipeline d’annotation utilise les liens explicites entre les images et les profils d’identité fournis par la base de données, visant à obtenir des affectations d’identité de meilleure qualité.’

Leur évaluation a comparé plusieurs versions du système de datation, pour comprendre d’où provenaient les gains. Un modèle supposait une connaissance parfaite de qui se trouvait dans l’image, fournissant une limite supérieure de la performance en éliminant toute incertitude dans la reconnaissance d’identité, avec la version complète du modèle qui estimait les identités et les dates conjointement, en pesant différents arrangements d’identité possibles avant d’arriver à une estimation finale d’année.

Une variante plus simple a sélectionné la seule configuration d’identité la plus probable sans marginaliser les alternatives, ce qui s’est avéré presque aussi efficace dans la pratique.

En revanche, la méthode de référence la plus basique a attribué chaque visage de manière indépendante et a combiné les estimations d’âge basées sur l’année résultantes, sans tenir compte du fait que les identités collectives avaient un sens.

Pour tester à quel point la méthode bénéficiait de l’utilisation de visages, un modèle distinct a été formé pour estimer la date directement à partir de la scène entière. Ce modèle basé sur la scène constitue l’approche alternative la plus forte actuellement utilisée dans l’estimation de la date d’une image, car il peut apprendre des modèles visuels spécifiques à une époque sur l’ensemble de l’image, plutôt que de s’appuyer sur l’identité ou l’âge.

Metrics et données

L’erreur absolue moyenne (MAE) entre l’année prédite et la vérité terrain connue a été la mesure centrale pour les expériences.

Les données ont été divisées en cinq parties, avec soin pour s’assurer que toutes les images du même film étaient conservées dans une seule partition. Trois de ces parties ont été utilisées pour la formation, une pour la validation et une pour les tests. Cette rotation à cinq plis a été appliquée pour éviter la suradaptation.

Puisque les modèles basés sur les visages n’ont pas été formés sur cet ensemble de données, aucune division n’a été nécessaire, et ils ont été évalués directement sur l’ensemble complet CSFD-1,6M.

Le modèle de scène a été formé pendant 200 époques sous l’optimiseur Adam, avec des images redimensionnées à une taille de 384×384.

Résultats

La section des résultats de l’article est divisée de manière inhabituelle sur une série d’indicateurs de performance, sans aucun résultat unique ou central. Cependant, nous présenterons une sélection des résultats les plus pertinents ici.

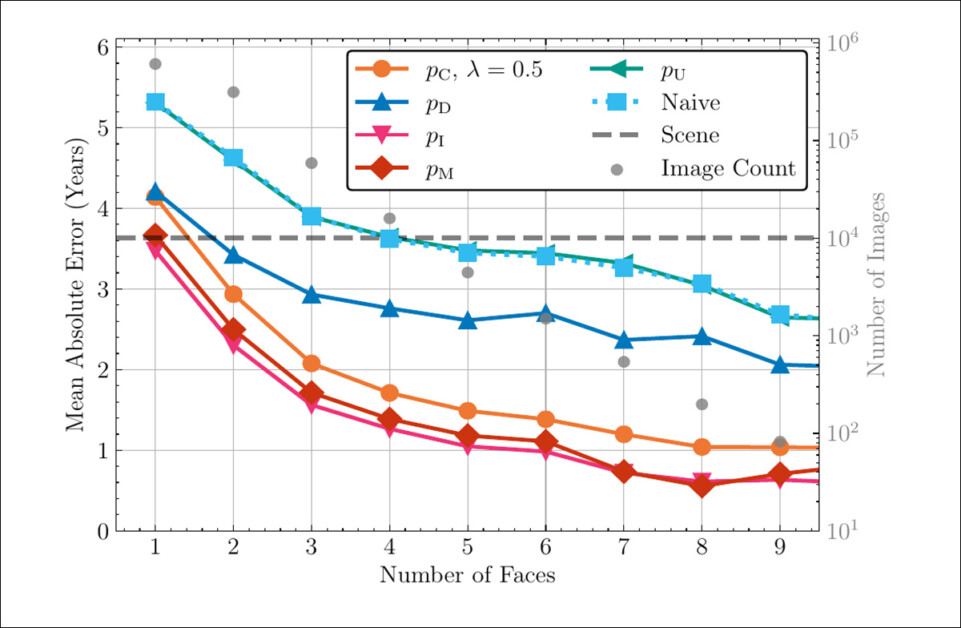

Le résultat le plus important n’est pas un seul nombre, mais un modèle : les modèles d’agrégation faciale (en particulier les variantes complète et Top-1) surpassent constamment la référence scène solide chaque fois que deux identités connues ou plus sont présentes – même si le modèle de scène est formé directement sur l’ensemble de données, ce qui soutient l’affirmation centrale selon laquelle la datation faciale liée à l’identité fournit un signal plus robuste que l’interprétation de la scène holistique.

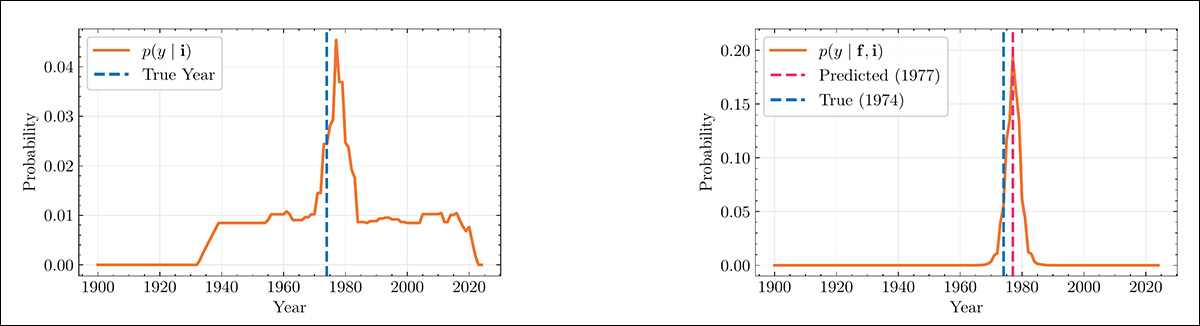

Pour évaluer l’effet des a priori temporels, les auteurs ont comparé plusieurs configurations de leur modèle complet. La performance la plus forte a été obtenue en utilisant l’a priori décennie, qui a surpassé de manière significative à la fois le modèle naïf (qui n’utilise pas d’a priori temporel) et l’a priori uniforme (qui suppose aucune préférence pour les années) :

La performance chute fortement pour toutes les méthodes à mesure que le nombre de visages augmente, mais les modèles utilisant des a priori temporels réalistes, tels que l’a priori décennie, sont affectés beaucoup moins. Les références Naive et Scene restent plates ou se dégradent avec des groupes plus importants, tandis que le modèle complet guidé par des a priori informatifs maintient une faible erreur. Les a priori basés sur l’oracle, qui s’appuient sur les statistiques du jeu de test, définissent la limite inférieure des performances réalisables.

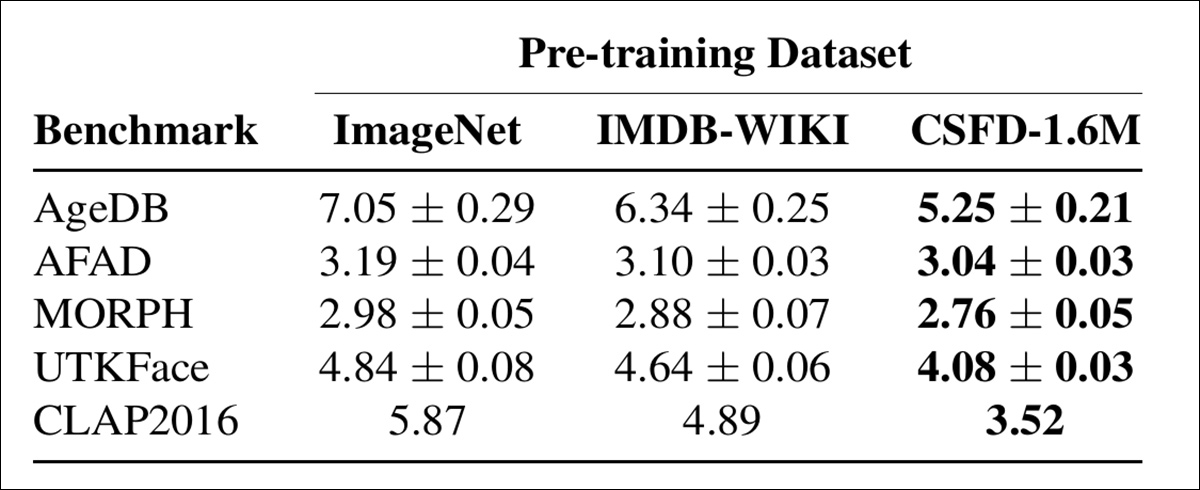

Pour démontrer la valeur de CSFD-1,6M au-delà de la datation de photo, l’ensemble de données a également été testé en tant que ressource de préformation pour la tâche plus large d’estimation de l’âge facial. En suivant un protocole d’évaluation standard, des modèles ResNet101 ont été préformés sur CSFD-1,6M, et comparés à des homologues préformés sur IMDB-WIKI et ImageNet. Ces modèles ont ensuite été affinés et évalués sur cinq références populaires : AgeDB ; AFAD, MORPH ; UTKFace ; et CLAP2016 :

Erreur absolue moyenne (plus ou moins l’écart-type) sur cinq références d’estimation d’âge, en comparant les modèles préformés sur ImageNet, IMDB-WIKI et CSFD-1,6M. Des valeurs plus faibles indiquent de meilleures performances. CSFD-1,6M donne les résultats les plus forts sur toutes les références.

Sur les cinq ensembles de données, la préformation sur CSFD-1,6M a conduit aux taux d’erreur les plus bas, surpassant les deux autres sources de préformation d’une marge claire – un écart de performance qui s’est avéré le plus fort sur AFAD et CLAP2016, mais est resté constant dans l’ensemble.

Nous renvoyons le lecteur au reste de la section des résultats quelque peu fragmentée de l’article source, qui traite également de manière approfondie des études d’ablation.

Conclusion

Bien que le nouvel article devienne rapidement dense et inaccessible pour le lecteur occasionnel, le sujet abordé est l’un des plus intéressants et des plus pertinents dans la littérature de la vision par ordinateur – non seulement parce qu’il chevauche adroitement l’anthropologie et les études culturelles, où les constantes sont difficiles à déterminer.

* De même que l’évolution musicale a également ralenti son rythme de changement.

Publié pour la première fois lundi 10 novembre 2025