Intelligence artificielle

Une prise personnelle sur les tendances de la littérature de la vision par ordinateur en 2024

J’ai suivi en continu la scène de la recherche en vision par ordinateur (CV) et en synthèse d’images sur Arxiv et ailleurs pendant environ cinq ans, donc les tendances deviennent évidentes au fil du temps, et elles changent de direction chaque année.

Par conséquent, à mesure que 2024 se termine, j’ai pensé qu’il était approprié de jeter un coup d’œil à certaines nouvelles caractéristiques ou en évolution dans les soumissions Arxiv dans la section Vision par ordinateur et reconnaissance de formes section. Ces observations, bien que informées par des centaines d’heures d’étude de la scène, sont strictement des anecdotas.

L’essor continu de l’Asie de l’Est

À la fin de 2023, j’avais remarqué que la majorité de la littérature dans la catégorie de la synthèse vocale provenait de Chine et d’autres régions d’Asie de l’Est. À la fin de 2024, je dois observer (de manière anecdotique) que cela s’applique maintenant également à la scène de la recherche en synthèse d’images et de vidéos.

Cela ne signifie pas que la Chine et les pays adjacents produisent nécessairement toujours les meilleurs travaux (en effet, il existe certaines preuves contraires) ; ni cela ne tient compte de la grande probabilité en Chine (comme en Occident) que certaines des systèmes les plus intéressants et les plus puissants en développement soient propriétaires et exclus de la littérature de recherche.

Mais cela suggère que l’Asie de l’Est bat l’Occident en termes de volume, à cet égard. Ce que cela vaut dépend de l’étendue à laquelle vous croyez dans la viabilité de la persistance d’Edison, qui s’avère généralement inefficace face à des obstacles intractables.

Il existe de nombreux obstacles de ce type dans l’IA générative, et il n’est pas facile de savoir lesquels peuvent être résolus en s’attaquant aux architectures existantes, et lesquels devront être réexaminés à partir de zéro.

Bien que les chercheurs d’Asie de l’Est semblent produire un plus grand nombre de documents de recherche en vision par ordinateur, j’ai remarqué une augmentation de la fréquence de projets de type “Frankenstein” – des initiatives qui constituent un mélange de travaux antérieurs, tout en ajoutant une nouveauté architecturale limitée (ou peut-être juste un type de données différent).

Cette année, un nombre nettement plus élevé de collaborations d’Asie de l’Est (principalement chinoises ou impliquant des collaborations chinoises) semblent être motivées par des quotas plutôt que par le mérite, augmentant considérablement le rapport signal/bruit dans un domaine déjà surabondant.

En même temps, un plus grand nombre de documents d’Asie de l’Est ont également retenu mon attention et mon admiration en 2024. Donc, si c’est tout un jeu de nombres, cela ne rate pas – mais cela ne coûte pas non plus cher.

Augmentation du volume des soumissions

Le volume de documents, provenant de tous les pays d’origine, a visiblement augmenté en 2024.

Le jour de publication le plus populaire change tout au long de l’année ; actuellement, c’est le mardi, lorsque le nombre de soumissions à la section Vision par ordinateur et reconnaissance de formes est souvent d’environ 300-350 en une seule journée, dans les périodes de pointe (mai-août et octobre-décembre, c’est-à-dire la saison des conférences et la saison de la date limite des quotas annuels, respectivement).

Au-delà de mon expérience personnelle, Arxiv lui-même rapporte un record du nombre de soumissions en octobre 2024, avec 6000 nouvelles soumissions au total, et la section Vision par ordinateur est la deuxième section la plus soumise après l’apprentissage automatique.

Cependant, puisque la section Apprentissage automatique d’Arxiv est souvent utilisée comme une catégorie agrégée ou supplémentaire, cela plaide en faveur de la Vision par ordinateur et de la reconnaissance de formes comme la catégorie la plus soumise d’Arxiv.

Les statistiques propres d’Arxiv dépeignent clairement l’informatique comme le leader clair des soumissions :

Les sciences de l’informatique (CS) dominent les statistiques de soumission d’Arxiv au cours des cinq dernières années. Source : https://info.arxiv.org/about/reports/submission_category_by_year.html

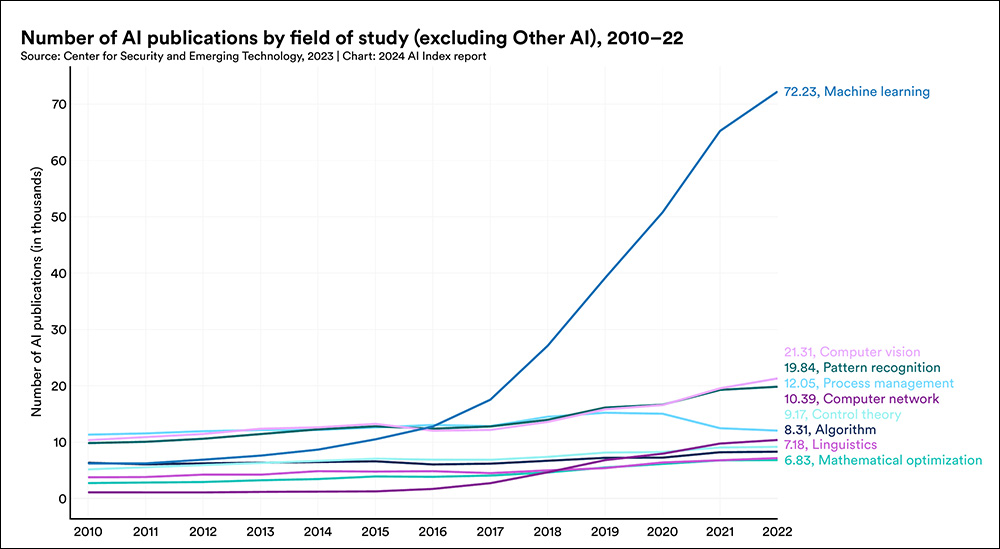

L’Index IA de l’Université de Stanford 2024, bien que ne pouvant pas encore signaler les statistiques les plus récentes, met également l’accent sur l’augmentation notable des soumissions de documents universitaires sur l’apprentissage automatique au cours des dernières années :

Bien que les chiffres ne soient pas disponibles pour 2024, le rapport de Stanford montre néanmoins de manière spectaculaire l’augmentation du volume des soumissions de documents sur l’apprentissage automatique. Source : https://aiindex.stanford.edu/wp-content/uploads/2024/04/HAI_AI-Index-Report-2024_Chapter1.pdf

Diffusion>Mesh Frameworks se multiplient

Une autre tendance claire qui est apparue pour moi est une forte augmentation des documents qui traitent de l’utilisation de modèles de diffusion latente (LDM) comme générateurs de modèles CGI à base de maillage.

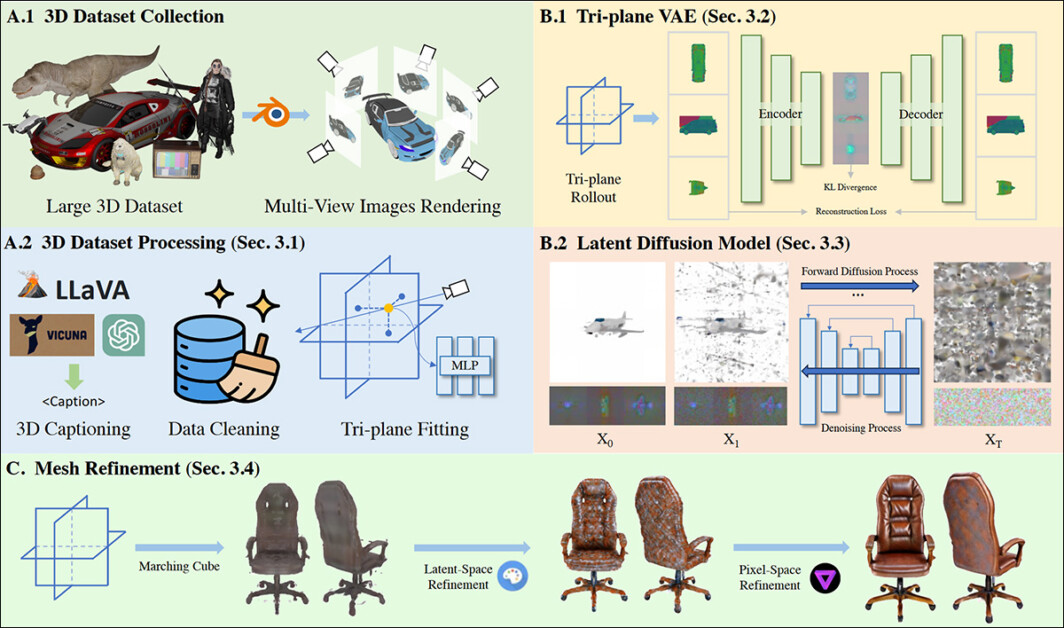

Les projets de ce type incluent InstantMesh3D de Tencent, 3Dtopia, Diffusion2, V3D, MVEdit, et GIMDiffusion, parmi une multitude d’autres offres similaires.

Génération et raffinement de maillage via un processus basé sur la diffusion dans 3Dtopia. Source : https://arxiv.org/pdf/2403.02234

Ce domaine de recherche émergent peut être considéré comme une concession tacite à l’intractabilité persistante des systèmes génératifs tels que les modèles de diffusion, qui il y a seulement deux ans étaient présentés comme un substitut potentiel à tous les systèmes que les modèles de diffusion>maillage cherchent maintenant à peupler ; en reléguant la diffusion au rôle d’un outil dans les technologies et les flux de travail qui remontent à trente ans ou plus.

Stability.ai, originaire du modèle open source Stable Diffusion, vient de sortir Stable Zero123, qui peut, entre autres choses, utiliser une interprétation de Neural Radiance Fields (NeRF) d’une image générée par IA comme un pont pour créer un modèle CGI explicite à base de maillage qui peut être utilisé dans les arènes CGI telles que Unity, dans les jeux vidéo, la réalité augmentée et sur d’autres plateformes qui nécessitent des coordonnées 3D explicites, par opposition aux coordonnées implicites (cachées) des fonctions continues.

Cliquez pour jouer. Les images générées dans Stable Diffusion peuvent être converties en maillages CGI rationnels. Ici, nous voyons le résultat d’un flux de travail d’image à CGI à l’aide de Stable Zero 123. Source : https://www.youtube.com/watch?v=RxsssDD48Xc

Sémantique 3D

L’espace de l’IA générative fait une distinction entre les systèmes de vision et les systèmes génératifs 2D et 3D. Par exemple, les cadres de repérage facial, bien qu’ils représentent des objets 3D (visages) dans tous les cas, ne calculent pas nécessairement des coordonnées 3D adressables.

Le système FANAlign populaire FANAlign, largement utilisé dans les architectures de deepfake de 2017 (entre autres), peut accueillir les deux approches :

Au-dessus, les repères 2D sont générés sur la base des seuls linéaments et caractéristiques du visage reconnus. En dessous, ils sont rationalisés dans l’espace 3D X/Y/Z. Source : https://github.com/1adrianb/face-alignment

Donc, tout comme « deepfake » est devenu un terme ambigu et détourné, « 3D » est également devenu un terme confus dans la recherche en vision par ordinateur.

Pour les consommateurs, il a généralement signifié des médias stéréo (tels que des films où le spectateur doit porter des lunettes spéciales) ; pour les praticiens des effets visuels et les modeliseurs, il fournit la distinction entre l’art 2D (tel que des esquisses conceptuelles) et les modèles à base de maillage qui peuvent être manipulés dans un « programme 3D » comme Maya ou Cinema4D.

Mais en vision par ordinateur, cela signifie simplement qu’un système de coordonnées cartésiennes existe quelque part dans l’espace latent du modèle – pas qu’il puisse nécessairement être adressé ou directement manipulé par un utilisateur ; du moins, pas sans des systèmes interprétatifs CGI basés sur des tiers tels que 3DMM ou FLAME.

Par conséquent, la notion de diffusion>3D est inexacte ; non seulement n’importe quel type d’image (y compris une photo réelle) peut être utilisé comme entrée pour produire un modèle CGI génératif, mais le terme moins ambigu « maillage » est plus approprié.

Cependant, pour aggraver l’ambiguïté, la diffusion est nécessaire pour interpréter la photo source en un maillage, dans la majorité des projets émergents. Un meilleure description pourrait donc être image-to-mesh, tandis que image>diffusion>mesh est une description encore plus précise.

Mais c’est un argument difficile à présenter lors d’une réunion du conseil d’administration, ou dans un communiqué de presse conçu pour engager les investisseurs.

Preuves d’impasses architecturales

Même par rapport à 2023, la récolte de documents de l’année dernière présente une augmentation de la désespérance autour de la suppression des limites pratiques difficiles de la génération basée sur la diffusion.

Le principal obstacle reste la génération de vidéos narrativement et temporellement cohérentes, et le maintien d’une apparence cohérente des personnages et des objets – non seulement à travers différents clips vidéo, mais même à travers la courte durée d’un seul clip vidéo généré.

La dernière innovation époquale dans la synthèse basée sur la diffusion a été l’avènement de LoRA en 2022. Alors que de nouveaux systèmes tels que Flux ont amélioré certains des problèmes de valeurs aberrantes, tels que l’incapacité antérieure de Stable Diffusion à reproduire le contenu textuel à l’intérieur d’une image générée, et que la qualité globale de l’image s’est améliorée, la majorité des documents que j’ai étudiés en 2024 étaient essentiellement juste en train de déplacer la nourriture sur l’assiette.

Ces impasses se sont produites auparavant, avec les réseaux antagonistes génératifs (GAN) et les champs de rayonnement neural (NeRF), qui n’ont pas tenu leurs promesses initiales – et qui sont de plus en plus utilisés dans des systèmes plus conventionnels (comme l’utilisation de NeRF dans Stable Zero 123, voir ci-dessus). Cela semble également se produire avec les modèles de diffusion.

Recherche sur le splatting gaussien

Il semblait à la fin de 2023 que la méthode de rasterisation 3D Gaussian Splatting (3DGS), qui a fait ses débuts comme technique d’imagerie médicale dans les années 90, allait soudainement surpasser les systèmes basés sur les auto-encodeurs pour les défis de synthèse d’images humaines (tels que la simulation et la reproduction faciales, ainsi que le transfert d’identité).

Le document ASH de 2023 promettait des humains 3DGS complets, tandis que Gaussian Avatars offrait un détail massivement amélioré (par rapport aux méthodes concurrentes basées sur les auto-encodeurs et autres), ainsi qu’une réédition impressionnante.

Cette année, cependant, a été relativement pauvre en moments de percée pour la synthèse humaine 3DGS ; la plupart des documents qui ont abordé le problème étaient soit dérivés des travaux ci-dessus, soit n’ont pas dépassé leurs capacités.

Au lieu de cela, l’accent a été mis sur l’amélioration de la faisabilité architecturale fondamentale du 3DGS, ce qui a conduit à une multitude de documents qui proposent des environnements extérieurs 3DGS améliorés. Une attention particulière a été portée aux approches de localisation et de cartographie simultanées (SLAM) 3DGS, dans des projets tels que Gaussian Splatting SLAM, Splat-SLAM, Gaussian-SLAM, DROID-Splat, parmi beaucoup d’autres.

Les projets qui ont tenté de poursuivre ou d’étendre la synthèse humaine basée sur les splats incluent MIGS, GEM, EVA, OccFusion, FAGhead, HumanSplat, GGHead, HGM, et Topo4D. Bien qu’il y en ait d’autres, aucun de ces documents n’a atteint l’impact initial des documents qui ont émergé à la fin de 2023.

L’ère Weinstein des échantillons de test est en déclin

Les recherches menées en Asie du Sud-Est en général (et en Chine en particulier) présentent souvent des exemples de test qui sont problématiques à republier dans un article de revue, car ils contiennent du matériel qui est un peu « piquant ».

Que les chercheurs en Asie de l’Est cherchent à attirer l’attention sur leurs sorties est débattu ; mais au cours des 18 derniers mois, un nombre croissant de documents sur l’IA générative (synthèse d’images et/ou de vidéos) ont utilisé par défaut de jeunes femmes et filles légèrement vêtues dans les exemples de projet. Des exemples limite NSFW incluent UniAnimate, ControlNext, et même des documents très « sèches » tels que Évaluation de la cohérence du mouvement par la distance de mouvement de Fréchet (FVMD).

Ceci suit les tendances générales des sous-reddits et des communautés qui se sont rassemblées autour des modèles de diffusion latente (LDM), où la règle 34 reste très présente.

Confrontation de célébrités

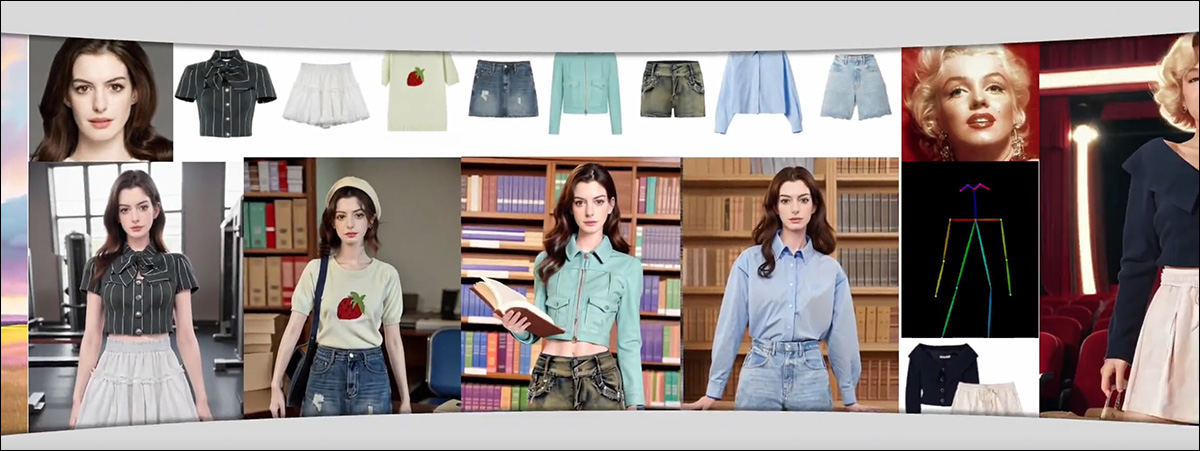

Ce type d’exemple inapproprié chevauche la reconnaissance croissante du fait que les processus IA ne devraient pas exploiter arbitrairement les ressemblances de célébrités – en particulier dans les études qui utilisent des exemples mettant en vedette des célébrités attirantes, souvent féminines, et les placent dans des contextes discutables.

Un exemple est AnyDressing, qui, outre le fait de mettre en vedette des personnages féminins jeunes et de style anime, utilise également librement les identités de célébrités classiques telles que Marilyn Monroe, et des célébrités actuelles telles qu’Ann Hathaway (qui a dénoncé ce type d’utilisation très ouvertement).

L’utilisation arbitraire de célébrités actuelles et « classiques » est encore relativement courante dans les documents d’Asie de l’Est, bien que cette pratique soit légèrement en déclin. Source : https://crayon-shinchan.github.io/AnyDressing/

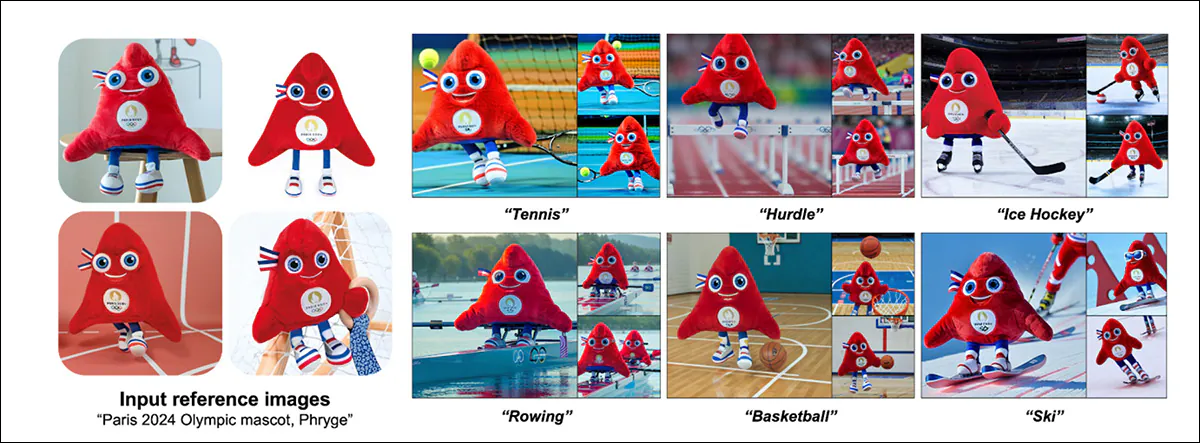

Dans les documents occidentaux, cette pratique particulière est nettement en déclin tout au long de 2024, menée par les principales sorties de FAANG et d’autres grands organismes de recherche tels qu’OpenAI. Critiquement conscients du potentiel de litiges futurs, ces grands acteurs corporatifs semblent de plus en plus réticents à représenter même des personnages fictifs photoréalistes.

Bien que les systèmes qu’ils créent (tels que Imagen et Veo2) soient clairement capables d’une telle sortie, les exemples de projets de l’IA générative occidentale tendent désormais vers des images et des vidéos « mignonnes », « disneyfiées » et extrêmement « sûres ».

Malgré la capacité d’Imagen à créer des sorties « photoréalistes », les exemples promus par Google Research sont généralement des contenus fantastiques et « familiaux » – les humains photoréalistes sont soigneusement évités, ou des exemples minimalistes sont fournis. Source : https://imagen.research.google/

Lavage de visage

Dans la littérature CV occidentale, cette approche démagogique est particulièrement évidente pour les systèmes de personnalisation – des méthodes capables de créer des ressemblances cohérentes d’une personne particulière à travers plusieurs exemples (c’est-à-dire comme LoRA et l’ancien DreamBooth).

Des exemples incluent l’incrustation visuelle orthogonale, LoRA-Composer, InstructBooth de Google, et bien d’autres.

InstructBooth de Google met le facteur de mignonnerie à 11, même si l’histoire suggère que les utilisateurs sont plus intéressés à créer des humains photoréalistes que des personnages mignons ou pelucheux. Source : https://sites.google.com/view/instructbooth

Cependant, l’essor du « mignon exemple » est visible dans d’autres domaines de recherche en CV et en synthèse, dans des projets tels que Comp4D, V3D, DesignEdit, UniEdit, FaceChain (qui concède à des attentes utilisateur plus réalistes sur sa page GitHub), et DPG-T2I, parmi beaucoup d’autres.

La facilité avec laquelle de tels systèmes (tels que LoRAs) peuvent être créés par des utilisateurs à domicile avec un matériel relativement modeste a conduit à une explosion de modèles de célébrités téléchargeables gratuitement sur le domaine civit.ai et la communauté. Un tel usage illicite reste possible grâce à la mise en open source d’architectures telles que Stable Diffusion et Flux.

Bien que soit possible de contourner les fonctionnalités de sécurité des systèmes de texte à image (T2I) et de texte à vidéo (T2V) génératifs pour produire du contenu interdit par les conditions d’utilisation d’une plateforme, l’écart entre les capacités restreintes des meilleurs systèmes (tels que RunwayML et Sora) et les capacités illimitées des systèmes simplement performants (tels que Stable Video Diffusion, CogVideo et les déploiements locaux de Hunyuan) n’est pas vraiment en train de se refermer, comme beaucoup le croient.

Au lieu de cela, ces systèmes propriétaires et open source, respectivement, menacent de devenir également inutiles : les systèmes T2V hyperscale et coûteux peuvent devenir excessivement bridés en raison de la peur des litiges, tandis que le manque d’infrastructure de licence et de surveillance des ensembles de données dans les systèmes open source pourrait les verrouiller complètement sur le marché à mesure que des réglementations plus strictes sont mises en œuvre.

Publié pour la première fois mardi 24 décembre 2024