Intelligence artificielle

Pourquoi les systèmes de vidéo générative ne peuvent-ils pas créer des films complets ?

L’avènement et le progrès de la vidéo générative basée sur l’intelligence artificielle ont incité de nombreux observateurs occasionnels à prévoir que l’apprentissage automatique entraînera la mort de l’industrie cinématographique telle que nous la connaissons – au lieu de cela, des créateurs individuels pourront créer des blockbusters de style hollywoodien à la maison, soit sur des systèmes GPU locaux, soit sur des systèmes basés sur le cloud.

Est-ce possible ? Même si c’est possible, est-ce imminent, comme le croient tant de gens ?

Qu’il soit possible pour les individus de créer des films, sous la forme que nous connaissons, avec des personnages cohérents, une continuité narrative et une photoréalisme totale, est tout à fait possible – et peut-être même inévitable.

Cependant, il existe plusieurs raisons fondamentales pour lesquelles cela ne devrait pas se produire avec des systèmes de vidéo basés sur les modèles de diffusion latente.

Ce dernier fait est important, car, pour le moment, cette catégorie comprend tous les systèmes populaires de texte-vidéo (T2) et d’image-vidéo (I2V) disponibles, y compris Minimax, Kling, Sora, Imagen, Luma, Amazon Video Generator, Runway ML, Kaiber (et, autant que nous puissions le discerner, la fonctionnalité vidéo pendant d’Adobe Firefly) ; parmi de nombreux autres.

Ici, nous considérons la perspective de véritables productions de auteur à long métrage générées par ordinateur, créées par des individus, avec des personnages cohérents, une cinématographie et des effets visuels d’au moins au niveau de l’état actuel de l’art à Hollywood.

Examinons certains des plus grands obstacles pratiques aux défis impliqués.

1 : Vous ne pouvez pas obtenir une suite de plans précise

L’incohérence narrative est le plus important de ces obstacles. Le fait est que aucun système de génération de vidéo actuellement disponible ne peut faire une véritable suite de plans précise*.

C’est parce que le modèle de diffusion de débruitage au cœur de ces systèmes repose sur du bruit aléatoire, et que ce principe fondamental n’est pas adaptable à la réinterprétation exacte du même contenu deux fois (c’est-à-dire, à partir de différents angles, ou en développant le plan précédent en une suite de plans qui maintient la cohérence avec le plan précédent).

Lorsque des invites de texte sont utilisées, seules ou avec des images ‘graines’ téléchargées (entrée multimodale), les jetons dérivés de l’invite éliciteront un contenu sémantiquement approprié de l’espace latent du modèle.

Cependant, davantage entravé par le facteur de « bruit aléatoire », il ne le fera jamais de la même manière deux fois.

Cela signifie que les identités des personnes dans la vidéo auront tendance à changer, et les objets et les environnements ne correspondront pas au plan initial.

C’est pourquoi les extraits virals présentant des visuels extraordinaires et une sortie de style hollywoodien ont tendance à être soit des plans uniques, soit un « montage de démonstration » des capacités du système, où chaque plan présente des personnages et des environnements différents.

Extraits d’un montage de génération d’IA de Marco van Hylckama Vlieg – source : https://www.linkedin.com/posts/marcovhv_thanks-to-generative-ai-we-are-all-filmmakers-activity-7240024800906076160-nEXZ/

L’implication dans ces collections de générations de vidéo ad hoc (qui peuvent être trompeuses dans le cas de systèmes commerciaux) est que le système sous-jacent peut créer des récits contigus et cohérents.

L’analogie utilisée ici est un trailer de film, qui ne présente que une minute ou deux de footage du film, mais donne au public une raison de croire que le film entier existe.

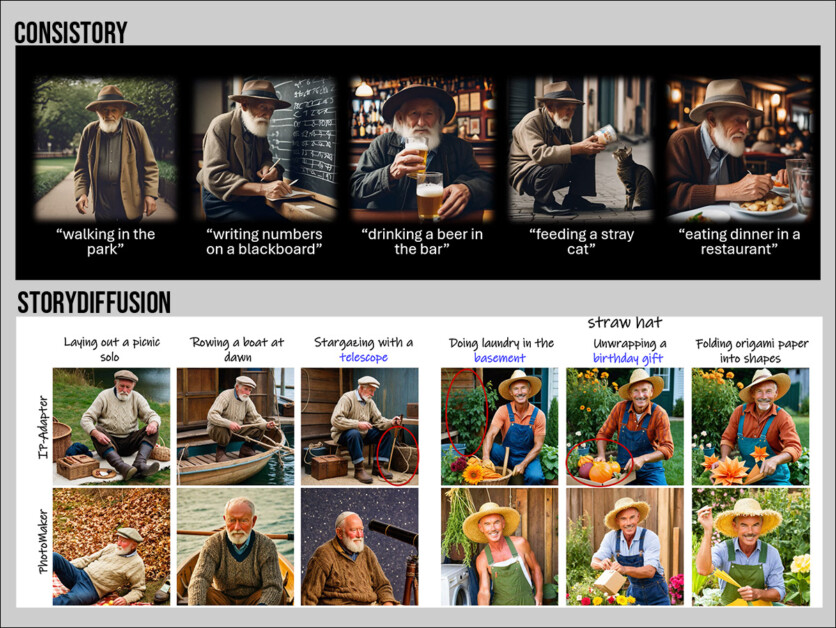

Les seuls systèmes qui offrent actuellement une cohérence narrative dans un modèle de diffusion sont ceux qui produisent des images fixes. Ceux-ci incluent ConsiStory de NVIDIA, et divers projets dans la littérature scientifique, tels que TheaterGen, DreamStory, et StoryDiffusion.

Deux exemples de ‘cohérence narrative statique’, à partir de modèles récents : Sources : https://research.nvidia.com/labs/par/consistory/ et https://arxiv.org/pdf/2405.01434

En théorie, on pourrait utiliser une version améliorée de tels systèmes (aucun des précédents n’est vraiment cohérent) pour créer une série de plans d’image à vidéo, qui pourraient être assemblés en une séquence.

À l’état actuel de l’art, cette approche ne produit pas de plans de suite plausibles ; et, dans tous les cas, nous avons déjà dévié du rêve auteur en ajoutant une couche de complexité.

Nous pouvons, en outre, utiliser des modèles d’adaptation de bas rang (LoRA), spécifiquement formés sur des personnages, des choses ou des environnements, pour maintenir une meilleure cohérence entre les plans.

Cependant, si un personnage souhaite apparaître dans une nouvelle tenue, un LoRA entièrement nouveau devra généralement être formé pour incarner le personnage vêtu de cette façon (bien que des sous-concepts tels que ‘robe rouge’ puissent être formés dans des LoRAs individuels, ainsi que des images appropriées, ils ne sont pas toujours faciles à travailler).

Cela ajoute une complexité considérable, même à une scène d’ouverture dans un film, où une personne se lève, met une robe de chambre, bâille, regarde par la fenêtre de la chambre et va à la salle de bain pour se brosser les dents.

Une telle scène, contenant environ 4-8 plans, peut être filmée en une matinée par des procédures de réalisation de films conventionnelles ; à l’état actuel de l’art en intelligence artificielle générative, elle représente potentiellement des semaines de travail, de multiples LoRAs formés (ou d’autres systèmes auxiliaires) et une quantité considérable de post-production

Alternativement, la vidéo-vidéo peut être utilisée, où des footage ordinaires ou des effets visuels sont transformés par des invites de texte en interprétations alternatives. Runway offre un tel système, par exemple.

CGI (à gauche) à partir de Blender, interprété dans une expérience de vidéo-vidéo aidée par texte de Runway par Mathieu Visnjevec – Source : https://www.linkedin.com/feed/update/urn:li:activity:7240525965309726721/

Il y a deux problèmes ici : vous devez déjà créer les footage de base, vous faites donc déjà le film deux fois, même si vous utilisez un système synthétique tel que MetaHuman d’UnReal.

Si vous créez des modèles CGI (comme dans la séquence ci-dessus) et les utilisez dans une transformation d’image à vidéo, leur cohérence entre les plans ne peut pas être garantie.

C’est parce que les modèles de diffusion de vidéo ne voient pas le « grand tableau » – ils créent plutôt un nouveau cadre en fonction des cadres précédents, et, dans certains cas, prennent en compte un cadre futur proche ; mais, pour comparer le processus à une partie d’échecs, ils ne peuvent pas réfléchir « dix coups à l’avance » et ne peuvent pas se souvenir de dix coups en arrière.

Deuxièmement, un modèle de diffusion aura toujours du mal à maintenir une apparence cohérente entre les plans, même si vous incluez plusieurs LoRAs pour les personnages, les environnements et le style d’éclairage, pour les raisons mentionnées au début de cette section.

2 : Vous ne pouvez pas éditer un plan facilement

Si vous dépeignez un personnage marchant dans la rue en utilisant des méthodes de CGI traditionnelles, et que vous décidez que vous voulez modifier un aspect du plan, vous pouvez ajuster le modèle et le rendre à nouveau.

Si c’est un tournage en réalité, vous réinitialisez simplement et vous le tournez à nouveau, avec les modifications appropriées.

Cependant, si vous produisez un plan de vidéo générée par IA que vous aimez, mais que vous voulez modifier un aspect de celui-ci, vous ne pouvez le faire qu’en utilisant des méthodes de post-production fastidieuses développées au cours des 30-40 dernières années : CGI, rotoscopie, modelage et masquage – toutes des procédures laborieuses et coûteuses, chronophages .

La façon dont les modèles de diffusion fonctionnent, même en changeant un seul aspect d’une invite de texte (même dans une invite multimodale, où vous fournissez une image de graine source complète) changera plusieurs aspects de la sortie générée, conduisant à un jeu de « whack-a-mole » d’invite.

3 : Vous ne pouvez pas vous fier aux lois de la physique

Les méthodes de CGI traditionnelles offrent une variété de modèles algorithmiques basés sur la physique qui peuvent simuler des choses telles que la dynamique des fluides, le mouvement gazeux, la cinématique inverse (la modélisation précise du mouvement humain), la dynamique des tissus, les explosions et divers autres phénomènes du monde réel.

Cependant, les méthodes basées sur la diffusion, comme nous l’avons vu, ont une mémoire courte et une gamme limitée de prédictions de mouvement (exemples de telles actions, inclus dans l’ensemble de formation) à partir desquelles puiser.

Dans une version antérieure de la page d’accueil d’OpenAI pour le système de génération Sora, l’entreprise a reconnu que Sora a des limites à cet égard (bien que ce texte ait depuis été supprimé) :

‘[Sora] peut avoir du mal à simuler la physique d’une scène complexe, et peut ne pas comprendre des instances spécifiques de cause et d’effet (par exemple : un cookie peut ne pas montrer une marque après qu’un personnage l’a mordu).

‘Le modèle peut également confondre des détails spatiaux inclus dans une invite, tels que discerner la gauche de la droite, ou lutter avec des descriptions précises d’événements qui se déroulent dans le temps, comme des trajectoires de caméra spécifiques.’

L’utilisation pratique de divers systèmes de génération de vidéo basés sur l’API révèle des limitations similaires dans la représentation de la physique précise. Cependant, certains phénomènes physiques courants, comme les explosions, semblent être mieux représentés dans leurs ensembles de formation.

Certains embeddings de mouvement antérieur, soit formés dans le modèle génératif, soit alimentés à partir d’une vidéo source, prennent un certain temps à compléter (comme une personne effectuant une séquence de danse complexe et non répétitive dans un costume élaboré) et, une fois de plus, la fenêtre d’attention myope du modèle de diffusion est susceptible de transformer le contenu (identité faciale, détails de costume, etc.) une fois que le mouvement s’est déroulé. Cependant, les LoRAs peuvent atténuer cela, dans une certaine mesure.

Corriger en post-production

Il existe d’autres lacunes dans la génération de vidéo purement basée sur l’IA, telles que la difficulté qu’elles ont à dépeindre des mouvements rapides, et le problème général et bien plus pressant d’ obtenir une cohérence temporelle dans la vidéo de sortie.

En outre, la création de performances faciales spécifiques est pratiquement une question de chance dans la vidéo générative, tout comme la synchronisation labiale pour le dialogue.

Dans les deux cas, l’utilisation de systèmes auxiliaires tels que LivePortrait et AnimateDiff devient très populaire dans la communauté VFX, car cela permet la transposition d’au moins de larges expressions faciales et de synchronisation labiale à la sortie générée existante.

Un exemple de transfert d’expression (vidéo de conduite en bas à gauche) imposé à une vidéo cible avec LivePortrait. La vidéo est de Generative Z TunisiaGenerative. Voir la version longue en meilleure qualité à https://www.linkedin.com/posts/genz-tunisia_digitalcreation-liveportrait-aianimation-activity-7240776811737972736-uxiB/?

De plus, une myriade de solutions complexes, incorporant des outils tels que l’interface utilisateur ComfyUI ComfyUI de Stable Diffusion et l’application de composition et de manipulation professionnelle Nuke, ainsi que la manipulation de l’espace latent, permettent aux praticiens d’effets visuels basés sur l’IA d’avoir un contrôle plus grand sur l’expression faciale et l’attitude.

Bien qu’il décrit le processus d’animation faciale dans ComfyUI comme « torture », le professionnel des effets visuels Francisco Contreras a développé une telle procédure, qui permet l’imposition de phonèmes de lèvres et d’autres aspects de la représentation de la tête.

Stable Diffusion, aidée par un flux de travail ComfyUI alimenté par Nuke, a permis au professionnel des effets visuels Francisco Contreras d’avoir un contrôle inhabituel sur les aspects faciaux. Pour la vidéo complète, à une résolution meilleure, allez à https://www.linkedin.com/feed/update/urn:li:activity:7243056650012495872/

Conclusion

Rien de tout cela n’est prometteur pour la perspective d’un utilisateur unique générant des films complets de style blockbuster, avec un dialogue réaliste, une synchronisation labiale, des performances, des environnements et une continuité cohérents.

De plus, les obstacles décrits ici, du moins en relation avec les modèles de vidéo générative basés sur la diffusion, ne sont pas nécessairement solvables « d’ici peu », malgré les commentaires de forum et l’attention des médias qui font ce cas. Les contraintes décrites semblent être intrinsèques à l’architecture.

Dans la recherche de synthèse d’IA, comme dans toute recherche scientifique, des idées brillantes nous éblouissent périodiquement avec leur potentiel, pour que des recherches plus approfondies découvrent leurs limites fondamentales.

Dans l’espace de la génération/synthèse, cela s’est déjà produit avec les réseaux antagonistes génératifs (GAN) et les champs de rayonnement neuronal (NeRF), qui se sont finalement avérés très difficiles à instrumentaliser en systèmes commerciaux performants, malgré des années de recherche universitaire dans ce but. Ces technologies apparaissent maintenant le plus souvent comme des composants auxiliaires dans des architectures alternatives.

Tout comme les studios de cinéma peuvent espérer que la formation sur des catalogues de films légitimement licenciés pourrait éliminer les artistes d’effets visuels, l’IA ajoute actuellement des rôles à la main-d’œuvre.

Que les systèmes de vidéo basés sur la diffusion puissent vraiment être transformés en générateurs de films cohérents et photoréalistes, ou que toute l’affaire soit simplement une autre quête alchimique, devrait devenir apparent au cours des 12 prochains mois.

Il se peut que nous ayons besoin d’une approche entièrement nouvelle ; ou il se peut que Gaussian Splatting (GSplat), qui a été développé dans les années 90 et a récemment pris son essor dans l’espace de synthèse d’images, représente une alternative potentielle à la génération de vidéo basée sur la diffusion.

Puisque GSplat a mis 34 ans pour émerger, il est possible que d’anciens prétendants tels que NeRF et GAN – et même les modèles de diffusion latente – n’aient pas encore eu leur jour.

* La fonction de storyboard AI de Kaiber offre ce type de fonctionnalité, mais les résultats que j’ai vus ne sont pas de qualité de production.

Martin Anderson est l’ancien responsable du contenu de recherche scientifique chez metaphysic.ai

Premièrement publié lundi 23 septembre 2024