Intelligence artificielle

Un cartel de jeux de données influents domine la recherche en apprentissage automatique, suggère une nouvelle étude

Un nouveau document de l’Université de Californie et de Google Research a constaté qu’un petit nombre de jeux de données de référence d’apprentissage automatique, en grande partie issus d’institutions occidentales influentes, et fréquemment d’organisations gouvernementales, dominent de plus en plus le secteur de la recherche en intelligence artificielle.

Les chercheurs concluent que cette tendance à « revenir » à des jeux de données open source très populaires, tels que ImageNet, soulève un certain nombre de préoccupations pratiques, éthiques et même politiques.

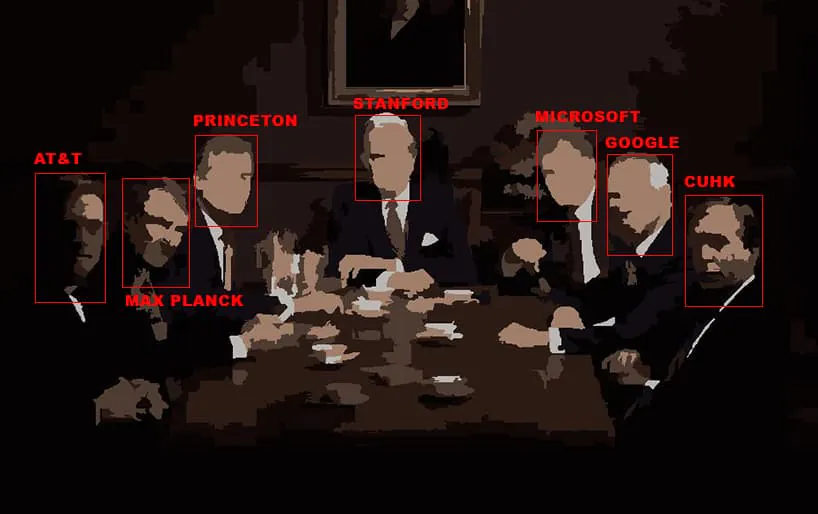

Parmi leurs constatations – basées sur des données essentielles du projet communautaire mené par Facebook Papers With Code (PWC) – les auteurs affirment que ‘les jeux de données largement utilisés sont introduits par seulement une poignée d’institutions de l’élite’, et que cette « consolidation » a augmenté à 80 % ces dernières années.

‘[Nous] constatons qu’il y a une inégalité croissante dans l’utilisation des jeux de données à l’échelle mondiale, et que plus de 50 % de toutes les utilisations de jeux de données dans notre échantillon de 43 140 correspondent à des jeux de données introduits par douze institutions de l’élite, principalement occidentales.’

Une carte des utilisations de jeux de données non spécifiques à une tâche sur les dix dernières années. Les critères d’inclusion sont les institutions ou les entreprises qui représentent plus de 50 % des utilisations connues. À droite, le coefficient de Gini pour la concentration des jeux de données au fil du temps pour les institutions et les jeux de données. Source : https://arxiv.org/pdf/2112.01716.pdf

Les institutions dominantes comprennent l’Université de Stanford, Microsoft, Princeton, Facebook, Google, l’Institut Max Planck et AT&T. Quatre des dix premières sources de jeux de données sont des institutions corporatives.

Le document caractérise également l’utilisation croissante de ces jeux de données de l’élite comme ‘un véhicule pour l’inégalité dans la science’. C’est parce que les équipes de recherche cherchant l’approbation de la communauté sont plus motivées pour atteindre des résultats à l’état de l’art (SOTA) contre un jeu de données cohérent que pour générer des jeux de données originaux qui n’ont pas de telle reconnaissance, et qui nécessiteraient que les pairs s’adaptent à de nouvelles métriques au lieu d’indices standard.

Dans tous les cas, comme le reconnaît le document, créer son propre jeu de données est une entreprise prohibitivement coûteuse pour les institutions et les équipes moins bien dotées.

‘La validité scientifique prima facie accordée par le benchmarking SOTA est génériquement confondue avec la crédibilité sociale que les chercheurs obtiennent en montrant qu’ils peuvent concourir sur un jeu de données largement reconnu, même si un benchmark plus spécifique au contexte pourrait être plus techniquement approprié.

‘Nous posons que ces dynamiques créent un “effet Matthew” (c’est-à-dire “les riches deviennent plus riches et les pauvres deviennent plus pauvres”) où les benchmarks réussis, et les institutions de l’élite qui les introduisent, gagnent une stature démesurée dans le domaine.

Le document s’intitule Réduits, réutilisés et recyclés : la vie d’un jeu de données dans la recherche en apprentissage automatique, et provient de Bernard Koch et Jacob G. Foster à UCLA, et d’Emily Denton et Alex Hanna à Google Research.

Le travail soulève un certain nombre de problèmes avec la tendance croissante à la consolidation qu’il documente, et a été accueilli avec une approbation générale sur Open Review. Un commentateur de NeurIPS 2021 a commenté que le travail est ‘extrêmement pertinent pour quiconque impliqué dans la recherche en apprentissage automatique.’ et a prévu son inclusion en tant que lecture assignée dans les cours universitaires.

De la nécessité à la corruption

Les auteurs notent que la culture actuelle de « battez le benchmark » est née comme remède au manque d’outils d’évaluation objectifs qui a provoqué l’effondrement de l’intérêt et de l’investissement dans l’IA il y a plus de trente ans, après le déclin de l’enthousiasme des entreprises pour les nouvelles recherches sur les « systèmes experts » :

‘Les benchmarks formalisent généralement une tâche particulière à travers un jeu de données et une métrique quantitative d’évaluation associée. La pratique a été introduite à l’origine dans la recherche en apprentissage automatique après l’“hiver de l’IA” des années 80 par les financeurs gouvernementaux, qui cherchaient à évaluer plus précisément la valeur reçue sur les subventions.’

Le document soutient que les avantages initiaux de cette culture informelle de normalisation (réduction des barrières à la participation, des métriques cohérentes et des opportunités de développement plus agiles) commencent à être supplantés par les inconvénients qui se produisent naturellement lorsqu’un corps de données devient suffisamment puissant pour définir effectivement ses « conditions d’utilisation » et sa portée d’influence.

Les auteurs suggèrent, conformément à beaucoup de pensées récentes de l’industrie et de l’université sur le sujet, que la communauté de recherche ne pose plus de problèmes nouveaux si ceux-ci ne peuvent pas être abordés à l’aide de jeux de données de référence existants.

Ils notent en outre que l’adhésion aveugle à ce petit nombre de jeux de données « d’or » encourage les chercheurs à atteindre des résultats qui sont surajustés (c’est-à-dire qui sont spécifiques au jeu de données et qui ne sont pas susceptibles de fonctionner aussi bien sur des données du monde réel, sur de nouveaux jeux de données universitaires ou originaux, ou même nécessairement sur différents jeux de données dans le « standard d’or »).

‘Compte tenu de la concentration élevée de la recherche sur un petit nombre de jeux de données de référence, nous croyons que la diversification des formes d’évaluation est particulièrement importante pour éviter la surajustement aux jeux de données existants et la fausse représentation des progrès dans le domaine.’

Influence gouvernementale dans la recherche en vision par ordinateur

Selon le document, la recherche en vision par ordinateur est nettement plus affectée par le syndrome qu’il décrit que d’autres secteurs, les auteurs notant que la recherche en traitement automatique des langues (TAL) est beaucoup moins affectée. Les auteurs suggèrent que cela pourrait être dû au fait que les communautés TAL sont ‘plus cohérentes’ et plus grandes, et que les jeux de données TAL sont plus accessibles et plus faciles à curer, ainsi que plus petits et moins gourmands en ressources en termes de collecte de données.

Dans la vision par ordinateur, et en particulier en ce qui concerne les jeux de données de reconnaissance faciale (RF), les auteurs affirment que les intérêts corporatifs, étatiques et privés se croisent souvent :

‘Les institutions corporatives et gouvernementales ont des objectifs qui peuvent entrer en conflit avec la vie privée (par exemple, la surveillance), et que le poids de ces priorités est susceptible d’être différent de celui des universitaires ou des parties prenantes plus larges de l’IA.’

Pour les tâches de reconnaissance faciale, les chercheurs ont constaté que l’incidence de jeux de données purement académiques diminue considérablement par rapport à la moyenne :

‘[Quatre] des huit jeux de données (33,69 % du total des utilisations) étaient financés exclusivement par des entreprises, l’armée américaine ou le gouvernement chinois (MS-Celeb-1M, CASIA-Webface, IJB-A, VggFace2). MS-Celeb-1M a finalement été retiré en raison de la controverse entourant la valeur de la vie privée pour les différentes parties prenantes.’

Les jeux de données les plus utilisés dans les communautés de recherche en génération d’images et en reconnaissance faciale.

Dans le graphique ci-dessus, comme le notent les auteurs, nous voyons également que le domaine relativement récent de la génération d’images (ou de la synthèse d’images) repose fortement sur des jeux de données existants, beaucoup plus anciens, qui n’ont pas été destinés à cette utilisation.

En fait, le document observe une tendance croissante à la « migration » des jeux de données loin de leur objectif initial, remettant en question leur adaptabilité aux besoins de nouveaux secteurs de recherche ou de recherche marginale, et dans quelle mesure les contraintes budgétaires peuvent « génériquer » l’étendue des ambitions des chercheurs dans le cadre plus étroit fourni à la fois par les matériaux disponibles et par une culture si obsédée par les classements de benchmark d’année en année que les nouveaux jeux de données ont du mal à gagner en reconnaissance.

‘Nos constatations indiquent également que les jeux de données se déplacent régulièrement entre différentes communautés de tâches. À l’extrême, la majorité des jeux de données de référence en circulation pour certaines communautés de tâches ont été créés pour d’autres tâches.’

En ce qui concerne les luminaires de l’apprentissage automatique (y compris Andrew Ng) qui ont de plus en plus appelé à une plus grande diversité et à une meilleure curation des jeux de données ces dernières années, les auteurs soutiennent le sentiment, mais estiment que ce type d’effort, même s’il est couronné de succès, pourrait potentiellement être contrecarré par la dépendance actuelle de la culture à l’égard des résultats SOTA et des jeux de données établis :

‘Notre recherche suggère que simplement appeler les chercheurs en apprentissage automatique à développer plus de jeux de données, et à modifier les structures d’incitation de telle sorte que le développement de jeux de données soit valorisé et récompensé, peut ne pas suffire à diversifier l’utilisation des jeux de données et les perspectives qui façonnent et définissent les ordres du jour de la recherche en apprentissage automatique.’

‘En plus d’inciter au développement de jeux de données, nous préconisons des interventions politiques axées sur l’équité qui donnent la priorité à un financement important pour les personnes dans les institutions moins bien dotées pour créer des jeux de données de haute qualité. Cela diversifierait – d’un point de vue social et culturel – les jeux de données de référence utilisés pour évaluer les méthodes d’apprentissage automatique modernes.’

6 décembre 2021, 16h49 GMT+2 – Correction de la possession dans le titre. – MA