Intelligence artificielle

MINT-1T : mise à l’échelle des données multimodales open source de 10 fois

La formation de grands modèles multimodaux (LMM) de pointe nécessite de grands ensembles de données avec des séquences entrelacées d’images et de texte en forme libre. Bien que les LMM open source aient évolué rapidement, il existe encore un manque important de jeux de données multimodaux entrelacés à grande échelle qui sont open source. L’importance de ces ensembles de données ne peut pas être surestimée, car ils forment la base de la création de systèmes d’IA avancés capables de comprendre et de générer du contenu dans différents modaux. Sans un approvisionnement suffisant en ensembles de données entrelacés complets, le potentiel de développement de LMM plus sophistiqués et plus capables est considérablement entravé. Ces ensembles de données permettent aux modèles d’apprendre à partir d’une gamme diversifiée d’entrées, les rendant plus polyvalents et plus efficaces dans diverses applications. De plus, la rareté de tels ensembles de données pose un défi à la communauté open source, qui repose sur des ressources partagées pour stimuler l’innovation et la collaboration.

Les LMM open source ont réalisé des progrès importants ces dernières années, mais leur croissance est entravée par la disponibilité limitée de grands ensembles de données entrelacés à grande échelle. Pour surmonter cet obstacle, des efforts concertés sont nécessaires pour curer, annoter et publier plus d’ensembles de données complets qui peuvent soutenir le développement et l’affinement continus des modèles multimodaux. En outre, la création et la diffusion de ces ensembles de données impliquent de surmonter plusieurs obstacles techniques et logistiques. La collecte de données doit être extensive et représentative des contextes divers dans lesquels les LMM seront déployés. L’annotation nécessite une attention particulière pour garantir que les séquences entrelacées d’images et de texte sont alignées de manière à améliorer les capacités d’apprentissage du modèle. De plus, le fait de garantir que les ensembles de données sont open source implique de résoudre des considérations juridiques et éthiques liées à la confidentialité des données et aux droits d’utilisation. L’expansion de la disponibilité de grands ensembles de données multimodaux entrelacés de haute qualité est essentielle pour l’avenir de la recherche et du développement de l’IA. En résolvant la pénurie actuelle, la communauté de l’IA peut favoriser une plus grande innovation et collaboration, conduisant à la création de LMM plus puissants et plus polyvalents capables de résoudre des problèmes complexes et réels.

En partant de cette idée, MINT-1T, le plus grand et le plus diversifié ensemble de données multimodaux entrelacés open source à ce jour. MINT-1T : une échelle 10 fois plus grande, comprenant un trillion de jetons de texte et 3,4 milliards d’images que les ensembles de données open source existants. L’ensemble de données MINT-1T introduit également de nouvelles sources telles que des fichiers PDF et des documents ArXiv. Puisque les ensembles de données multimodaux entrelacés ne sont pas faciles à mettre à l’échelle, il est important que l’ensemble de données MINT-1T partage le processus de curation des données afin que d’autres puissent également effectuer des expériences sur ces variantes riches en informations. L’ensemble de données MINT-1T démontre que sa méthode ; les modèles de langage formés sur MINT-1T sont compétitifs (bien que légèrement) avec les précédents états de l’art OBELICS.

MINT-1T : Un ensemble de données multimodaux avec un trillion de jetons

Les grands ensembles de données de pré-formation open source ont été déterminants pour la communauté de recherche dans l’exploration de l’ingénierie des données et la formation de modèles transparents et open source. Dans le domaine du texte, les premiers travaux tels que C4 et The Pile ont joué des rôles cruciaux pour permettre à la communauté de former les premiers modèles de langage open source de grande taille comme GPT-J, GPT-Neo, et d’autres. Ces efforts fondamentaux ont également ouvert la voie à des améliorations ultérieures des méthodes de filtrage des données et de mise à l’échelle. De même, dans l’espace image-texte, les grands ensembles de données open source ont suscité des innovations dans de meilleures méthodes de curation des données, telles que les réseaux de filtrage des données et T-MARS. Il y a un déplacement notable des laboratoires de pointe vers la formation de grands modèles multimodaux (LMM) qui nécessitent de grands ensembles de données multimodaux entrelacés composés de séquences libres d’images et de texte. À mesure que les capacités des modèles de pointe avancent rapidement, un écart important émerge dans les données de formation multimodales entre les modèles fermés et open source. Les ensembles de données multimodaux entrelacés open source actuels sont plus petits et moins diversifiés que leurs homologues texte-seulement, étant principalement issus de documents HTML, ce qui limite la largeur et la variété des données. Cette limitation entrave le développement de LMM open source robustes et crée un écart entre les capacités des modèles open source et fermés.

Pour combler cet écart, MINT-1T a été créé comme le plus grand et le plus diversifié ensemble de données multimodaux entrelacés open source à ce jour. MINT-1T contient un total d’un trillion de jetons de texte et de trois milliards d’images, issus de sources diverses telles que HTML, PDF et ArXiv. Avant MINT-1T, le plus grand ensemble de données open source dans ce domaine était OBELICS, qui comprenait 115 milliards de jetons de texte et 353 millions d’images, toutes issues de HTML.

Les contributions de MINT-1T sont les suivantes :

- Ingénierie des données : La mise à l’échelle de ces données multimodales entrelacées présente plus un défi d’ingénierie que la construction de jeux de données texte-seulement ou d’appariements image-texte. La gestion de tailles de documents plus importantes et la préservation de l’ordre d’origine des images et du texte sont cruciales.

- Diversité : MINT-1T est le premier dans l’espace des données multimodales entrelacées à rassembler des documents multimodaux de haute qualité à grande échelle à partir de sources telles que les fichiers PDF de CommonCrawl et ArXiv.

- Expériences de modèles : Les expériences montrent que les LMM formés sur MINT-1T ne sont pas seulement compétitifs mais surpassent potentiellement les performances des modèles formés sur le meilleur ensemble de données open source existant, OBELICS, tout en offrant une augmentation de dix fois de l’échelle.

MINT-1T : Construction de l’ensemble de données

MINT-1T curé un grand ensemble de données open source qui utilise des sources plus diversifiées de documents entrelacés, tels que des fichiers PDF et des documents ArXiv. Cette section détaille les méthodes de MINT-1T pour la source de documents multimodaux, le filtrage de contenu de mauvaise qualité, la déduplication des données et la suppression de contenu non adapté au travail ou indésirable. L’ensemble de données final comprend 922 milliards (B) de jetons HTML, 106B de jetons PDF et 9B de jetons ArXiv.

Approvisionnement de grandes quantités de documents multimodaux

Pipeline HTML

MINT-1T suit la méthode d’OBELICS pour extraire des documents multimodaux entrelacés de fichiers WARC de CommonCrawl en analysant l’arbre DOM de chaque entrée WARC. Alors qu’OBELICS n’a traité que des documents de février 2020 à février 2023 des dumps de CommonCrawl, MINT-1T a élargi le bassin de documents pour inclure des documents HTML de mai 2017 à avril 2024 (avec des dumps complets d’octobre 2018 à avril 2024 et des dumps partiels des années précédentes). De même qu’OBELICS, MINT-1T filtre les documents contenant aucune image, plus de trente images ou toute image avec des URL contenant des sous-chaînes inappropriées telles que logo, avatar, porn, et xxx.

Pipeline PDF

MINT-1T source des documents PDF à partir de fichiers WAT de CommonCrawl des dumps de février 2023 à avril 2024. Initialement, tous les liens PDF sont extraits de ces dumps. MINT-1T tente ensuite de télécharger et de lire les PDF à l’aide de PyMuPDF, en éliminant les PDF de plus de 50 Mo (probablement contenant de grandes images) et ceux de plus de 50 pages. Les pages sans texte sont exclues et un ordre de lecture est établi pour les pages restantes. L’ordre de lecture est déterminé en trouvant la boîte de délimitation de tous les blocs de texte sur une page, en regroupant les blocs en fonction des colonnes et en les ordonnant de haut en bas et de gauche à droite. Les images sont intégrées dans la séquence en fonction de leur proximité avec les blocs de texte sur la même page.

Pipeline ArXiv

MINT-1T construit des documents ArXiv entrelacés à partir du code source LaTeX en utilisant TexSoup pour trouver les balises de figure et entrelacer les images avec le texte du document. Pour les documents à fichiers multiples, MINT-1T identifie le fichier principal Tex et remplace les balises d’entrée par le contenu de ses fichiers. Le code LaTeX est nettoyé en supprimant les imports, la bibliographie, les tableaux et les balises de citation. Puisque ArXiv est déjà une source de données très ciblée, aucune filtration et déduplication supplémentaires ne sont effectuées.

Filtrage de la qualité du texte

MINT-1T évite d’utiliser des heuristiques basées sur le modèle pour le filtrage du texte, suivant les pratiques établies par RefinedWeb, Dolma et FineWeb. Initialement, les documents non anglais sont éliminés en utilisant le modèle d’identification de langue Fasttext (avec un seuil de confiance de 0,65). Les documents avec des URL contenant des sous-chaînes NSFW sont également supprimés pour exclure le contenu pornographique et indésirable. Les méthodes de filtrage de texte de RefinedWeb sont appliquées, en particulier en supprimant les documents avec des n-grammes dupliqués excessifs ou ceux identifiés comme de mauvaise qualité en utilisant les règles de MassiveText.

Filtrage des images

Après la curation des PDF et des fichiers HTML, MINT-1T tente de télécharger toutes les URL d’images dans l’ensemble de données HTML, en éliminant les liens non récupérables et en supprimant les documents avec des liens d’images non valides. Les images de moins de 150 pixels sont supprimées pour éviter les images bruyantes telles que les logos et les icônes, et les images de plus de 20 000 pixels sont également supprimées car elles correspondent généralement à des images hors sujet. Pour les documents HTML, les images avec un rapport d’aspect supérieur à deux sont supprimées pour filtrer les images de mauvaise qualité telles que les bannières publicitaires. Pour les PDF, le seuil est ajusté à trois pour préserver les figures et les tableaux scientifiques.

La figure ci-dessus représente de manière unique comment MINT-1T inclut des données à partir de fichiers PDF et de documents ArXiv au-delà des sources HTML.

Filtrage de sécurité

- Filtrage d’images NSFW : MINT-1T applique un détecteur d’images NSFW à toutes les images de l’ensemble de données. Si un document contient une seule image NSFW, l’ensemble du document est supprimé.

- Suppression des informations personnelles identifiables : Pour atténuer le risque de fuite de données personnelles, les adresses e-mail et les adresses IP dans les données texte sont anonymisées. Les adresses e-mail sont remplacées par des modèles tels que “[email protected]” et les adresses IP par des adresses IP non fonctionnelles générées aléatoirement.

Déduplication

MINT-1T effectue une déduplication de texte de paragraphes et de documents dans chaque instantané de CommonCrawl et une déduplication d’images pour supprimer les images répétitives et non informatives telles que les icônes et les logos. Toutes les étapes de déduplication sont effectuées séparément pour chaque source de données.

Déduplication de paragraphes et de documents

En suivant la méthodologie de Dolma, MINT-1T utilise un filtre Bloom pour la déduplication efficace du texte, en définissant le taux de faux positifs à 0,01 et en dédupliquant les paragraphes de 13 grammes (indiqués par des délimiteurs de nouvelle ligne double) de chaque document. Si plus de 80 % des paragraphes d’un document sont des doublons, l’ensemble du document est supprimé.

Suppression du texte de chaîne de caractères commune

Après la déduplication de paragraphes, MINT-1T supprime les phrases de chaîne de caractères courtes dans les documents HTML, telles que “Skip to content” ou “Blog Archive.” Cela est fait en exécutant une déduplication de paragraphes exacte sur 2 % de chaque instantané de CommonCrawl, conformément aux pratiques de CCNet, en garantissant principalement la suppression du texte de chaîne de caractères commune.

La figure ci-dessus démontre le processus de filtrage pour MINT-1T et montre comment les jetons sont supprimés tout au long du pipeline de données pour HTML, PDF et documents ArXiv.

Déduplication d’images

Dans chaque instantané de CommonCrawl, MINT-1T supprime les images qui apparaissent fréquemment en fonction des hachages SHA256. Plutôt que la déduplication stricte, seules les images qui apparaissent plus de dix fois dans un instantané sont supprimées, suivant les pratiques de Multimodal-C4. Conformément à OBELICS, les images répétées dans un seul document sont supprimées, ne conservant que la première occurrence.

Infrastructure

Au cours du traitement des données, MINT-1T a eu accès à une moyenne de 2 350 cœurs CPU à partir d’un mélange de nœuds à 190 processeurs et à 90 processeurs. Au total, environ 4,2 millions d’heures CPU ont été utilisées pour construire cet ensemble de données.

Comparaison de la composition de documents dans MINT-1T avec OBELICS

Lors de l’évaluation de la composition des ensembles de données entrelacés, deux caractéristiques clés sont examinées : la distribution des jetons de texte par document et le nombre d’images par document. Pour cette analyse, 50 000 documents ont été échantillonnés aléatoirement à partir d’OBELICS et de chaque source de données dans MINT-1T. Le tokenizer de GPT-2 a été utilisé pour calculer le nombre de jetons de texte. Les valeurs aberrantes ont été supprimées en excluant les documents qui se situaient en dehors de la plage interquartile de 1,5 pour le nombre de jetons de texte et d’images. Comme le montre la figure suivante, le sous-ensemble HTML de MINT-1T s’aligne étroitement sur la distribution de jetons observée dans OBELICS. Cependant, les documents issus de PDF et d’ArXiv tendent à être plus longs que les documents HTML en moyenne, mettant en évidence les avantages de la source de données diversifiée. La figure 5 examine la densité d’images dans l’ensemble des documents, révélant que les documents PDF et ArXiv contiennent plus d’images que les documents HTML, les échantillons ArXiv étant les plus denses en images.

Comment les différentes sources de données améliorent-elles la diversité des documents ?

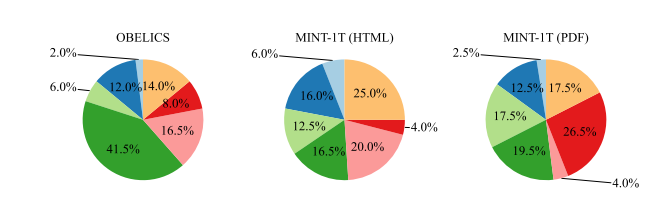

Une motivation importante pour élargir le bassin de documents multimodaux au-delà de HTML est l’amélioration de la couverture de domaine. Pour quantifier la diversité et la profondeur de cette couverture, un modèle LDA a été formé sur 100 000 documents échantillonnés à partir de l’ensemble de données OBELICS, du sous-ensemble HTML de MINT-1T et du sous-ensemble PDF (hors ArXiv) de MINT-1T pour obtenir 200 sujets. GPT-4 a ensuite été utilisé pour classer l’ensemble de mots pour identifier les domaines dominants – tels que la santé et la médecine, la science, les affaires, les humanités, l’histoire, etc. – sur la base des domaines MMMU. L’analyse révèle des tendances distinctes dans la distribution de domaine :

- OBELICS : Cet ensemble de données montre une concentration prononcée dans les “Humanités et sciences sociales”. Cela peut être attribué à son processus de construction de données, qui implique de filtrer les documents qui ne ressemblent pas à des articles de Wikipedia, ce qui pourrait potentiellement modifier la distribution vers un contenu plus général et axé sur les humanités.

- Sous-ensemble HTML de MINT-1T : Contrairement à OBELICS, le sous-ensemble HTML de MINT-1T n’est pas fortement biaisé vers un domaine spécifique, suggérant une représentation de domaine plus large et plus équilibrée.

- Sous-ensemble PDF de MINT-1T : Il y a une proportion plus élevée de documents “Science et technologie” dans les documents PDF de MINT-1T. Cette tendance est probablement due à la nature de la communication scientifique, où les PDF sont le format préféré pour partager des rapports de recherche et des rapports techniques détaillés.

MINT-1T : Résultats et expériences

Pour toutes les expériences, MINT-1T forme le modèle sur 50 % de lots de légendage d’images et de texte et 50 % de lots de documents multimodaux entrelacés. Un maximum de 2048 jetons multimodaux est échantillonné à partir de chaque document entrelacé et 340 jetons à partir de chaque échantillon d’image et de texte. De même que Flamingo, un jeton “fin” est ajouté pour indiquer la fin d’une séquence d’image et de texte adjacente. Au cours de la formation, 50 % des documents à image unique entrelacée sont supprimés aléatoirement pour suréchantillonner les documents à plusieurs images. L’ensemble de données d’image et de texte est composé d’un mélange de jeux de données de légendage internes. La capacité du modèle à raisonner sur des séquences multimodales entrelacées est évaluée à travers ses capacités d’apprentissage en contexte et ses performances de raisonnement multi-image.

La figure ci-dessus illustre le pourcentage de documents de chaque domaine dans MMMU pour OBELICS et des sous-ensembles de MINT-1T.

Apprentissage en contexte : Les modèles sont évalués sur les performances d’apprentissage en contexte à quatre et huit démonstrations sur divers benchmarks de légendage (COCO (test de Karpathy) et TextCaps (validation)) et des ensembles de données de questions et réponses visuelles (VQAv2 (validation), OK-VQA (validation), TextVQA (validation) et VizWiz (validation)). Les démonstrations sont échantillonnées aléatoirement à partir de l’ensemble de formation. Les scores sont moyennés sur plusieurs exécutions d’évaluation, avec des démonstrations aléatoires pour tenir compte de la sensibilité aux invites choisies. Différentes invites sont abordées pour chaque tâche pour sélectionner les meilleures invites performantes.

Raisonnement multi-image : Les modèles sont évalués sur MMMU (contenant à la fois des questions à une image et à plusieurs images) et Mantis-Eval (toutes des questions à plusieurs images) pour sonder les capacités de raisonnement multi-image au-delà des évaluations d’apprentissage en contexte.

Formation sur des documents HTML

Initialement, la partie HTML de MINT-1T est comparée à OBELICS, car OBELICS est l’ensemble de données entrelacées de pointe précédent, également issu de documents HTML. Deux modèles sont formés sur les parties HTML de MINT-1T et OBELICS pour un total de 10 milliards de jetons multimodaux. Leurs performances d’apprentissage en contexte sont évaluées. Le tableau suivant présente les performances à quatre et huit démonstrations sur les benchmarks courants ; le modèle formé sur les documents HTML de MINT-1T performs mieux qu’OBELICS sur les tâches VQA mais moins bien sur les benchmarks de légendage. En moyenne, OBELICS performs légèrement mieux que MINT-1T (HTML).

Ajout de documents PDF et ArXiv

Par la suite, la formation est effectuée sur l’ensemble complet des sources de données de MINT-1T, avec un mélange de documents HTML, PDF et ArXiv. Les documents entrelacés sont échantillonnés à 50 % à partir de HTML, 45 % à partir de PDF et 5 % à partir d’ArXiv. Le modèle est formé pour un total de 10 milliards de jetons multimodaux. Comme le montre le tableau ci-dessus, le modèle formé sur l’ensemble complet des données de MINT-1T surpasse OBELICS et MINT-1T (HTML) sur la plupart des benchmarks d’apprentissage en contexte. Sur les benchmarks de raisonnement multimodal plus complexes, le modèle MINT-1T surpasse OBELICS sur MMMU mais performs moins bien sur Mantis-Eval.

Tendances détaillées

Comment les performances d’apprentissage en contexte évoluent-elles avec les démonstrations ?

Les performances d’apprentissage en contexte sont évaluées lorsqu’elles sont présentées avec une à huit démonstrations. Un seul essai par nombre de démonstrations est effectué pour chaque benchmark d’évaluation. Comme le montre la figure suivante, le modèle formé sur MINT-1T surpasse le modèle formé sur le sous-ensemble HTML de MINT-1T et OBELICS sur tous les nombres de démonstrations. Le modèle MINT-1T (HTML) performs légèrement moins bien qu’OBELICS.

Performances sur les tâches de légendage et de questions-réponses visuelles

La figure suivante présente les performances moyennes d’apprentissage en contexte sur les benchmarks de légendage et de questions-réponses visuelles. OBELICS surpasse tous les variants de MINT-1T sur les benchmarks de légendage à quatre démonstrations et performs légèrement moins bien que MINT-1T sur les benchmarks de légendage à huit démonstrations. Cependant, MINT-1T surpasse de manière significative les modèles de base sur les tâches VQA. MINT-1T (HTML) surpasse également OBELICS sur les tâches VQA.

Performances sur différents domaines

L’inclusion de domaines diversifiés dans MINT-1T vise à améliorer la généralisation du modèle. La figure précédente décompose les performances sur MMMU pour chaque domaine. À l’exception du domaine des affaires, MINT-1T surpasse OBELICS et MINT-1T (HTML). L’augmentation des performances dans les domaines de la science et de la technologie pour MINT-1T est attribuée à la prévalence de ces domaines dans les documents ArXiv et PDF.

Pensées finales

Dans cet article, nous avons discuté de MINT-1T, le plus grand et le plus diversifié ensemble de données multimodaux entrelacés open source à ce jour. MINT-1T : une échelle 10 fois plus grande, comprenant un trillion de jetons de texte et 3,4 milliards d’images que les ensembles de données open source existants. L’ensemble de données MINT-1T introduit également de nouvelles sources telles que des fichiers PDF et des documents ArXiv. Puisque les ensembles de données multimodaux entrelacés ne sont pas faciles à mettre à l’échelle, il est important que l’ensemble de données MINT-1T partage le processus de curation des données afin que d’autres puissent également effectuer des expériences sur ces variantes riches en informations. L’ensemble de données MINT-1T démontre que sa méthode ; les modèles de langage formés sur MINT-1T sont compétitifs (bien que légèrement) avec les précédents états de l’art OBELICS.