Intelligence artificielle

Routeurs de modèles et piège de rétroaction : Comment l’IA apprend d’elle-même

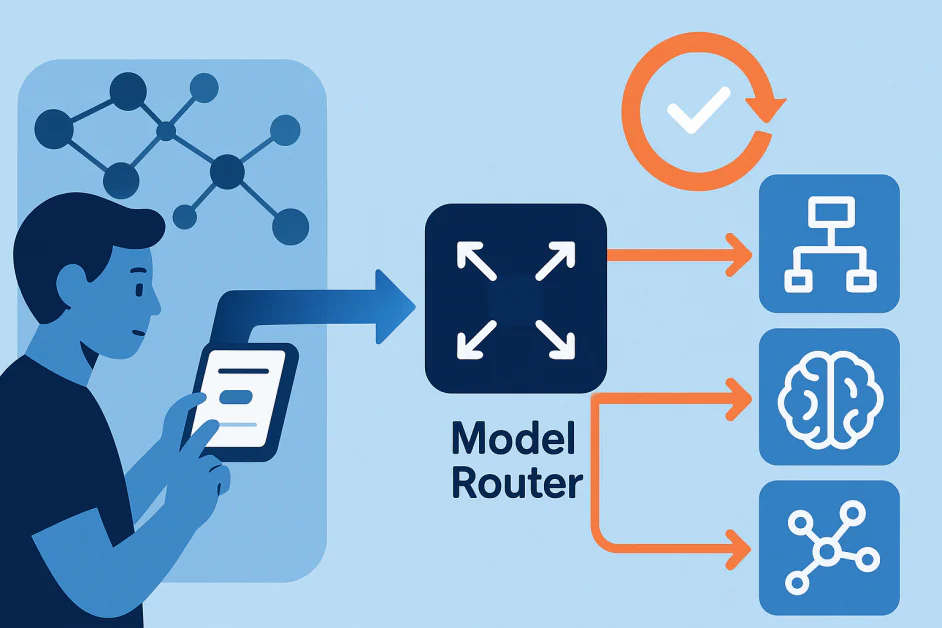

Les systèmes d’IA modernes ne sont plus construits autour d’un seul modèle qui gère toutes les tâches. Au lieu de cela, ils s’appuient sur des collections de modèles, chacun conçu pour des objectifs spécifiques. Au centre de cette configuration se trouve le routeur de modèle, un composant qui interprète une demande utilisateur et décide quel modèle doit la gérer. Par exemple, dans des systèmes comme OpenAI’s GPT-5, un routeur peut envoyer une requête simple à un modèle léger pour la rapidité tout en routant des tâches de raisonnement complexes à un modèle plus avancé.

Les routeurs ne sont pas seulement des gestionnaires de trafic. Ils apprennent du comportement des utilisateurs, comme lorsque les gens basculent entre les modèles ou préfèrent certaines réponses. Cela crée un cycle : le routeur attribue la requête, le modèle produit une réponse, les réactions des utilisateurs fournissent une rétroaction, et le routeur met à jour ses décisions. Lorsque ces cycles fonctionnent discrètement en arrière-plan, ils peuvent former des boucles de rétroaction cachées. De telles boucles peuvent amplifier les biais, renforcer les modèles défectueux ou réduire progressivement les performances de manière difficile à détecter.

Cet article examine comment les routeurs de modèles fonctionnent, comment les boucles de rétroaction émergent et quels risques elles posent à mesure que les systèmes d’IA continuent d’évoluer.

Comprendre les routeurs de modèles dans l’IA

Un routeur de modèle est la couche de prise de décision dans un système d’IA à multi-modèles. Son rôle est de déterminer quel modèle convient le mieux à une tâche. Le choix dépend de facteurs tels que la complexité de la requête, l’intention de l’utilisateur, le contexte et les compromis entre coût, précision et rapidité.

Contrairement aux systèmes qui suivent des règles fixes, la plupart des routeurs de modèles sont eux-mêmes des systèmes d’apprentissage automatique. Ils sont formés sur des signaux du monde réel et s’adaptent avec le temps. Ils peuvent apprendre du comportement des utilisateurs, tel que le commutation entre les modèles, la notation des réponses ou la reformulation des invites, ainsi que des évaluations automatisées qui mesurent la qualité de la sortie.

Cette adaptabilité rend les routeurs puissants mais également risqués. Ils améliorent l’efficacité et offrent une meilleure expérience utilisateur, mais les mêmes processus de rétroaction qui affinent leurs décisions peuvent également créer des boucles de renforcement. Au fil du temps, ces boucles peuvent affecter non seulement les stratégies de routage mais également le comportement du système d’IA plus large.

Comment les boucles de rétroaction se forment

Une boucle de rétroaction se produit lorsqu’une sortie de système influence les données qu’il apprend plus tard. Un exemple simple est un système de recommandation : si vous cliquez sur une vidéo de sport, le système vous montre plus de contenu sportif, ce qui façonne ce que vous regardez ensuite. Au fil du temps, le système renforce ses propres modèles. Un autre exemple pour comprendre la boucle de rétroaction est la police prédictive. Un algorithme peut prédire une criminalité plus élevée dans certains quartiers, ce qui peut conduire à davantage de patrouilles. Les patrouilles accrues découvrent plus d’incidents, qui à leur tour confirment la prédiction de l’algorithme. Le système semble précis, mais les données sont biaisées par son influence propre. Les boucles de rétroaction peuvent être directes ou cachées. Les boucles directes sont faciles à reconnaître, comme un système de recommandation réentraîné sur ses propres suggestions. Les boucles cachées sont plus subtiles car elles surgissent lorsque différentes parties d’un système influencent indirectement les unes les autres.

Les routeurs de modèles peuvent créer des boucles similaires. Une décision de routeur façonne quel modèle produit la réponse. Cette réponse façonne le comportement de l’utilisateur, qui devient une rétroaction pour le routeur. Au fil du temps, le routeur peut commencer à renforcer les modèles qui ont fonctionné dans le passé plutôt que de choisir constamment le meilleur modèle. Ces boucles sont difficiles à détecter et peuvent discrètement pousser les systèmes d’IA dans des directions non intentionnelles.

Pourquoi les boucles de rétroaction dans les routeurs sont risquées

Alors que les boucles de rétroaction aident les routeurs à améliorer l’appariement des tâches, elles comportent également des risques qui peuvent déformer le comportement du système. Un risque est de renforcer les biais initiaux. Si un routeur envoie régulièrement un certain type de requête à le Modèle A, la plupart des rétroactions proviendront des sorties du Modèle A. Le routeur peut alors supposer que le Modèle A est toujours le meilleur, mettant de côté le Modèle B, même s’il pourrait parfois performer mieux. Cette utilisation inégale peut devenir auto-renforçante. Les modèles qui performent bien sur les tâches routées attirent plus de requêtes, ce qui renforce leurs forces. Les modèles sous-utilisés reçoivent moins de chances de s’améliorer, créant un déséquilibre et réduisant la diversité.

Les biais peuvent également provenir des modèles d’évaluation utilisés pour juger la correction. Si le modèle « juge » a des angles morts, ses biais sont transmis directement au routeur, qui optimise alors pour les valeurs du juge plutôt que pour les besoins réels de l’utilisateur. Le comportement de l’utilisateur ajoute une autre couche de complexité. Si un routeur a tendance à retourner certains styles de réponses, les utilisateurs peuvent adapter leurs requêtes pour correspondre à ces modèles, les renforçant encore plus. Au fil du temps, cela peut restreindre à la fois le comportement de l’utilisateur et les réponses du système. Les routeurs peuvent également apprendre à associer certains modèles de requête ou des démographiques à des modèles spécifiques. Cela peut conduire à des expériences systématiquement différentes entre les groupes, potentiellement renforçant et amplifiant les biais sociétaux existants.

Une autre préoccupation clé est la dérive à long terme. Les décisions qu’un routeur prend aujourd’hui influencent les données de formation utilisées demain. Si les modèles sont réentraînés sur des sorties influencées par le routage, ils peuvent apprendre les préférences du routeur plutôt que des approches indépendantes. Cela peut rendre les réponses à travers les modèles plus uniformes et intégrer des biais qui persistent avec le temps.

Stratégies pour briser le cycle

Réduire les risques des boucles cachées nécessite une conception active et une surveillance. La formation devrait utiliser des sources de données diverses, et non seulement les clics ou les commutations des utilisateurs. Le routage aléatoire occasionnel peut également empêcher qu’un modèle ne monopolise un type de tâche. La surveillance est essentielle. Des audits réguliers peuvent révéler si un routeur dérive vers certains modèles ou s’appuie trop sur un seul modèle. La transparence dans les décisions du routeur aide les chercheurs à détecter les biais tôt.

Les routeurs devraient également être réentraînés périodiquement avec des données fraîches et équilibrées afin que les anciens biais ne soient pas verrouillés. L’intégration d’une surveillance humaine, en particulier dans des domaines sensibles, ajoute une autre couche de responsabilité. Les humains peuvent identifier lorsque un routeur favorise systématiquement un modèle ou mal classe certaines requêtes.

La clé est de traiter le routeur comme un modèle soumis à la rétroaction, et non comme un composant fixe ou neutre. En reconnaissant comment les routeurs sont eux-mêmes façonnés par les données qu’ils créent, les chercheurs et les développeurs peuvent concevoir des systèmes qui restent équitables, adaptables et fiables avec le temps.

En résumé

Les routeurs de modèles offrent des avantages clairs en termes d’efficacité et d’adaptabilité, mais ils comportent également des risques cachés. Les boucles de rétroaction au sein de ces systèmes peuvent silencieusement amplifier les biais, limiter la diversité des réponses et verrouiller les modèles dans des modèles de comportement étroits. À mesure que ces architectures deviennent plus courantes, reconnaître et traiter ces risques tôt sera clé pour construire des systèmes d’IA qui restent équitables, fiables et réellement adaptables.