Andersonin kulma

Käyttäen tekoälyä elokuvan grainin simuloimiseen

Make America Grainy Again: uusi tekoälytyökalu voi poistaa elokuvan grainin vanhasta kuvamateriaalista, pakata videon murto-osaan sen koosta ja sitten palauttaa grainin, jotta katsojat eivät huomaa mitään. Se toimii olemassa olevien video-standardeiden kanssa ja leikkaa kaistanleveyttä jopa 90 prosentilla, säilyttäen samalla vintage-tyylin.

Monille meistä, jotka katsottelevat elokuvia tai vanhoja TV-ohjelmia, elokuvan grainin “sirppi” on turvallinen; vaikka emme tietoisesti rekisteröi sitä, grain kertoo meille, että se, mitä katsomme, on tehty kemikaaleilla, ei koodilla, ja sitoo kokemuksen fyysiseen maailmaan: valokuvausvalinnan, valotus, laboratoriotilastojen ja menneiden aikojen kautta:

Hollywoodin lähestymistapa grainiin on muuttunut kulttuurin ja tuotantotapojen mukaan. 1960-luvulla kehittyvät kameran valmistusmenetelmät ja valokuvauksen käytännöt vaikuttivat vuosikymmenen omaleimaiseen visuaaliseen identiteettiin. Myöhemmin ohjaajat, jotka työskentelivat digitaalisesti, alkoivat jälleen esittää grainia tarkoituksella. 1980-luvun puolivälissä ohjaaja James Cameron valitsi erityisen karkean Kodak-filmin elokuvaan Aliens (1986, alhaalla oikealla kuvassa), luultavasti parantamaan ilmapiiriä ja samalla auttamaan piilottamaan langat käytännön VFX-miniatyötyöstä. Lähde: https://archive.is/3ZSjN (oma viimeisin artikkeli aiheesta)

Analoginen tekstura tulee ajalta, jolloin median tuottaminen maksoi oikeaa rahaa, pääsy oli rajoitettu, ja oli ainakin löyhä vaikutelma, että vain kyvykkäimmät tai määrätietoisimmat pystyivät pääsemään läpi, toimien lyhenteenä realismin ja luotettavuuden kannalta – ja kun korkean resoluution tallennusteknologiat poistivat sen, nostalgia.

Christopher Nolan ei koskaan vaihtanut. Kun suurin osa teollisuudesta omaksui digitaalisen nopeuden ja joustavuuden vuoksi, tunnettu ohjaaja puolusti selluloidia sekä kurin ja esteettisenä.

Denis Villeneuve, joka työskentelee neliön digitaalisten putkien sisällä, parsii edelleen kuvamateriaalinsa valokemiallisten prosessien kautta. Dune-elokuville, jotka kuvattiin digitaalisesti, kuvamateriaali tulostettiin elokuvafilmiin ja sitten skannattiin takaisin digitaaliseen muotoon, yksinomaan ilmapiirin ja vaikutuksen vuoksi.

Väärä Grain

Elokuvan ja TV-laadun harrastajat yhdistävät näkyvän grainin korkeaan resoluutioon, jossa bittinopeus (määrä dataa, joka syötetään jokaiseen kehykseen) on niin korkea, että jopa pienimmät yksityiskohdat, kuten halidihiukkaset, säilytetään.

Kuitenkin, jos suoratoistopalvelut todella tarjoaisivat tällaista bittinopeutta, se aiheuttaisi vakavia rasitteita verkkokapasiteettiin ja todennäköisesti aiheuttaisi puskurointia ja tökkimistä. Sen vuoksi alustat, kuten Netflix luo optimoidut AV1-versiot sisällöstään ja käyttää AV1-kooderin ominaisuuksia lisätäkseen grainia elokuvaan tai jaksoon älykkäällä ja sopivalla tavalla, säästäen 30 prosenttia kaistanleveydestä prosessissa.

AV1 on suunniteltu sisällyttämään keinotekoinen elokuvan grain, kuten näissä esimerkeissä. Lähde: https://waveletbeam.com/index.php/av1-film-grain-synthesis

‘Grain-fetissi’ on suhteellisen harvinainen digitaalinen vastine atavistisiin suuntauksiin, kuten vinyylilevyjen uudelleenheräämiseen, ja on vaikea sanoa, onko sitä käytetty suoratoistopalveluissa tehdäkseen erittäin optimoidun videon näyttämään kuin todella kalliista ‘raakavideota’ (niille katsojille, jotka ovat tiedostamatta yhdistäneet nämä ominaisuudet), tehdäkseen bittinopeuden näyttämään korkeammalta kuin se on; tai häivyttääkseen havaittavissa olevan laadun laskun, jonka vanhat 4:3-ohjelmat muuten ottaisivat, kun suoratoistopalvelut leikkaavat ne laajakuvaksi; tai vain jäädyttääkseen retro ‘Nolan-estetiikkaa’ yleensä.

Grain Siloed

Ongelma on, että grain on myös melua. Digitaaliset järjestelmät vihaavat melua, ja suoratoistokoodit, kuten AV1, poistavat sen säästääkseen kaistanleveyttä, ellei grain-asetuksia määritetä nimenomaisesti. Vastaavasti tekoälypohjaiset ylösasteettavat kuten Topaz Gigapixel -sarja kohdellaan grainia virheenä, joka on korjattava.

Diffuusiopohjaisessa kuvasynteesissä grain on erittäin haasteellista luoda, koska se edustaa äärimmäistä yksityiskohtaisuutta, ja siksi se ilmestyisi yleensä vain massiivisesti ylisopivissa malleissa, koska koko latentti-diffuusiomallin (LDM) arkkitehtuuri on suunniteltu purkamaan melun (kuten grain) selkeäksi kuvaksi, ei kohdella grain-hiukkasia implisiittisinä ominaisuuksina mediassa.

Sen vuoksi on haasteellista luoda vakuuttavaa grainia tekoälyllä. Ja vaikka se olisi mahdollista, sen suora renderöinti optimoituun videoon vain paisuttaisi videon tiedostokokoa takaisin ylös.

Johtuen tästä jälkimmäisestä logistisesta huomioonotosta, viimeisimmän videokoodien, kuten Versatile Video Coding (VVC): n, tarjoaa grainia laittomana palveluna.

VVC pakkaa puhdas, meluttoman videon ja hylkää grainin. Sen sijaan, että dataa haaskataan yritettäessä säilyttää satunnaisia korkeataajuisia grain-malleja, se analysoi grainin erikseen ja koodaa pieni joukon parametreja (esim. Amplitudi, taajuus ja sekoitusmalli), jotka kuvaavat, miten grainia voidaan uudelleen luoda toistettaessa.

Nämä parametrit tallennetaan FGC-SEI (Elokuvan Grainin Ominaisuuksien Lisätieto) -virtaan, joka kulkee päävirtauksen rinnalla. Dekoodauksen jälkeen synteesimoduuli käyttää näitä ohjeita uudelleen luodakseen keinotekoista grainia, joka jäljittelee alkuperäistä.

Tämä säilyttää ‘korkean bittinopeuden, grain-rikkaan emulsion’ ulkonäön, pitäen samalla todellisen bittinopeuden alhaisena, koska kooderin ei tarvitse kuluttaa resursseja epäilyttävän melun säilyttämiseen.

Lisäksi, kuten erillisten tekstitys-tiedostojen kanssa, tämä keinotekoinen ‘grain’-sisältö on spesifinen kyseiselle videolle; holtittomasti soveltamalla yleisiä grain-suotimia alustoilla, kuten Photoshop tai After Effects, tai automaattisissa prosessoinneissa, ei tulosta ‘sovitettua’ grainia, vaan sen sijaan irrallista melun päällystelevää:

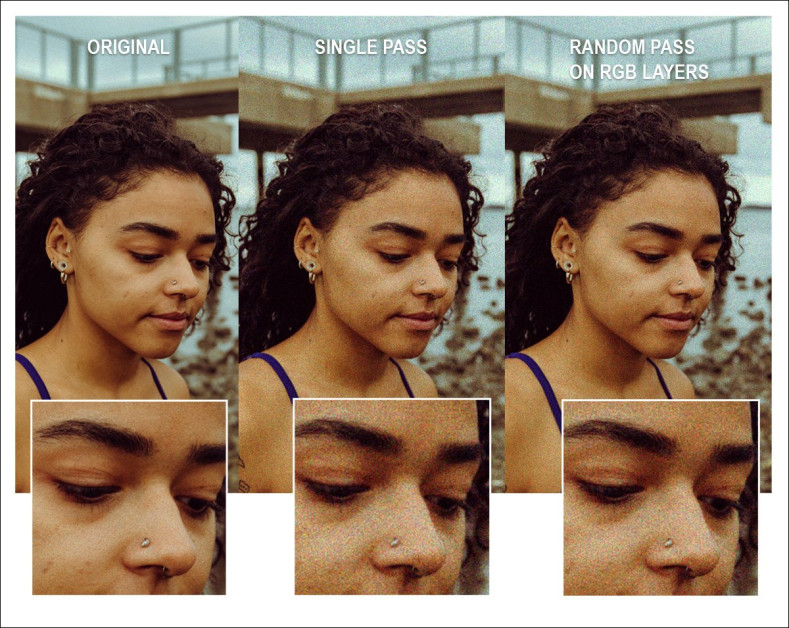

Vasen: alkuperäinen kuva. Keskellä: Photoshop Camera Raw Grain sovellettu yhdenmukaisesti kaikkiin kanaviin. Oikea: sama Grain-suodin sovellettu yksittäin kuhunkin kanavaan peräkkäin. Lähdekuva (CC0): https://stocksnap.io/photo/woman-beach-FJCOO6JWDP (omasta aiemmasta artikkelistani)

Photoshopin ‘Grain’-suodin lisää yhdenmukaista satunnaista melua; mutta oikea elokuvan grain tulee halidi-kiteistä eri kokoisista. Suodattimen soveltaminen kuhunkin kanavaan erikseen (ks. yllä oleva kuva) luo vain enemmän kaaosta, ei realisimia. Oikea elokuvan grain heijastaa, miten valo osuu kerroksiin valotushetkellä. Sen simuloiminen vaatisi arvioimista, miten eri alueet kuvasta aktivoivat kunkin halidi-kerroksen, ei pelkästään jakamalla vaikutus RGB-kerrosten yli.

FGA-NN

Tähän epäilyttävään tavoitteeseen tulee uusi tutkimuspaperi Ranskasta – lyhyt mutta mielenkiintoinen ulosanti, joka tarjoaa määrällisesti ja laadullisesti paremman menetelmän grainin analysointiin ja luomiseen:

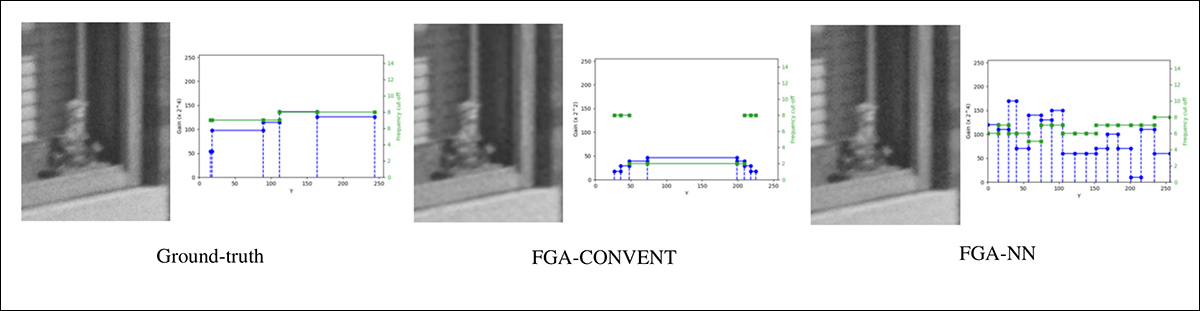

Vertailu alkuperäisen grainin ja eri analyysi- ja synteesimenetelmien tuloksien välillä. Lähde: https://arxiv.org/pdf/2506.14350

Uusi järjestelmä, joka on nimeltään FGA-NN, ei poikkeuta perinteisestä Gaussian-pohjaisesta grain-synteesistä VVC-yhteensopivan menetelmän, Versatile Film Grain Synthesis (VFGS), kautta. Mitä järjestelmä muuttaa, on analyysi, joka käyttää neuroverkkoa arvioimaan synteesiparametreja tarkemmin

Sen vuoksi lopullinen grain on edelleen syntetisoitu samalla perinteisellä Gaussian-mallilla – mutta verkko syöttää parempaa metatietoa standardiin, sääntöpohjaiseen generaattoriin, saavuttaen tilanhuipputason mallin.

Uusi paperi on otsikoitu FGA-NN: Elokuvan Grainin Analyysi Neuroverkko, ja se tulee kolmelta tutkijalta InterDigital R&D: stä, Cesson-Sévigné. Vaikka paperi ei ole pitkä, tarkastellaan joitakin uuden menetelmän edistysaskelien avainasioita.

Menetelmä

Yhteenvetona: FGA-NN-järjestelmä ottaa grainisen videon syötteenä ja poistaa siitä tiiviin grainin kuvaus, tulostaen parametrit standardoituun FGC-SEI-muotoon, jota käytetään monissa modernissa koodeissa. Nämä parametrit välitetään videon mukana, mahdollistaen dekooderille grainin uudelleenluomisen VFGS: n avulla, sen sijaan, että grainia koodataan suoraan.

Elokuvan grainin analysointi- ja uudelleensoveltamisskeema videon jakelussa, käyttäen FGA-NN: ää parametrin poistoon ja VFGS: ää synteesiin.

Koulutusverkon kouluttamiseksi kirjoittajat tarvitsivat pareja grainisista videoista ja vastaavia FGC-SEI-metatietoja. Koska useimmat grainiset kuvamateriaalit eivät sisällä tällaista metatietoa, tutkijat loivat oman tietokannan luomalla FGC-SEI-parametreja, soveltamalla keinotekoista grainia puhaisiin videoihin ja käyttämällä niitä koulutus-esimerkkeinä.

FGA-NN: n koulutusdata luotiin soveltamalla keinotekoista grainia puhaisiin kuvamateriaaleihin BVI-DVC ja DIV2K -tietokannoista. Satunnaistetut FGC-SEI-parametrit luotiin ja käytettiin VFGS-synteesityökalun kanssa, mahdollistaen kunkin grainisen videon parittamisen tunnetuin metatiedoilla.

Taajuuspohjainen malli, jota tukevat nykyiset videostandardit, käytettiin, ja parametri-alueet rajoitettiin säilyttämään visuaalinen uskottavuus sekä luma- että kroma-kanavilla.

Koulutusdata uudelle kokoelmalle luotiin soveltamalla keinotekoista grainia puhaisiin kuvamateriaaleihin BVI-DVC ja DIV2K -tietokannoista. Satunnaistetut FGC-SEI-parametrit luotiin ja käytettiin Versatile Film Grain Synthesis (VFGS) -työkalun kanssa, mahdollistaen kunkin grainisen videon parittamisen tunnetuin metatiedoilla.

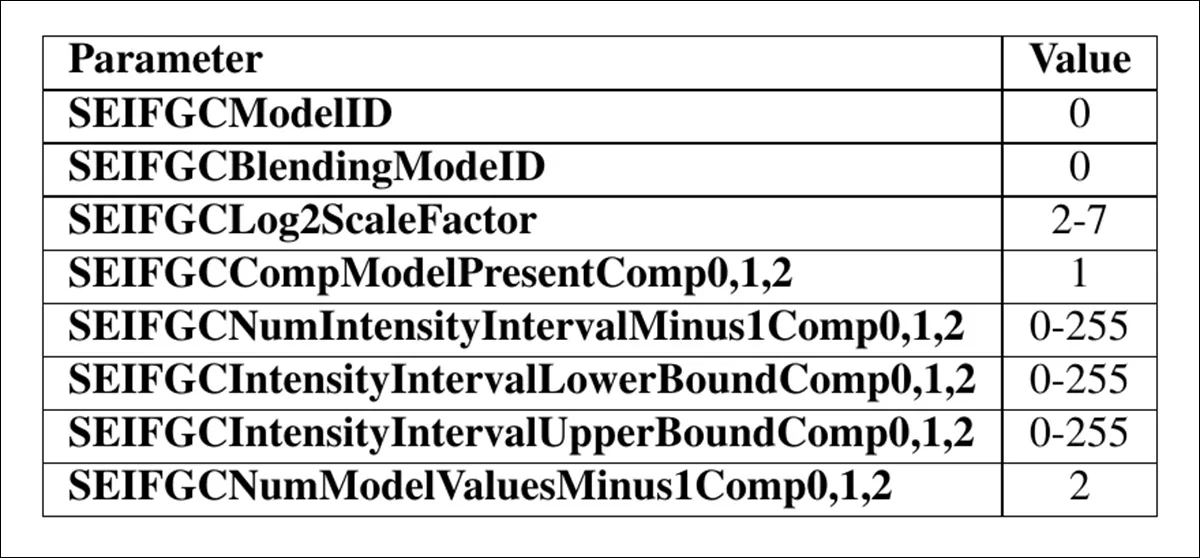

Yleiskatsaus satunnaistetuista FGC-SEI-parametri-alueista, joita käytettiin keinotekoisen grainin luomiseen koulutukseen, sovellettuna puhaisiin kuvamateriaaleihin BVI-DVC- ja DIV2K-tietokannoista. Parametrit rajoitettiin säilyttämään visuaalinen uskottavuus sekä luma- että kroma-kanavilla.

Taajuus-suodinmalli, joka on ainoa nykyisten koodekien toteutusten tukema synteesimenetelmä, kuten VVC Test Model (VTM), käytettiin koko ajan. Parametri-alueet rajoitettiin säilyttämään visuaalinen uskottavuus sekä luma- ja kroma-kanavilla.

Verkkovaikutus

FGA-NN sisältää kaksi koordinoitua mallia, luma- ja kroma-kanaville, jotka on suunniteltu ennustamaan tarkat parametrit, joita tarvitaan realistisen elokuvan grainin luomiseen.

Kunkin syötekuvalle järjestelmä arvioi joukon intensiteettivälejä, skaalauksenkohtia, jotka liittyvät kunkin väliin, vaakasuoria ja pystysuoria leikkaustaajuksia ja kokonaista säätöä, jota kutsutaan Log2Scale-tekijäksi. Tätä varten malli käyttää jaettua piirrustus-ekstraktoria, joka prosessoi grainisen syötekuvalle ja syöttää neljään erilliseen lähtöhaaraan, joista kunkin on vastuussa eri ennustustehtävistä:

Luma-version FGA-NN: n arkkitehtuuri. Jaettu runko poistaa piirteitä grainisesta syötekuvalle ja syöttää neljään erilliseen lähtöhaaraan, jotka on suunniteltu eri parametri-ennustustehtävistä: välien rajoitukset, skaalaukset, leikkaustaajuudet ja globaali Log2Scale. Kroma-verkko käyttää samaa rakennetta, mutta sovittaa syöte- ja lähtöulottuvuuksia.

Välien rajoitukset ennustetaan regressiolla, kun taas skaalaukset, leikkaustaajuudet ja globaali skaalaus ovat luokittelutehtäviä.

Arkkitehtuuri on sovitettu kunkin tehtävän monimutkaisuuden mukaan, ja suuremmat sisäiset kerrokset käytetään tarkempien ennustusten tekemiseen; erityisesti kroma-malli heijastaa luma-rakennetta, mutta sovittaa värien ominaisuuksiin.

Koulutus ja testit

FGA-NN koulutettiin neljällä objektiivifunktiolla, joista kunkin on vastuussa yksi sen ennustustehtävistä. Luokittelulähtöille käytettiin kategoriaa cross-entropia-hävikkiä vähentämään kuilua ennustettujen luokkien ja todellisen tiedon välillä.

Välien rajoitukset normalisoitiin 0-1-alueelle ja optimoitiin yhdistetyllä hävikillä: eksponentiaalisesti skaalatulla L1 hävikillä (expL1), joka rangaisti suurempia virheitä voimakkaammin, ja monotonicity-rangaistuksella, joka esti laskevia suuntauksia. Kaikki neljä hävikkiä yhdistettiin, ja suuret painot määrättiin leikkaus- ja skaalauksille, kun taas välien rajoitukset ja Log2Scale painotettiin 1: ksi ja 0,1: ksi.

Koulutus suoritettiin Adam -optimoinnin alla, 5e-4: n oppiamissuhteella, 10 000 iteroinnissa, 64: n eränkoossa.

Ainoa vertailukelpoinen työkalu, joka soveltuu vertailutesteihin, on FGA-CONVENT, joka myös tuottaa arvoja FGC-SEI-muodossa, ja käytetään grainin käsittelyyn. Molemmat järjestelmät testattiin UHD- sekvensseissä JVET:n subjektiivisesta arviointijoukosta, käyttäen kuvamateriaalia, joka sisälsi oikeaa elokuvan grainia.

Pystysuorat viivat osoittavat intensiteettivälien rajoja, kun taas Log2Scale-voimakkuus on mainittu akselin merkinnässä.

Kirjoittajat toteavat:

‘Yksi voi havaita, että FGA-NN havaitsee tarkasti elokuvan grain-mallin ja -amplitudin yleisen suunnan, johtaen syntetisoituun kuvaan, jolla on havainnollisesti samanlainen elokuvan grain kuin alkuperäisillä.

‘Toisaalta FGA-CONVENT ennustaa alempaa skaalaukselle, jota kompensoidaan vastaavasti alempaa Log2Scale-tekijällä sen suunnittelun vuoksi, ja taipuu luomaan karkeamman elokuvan grain-mallin kuin viite, johtaen erilaiseen mutta visuaalisesti yhdenmukaiseen ulkonäköön.’

He huomauttavat, että suora vertailu alkuperäisen grainin parametreihin on epäluotettavaa, koska skaalaus ja Log2Scale voivat korvata toisiaan, ja pienet virheet usein vaikuttavat vähän visuaaliseen vaikutukseen.

Uskon koetus

Elokuvan grainin uskaillinen todennettiin neljällä työvirralla: FGA-NN VFGS: n kanssa; FGA-CONVENT plus VFGS; Style-FG; ja 3R-INN. Testit käyttivät sekä FGC-SEI- että FilmGrainStyle740k -tietokantoja, vertaamalla tuloksia alkuperäisiin Learned Perceptual Similarity Metrics (LPIPS); JSD-NSS; ja Kullback–Leibler (KL) -hävikki.

Vertailutulokset FilmGrainStyle740k-tietokannasta. Style-FG ja 3R-INN suorittavat parhaiten, koska ne on koulutettu tällä tietokannalla, FGA-NN seuraa läheisenä. FGA-CONVENT suoriutuu heikosti, mikä heijastaa sen riippuvuutta monikehyksisestä analyysistä ja homogeenisista alueista – ehtoja, joita ei täytetä tässä tapauksessa käytetyissä pienissä, tekstuuririkkaissa syötteissä.

Tästä tuloksesta kirjoittajat toteavat:

‘FilmGrainStyle740k-testijoukossa Style-FG ja 3R-INN saavuttavat parhaat tulokset, koska nämä menetelmät on koulutettu tällä tietokannalla, FGA-NN seuraa läheisenä. FGA-CONVENTin suorituskyky on alhainen molemmilla testijoukoilla.

‘Tämä johtuu siitä, että analyysi perustuu homogeenisiin alueisiin ja hyödyntää tietoa useista kehyksistä oikeassa elokuvan grainin analyysitapauksessa, kun taas tässä arvioinnissa analyysi saa yksittäisen matalaresoluutioisen kuvan (256×256 maksimissaan 768×512), joka usein sisältää merkittävää tekstuuria.

‘Tämä vaikeuttaa haastetta perinteisille analyysimenetelmille, ja tekee FGA-CONVENTin soveltamisen mahdottomaksi tällaisiin pieniin kuviiin.’

Lopulta kirjoittajat toteavat, että vaikka oppimiseen perustuvat menetelmät, kuten 3R-INN ja Style-FG, tuottavat vahvoja visuaalisia tuloksia kokoelmista, niiden korkea laskennallinen kustannus tekee niistä sopimattomia käyttöön loppukäyttäjien laitteissa.

Vertailu matalan bittinopeuden kehyksistä, joita on parannettu eri analyysi- ja synteesityövirroilla (kolmas viimeinen sarakkeista).

Vertailun sijaan ehdotettu lähestymistapa, joka yhdistää kevyen FGA-NN-analyysimoduulin tehokkaaseen VFGS-synteesimenetelmään, jota kirjoittajat kuvaavat toimivammaksi ja käyttökelpoisemmaksi ratkaisuksi elokuvan grainin palauttamiseen pakatussa videossa.

He toteavat, että FGA-NN: n hyödyt ovat mahdollisesti merkittäviä, suuressa mittakaavassa:

‘Koodaamalla UHD-videota elokuvan grainilla keskitasoisilla tai matalilla bittinopeuksilla käyttäen elokuvan grainin analyysi- ja synteesityövirranne, voidaan saavuttaa jopa 90 prosentin bittinopeuden säästö verrattuna korkean bittinopeuden koodaukseen.’

Johtopäätös

Elokuvan grainiin liittyvä pakkomielteinen ajattelu on yksi outoimmista ja hämmästyttävimmistä post-analogisen ajan harhakuvista, ja on mielenkiintoista huomata, että se, mikä kerran katsottiin rajoituksena, on nyt muuttunut todellisuuden ja aidon tilan symboleiksi itsessään, jopa uudelle sukupolvelle, joka on syntynyt emulsion laskun jälkeen.

On huomattava, että mikään valtavirtaisten grainin luomismenetelmistä, mukaan lukien tämä viimeisin innovaatio, ei voi tarkasti vangita oikean vaikutusta, miten valo vaikuttaa halidi-kerroksiin todellisessa valokemiallisessa prosessissa, eri olosuhteissa.

Ensijulkaistu keskiviikkona, 18. kesäkuuta 2025