Andersonin kulma

Etsimässä ’pöllöjä ja liskoja’ mainostajan yleisössä

Koska online-mainonnasta arvioidaan käytetyn 740,3 miljardia Yhdysvaltain dollaria vuonna 2023, on helppo ymmärtää, miksi mainostusyritykset panostavat merkittäviä resursseja tähän tiettyyn tietokoneen näön tutkimuksen suuntaan.

Vaikka ala on eristäytyvä ja suojeleva, se julkaisee toisinaan tutkimuksia, jotka viittaavat edistyneempään omistajaan kasvo- ja silmänseurantatutkimuksessa – mukaan lukien ikäntunnistus, joka on keskeinen väestötilastojen analytiikassa:

Ikän arvioiminen villinä mainoskontekstina on mielenkiintoista mainostajille, jotka voivat kohdistaa tietyn ikäryhmän. Tässä kokeellisessa esimerkissä automaattisesta kasvojen ikäarvioinnista seurataan esittäjä Bob Dylanin ikää vuosien varrella. Lähde: https://arxiv.org/pdf/1906.03625

Nämä tutkimukset, jotka harvoin ilmestyvät julkisissa tietokannoissa, kuten Arxiv, käyttävät lailliseen rekrytointiin osallistuneita osallistujia AI-vetoinen analyysi, jonka tavoitteena on määrittää, kuinka paljon ja millä tavoin katsoja on sitoutunut mainokseen.

Dlibin Histogram of Oriented Gradients (HoG) käytetään usein kasvoarviojärjestelmissä. Lähde: https://www.computer.org/csdl/journal/ta/2017/02/07475863/13rRUNvyarN

Eläinten vaisto

Tässä suhteessa mainosala on kiinnostunut määrittämään väärät positiiviset (tilanteita, joissa analyysijärjestelmä tulkitsee väärin kohteen toimintaa) ja luomaan selkeät kriteerit siitä, milloin henkilö, joka katsoo heidän mainoksiaan, ei ole täysin sitoutunut sisältöön.

Näytön perusteella mainonnassa tutkimukset keskittyvät kahteen ongelmaan kahteen ympäristöön. Ympäristöt ovat “työpöytä” tai “mobiili”, joilla kummallakin on omat ominaisuudet, jotka vaativat räätälöityjä seurantaratkaisuja; ja ongelmat – mainostajan näkökulmasta – edustavat pöllön ja liskon käyttäytymistä – katsojien taipumusta ei huomioida täysin mainosta, joka on heidän edessään.

Esimerkkejä ‘pöllön’ ja ‘liskon’ käyttäytymisestä mainosalan tutkimushankkeen kohteena. Lähde: https://arxiv.org/pdf/1508.04028

Jos käännät päätäsi pois tarkoitettuun mainokseen koko päällä, tämä on ‘pöllön’ käyttäytymistä; jos pään asento on staattinen, mutta silmäsi vaeltavat pois näytöltä, tämä on ‘liskon’ käyttäytymistä. Analytiikassa ja uusien mainosten testauksessa nämä ovat olennaisia toimintoja, joita järjestelmän on kyettävä havaitsemaan.

SmartEyen Affectiva-yritys julkaisi uuden tutkimuksen, joka tarjoaa arkkitehtuurin, joka hyödyntää useita olemassa olevia kehyksiä yhdistääksesi yhdistetyn ja yhdistetyn ominaisuusjoukon kaikkiin vaadittuihin olosuhteisiin ja mahdollisiin reaktioihin – ja pystyäkseen sanomaan, onko katsoja väsynyt, sitoutunut tai jollain tavoin etäinen sisällöstä, jonka mainostaja haluaa heidän katsovan.

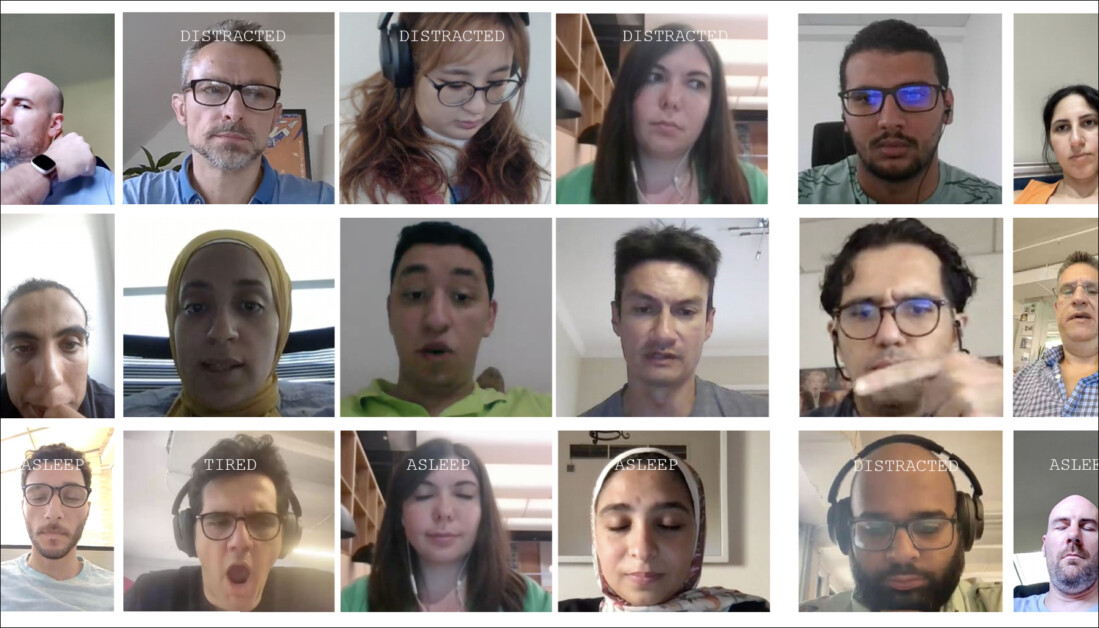

Esimerkkejä tosista ja vääristä positiivisista havainnoista uuden huomion järjestelmästä eri häiriösignaaleille, esitettynä erikseen työpöytä- ja mobiililaitteille. Lähde: https://arxiv.org/pdf/2504.06237

Kirjoittajat toteavat:

‘Rajoitettu tutkimus on tutkinut huomion seuraamista online-mainonnassa. Vaikka nämä tutkimukset keskittyivät pään asennon tai silmänseurannan arvioimiseen väärän katseisuunnan havaitsemiseksi, ne jättävät huomiotta tärkeitä parametreja, kuten laitetyyppi (työpöytä tai mobiili), kameran sijoittelu suhteessa näyttöön ja näytön koko. Nämä tekijät vaikuttavat merkittävästi huomion havaitsemiseen.

‘Tässä tutkimuksessa esitämme arkkitehtuurin huomion havaitsemiseksi, joka kattaa useita häiriöitä, mukaan lukien sekä pöllön että liskon käyttäytymisen – katsojien taipumus ei huomioida täysin mainosta, joka on heidän edessään.

‘Toisin kuin aiemmat lähestymistavat, menetelmämme yhdistää laitteistokohtaisia ominaisuuksia, kuten laitetyyppi, kameran sijoittelu, näytön koko (työpöydissä) ja kameran suunta (mobiililaitteissa) raakojen silmänseuranta-arvioiden kanssa parantamaan huomion havaitsemisen tarkkuutta.’

Uusi tutkimus uusi tutkimus on nimeltään Online-mainosten aikaisen katsojan huomion seuraaminen, ja se on neljän tutkijan työ Affectivasta.

Menetelmä ja data

Largely salaisen ja suljetun luonteen vuoksi nämä järjestelmät eivät vertaa kirjoittajien lähestymistapaa suoraan kilpailijoiden kanssa, vaan esittävät tuloksensa ainoastaan ablaatio-tutkimuksina; eikä tutkimus noudata yleensä tietokoneen näön kirjallisuuden muotoa. Siksi tarkastelemme tutkimusta sellaisena, kuin se on esitetty.

Kirjoittajat korostavat, että vain rajoitettu määrä tutkimuksia on keskittynyt huomion havaitsemiseen erityisesti online-mainonnassa. AFFDEX SDK: ssä, joka tarjoaa reaaliaikaisen monikasvojen tunnistamisen, huomio arvioidaan ainoastaan pään asennosta, ja osallistujat on merkitty huomiotta, jos heidän päänsä kulma ylittää määritetyn kynnyksen.

Esimerkki AFFDEX SDK: sta, Affectivan järjestelmästä, joka riippuu pään asennosta huomion osoittimena. Lähde: https://www.youtube.com/watch?v=c2CWb5jHmbY

Vuonna 2019 tehdyn yhteistyön Automaattinen visuaalisen huomion mittaaminen videosisällössä syvän oppimisen avulla kokoelmaan kuului noin 28 000 osallistujaa, jotka oli merkitty eri huomiotta oleville käyttäytymisille, mukaan lukien katsominen pois, silmien sulkeminen tai osallistuminen ei-liittyviin toimintoihin, ja CNN-LSTM-malli koulutettiin huomion havaitsemiseksi kasvojen ulkonäöstä ajassa.

Vuoden 2019 tutkimuksesta esimerkki, joka havainnollistaa ennustettuja huomiotiloja katsojalle, joka katsoo videosisällöntä. Lähde: https://www.jeffcohn.net/wp-content/uploads/2019/07/Attention-13.pdf.pdf

Kuitenkin kirjoittajat toteavat, että nämä aiemmat pyrkimykset eivät ottaneet huomioon laitteistokohtaisia tekijöitä, kuten laitetyyppiä (työpöytä tai mobiili); eikä näytön kokoa tai kameran sijoittelua. Lisäksi AFFDEX-järjestelmä keskittyy vain silmänseurannan havaitsemiseen ja jättää huomiotta muut häiriölähteet, kun taas vuoden 2019 tutkimus yritti havaita laajemman joukon käyttäytymisesti, mutta sen käyttämä yksinkertainen CNN saattaa olla riittämätön tämän tehtävän suorittamiseen.

Kirjoittajat toteavat, että jotkut suosituimmat tutkimukset tällä alalla eivät ole optimoituja mainonnan testaamiseen, jolla on erilaiset vaatimukset verrattuna alueisiin, kuten ajamiseen tai koulutukseen – joissa kameran sijoittelu ja kalibrointi ovat yleensä ennalta määritettyjä, ja joissa toiminta perustuu kalibroimattomiin asetelmiin ja toimii rajoitettujen silmänseurantarakenteiden puitteissa.

Siksi he ovat kehittäneet arkkitehtuurin katsojan huomion havaitsemiseksi online-mainonnassa, hyödyntäen kahta kaupallista työkalupakettia: AFFDEX 2.0 ja SmartEye SDK.

Esimerkkejä kasvoanalyysistä AFFDEX 2.0: sta. Lähde: https://arxiv.org/pdf/2202.12059

Nämä aiemmat työt poimivat alhaiset ominaisuudet, kuten kasvoilmeet, pään asento ja silmänseuranta – jotka poimitaan edellä mainittujen AFFDEX 2.0 ja SmartEye SDK: n avulla.

Nämä ominaisuudet muunnetaan sitten korkeamman tason osoittimiksi, joista kunkin häiriötyyppi käsitellään erillisellä binäärisellä luokittelijalla, joka on koulutettu omassa tietokannassaan itsenäiselle optimoinnille ja arvioinnille.

Ehdotetun seurantajärjestelmän schema.

Katse -malli määrittää, katsooko katsoja näyttöä vai ei, käyttäen normalisoituja katsekoordinaatteja, joissa on erillinen kalibrointi työpöytä- ja mobiililaitteille. Tätä prosessia auttaa lineaarinen tuki vektormalli (SVM), joka on koulutettu spatiaalisilla ja temporaalisilla ominaisuuksilla, ja joka sisältää muistin ikkunan nopeiden katseensiirtymien sileämiseksi.

Puhuminen ilman ääntä havaitaan käyttämällä suun alueita ja 3D-CNN: ää, joka on koulutettu sekä keskustelu- että ei-keskusteluvideopätkistä. Merkinnät määritetään istunnon tyypin perusteella, ja aikasuodatus vähentää väärät positiiviset, jotka voivat johtua lyhyistä suun liikkeistä.

Yökäyminen havaitaan käyttämällä täysiä kasvojen leikkausalueita, jotta voidaan havaita laajempaa kasvojen liikettä, ja 3D-CNN: ää, joka on koulutettu manuaalisesti merkityistä kehyksistä (vaikka tehtävä oli monimutkainen yökäymisen matalan frekvenssin ja muiden ilmeiden kanssa olevan samankaltaisuuden vuoksi).

Näytön hylkäys tunnistetaan kasvojen puuttumisen tai äärimmäisen pään asennon perusteella, ja ennusteet tehdään päätöspuun avulla.

Lopullinen huomiotila määritetään kiinteällä säännöllä: jos jokin moduuli havaitsee huomiotta, katsoja on merkitty huomiotta – lähestymistapa, joka priorisoi herkkyyttä, ja joka on säätetty erikseen työpöytä- ja mobiililaitteille.

Testit

Kuten mainittiin aiemmin, testit seuraavat ablaatio-menettelyä, jossa komponentit poistetaan ja vaikutus lopputulokseen huomioidaan.

Tutkimuksessa havaittuja huomiotta olevien luokkien erilaiset kategoriat.

Katsemalli tunnistaa pois näytöltä käyttäytymisen kolmessa vaiheessa: normalisoiden raakojen katsearviot, hienosäätäen tulosta ja arvioimalla näytön kokoa työpöydissä.

Ymmärtääkseen kunkin komponentin merkitystä, kirjoittajat poistivat ne yksitellen ja arvioivat suorituskyvyn 226 työpöytä- ja 225 mobiilivideota, jotka oli poimittu kahdesta tietokannasta. Tulokset, mitattuna G-mean ja F1 -arvoilla, on esitetty alla:

Tulokset, jotka osoittavat täydellisen katsemallin suorituskyvyn sekä versiot, joista on poistettu yksittäisiä prosessointivaiheita.

Jokaisessa tapauksessa suorituskyky heikkeni, kun vaihe poistettiin. Normalisointi osoittautui erityisen arvokkaaksi työpöydissä, joissa kameran sijoittelu vaihtelee enemmän kuin mobiililaitteissa.

Tutkimus arvioi myös, miten visuaaliset ominaisuudet ennustivat mobiilikameran suuntaa: kasvojen sijainti, pään asento ja silmänseuranta saivat 0,75, 0,74 ja 0,60, kun taas niiden yhdistelmä saavutti 0,91, korostaen – kirjoittajien mukaan – useiden vihjeiden yhdistämisen etua.

Puhuminen -malli, joka oli koulutettu pystysuoraa huulien etäisyydellä, saavutti ROC-AUC -arvon 0,97 manuaalisesti merkityssä testijoukossa ja 0,96 suuremmassa automaattisesti merkityssä tietokannassa, osoittaen vakaata suorituskykyä molemmissa.

Yökäymisen malli saavutti ROC-AUC-arvon 96,6 prosenttia pelkästään suun suhteen, mikä parani 97,5 prosenttiin, kun se yhdistettiin toimintayksikön ennusteisiin AFFDEX 2.0: sta.

Näytön hylkäys -malli luokitteli hetket huomiotta, kun sekä AFFDEX 2.0 että SmartEye eivät havainneet kasvoja yli yhden sekunnin ajan. Arvioinnin toteuttamiseksi kirjoittajat merkittivät manuaalisesti kaikki nämä kasvojen puuttumisen tapaukset oikean häiriön tietokannassa, tunnistamalla kunkin aktivaation taustalla olevan syyn.

Kuten tuloksien taulukossa alla on esitetty, vain 27 prosenttia “ei-kasvo”-aktivaatioista johtui siitä, että käyttäjät olivat jättäneet fyysisesti näytön.

Erilaiset saadut syyt, miksi kasvoa ei löydy tietyissä tapauksissa.

Tutkimus toteaa:

‘Vaikka näytön hylkäys muodosti vain 27 prosenttia tapauksia, jotka laukaisivat ei-kasvo-signaalin, se laukesi myös muista syistä, jotka osoittavat huomiotta, kuten osallistujien katsominen pois näytöltä äärimmäisellä kulmalla, tekeminen liikaa liikettä tai kasvojen merkittävä peittäminen esineellä/kädellä.’

Viimeisessä kvantitatiivisessa testissä kirjoittajat arvioivat, miten eri häiriösignaaleja (pois näytöltä, uneliaisuus, puhuminen, näytön hylkäys) lisääminen vaikuttaa heidän huomion mallinsa kokonaisuuden suorituskykyyn.

Testaus tehtiin kahdella tietokannalla: oikean häiriön tietokannalla ja katse -tietokannan testijoukolla. G-mean- ja F1-arvoja käytettiin suorituskyvyn mittarina (vaikka uneliaisuus ja puhuminen jätettiin pois katse -tietokannan analyysistä, koska ne eivät ole asiayhteydestä riippumatta olennaista).

Kuten alla olevasta taulukosta voidaan nähdä, huomion havaitseminen parani jatkuvasti, kun lisättiin eri häiriötyyppejä, pois näytöltä ollen yleisin häiriö, joka tarjosi vahvimman perusviiteen.

Eri häiriösignaaleja lisäämisen vaikutus arkkitehtuuriin.

Tästä tuloksesta tutkimus toteaa:

‘Ensinnäkin voidaan todeta, että kaikkien häiriösignaaleiden yhdistäminen parantaa huomion havaitsemista.

‘Toiseksi huomion havaitsemisen parantuminen on johdonmukaista sekä työpöytä- että mobiililaitteilla. Kolmanneksi mobiilien istuntojen oikea häiriö -tietokannassa on havaittavissa merkittäviä pään liikkeitä, kun katsoja katsuu pois, mikä johtaa parempaan suorituskykyyn mobiililaitteilla verrattuna työpöytälaitteisiin.

‘Neljänneksi uneliaisuuden signaalin lisääminen johtaa suhteellisen vähäiseen parantumiseen verrattuna muihin signaaleihin, koska se on harvinaista.

‘Viimeiseksi näytön hylkäyssignaali johtaa suhteellisen suurempaan parantumiseen mobiililaitteilla verrattuna työpöytälaitteisiin, koska mobiililaitteet voidaan jättää helposti huomiotta.’

Kirjoittajat vertaavat myös malliaan AFFDEX 1.0: aan, aikaisempaan järjestelmään, jota käytetään mainonnan testauksessa – ja jopa heidän mallinsa pään perusteella tapahtuva silmänseuranta ylittää AFFDEX 1.0: n molemmilla laitteilla:

‘Tämä parannus johtuu pään liikkeiden sisällyttämisestä sekä yaw- että pitch-suunnassa, sekä pään asennon normalisoinnista pienien muutosten huomioon ottamiseksi. Mobiilien oikean häiriön tietokannan voimakkaat pään liikkeet ovat aiheuttaneet päämallin suorittamisen samalla tasolla kuin AFFDEX 1.0.’

Kirjoittajat päättävät tutkimuksensa (ehkä hieman muodollisella) laadullisella testikierroksella, joka on esitetty alla.

Huomion mallin esimerkkitoistot työpöytä- ja mobiililaitteilla, joissa kunkin rivin esittävät eri häiriötyyppien tosia ja väärä positiivisia esimerkkejä.

Kirjoittajat toteavat:

‘Tulokset osoittavat, että mallimme havaitsee tehokkaasti erilaisia häiriöitä epäohjatuissa olosuhteissa. Se voi kuitenkin toisinaan tuottaa väärä positiivisia tuloksia tietyissä reunatapauksissa, kuten voimakkaassa pään kallistuksessa silmien säilyttäessä katseensa näytöllä, joissain suun peittämisissä, erittäin sumein silmin tai voimakkaasti himmentyneissä kasvojen kuvissa. ‘

Johtopäätös

Vaikka tulokset edustavat mitattua, mutta merkittävää edistystä aiempaan työhön verrattuna, tutkimuksen syvempi arvo piilee siinä, miten se antaa vihjeen katsojan sisäisen tilan pääsyyn.

Vaikka data kerättiin suostumuksesta, menetelmä osoittaa tulevaisuuden kehyksiä, jotka voivat laajentaa strukturoiduista, markkinatutkimuksen asetelmista.

Tämä melko paranoinen johtopäätös vahvistetaan vain tämän tutkimussuunnan eristäytyneen, rajoitetun ja tarkkaan suojatun luonteen kautta.

* Muunnokseni kirjoittajien sisäisistä viittauksista hyperlinkkeihin.

Julkaistu ensimmäisen kerran keskiviikkona 9. huhtikuuta 2025