Andersonin kulma

Tuomalla tekoälyllä generoidut kuvat valoon HDR:n avulla

Tekoälykuvat ja -videot saattavat olla vaikuttavia, mutta ne eivät ole ammattilaisten tasoa – ongelmaa, jota uusi tutkimushanke pyrkii ratkaisemaan.

Amatöörikuvaajien ja ammattilaisten audiovisuaalisessa yhteisössä yksi useimmin esiin tulevista vastalauseista tekoälyn tunkeutumiselle on nykyisen ammattilaisten tasoa olevien kuvan ja videon toistojen puute. Tähän kuuluu muun muassa kyky työskennellä High Dynamic Range (HDR) -kuvien ja -videoiden parissa.

HDR-kuvat ovat moderni vastine 1800- ja 1900-luvun valokuvauksen käytännölle, jossa sama kuva otetaan useita kertoja eri määrällä valoa, joka pääsee filmiin:

Yllä, lyhyt bracketoitujen kuvien sarja. Alle, korkea dynaaminen alue, joka voidaan extrapoloida näistä valokuvista yhteen kuvaan. Lähde

Perinteisessä valokuvauksessa tämä johti useisiin kuviin, jotka voitiin jonkin taidon ja vaivan jälkeen koostaa yhdeksi valokuvaksi, josta hyötyi kaikkien eri yksityiskohtien tasojen yhdistäminen. Mutta se ei ollut triviaali tai helppo prosessi.

Nyt ‘autobracketoitujen’ kuvien sarja voidaan joko tuottaa useita kuvia tai yhdistää yhdeksi HDR-kuvaksi – käytännössä moninaisuus altistuksia yhdessä kuvassa, jota HDR-kuvanmuokkausohjelmat kuten Photoshop voivat iteroida läpi ja sallia valokuvan orkesteroida yhdeksi, ihanteelliseksi lopputulokseksi.

Jos ihmettelet, miksi sinun pitäisi välittää tai miten tämä vaikuttaa omaan valokuvaukseesi, tämän artikkelin kuvitus on tarkoitettu osoittamaan tämä tutulla tavalla:

Yllä, vasemmalla näemme tyypillisen esimerkin sRGB (eli ei-HDR) -kuvasta. Pelkästään sen kirkastaminen (näytetty oikealla) ei näytä hirviötä kaapissa, koska yksityiskohta hukattiin, kun valokuvan ottaja ja kameran automaattiset prosessit päättivät, mitä priorisoida valokuvassa:

Alhaalla on osoitus (vasemmalla) siitä, kuinka “häikäisty” etualan olisi pitänyt olla valotusajankohtana rekisteröidäkseen hirviön kaapissa ei-HDR-kuvassa, ja (oikealla) kuinka hirviö uppoaa pimeyteen, kun valotus tehdään sopivaksi hyvin valaistujen etualan aiheiden mukaan:

Alhaalla näemme, minkälaista yksityiskohtaa voidaan “pelastaa” HDR-kuvasta tai -kuvien sarjasta. Tässä tapauksessa hirviö “piili” HDR-sarjan alimmassa visuaalisessa rekisterissä, tasolla, jossa muu sisältö olisi “räjähtänyt” lähes valkoiseksi (yllä, vasemmalla). Määrittelemällä, että laaja valikoima kirkkausarvoja tulisi ilmaista valikoivasti samassa kuvassa, nämä ristiriitaiset alueet voidaan koostaa yhdeksi järkeväksi kuvaksi:

Ei-HDR-kuva tunnetaan näytönviittaavana kuvana, ja korkean gamut HDR-kuva tunnetaan kohtauksenviittaavana kuvana.

HDR-videot ovat myös olemassa, ja tämä tyyppinen tonaalinen joustavuus ja muokattavuus antaa elokuvantekijöille jonkin verran tilaa pelastaa, säätää ja tulkita kuvamateriaalia useilla luovilla ja johdonmukaisilla tavoilla; ei siis yllättävää, että luovia ihmisiä vastustaa työskentely tekoälyllä generoidun sRGB-lähdön kanssa, joka on tyypillinen useimmissa generatiivisissa tekoälykehyksissä.

HDR tekoälyssä

Luonnollisesti tutkimusala on kiinnostunut siirtämään tekoälykehykset HDR-aikaan. Mutta se ei ole triviaali tehtävä, sekä tekoälyjärjestelmien perusrakenteen vuoksi, että hyvän HDR-aineiston ottaminen vaatii paljon levytilaa, mikä tekee kokoelmista kömpelöt; seurauksena, soveltuvat aineistot ovat niukkoja.

Kuitenkin yhteistyö Singaporen yliopiston ja Adobe Researchin välillä tarjoaa menetelmän HDR-kuvien tuottamiseksi, metodologia, jota voidaan teoriassa soveltaa sekä videoihin että kuvien tuottamiseen:

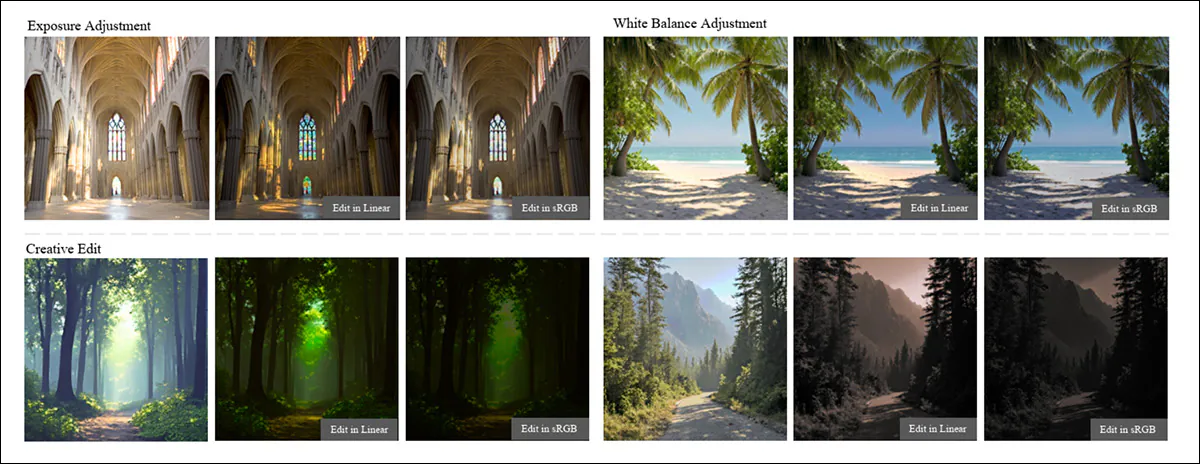

Hankkeen sivustolta uuden työn esimerkkejä ‘bracketoiduista’ teksti-kuva -tuloksista. Lähde

Uusi järjestelmä tuottaa useita saman kuvan versioita eri kirkkaustasoilla ja opettelee, kuinka kirkas kohtaus todella on, ja yhdistää nämä yhdeksi tulokseksi, joka säilyttää yksityiskohdat sekä varjoissa että korkeissa valoissa, sallien myöhempien muokkausten valotukseen tai väritykseen käyttäytyä kuin oikean kameran muokkauksena, eikä haavoittuvana muokkauksena täysin prosessoidussa kuvassa.

Järjestelmä hyödyntää useita eri malleja tehtävään, mukaan lukien Qwen ja Flux -variantteja:

Uuden paperin esimerkkejä, jotka osoittavat, miten järjestelmä voi tuottaa useita valotusversioita samasta kohtauksesta, säilyttäen samalla perusrakenteen kiinteänä. Aloittaen yksinkertaisesta reunakartasta, malli tuottaa johdonmukaisia kuvia erittäin tummista hyvin kirkkaisiin asetuksiin, riippumatta siitä, kuvaako tekstiprompti kuunvaloa, auringonvaloa, auringonlaskua tai jopa pientä esinettä, kuten ilmapalloa, aihe ja koostus säilytetään vakaana, kun ainoastaan valaistus muuttuu. Lähde

Tekijät toteavat:

‘Lineaisten kuvien generointi on haasteellista, koska esikoulutetut VAE:t latenttisissa diffuusiomalleissa kamppailevat säilyttämään ääriolosuhteita ja varjoja samanaikaisesti johtuen suuremmasta dynaamisesta alueesta ja bittisyvyydestä.

‘Tähän tarkoitukseen edustamme lineaarista kuvaa valotusbracketeiden sarjana, jokainen joka havaitsee tietyn osan dynaamisesta alueesta, ja ehdotamme DiT-pohjaista flow-matching -arkkitehtuuria teksti-ehdoitettujen valotusbrackettien generointiin.

‘Lisäksi osoitamme alihankkeiden soveltamista, mukaan lukien tekstiohjattu lineaarinen kuvanmuokkaus ja rakenne-ehdoitettu generointi ControlNetin kautta.’

Uusi työ on otsikoitu Lineaariset kuvat generoidaan syntetisoimalla valotusbracketteja, ja se tulee neljältä tekijältä S-Labista Nanyangin teknillisestä yliopistosta, Adobe NextCamista ja Adobe Researchista. Hankkeen sivuston ja YouTube-videon lisäksi on myös (tällä hetkellä niukka) GitHub-repo ja luvattu aineiston julkaisu.

Vaikka tekijät toimittavat monia esimerkkejä järjestelmän tuloksista liittyvällä hankkeen sivustolla, katsojien on tarve HDR-kelpoinen näyttö, jotta he voivat erottaa esitettyjen HDR-tulosten ominaisuudet. Kuitenkin löydät tutkijoiden YouTube-esittelyn tämän artikkelin lopussa – mutta ole tietoinen, että esitettyjen esimerkkien erot eivät välttämättä ole selviä ei-HDR-näytöllä.

Menetelmä ja aineisto

Tekijät korostavat aineiston keräämisen haasteellisuutta tässä tavoitteessa:

‘Lineaarisia kuvia on erittäin haasteellista hankkia käytännössä. Lisäksi useimmat julkiset HDR-aineistot ovat joko panoraamisia (joten ne keskittyvät lähes yksinomaan suurten kokoonpanojen sisältöön) tai eivät tarjoa todellisia lineaarisia kuvia, mikä tekee niistä sopimattomia tarkoituksiimme.

‘Sen vuoksi käytämme pääasiassa RAW-kuva-aineistoja perustana koulutukseen.’

Tutkijat käyttivät luovasti käytettävissä olevia vaihtoehtoja, hyödyntäen RAISE-aineistoa todellisena koulutusaineistona ja MIT-Adobe FiveK -aineistoa arviointiaineistona*.

Jotta voidaan luoda käytettävissä oleva HDR-koulutusaineisto, tutkijat suorittivat RAW-kameratiedostot standardoidun putken läpi, poistaakseen kamerakohtaiset ominaisuudet, ja muuttaakseen kuvat yhdenmukaiseksi, kohtaukseen viittaavaksi lineaariseksi muodoksi:

Järjestelmän työnkulun kaavio: järjestelmä aloittaa melusta, joka edustaa neljää valotusastetta samasta kohtauksesta, sekä tekstipromptia ja kirkkaustunnusta. Tämä prosessoidaan pinottujen transformer-lohkoihin, jotka pitävät eri valotukset linjassa, samalla kun säätää valaistusta. Järjestelmä sitten ennustaa sekä valotuskuvaus, että yleisen kirkkausasteikon, ja yhdistää ne yhdeksi kohtaukseen viittaavaksi kuvaksi, säilyttäen yksityiskohdat sekä varjoissa että korkeissa valoissa.

Tämä edellytti täydellisen RGB:n jälleenrakentamista anturidatasta, värin korjaamista, valkotason normalisointia ja lyhyen siirtymisen havainnolliseen väriavaruuteen häikäisyn poistamiseksi, ennen paluuta puhdasan lineaariseen signaaliin. Kohtauksen todellinen valo palautettiin kameran valotusasetusten avulla, jotta jokainen pikseli heijastaisi todellista kirkkautta eikä vain näytönvalmiin approksimaation.

Koska nämä arvot voivat vaihdella laajasti, aineistoa vakautettiin skaalauksella, jokainen kuva omalla kirkkausjakaumallaan, käyttäen keskitason ja korkeiden valojen tilastoa välttääkseen sekä häikäistyneitä kuvia että ylivalottuneita korkeita valoja, ja lopulta saavutetaan normalisoitu lineaarinen kuva, joka säilyttää kohtauksen todellisen valon alueen, säilyttäen samalla tarpeeksi vakaata koulutusta varten.

Tekstiprompdit kuville luotiin Qwen2.5-VL 7B -mallilla, ja promppteja muokattiin vastaamaan Flux-mallin ominaisuuksia, jota käytettäisiin generointiajankohtana.

Jokainen kuva jaettiin valotusviipaleisiin ja lähetettiin jaettuun VAE-encoderiin, joka muutti kaikki valotukset yhteiseen latenttiavaruuteen, joka suunniteltiin havaitsemaan kirkkauden täyden alueen. Latentit hienosäädettiin melusta, ja dekoodattiin takaisin kuvaiksi, sallien johdonmukaisen rekonstruktioon sekä tummissa että kirkkaiden alueilla, ilman niiden romahtamista yhdeksi “tasatun” valotukseksi.

LoRA-hienosäätö käytettiin sovittamaan esikoulutettu Flux-runko lineaarisiin kuviin vähäisillä lisäparametreillä, auttaen Single-Diffusion Transformers (single-DiT) -mallia pysymään vakaana, vaikka kirkkaus vaihteli valotusbracketeissa.

Valotusmuokkauksen itsehuomio (keskisarake kaaviossa yllä) otettiin käyttöön yhdessä prosessoidakseen kaikki bracketit, sallien valaistuksen mukauttamisen kullekin valotusbracketille, samalla kun rakenteellinen yksityiskohta säilytettiin linjassa.

3D Rotary Positional Embedding (3D-R[o]PE) käytettiin sekä spatiaalisen sijainnin että valotusbracketin tunnistamiseen, jotta malli voisi erottaa, mihin brackettiin kunkin token kuului, säilyttäen spatiaalisen johdonmukaisuuden, mahdollistaen puhdas erottelu kirkkauden vaihtelusta kohtauksen sisällöstä.

Aineiston yleiskatsaus tutkimuksessa, osoittaa, miten kuvat jakautuvat sisältötyypeittäin ja sisä- ja ulkotilakohtauksittain, sekä kirkkausarvojen jakautumista prosessoidussa aineistossa. Histogrammit piirtävät luminanssin ja radianssin asteikolla log-avaruudessa, osoittaen, kuinka laajasti maailmanlaajuinen kirkkaus voi vaihdella, korkeammat radianssiarvot vastaavat fyysisesti kirkkaita kohtauksia ja korostavat vahvaa dynaamista aluetta, jota malli on koulutettu käsittelemään.

3D-RoPE erotti missä piirre oli ja ‘mihin valotus se kuuluu’ eri signaaleihin, jotta kirkkauden vaihtelu voitiin mukauttaa itsenäisesti, ilman spatiaalisen yksityiskohdan vahingoittamista.

Testit

Tutkijat käyttivät Flux-deviä generatiivisena kehyksenä, koulutus tapahtui neljällä NVIDIA A100 -näytönohjaimella, jokaisella 80GB VRAM:ia. Erän koko asetettiin 4:ään (GPU:lla), 10 000 iteraatiota.

LoRA-hienosäätö käytti sijaa 64. AdamW -optimointi käytettiin oppien nopeudella 2×102 (valotusmuokkauksen osalta).

Tekijät toteavat, että vaikka on kaksi aiempaa työtä, jotka ovat samanlaisia, kumpikaan ei ollut ilmeinen ehdokas testivaiheeseen. Max Planck -johtama 2022 GlowGAN on rajoitettu tiettyihin kuvauskategorioiden tuottamiseen, kun taas 2025 Bracket Diffusion (jälleen Max Planck -instituutin johdolla) voi tuottaa vain yhden HDR-kuvan 256x256px, ja se kestää useita minuutteja.

Alkuperäisestä GlowGAN -paperista, tyypilliset matalan dynaamisen alueen (LDR) kuvat menettävät yksityiskohdat varjoissa ja korkeissa valoissa, kun taas malli oppii tuottamaan korkean dynaamisen alueen (HDR) versioita, jotka säilyttävät yksityiskohdat kirkkauden tasojen yli ja mahdollistavat täyttymättömien alueiden palauttamisen käänteisen tonemappingin kautta. Lähde

Sen vuoksi lineaarisen kuvan generoinnissa ei ole suoria vertailukohteita, tekijät vertasivat menetelmänsä soveltamalla olemassa oleviin vahvoihin malleihin, eikä tarkoituksellisiin vaihtoehtoihin.

Yksi koe (‘T2I Fine-Tuning’) hienosääteli teksti-kuva -diffuusiomallin Flux LoRA:lla, kouluttaen sen tuottamaan lineaarisia kuvia suoraan, ja arvioi, miten valmis T2I-malli sopeutui tähän alueeseen.

Toinen vertailu (‘T2V fine-tuning’) käytti teksti-videomallia Wan 2.1, jonka VAE pakkaa useita kehyksiä yhteiseen latenttiin; tässä asetelmassa neljä valotusbrackettia koodattiin yhteen latenttiin esitykseen, ja dekoodattiin takaisin, testaten, voiko video-tyyppinen putki mallintaa valotusvaihtelua.

Kolmas koe (‘T2I Model Inflation’) vertasi CameraCtrl ja Generative Photography -menetelmiä, jotka laajentavat kuvadiffuusiomalleja ajallisin moduulein, tuottaen monikehyksisiä tuloksia. Nämä sovellettiin myös samaan aineistoon koulutusta varten, jotta vertailu olisi yhdenmukainen.

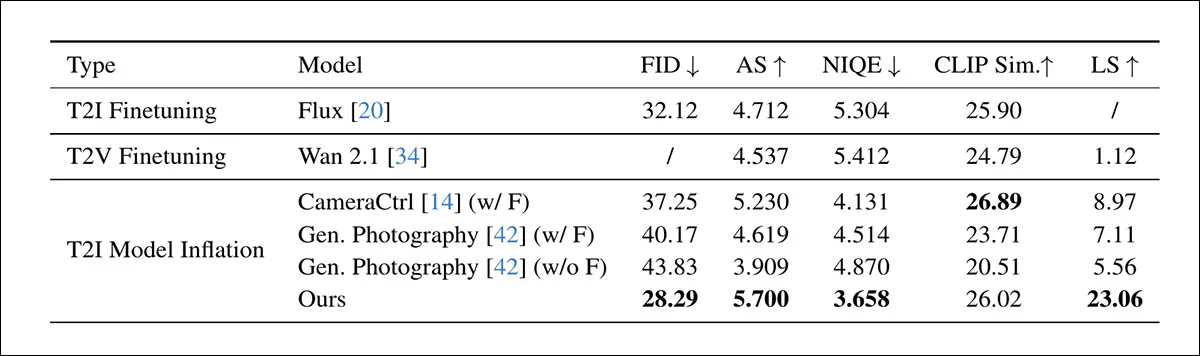

Käytetyt mittarit olivat Fréchet Inception Distance (FID); Estetiikka-arvo (AS); Naturalness Image Quality Evaluator (NIQUE); CLIP Sim -arvo; ja Luminanssin samankaltaisuus (LS):

Tekijöiden menetelmän vertailu useiden sovellettuja perusviivoja vastaan lineaaristen, kohtaukseen viittaavien kuvien generointiin. Teksti-kuva (Flux) ja teksti-videomallit (Wan 2.1) hienosäätellään LoRA:lla, testaten, miten hyvin olemassa olevat generatiiviset järjestelmät käsittelevät tämän asetelman, kun taas CameraCtrl ja Generative Photography laajentavat diffuusiomalleja ajallisin komponenteilla. Jotkin arvot puuttuvat, koska jotkin mallit eivät voi luotettavasti tuottaa johdonmukaisia valotusbracketteja, joita vaaditaan täyden dynaamisen alueen palauttamiseen. Raportoiduissa mittareissa uusi menetelmä saavuttaa vahvimmat yleiset tulokset, erityisesti mittareilla, jotka liittyvät kuvan laatuun ja tarkin kirkkauden rekonstruktioon.

Tekijät toteavat:

‘Suoraan lineaaristen kuvien kouluttaminen T2I-mallilla tekee siitä haasteellista tasapainottaa varjo- ja korkeiden valojen yksityiskohdat. T2I-mallin laajennusmenetelmät kärsivät sekä rajoitetusta dynaamisesta alueesta että merkittävistä kuvanlaadun heikkennysten jälkeen, jopa hienosäätöä.

‘T2V-hienosäätössä Wan 2.1:n 4-kertainen ajallinen alennus yhdistää 4 valotusbracketin yhteen latenttiin esitykseen, aiheuttaen merkittävän jakauman epäyhtenäisyyden, jota ei voida ratkaista pelkästään hienosäätöllä.’

‘Kohtaukseen viittaavien ominaisuuksien suora mallinnus valotusbracketeilla antaa meille ylivertaisen visuaalisen laadun ja dynaamisen alueen kaikissa vertailukohteissa.’

<img class=" wp-image-414267" src="https://www.unite.ai/wp-content/uploads/2026/04/figure-6-2.jpg" alt="Vertailu LoRA-hienosäätellyn Fluxin ja Wan 2.1:n kanssa, osoittaa, miten kunkin menetelmä käsittelee valotusmuutoksia samojen kohtauksien yli. Vastamallit taipuvat menettämään yksityiskohdat hyvin tummissa tai hyvin kirkkaiden alueilla, kun taas ehdotettu menetelmä säilyttää johdonmukaisen rakenteen ja palauttaa käyttökelpoisen yksityiskohdat koko valotusalueen yli. Viittaathan alkuperäiseen paperiin ja hankkeen sivustoon parempilaatuisten esimerkkien tulokset.

Pyynnön mukaan viitata alkuperäiseen paperiin laajennettuihin kokeisiin ja liitteiden osioon lisätutkimuksia varten.

Johtopäätös

Median ammattilaisille, kuten elokuvan ja television tuotantoon työskenteleville, sama ulostulo, joka on saanut maailman mielikuvituksen (ja yhä useammin heidän vihansa) valtaan, on jättänyt heidät epäilleiksi, koska heidän kaikki putkensa riippuvat jollain tavoin HDR:stä.

Sen vuoksi tämä on ajankohtainen hanke, edustaa mahdollisuutta, jota toivotaan tulevan valinnaisksi standardiksi uusissa kehyksissä – vaikka se todennäköisesti kaksinkertaistaa renderöintiajat; ilmeisesti myös viiveen on oltava vakavasti harkittuna, jotta HDR-ai-sisältöä ei rajoiteta “jälkituotantoon” eikä “kameran” luokkaan.

* Normaalisti näyttäisimme esimerkkejä, mutta koska lukija saattaa ei-HDR-näytöllä, jätämme ne tässä tapauksessa pois.

Ensimmäisen kerran julkaistu sunnuntaina, 26. huhtikuuta 2026