Tekoäly

Johdanto Vertex AI:hin

Tekoälymaiseman nopeasti muuttuessa yksi suurimmista esteistä teknologiajohtajille on siirtymisen “kokeellisesta” “yritysvalmiiksi”. Vaikka kuluttajachatbotit ja interaktiivinen alusta auttavat julkisen mielikuvan parantamisessa, yritykset eivät voi onnistua pelkästään chat-rajapinnan avulla. Kilpailun ollessa aggressiivisempaa kuin koskaan ennen, yrityksille tarvitaan vankka, skaalautuva ja turvallinen ekosysteemi, ja tämän tarjoaa Google Vertex AI:lla, Google Cloudin yhdistetyllä tekoäly- ja koneoppimisalustalla.

Vertex AI pyrkii vakiinnuttamaan itsensä generatiivisen tekoälyn integraation modernin pilvi-infrastruktuurin kanssa, tarjoten kattavan joukon ominaisuuksia, jotka siltaavat raaka- perusmallien ja tuotantovalmiiden sovellusten välistä kuilua. Vertex AI ei ole pelkästään suuri kielen mallien (LLM) wrapper, vaan yhdistetty koneoppimisen ja tekoälyn (ML/AI) ekosysteemi, joka kohdeltaa generatiivista tekoälyä modernin pilvi-infrastruktuurin ensisijaisena kansalaisena.

Vertex AI:n ytimessä on Malli Puutarha, joka on keskitetty markkinapaikka, josta on pääsy yli 200 valikoituun perusmalliin, mukaan lukien monimodaalinen valtavirta Gemini 2.5 Pro, jossa on hämmästyttävät 2 miljoonan tokenin kontekstiraja. Tässä artikkelissa pureudumme Vertex AI:n arkkitehtuuriin, tutkimme, miten Malli Puutarha toimii “App Storena” älykkyydelle, ja tarkastelemme teknisiä pilareita, jotka tekevät tästä alustasta seuraavan sukupolven yrityssovellusten rungon.

Ydinarkkitehtuuri: Yhdistetty Alusta

Vertex AI ei ole löyhästi kytketty työkalujen kokoelma, vaan yhdistetty data- ja tekoälyekosysteemi, joka on suunniteltu siltaamaan tekoälyyn vaikuttavaa datan, työkalujen ja tiimien fragmentaatiota. Perinteisesti tekoälykehitys tapahtuu eristetyissä ympäristöissä, ja joskus data on levitetty ja loukussa useissa tietokannoissa. Esimerkiksi organisaatiot voivat tallentaa asiakastietonsa SQL- varastoihin, kun taas rakenteettomat asiakirjat on haudattu Data Lakeen. Kun data on eristetty, tekoäly näkee vain “osittaisen totuuden”, mikä johtaa vääristyneisiin tuloksiin tai korkeisiin hallucinaatiorasioihin, koska sille puuttuu yrityksen täydellinen konteksti.

Vertex AI pyrkii integroimaan koko elinkaaren, alkaen raakadatan imuroinnista BigQueryyn ja Cloud Storageen ja päättyen tuotantoseurantaan, toimien käytännössä “yhdistävänä kudoksena” näiden silojen välillä. Vertex AI integroituu suoraan Cloud Storageen ja BigQueryyn, mahdollistaen tekoälymallien noutaa dataa ilman monimutkaisia Extraction, Transformation ja Load -putkia.

Pohja: Google:n AI- Hypercomputer

Vertex AI:n GenAI-kerros sijaitsee Google:n AI-Hypercomputer-arkkitehtuurin päällä, joka on integroitu supertietokonejärjestelmä, joka koostuu:

TPU v5p & v5e (Tensor Processing Units)

Google:n Tensor Processing Units ovat räätälöityjä ASIC:itä (Application-Specific Integrated Circuits), jotka on suunniteltu erityisesti syvän oppimisen matriisilaskentaan.

- TPU v5p (Suorituskyky): Tämä on lippulaiva- kiihdyttäjä massiivisen mittakaavan koulutukseen. Jokainen TPU v5p -podin voi skaalautua 8 960: een chippiin, jotka on kytketty Google:n korkean kaistan nopeuden Inter-Chip Interconnect (ICI) 4 800 Gbps. Teknologiajohtajalle tämä tarkoittaa 2,8-kertaa nopeampaa koulutusta GPT-3-kokoisen mallin (175B parametriä) verrattuna edelliseen sukupolveen, mikä vähentää merkittävästi markkinoille menoaikaa.

- TPU v5e (Tehtävän mukainen): Suunniteltu “kustannusoptimoituun” suorituskykyyn, v5e on työhevonen keskisuuren mittakaavan koulutukseen ja suuren läpimeno-nopeuden inferenceen. Se tarjoaa jopa 2,5-kertaa paremman hinnoittelun suorituskyvyn, mikä tekee siitä ihanteellisen valinnan yrityksille, jotka tarvitsevat suorittaa 24/7-inferenssiä ilman massiivista budjettia.

NVIDIA H100/A100 GPU:t joustavuuden vuoksi

Vaikka TPU:t ovat erikoistuneita, monet kehitystiimit riippuvat NVIDIA CUDA-ekosysteemistä. Vertex AI tarjoaa ensiluokkaisen tuen NVIDIA:n uusimmalle laitteistolle:

- NVIDIA H100 (Hopper): Ihanteellinen suurimpien avoimen lähdekoodin mallien (kuten Llama 3.1 405B) hienosäätöön, jotka vaativat massiivista muistin kaistanleveyttä.

- Jupiter-verkosto: Estämään “verkkopullonkaula”, Google käyttää Jupiter-pilvi-infrastruktuurin verkkoaineistoa. Tämä varmistaa, että data liikkuu GPU:iden välillä salamannopeasti, tukeen RDMA:ta (Remote Direct Memory Access) ohittamaan CPU:n kuormitus ja tarjota lähes paikallisen suorituskyvyn jakelu solmujen välillä.

Dynaaminen Orkestraatio

Tärkein tekninen muutos Vertex AI:ssa on Dynaaminen Orkestraatio. Perinteisessä ympäristössä, jos GPU-solmu epäonnistuu 3-viikkoisen koulutusajon aikana, koko työ voi kaatua.

- Automaattinen palautuminen: Vertex AI, usein Google Kubernetes Engine (GKE) avulla, tarjoaa “itseparantavat” solmut. Jos laitteiston virhe havaitaan, alusta siirtää automaattisesti työnkuormituksen terveeseen solmuun.

- Dynaaminen työnjakaja: Tämä työkalu sallii tiimien pyytää kapasiteettia kiireellisyyden mukaan. Voit valita Joustavan käynnistyksen (edullisempi, käynnistyy, kun kapasiteetti on saatavilla) tai Taatun kapasiteetin kriittisiin julkaisuihin.

- Palveluton koulutus: Tiimille, jotka haluavat nolla-infrastruktuurin hallintaa, Vertex AI Palveluton koulutus sallii teidän lähettää koodinne ja datanne; alusta tarjoaa klusterin, suorittaa työn ja purkaa sen – laskuttaen vain käytetystä laskentasekuntia.

Kolme sisääntulopistettä: Löytäminen, Kokeilu ja Automaatio

Sopimaan erilaisiin teknisiin henkilöihin – data- tutkijoista sovelluskehittäjiin – Vertex AI tarjoaa kolme ensisijaisia sisääntulopisteitä:

- Malli Puutarha: Löytämisen markkinapaikka.

- Vertex AI Studio: Kokeilun leikkikenttä.

- Vertex AI Agent Builder: Automaation tehdas.

Malli Puutarha: Löytämisen markkinapaikka

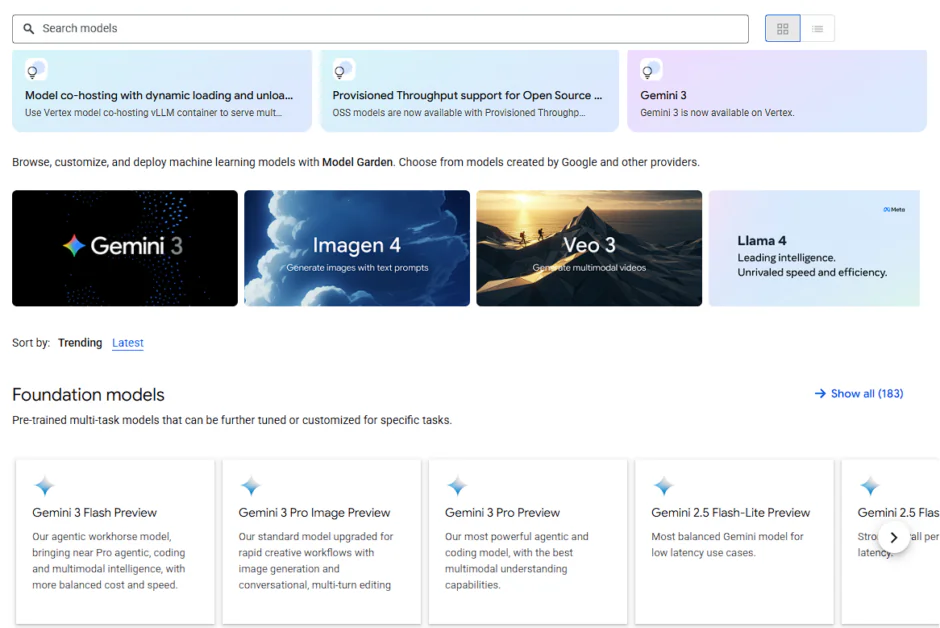

Google Cloudin Vertex AI Malli Puutarha on keskitetty alusta Google Cloudissa löytämiseksi, testaamiseksi, mukauttamiseksi ja käyttöönottoon laajasta valikoimasta ensisijaisia, avoimen lähdekoodin ja kolmannen osapuolen tekoälymalleja, mukaan lukien monimodaalisia malleja (näkemys, teksti, koodi) erilaisiin liiketoimintatarpeisiin, tarjoten suoran integraation Vertex AI:n työkalujen kanssa sujuvan MLOps:in vuoksi. Se toimii kattavana kirjastona, joka auttaa kehittäjiä ja yrityksiä valitsemaan oikean mallin (suurista perusmallista erikoistuneisiin) tehtäviinsä, olipa kyse tekstintuottamisesta, kuvan analyysistä tai koodin täydentämisestä, ja käyttöönottoon niitä tehokkaasti Google Cloud -ympäristössään.

Malli Puutarha luokittelee 200+:aan malliin kolmeen eriin tasoon, mahdollistaen arkkitehteja tasapainottaa suorituskykyä, kustannuksia ja hallintaa:

- Ensimmäisen osapuolen (Google) mallit: Nämä ovat Vertex AI:n lipunmallit, ja Google tarjoaa niitä eri koossa, aina Pro:sta monimutkaisella päättelyllä Flashiin, jossa on matala viive ja suuri volyymi, mikä mahdollistaa kehittäjien optimoida mallejaan käyttötarkoituksiin.

- Kolmannen osapuolen (omistajan) mallit: Strategisten kumppanuuksien kautta Vertex AI tarjoaa “Malli-palveluna” (MaaS) pääsyn jättiläisiin kuten Anthropic (Claude 3.5) ja Mistral AI:hen. Sen sijaan, että hallitset erillistä laskutusta ja turvallisuustunnisteita viidelle eri AI-toimittajalle, teknologiatiimi voi päästä kaikkiin niistä olemassaolevan Google Cloud -projektin kautta yhdenmukaisen API-muodon avulla.

- Avoimen lähdekoodin ja avoimen painoisten mallit: Tähän kuuluvat Meta:n Llama 3.2, Mistral ja Google:n oma Gemma. Nämä ovat ihanteellisia organisaatioille, jotka haluavat itse käyttöönottoon malleja omassa VPC:ssä (Virtual Private Cloud) varmistaakseen maksimaalisen datan eristystason.

Epäyhtenäisessä ympäristössä avoimen lähdekoodin mallin, kuten Llama, käyttöönotto vaatii PyTorch-ympäristön määrityksen, CUDA-ajureiden konfiguroinnin ja Flask- tai FastAPI-kääreiden hallinnan.

Malli Puutarha poistaa tämän “munging”-vaiheen Yhdenmukaisten hallittujen päätepisteiden avulla:

- Yhden klikkauksen käyttöönotto: Monille malleille “Käyttöönotto”-painike ottaa automaattisesti varaa tarvittavista TPU/GPU-resursseista, käärii mallin tuotantovalmiiseen konttiin ja tarjoaa REST API -päätepisteen.

- Hugging Face -integraatio: Vertex AI sallii nyt kehittäjien käyttöönottoa malleja suoraan Hugging Face Hubista Vertex-päätepisteeseen, tarjoten lähes äärettömän laajennuksen saatavilla olevasta älykkyydestä.

- Yksityinen palveluyhteys (PSC): Sääteltyjen alojen osalta malleja voidaan käyttöönottoon Yksityinen palveluyhteys avulla, varmistaen, että mallin päätepiste ei koskaan ole altis julkiselle internetille – pitäen dataliikenteen tiukasti yrityksen sisällä.

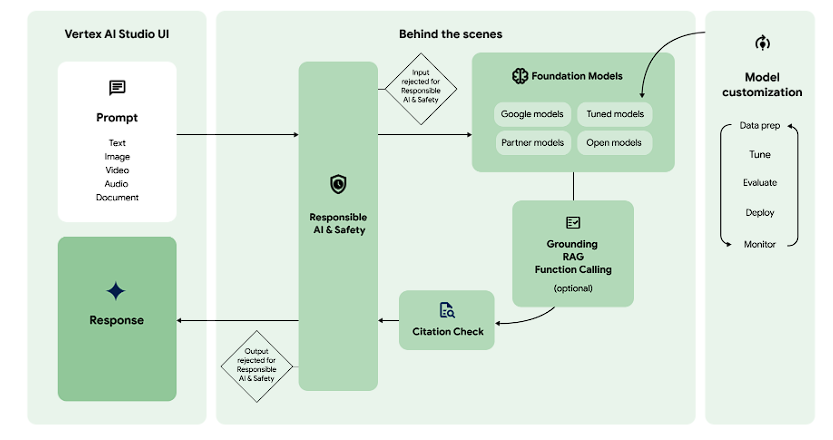

Vertex AI Studio: Kokeilun leikkikenttä

Kun Malli Puutarha on valinta, Vertex AI Studio on tarkkuus. Vertex AI Studio voidaan verrata kääntäjiin ja virheenjäljittimiin, joita tavataan perinteisessä ohjelmistomaailmassa. Vertex AI Studio on työtila, jossa raakat mallit muotoillaan tiettyjen liiketoimintatyökalujen avulla yhdistelemällä kehyskäsittelyä, monimodaalista testausta ja edistynyttä hyperparametrien säätöä.

Monimodaalinen prototyyppi: Tekstin ulkopuolella

Yksi Studio:n erottuvista ominaisuuksista on sen luonnollinen tuki monimodaliteetille. Kun muut alustat vaativat monimutkaisen koodauksen epätekstidatan käsittelyyn, Vertex AI Studio sallii sinun pudottaa tiedostoja suoraan käyttöliittymään testataksesi Gemini 2.5:n päättelykykyjä.

- Videoälykkyys: Voit ladata 45-minuuttisen teknisen avainpuhelman ja pyytää mallilta “tunnistamaan jokaisen kohdan, jossa tietty API mainitaan, ja antamaan aikaleimattu yhteenveto”.

- Asiakirjan analyysi: Sen sijaan, että malli vain lukee tekstiä, se voi analysoida visuaalisen asettelun 1000-sivuisen PDF-tiedoston, ymmärtäen suhteen kaavojen, taulukoiden ja ympäröivän proosan välillä.

- Koodin suorittaminen: Studio tukee nyt koodin suorittamista leikkikentällä. Jos pyydät mallilta ratkaisemaan monimutkaisen matemaattisen ongelman tai analysoida CSV-tiedostoa, malli voi kirjoittaa ja suorittaa Python-koodia turvallisessa eristetyssä ympäristössä antaakseen vahvistetun vastauksen.

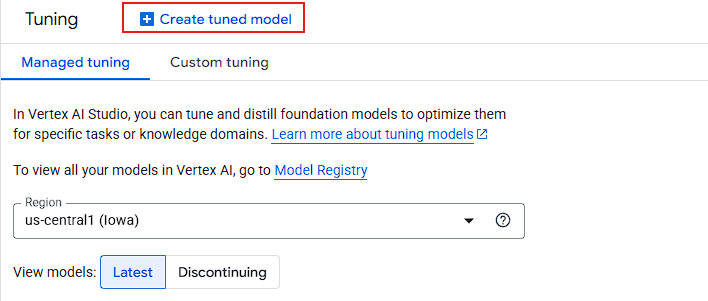

Edistynyt mukauttaminen: Säätöreitti

Kun kehyskäsittely (Zero-shot tai Few-shot) osuu katteeseen, Vertex AI Studio tarjoaa raskaan kaluston: Mallin säätö.

- Valvottu hienosäätö (SFT): Kehittäjät tarjoavat “Kehys/Vastaus” -parien tietokannan (ihanteellisesti 100+ esimerkkiä). Tämä opettaa mallille omaksumaan tietyn brändin äänen, tulostusmuodon (kuten erikoistuneen JSON) tai alan sanastoa.

- Kontekstin välimuisti: Yrityksille, jotka käsittelevät massiivisia, staattisia tietokantoja (kuten oikeudellista kirjastoa tai koodipohjaa), Studio sallii Kontekstin välimuistin. Tämä mahdollistaa “esilataamisen” miljoona tokenia dataa mallin muistiin, mikä vähentää merkittävästi viivettä ja kustannuksia myöhemmissä kyselyissä.

- Tislaus (Opettaja-Opiskelija): Tämä on korkean tason arkkitehtoninen siirto. Voit käyttää massiivista mallia (Gemini 2.5 Pro) “opettamaan” pienempää, nopeampaa mallia (Gemini 2.0 Flash). Tuloksena on kevyt malli, joka suorittaa “Pro”-tasolla, mutta toimii “Flash”-nopeudella ja -kustannuksilla.

Vertex AI Agent Builder: Automaation tehdas

Vertex AI Agent Builder on korkean tason orkestraatio-kehyksellä, joka sallii kehittäjien luoda nämä agentit yhdistämällä perusmallit yritysten datan ja ulkoisten API:en kanssa.

Arkkitehtuuri “Totuudesta”: Kiinnittäminen ja RAG

Ensisijainen tekninen este yritysten tekoälylle on hallusinaatio. Agent Builder ratkaisee tämän hienostuneen kiinnittämismoottorin avulla.

- Google-haku: Kyselyille, jotka vaativat reaaliaikaisen maailman tiedon (esim. “Mitkä ovat nykyiset asuntolainakorot New Yorkissa?”), agentti voi suorittaa Google-haun, poimia faktat ja mainita lähteensä.

- Vertex AI -haku (RAG-palveluna): Sen sijaan, että kehittäjät rakentavat manuaalisesti vektorigallon (Pinecone, Weaviate), he voivat käyttää Vertex AI -hakua indeksoimaan omia asiakirjojaan (PDF, HTML, BigQuery). Se käsittelee “paloittelu”, “upottaminen” ja “nouto” -vaiheet automaattisesti, varmistaen, että agentti vastaa vain yrityksen “Totuuden lähteestä”.

- Vertex AI RAG -moottori: Korkean skaalan, mukautettujen toteutusten osalta, tämä hallittu palvelu sallii hybridisen haun (yhdistäen vektoripohjaisen ja avainkohtaisen haun) parantamaan tarkkuutta jopa 30%:lla verrattuna standardi-LKM-tuloksiin.

Moniagenttien orkestraatio (A2A-protokolla)

Edistyneet yritysprosessit vaativat usein useita erikoistuneita agenteja, jotka työskentelevät yhdessä. Vertex AI esittelee Agent-to-Agent (A2A) -protokollan, avoimen standardin, joka sallii:

- “Matkailuagentti” puhuu “Rahoitusagentille” varmistaakseen, että lentolipun varaus on yrityksen budjetin puitteissa.

- Toimivuus: Koska se käyttää avointa protokollaa, Vertexilla rakennetut agentit voivat viestiä muiden kehyksillä, kuten LangChain tai CrewAI, rakennetuilla agenteilla.

Kehittäjän pinot: ADK ja Agent Engine

“Teknologiaplatform” -yleisölle Agent Builder tarjoaa kaksi eri reittiä:

- Ei-koodauskonsoli: Visuaalinen raahaus- ja pudotusliittymä nopealle prototyyppaus- ja liiketoimintakäyttäjien konfiguraatiolle.

- Agentti-kehityspaketti (ADK): Koodin ensin Python-työkalupaketti insinööreille. Se sallii “Kehys-koodin”, versionhallinnan integraation ja mahdollisuuden käyttöönottoon Vertex AI Agent Engineen – hallittuun suoritusaikaan, joka käsittelee istunnon kestoa, skaalautuvuutta ja tilan hallintaa automaattisesti.

Johtopäätös: “Mikä jos” – “Mikä seuraava”

Siirtyminen loistavasta tekoälydemosta tuotantovalmiiseen yritysohjelmaan on pitkään ollut “kuolemanlaakso” digitaalisen muodonmuutosprojektien osalta. Kuten olemme tutkineet, Vertex AI on suunniteltu erityisesti tämän kuilun ylittämiseksi. Yhdistämällä tekoälyyn vaikuttavan datan, työkalujen ja mallien orkestraation fragmentaation, Google Cloud on siirtänyt keskustelun tekoälymallien raakapowerista tekoälyelinkaaren toiminnalliseen kypsymiseen.