Tekoäly

Muuttamalla Emootioita Videomateriaalissa AI:n Avulla

Kreikan ja Yhdistyneen kuningaskunnan tutkijat ovat kehittäneet uuden syvän oppimisen lähestymistavan, jolla voidaan muuttaa videomateriaalissa esiintyvien ihmisten ilmeitä ja näennäistä mielialaa, säilyttäen samalla huulten liikkeiden uskollisuuden alkuperäiseen ääneen tavalla, jota aiemmat yritykset eivät ole pystyneet vastaamaan.

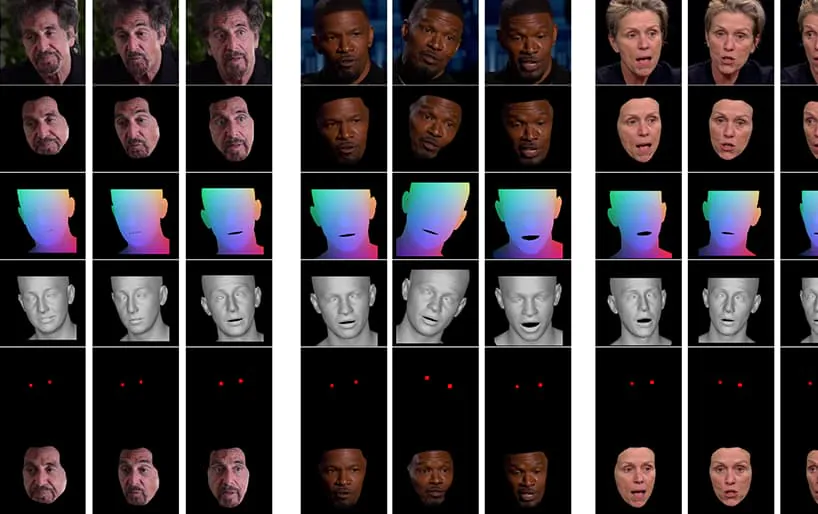

Videon alussa olevasta artikkelista, lyhyt Al Pacinon ilmeen hienovarainen muutos NED:llä, joka perustuu korkean tason semanttisiin käsitteisiin, jotka määrittelevät yksilöiden kasvojen ilmeitä ja niiden liittyvää tunnetta. ‘Reference-Driven’ -menetelmä oikealla puolella ottaa lähtöaineiston tulkittujen tunteiden ja soveltaa niitä koko videosekvenssiin. Lähde: https://www.youtube.com/watch?v=Li6W8pRDMJQ

Tämä tietty ala kuuluu kasvavaan luokkaan deepfaked emotions, jossa alkuperäisen puhujan identiteetti säilytetään, mutta heidän ilmeensä ja mikroilmeensä muutetaan. Kun tämä tietty AI-tekniikka kypsyy, se tarjoaa mahdollisuuden elokuva- ja TV-tuotannoille tehdä hienovaraisia muutoksia näyttelijöiden ilmeisiin – mutta myös avaa melko uuden kategorian ‘tunne-alteroitujen’ videon deepfake.

Kasvojen Muuttaminen

Julkinen henkilöiden, kuten poliitikkojen, kasvojen ilmeet ovat tarkoin valittuja; vuonna 2016 Hillary Clintonin kasvojen ilmeet tulivat intensiivisen median tarkastelun alle heidän potentiaalisen negatiivisen vaikutuksensa vuoksi hänen vaalivoittoaan vastaan; kasvojen ilmeet ovat myös kiinnostuksen aihe FBI:lle; ja ne ovat kriittinen osoitin työhaastatteluissa, mikä tekee (hyvin etäisestä) mahdollisuudesta live-‘ilmeen ohjaus’ -suodattimen toivottavaksi kehitykseksi työnhakijoille, jotka yrittävät päästä Zoomin esirajaukseen.

Vuoden 2005 tutkimus Isosta-Britanniasta vahvisti, että kasvojen ulkonäkö vaikuttaa äänestyspäätöksiin, kun taas vuoden 2019 Washington Post -artikkeli tarkasteli ‘asioista poistetun’ videootteiden jakamista, joka on tällä hetkellä lähin asia, mitä fake news -edustajat voivat tehdä, jotta voivat muuttaa, miten julkisuuden henkilö näyttää käyttäytyvän, reagoivan tai tuntevan.

Kohti Hermoemotionaalista Manipulaatiota

Tällä hetkellä kasvojen ilmeen manipuloinnin tila on melko perusluonteinen, koska se vaatii disentanglementin korkean tason käsitteistä (kuten suru, viha, onni, iloinen) varsinaisesta video sisällöstä. Vaikka perinteiset deepfake -arkkitehtuurit näyttävät saavuttavan tämän disentanglementin melko hyvin, tunteiden heijastaminen eri identiteetteihin edellyttää, että kaksi koulutus kasvojen joukkoa sisältää vastaavia ilmeitä kullekin identiteetille.

Typical esimerkkejä kasvojen kuvista, jotka käytetään deepfake -mallien kouluttamiseen. Tällä hetkellä voit muuttaa henkilön kasvojen ilmettä vain luomalla ID-spesifiset ilme-ilme -polut deepfake -hermoverkossa. Vuoden 2017 deepfake -ohjelmisto ei ole sisäistä, semanttista ymmärrystä ‘ilosta’ – se vain kartoittaa ja vastaa havaittuja muutoksia kasvojen geometriassa kahden aiheen välillä.

Mitä on toivottavaa, ja mitä ei ole vielä täydellisesti saavutettu, on tunnistaa, miten aihe B (esimerkiksi) ilahtaa, ja luoda yksinkertainen ‘iloinen’ -kytkin arkkitehtuuriin ilman, että se tarvitsee kartoittaa sitä vastaavaa aihe A:n iloista kuvaa.

Uusi artikkeli on otsikoitu Neural Emotion Director: Speech-preserving semantic control of facial expressions in “in-the-wild” videos, ja se tulee tutkijoilta Kansallisen Teknillisen Yliopiston sähkö- ja tietotekniikan tiedekunnasta Ateenasta, tietojenkäsittelytieteiden instituutista Foundation for Research and Technology Hellas (FORTH) -tutkimuslaitoksesta, ja College of Engineering, Mathematics and Physical Sciences -yliopistosta Exeterissä, Isossa-Britanniassa.

Tutkijaryhmä on kehittänyt kehyksen, joka on nimeltään Neural Emotion Director (NED), joka sisältää 3D-pohjaisen emotion-translation verkon, 3D-Based Emotion Manipulatorin.

NED ottaa vastaan sarjan ilme-parametreja ja kääntää ne kohdealueelle. Se on koulutettu epäparisissa tiedoissa, mikä tarkoittaa, että ei ole välttämätöntä kouluttaa tietoja, joissa kunkin identiteetin on oltava vastaavia kasvojen ilmeitä.

Videon, joka näkyy tämän artikkelin lopussa, suorittaa sarjan testejä, joissa NED määrää näennäisen emotionaalisen tilan YouTube -videomateriaaliin.

Kirjoittajat väittävät, että NED on ensimmäinen video-pohjainen menetelmä ‘ohjaamiseen’ näyttelijöitä satunnaisissa ja arvaamattomissa tilanteissa, ja he ovat tehneet koodin saataville NED:n projektisivulla.

Menetelmä ja Arkkitehtuuri

Järjestelmä on koulutettu kahdella suurella videoaineistolla, joihin on liitetty ’emotion’ -merkinnät.

Tuloste on mahdollista videon kasvojen renderöijän ansiosta, joka renderöi halutun emotion tilan videolle perinteisten kasvojen kuvan synteesimenetelmien avulla, mukaan lukien kasvojen segmentointi, kasvojen määräpaikan kohdistus ja sekoitus, jossa vain kasvojen alue syntetisoidaan ja sitten asetetaan alkuperäiseen videomateriaaliin.

Neural Emotion Detector (NED) -järjestelmän arkkitehtuuri. Lähde: https://arxiv.org/pdf/2112.00585.pdf

Aluksi järjestelmä hankkii 3D-kasvojen palautuksen ja määrää kasvojen määräpaikan sovittamisen syötteen kehyksiin, jotta voidaan tunnistaa ilme. Tämän jälkeen nämä palautetut ilme-parametrit siirretään 3D-pohjaiseen Emotion Manipulaattoriin, ja tyyli-vektori lasketaan joko semanttisen merkin (kuten ‘iloisen’) tai viite-tiedoston avulla.

Viite-tiedosto on video, joka esittää tietyn tunnistetun ilmeen/emotion, joka sitten asetetaan koko kohde-videon ylle, vaihtaen alkuperäisen ilmeen.

Lopullinen generoitu 3D-kasvojen muoto on sitten yhdistetty Normalisoidun Keskimääräisen Kasvojen Koordinaatin (NMFC) ja silmäkuvien (punaiset pisteet yllä olevassa kuvassa) kanssa, ja se siirretään hermo-renderöijään, joka suorittaa lopullisen manipulaation.

Tulokset

Tutkijat suorittivat laajat tutkimukset, mukaan lukien käyttäjä- ja ablaatio-tutkimukset, arvioidakseen menetelmän tehokkuutta aiempiin töihin verrattuna, ja he löysivät, että useimmissa kategoriassa NED ylittää tämän alueen nykyisen tilan hermo-kasvojen manipuloinnissa.

Artikkelin kirjoittajat näkevät, että myöhemmät tämän työn toteutukset ja samankaltaiset työkalut tulevat olemaan hyödyllisiä ensisijaisesti TV- ja elokuva-alalla, ja he toteavat:

‘Menetelmämme avaa runsaasti uusia mahdollisuuksia hyödyllisiin sovelluksiin hermo-renderöintiteknologioista, aina elokuvien jälkituotannosta ja videopeleistä photo-realistisiin affektiivisiin avatar-eihin.’

Tämä on varhainen työ alalla, mutta yksi ensimmäisistä, jotka yrittävät kasvojen uudelleen esittämistä videolla eikä vain kuvilla. Vaikka videot ovat periaatteessa monia kuvia, jotka pyörivät hyvin nopeasti, on olemassa aikasuhteita, jotka tekevät aiemmat emotion-siirron sovellukset vähemmän tehokkaiksi. Liitetyssä videossa ja esimerkeissä artikkelissa kirjoittajat esittävät visuaalisia vertailuja NED:n tuloksista muihin verrattavissa töihin.

Lisätietoja vertailuista ja monista muista NED:n esimerkeistä voidaan löytää koko videosta:

3. joulukuuta 2021, 18:30 GMT+2 – Yhden artikkelin kirjoittajan pyynnöstä tehtiin korjauksia ‘viite-tiedostoon’ liittyen, jonka sanoin virheellisesti olevan still-kuva (kun se on itse asiassa videoklippi). Myös korjaus Institute of Computer Science at the Foundation for Research and Technology -nimen osalta.

3. joulukuuta 2021, 20:50 GMT+2 – Toisen artikkelin kirjoittajan pyynnöstä tehtiin toinen korjaus edellä mainitun laitoksen nimen osalta.