Tekoäly

Irlallinen on seuraava syväväärennösten vallankumous

CGI-datan täydentämistä käytetään uudessa projektissa saavuttamaan suurempi valta deepfake-kuvien hallitsemiseksi. Vaikka et voi edelleenkään käyttää tehokkaasti CGI-päitä täyttämään puuttuvat aukot deepfake-kasvojen aineistoissa, uusi aalto tutkimusta identiteetin ja kontekstin erottamiseksi merkitsee, että pian et ehkä tarvitse.

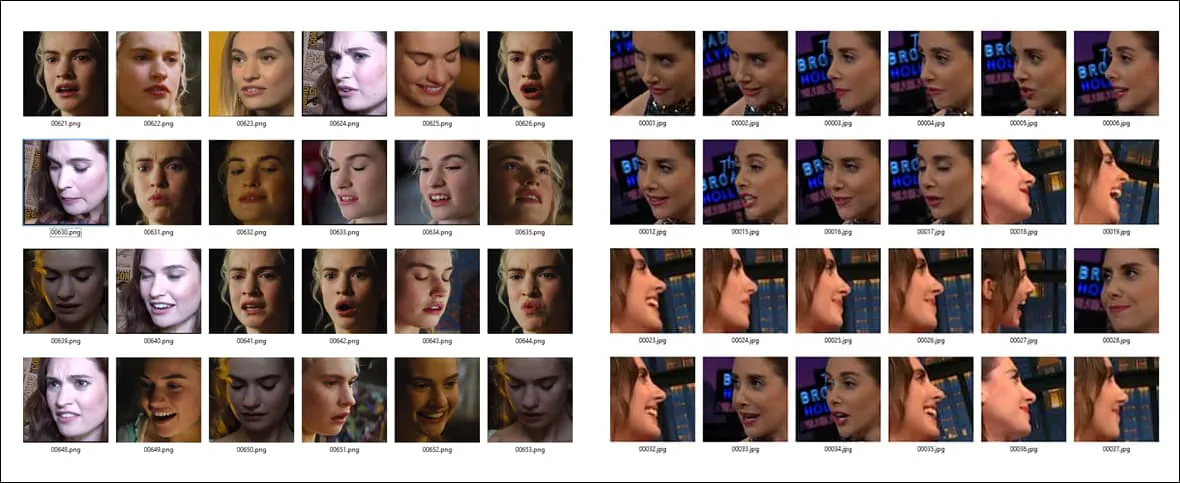

Luojat joistakin viime vuosien menestyneimmistä virali-deepfake-videoista valitsevat lähdevideonsa hyvin tarkkaan, välttäen jatkuvia profiilikuvasuhteita (ts. sellaisia sivusuunnan mugshot-valokuvia, joita poliisin pidätyksen prosessit ovat popularisoineet), teräviä kulmia ja epätavallisia tai liioiteltuja ilmeitä. Yhä useammin deepfake-tuottajien luomissa demonstroiduissa videoissa on editoitu koosteita, jotka valitsevat “helpoimmat” kulmat ja ilmeet deepfakingiin.

Itse asiassa deepfake-kuvissa, joissa alkuperäinen henkilö (joka korvataan deepfake-kuvalla) katsoo suoraan kameraan, vähäisen ilmeiden kirjon kanssa, on kaikkein mukavin kohde, johon voidaan lisätä deepfake-kuvallinen julkkis.

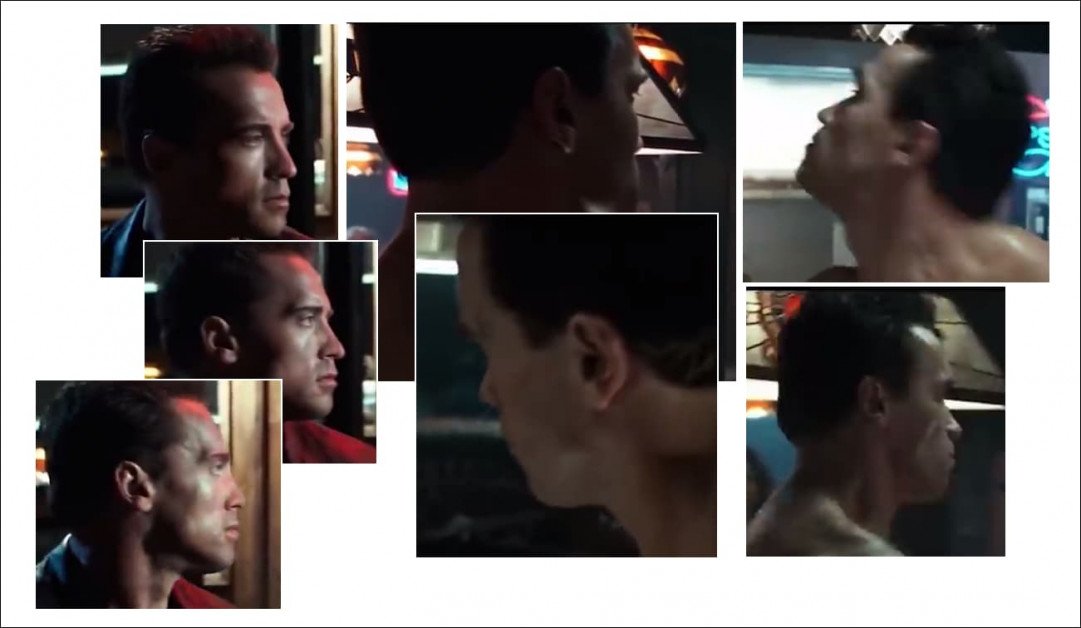

Suurin osa viime vuosiden suosituimmista deepfake-kuvista on näyttänyt kohteita, jotka katsovat suoraan kameraan, ja joko ilman suosittuja ilmeitä (kuten hymyilemättä), jotka voidaan helposti poimia punaisen maton papparazzikuvista, tai (kuten vuoden 2019 Sylvester Stallonen väärennös Terminaattorina, kuvassa vasemmalla), ihannetta, jossa ei ole lainkaan ilmettä, koska neutraalit ilmeet ovat erittäin yleisiä, mikä tekee niistä helppoja sisällyttää deepfake-malleihin.

Koska deepfake-teknologiat, kuten DeepFaceLab ja FaceSwap, suorittavat nämä yksinkertaiset vaihdot erittäin hyvin, olemme tarpeeksi lumoutuneita siitä, mitä he saavuttavat, ettei huomaa, mitä he eivät pysty tekemään, ja usein he eivät edes yritä:

Kuvakaappaukset arvostetusta deepfake-videosta, jossa Arnold Schwarzenegger muutetaan Sylvester Stalloneksi – ellei kulmat ole liian hankalat. Profiilit ovat edelleen pysyvä ongelma nykyisissä deepfake-lähestymistavoissa, osittain siksi, että avoimen lähdekoodin ohjelmisto, jota käytetään määrittämään kasvojen asentoja deepfake-kehyksissä, ei ole optimoitu sivunäkymille, mutta pääasiassa siksi, että kummassakin tarvittavassa aineistossa on puutteellinen soveltuva lähdeaineisto. Lähde: https://www.youtube.com/watch?v=AQvCmQFScMA

Uusi tutkimus Israelista ehdottaa uutta menetelmää, jossa käytetään synteettistä dataa, kuten CGI-päitä, tuomaan deepfaking 2020-luvulle, erottamalla todella kasvojen identiteetin (ts. Tom Cruisen kasvojen olennaiset piirteet kaikista kulmista) kontekstistaan (ts. katsominen ylös, katsominen sivulle, murjottaminen, murjottaminen pimeässä, kulmakarvojen rypistäminen, silmien sulkeminen, jne.).

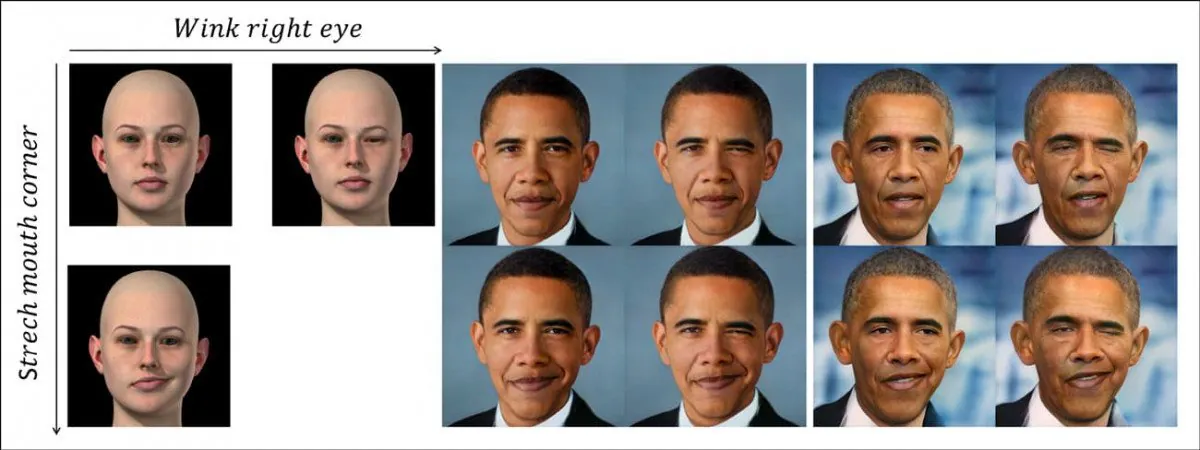

Uusi järjestelmä erottaa poseen ja kontekstiin (ts. silmän räpäyttäminen) yksilön identiteetin koodauksesta, käyttäen siihen liittymätöntä synteettistä kasvoaineistoa (kuvassa vasemmalla). Ylärivissä näemme “räpäytys”-ilmeen siirrettävän Barack Obaman identiteettiin, johdatettuna GAN:n latentin avaruuden oppimasta epälineaarisesta polusta, jota edustaa vasemmalla oleva CGI-kuva. Rivissä alla näemme venyneen suunurkan siirrettävän entisen presidentin kasvoille. Alhaalla oikeassa näemme molemmat ominaisuudet sovellettuna samanaikaisesti. Lähde: https://arxiv.org/pdf/2111.08419.pdf

Tämä ei ole pelkkä deepfake-pukinpaikkaus, joka on tekniikka, joka on sovellettavissa avatareihin ja osittaiseen kasvojen huulien synkronointiin, ja jolla on rajoitettu potentiaali täysimittaisiin deepfake-videomuunnoksiin.

Sen sijaan tämä edustaa tietä eteenpäin perustavanlaatuiseen erottamiseen välineistöstä (kuten ‘muuta pään kulmaa’, ‘luo surullinen ilme’) identiteetistä, tarjoten tien korkean tason, ei “johdannaisen” kuva-synteesipohjaiseen deepfake-kehykseen.

Uusi tutkimus on nimeltään Delta-GAN-Encoder: Encoding Semantic Changes for Explicit Image Editing, using Few Synthetic Samples, ja se tulee tutkijoilta Technion – Israel Institute of Technology:stä.

Ymmärtääksemme, mitä tämä työ merkitsee, katsokaamme, miten deepfaket valmistetaan kaikkialla deepfake-pornosivuista Industrial Light and Magic:iin (koska DeepFaceLab-avoin lähdekoodirepositorio on tällä hetkellä hallitseva sekä “amateur”- että ammattimaisessa deepfakingissa).

Mikä estää nykyisen deepfake-teknologian?

Deepfaket luodaan kouluttamalla encoder/decoder -konemallia kahdella kansioilla kasvoista – henkilö, jonka haluat “maalata yli” (edellisessä esimerkissä se on Arnie), ja henkilö, jonka haluat siirtää kuvamateriaaliin (Sly).

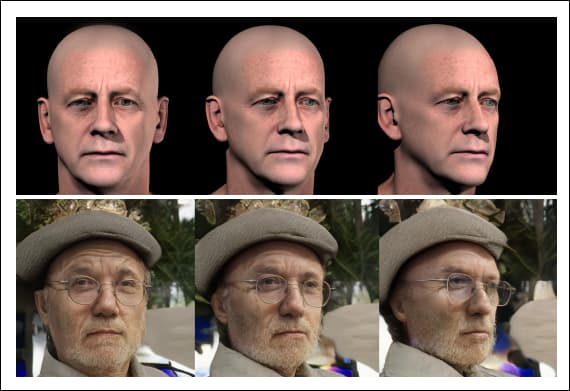

Eri poseiden ja valaistusolosuhteiden vaihtelua kahden eri kasvoaineiston välillä. Huomaa erottuva ilme kolmannen rivin lopussa sarjassa A, jolla ei ole läheistä vastinetta toisessa aineistossa.

Encoder/decoder-järjestelmä vertaa sitten jokaisen kuvan kummassakin kansiossa toisiinsa, ylläpitäen, parantamalla ja toistamalla tämän toiminnon satoja tuhansia iteraatioita (usein viikon ajan), kunnes se ymmärtää molempien identiteettien olennaiset piirteet tarpeeksi hyvin vaihtamaan ne vapaasti.

Kummallekin henkilölle, jotka vaihdetaan prosessissa, mitä deepfake-arkkitehtuuri oppii identiteetistä, on sekoitettu kontekstiin. Se ei voi oppia ja soveltaa periaatteita yleisestä posesta “hyväksi ja kaikkeen”, vaan tarvitsee runsaasti esimerkkejä koulutusaineistossa kummallekin identiteetille, joka on mukana kasvojen vaihdossa:

Koska kasvojen ID ja poseen ominaisuudet ovat tällä hetkellä niin tiiviisti kytköksissä toisiinsa, laaja parity ilmeistä, pään asennosta ja (jonkin verran) valaistuksesta on tarpeen kahden kasvoaineiston välillä kouluttaa tehokas deepfake-malli järjestelmissä, kuten DeepFaceLab. Mitä vähemmän tietty konfiguraatio (kuten “sivunäkymä/hymy/sauna”) on esillä kummassakin aineistossa, sitä vähemmän se renderöi deepfake-videossa, jos se on tarpeen.

Miksi data on niukkaa

Ellet ole usein pidätetty, sinulla ei todennäköisesti ole paljon sivuprofiilikuvia itsestäsi. Mitä tahansa, mitä sinulla on, sinä luultavasti heittäisit pois. Koska kuva-agenssit tekevät samoin, sivuprofiilikuvat ovat vaikeasti saatavissa.

Deepfaket usein sisällyttävät useita kopioita rajoitettua sivunäkemisen profiilidataa, jota heillä on identiteetistä, kasvojen aineistoon, vain siksi, että pose saa ainakin vähän huomiota ja aikaa koulutuksen aikana, sen sijaan, että se hylättäisiin poikkeamana.

Mutta on paljon enemmän mahdollisia sivunäkemisen kasvokuvia kuin on todennäköisesti saatavilla aineistoon sisällyttämistä varten – hymyileminen, murjottaminen, karjuminen, itku, pimeästi valaistu, halveksunta, väsymys, ilo, salamaniskun valaistu, katsominen ylös, katsominen alas, silmät auki, silmät kiinni… ja niin edelleen. Mitä tahansa näistä poseista, useissa yhdistelmissä, voisi olla tarpeen kohde-deepfake-videossa.

Ja se on vain profiileja. Kuinka monta kuvaa sinulla on itseltäsi, jossa sinä katsoo suoraan ylös? Onko sinulla tarpeeksi kuvia edustamaan 10 000 mahdollista ilmettä, joita sinä voit pitää samassa poseessa samasta kamerakulmasta, kattaen vähintään osan miljoonasta mahdollisesta valaistusympäristöstä?

On todennäköistä, että sinulla ei ole edes yhtä kuvaa itseltäsi, jossa sinä katsoo ylös. Ja se on vain kaksi kulmaa sadasta tai useammasta, jotka tarvitaan täydelliseen kattavuuteen.

Jopa jos olisi mahdollista luoda täydellinen kattavuus kasvoista kaikista kulmista valaistusolosuhteiden alaisena, tuloksena oleva aineisto olisi liian suuri koulutettavaksi, järjestyksessä satoja tuhansia kuvia; ja jopa jos se voitaisiin kouluttaa, nykyisten deepfake-kehysten koulutusprosessi heittäisi suurimman osan tästä lisädatasta pois hyväksi vain rajoitetun määrän johdannaisominaisuuksia, koska nykyiset kehykset ovat reduktionistisia eivätkä skaalautuvia.

Synteettinen korvaaminen

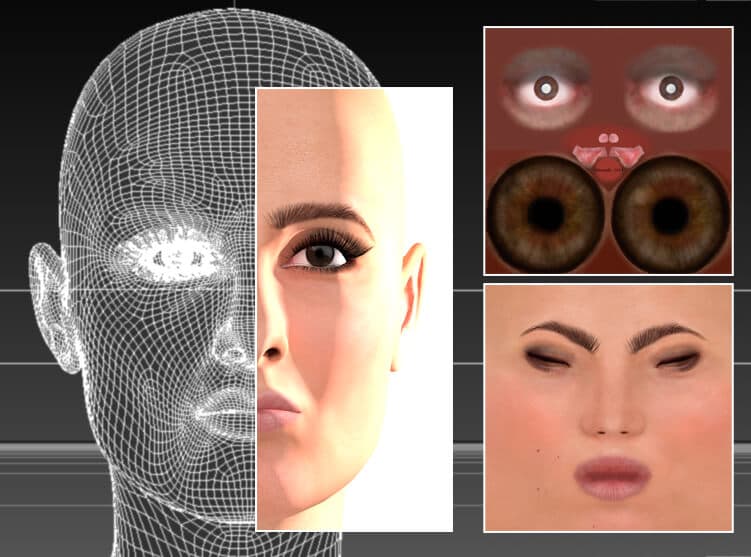

Deepfaken synnystä lähtien deepfaket ovat kokeilleet käyttämällä CGI-tyyppistä kuvaa, päitä luotuissa 3D-sovelluksissa, kuten Cinema4D ja Maya, luomaan ne “puuttuvat poseet”.

Ei tarvita AI:ta; näyttelijä luodaan perinteisessä CGI-ohjelmassa, Cinema 4D: ssä, käyttäen mesh- ja bitimap-tekstuureja – teknologiaa, joka on peräisin 1960-luvulta, vaikka se saavutti laajan käytön vasta 1990-luvulla. Teoriassa tämä kasvomalli voisi käytetty deepfake-lähdemateriaalin luomiseen epätavallisille poseille, valaistustyyleille ja kasvojen ilmeille. Käytännössä se on ollut rajoitettua tai ei lainkaan hyödyllistä deepfakingiin, koska CGI-renderöintien “epäaidon” ulkonäkö valuu läpi vaihdettuihin videoihin. Lähde: Tämän artikkelin kirjoittajan kuva https://rossdawson.com/futurist/implications-of-ai/comprehensive-guide-ai-artificial-intelligence-visual-effects-vfx/

CGI-kasvot irrotettuina, konseptuaalisina ohjeina

Sen sijaan uusi Delta-GAN-Encoder (DGE) -menetelmä Israelilaisilta tutkijoilta on tehokkaampi, koska poseen ja kontekstin tiedot CGI-kuvista on täysin erottettu “identiteetin” tiedoista.

Voimme nähdä tämän periaatteen toiminnassa alla olevassa kuvassa, jossa on saatu erilaisia pään suuntia käyttämällä CGI-kuvaa ohjeena. Koska identiteetin piirteet eivät ole liittyneet kontekstin piirteisiin, ei ole vuotoa CGI-kasvojen epäaidosta ulkonäöstä eikä identiteetistä, jota se edustaa:

Uudella menetelmällä sinun ei tarvitse löytää kolmea erillistä kuvaa, jotta voit tehdä deepfaken useista kulmista – voit vain kääntää CGI-päätä, jonka abstraktit piirteet asetetaan identiteettiin ilman mitään ID-tietojen vuotoa.

Delta-GAN-Encoder. Ylävasemmalla ryhmä: lähdekuvan kulmaa voidaan muuttaa toiseksi renderöidäkseen uuden lähdekuvan, joka heijastuu tulosteeseen; yläoikea ryhmä: valaistus on myös erottettu identiteetistä, mahdollistaen valaistustyylejen yhdistämisen; alavasemmalla ryhmä: useita kasvojen yksityiskohtia muutetaan luomaan “surullinen” ilme; alaoikea ryhmä: yksi yksittäinen kasvojen ilmeen yksityiskohta muutetaan, jotta silmät rypistetään.

Tämä identiteetin ja kontekstin erottaminen saavutetaan koulutusvaiheessa. Uuden deepfake-arkkitehtuurin putki etsii etsii pre-koulutetun Generative Adversarial Network (GAN) -latentin vektoria, joka vastaa muunnettavaa kuvaa – Sim2Real-metodologia, joka perustuu IBM:n AI-tutkimuksen 2018 projektiin.

Tutkijat huomauttavat:

‘Vain muutamalla näytteellä, jotka eroavat tietyn attribuutin mukaan, voidaan oppia eriytetty käyttäytyminen pre-koulutetusta sekoitetusta generatiivisesta mallista. Ei ole tarpeen täsmällisiä todellisia näytteitä saavuttaa tämä tavoite, joka ei välttämättä ole toteutettavissa.

‘Käyttämällä epärealistisia näytteitä voidaan sama tavoite saavuttaa hyödyntämällä koodatun latentin vektoreiden semantiikkaa. Haluttujen muutosten soveltaminen olemassa oleviin data-näytteisiin voidaan tehdä ilman latentin avaruuden käyttäytymisen nimenomaista tutkimista.’

Tutkijat odottavat, että tämän projektin tutkimuksen ydinperiaatteet voidaan siirtää muihin aloihin, kuten sisäarkkitehtuuriin, ja että Sim2Real-menetelmä, jota otettiin käyttöön Delta-GAN-Encoderiin, voi lopulta mahdollistaa deepfake-instrumentaation pelkästään luonnoksien perusteella, ei CGI-tyyppisen syötteen perusteella.

Voidaan väittää, että uuden Israelilaisen järjestelmän mahdollisuus synnyttää deepfake-videota on paljon vähemmän merkittävää kuin edistyminen, jonka tutkimus on tehnyt identiteetin ja kontekstin erottamisessa, saavuttaen samalla enemmän valtaa GAN:n latentin avaruuden yli.

Eriyttäminen on aktiivinen tutkimuksen ala kuvien synteesissä; tammikuussa 2021 Amazonin johdolla tehty tutkimus osoitti samanlaista poseen hallintaa ja eriyttämistä, ja vuonna 2018 Kiinan tiedeakatemian Shenzhen-instituutteja koskeva tutkimus teki edistystä mielivaltaisten näkökulmien generoimisessa GAN:ssa.