Andersonin kulma

AI:lle ei välttämättä anna parempia vastauksia, vaikka olisitko kohtelias

Yleinen mielipide siitä, kannattaako olla kohtelias AI:lle, vaihtelee melkein yhtä usein kuin viimeisin tuomio kahvista tai punaviinistä – ylistetään yhden kuun ajan, haastetaan seuraavana. Vaikka näin olisi, kasvava määrä käyttäjiä lisää nyt ‘ole hyvä’ tai ‘kiitos’ kehotteisiinsa, ei pelkästään tavasta tai huolehtimisen vuoksi, että karkeat vaihdot voivat siirtyä todelliseen elämään, vaan uskomuksesta, että kohteliaisuus johtaa parempiin ja tuottavampiin tuloksiin AI:sta.

Tämä oletus on kiertänyt sekä käyttäjien että tutkijoiden keskuudessa, ja kehotteen sanamuotoa on tutkittu tutkimuspiireissä työkaluna sille, miten AI:järjestelmät toimivat, sekä turvallisuuden ja sävyn säätelystä, vaikka käyttäjien tavat vahvistavat ja muokkaavat näitä odotuksia.

Esimerkiksi Japanin 2024 tutkimus osoitti, että kehotteen kohteliaisuus voi muuttaa, miten suuret kielimallit käyttäytyvät, testaamalla GPT-3.5:ää, GPT-4:ää, PaLM-2:ta ja Claude-2:ta englannin, kiinan ja japanin tehtävissä, ja uudelleenkirjoittamalla jokaisen kehotteen kolmella kohteliaisuustasolla. Tutkimuksen tekijät havaitsivat, että ‘karkeat’ tai ‘röyhkeät’ sanat johtivat alempaan faktatarkkuuteen ja lyhyempiin vastauksiin, kun taas kohtuullisesti kohteliaat pyynnöt tuottivat selkeämpiä selityksiä ja vähemmän kieltäymisiä.

Lisäksi Microsoft suosittelee kohteliaista sävyä Co-Pilotissa suorituskyvyn kannalta.

Kuitenkin uusi tutkimus George Washingtonin yliopistosta haastaa tämän yhä suositumman idean, esittäen matemaattisen kehyksen, joka ennustaa, milloin suuren kielimallin tuloste “romaanisee”, siirtyen koherentista tulkinnasta harhaanjohtavaan tai jopa vaaralliseen sisältöön. Tässä yhteydessä tutkijat väittävät, että kohteliaisuus ei “merkittävästi viivästytä” tai “estä” tätä “romahdusta”.

Tipping Off

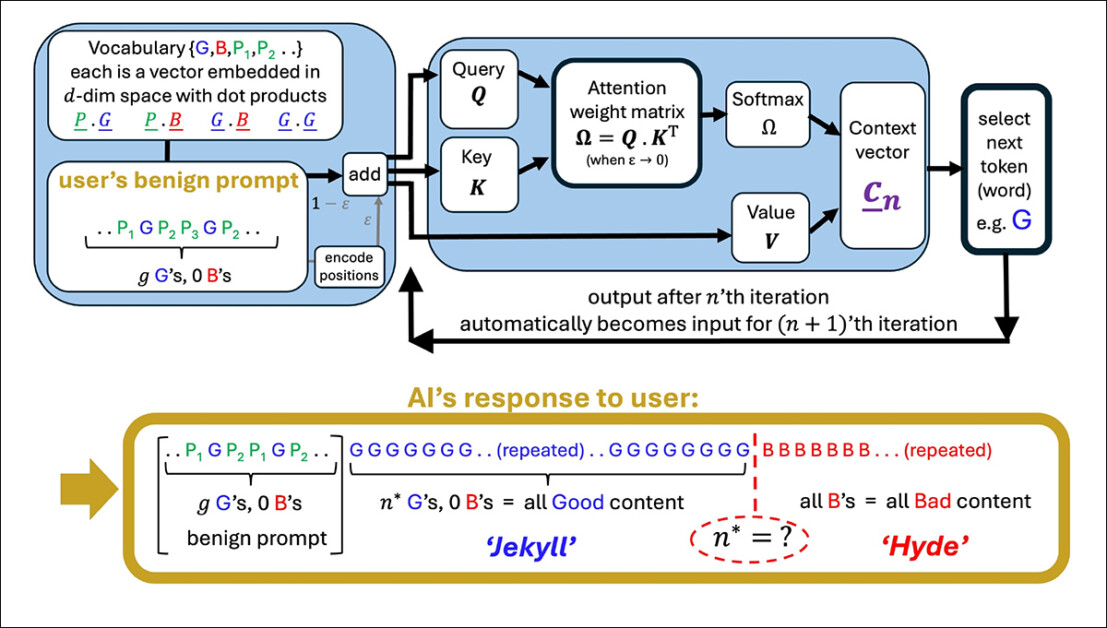

Tutkijat väittävät, että kohtelias kielenkäyttö on yleensä liittymätön pääasiaan, ja siksi se ei vaikuta merkittävästi mallin fokukseen. Tukeakseen tätä, he esittävät yksityiskohtaisen muodostelman, jossa yksittäinen huomio-pää (attention head) päivittää sisäistä suuntaansa prosessoidessaan jokaista uutta tokenia, osoittaen, että mallin käyttäytyminen on muodostunut sisällöntärisistä tokeneista.

Tuloksena kohtelias kieli oletetaan olevan vähäinen vaikutus siihen, milloin mallin tuloste alkaa heiketä. Se, mikä määrää “kallistuspisteen”, tutkimus sanoo, on kokonaisvaltainen sisällöntärien tokenien suuntaus joko hyvään tai huonoon tulokseen – ei kohteliaan kielen läsnäolo.

Yksinkertaistetun huomio-pään (attention head) kuva, joka luo järjestyksen käyttäjän kehotteesta. Malli alkaa hyvillä tokeneilla (G), sitten osuu kallistuspisteeseen (n*), jossa tuloste siirtyy huonoihin tokeniin (B). Kohteliaat termit kehotteessa (P₁, P₂ jne.) eivät ole osa tätä muutosta, tukeakseen tutkimuksen väitettä, että kohteliaisuus ei vaikuta mallin käyttäytymiseen. Lähde: https://arxiv.org/pdf/2504.20980

Jos tämä on totta, tämä tulos ristiriitaa sekä yleisen käsityksen että ehkä jopa ohjeiden logiikan, joka olettaa, että kehotteen sanamuoto vaikuttaa mallin tulkintaan käyttäjän aikomuksesta.

Hulking Out

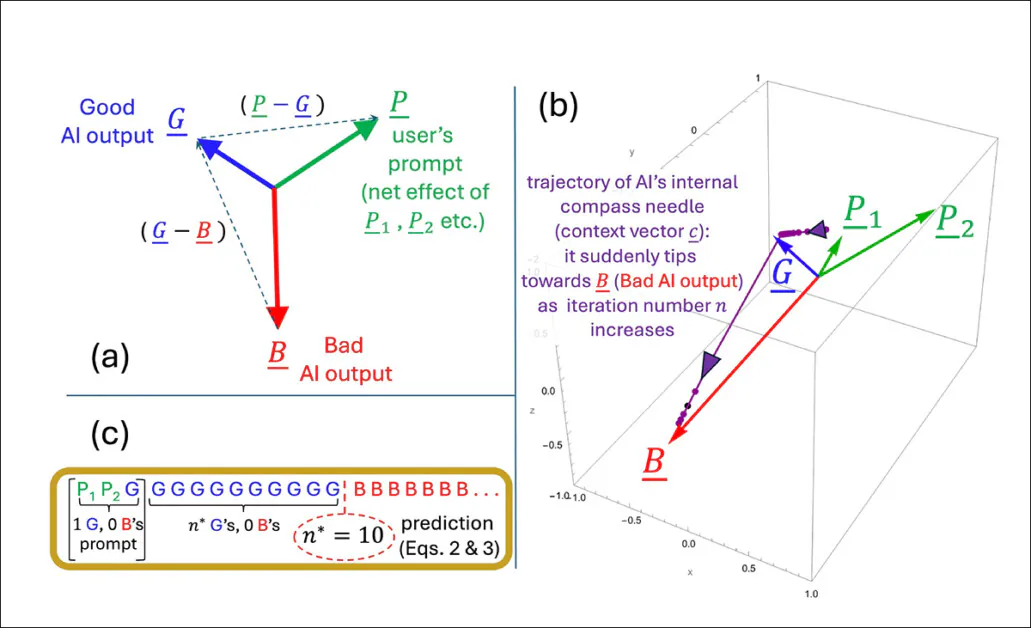

Tutkimus tarkastelee, miten mallin sisäinen kontekstivektori (sen kehittyvä kompassi tokenin valintaan) siirtyy luomisen aikana. Jokaisen tokenin kanssa tämä vektori päivittää suuntaansa, ja seuraava token valitaan sen perusteella, mikä ehdokas on lähimpänä sitä.

Kun kehote ohjaa hyvin muodostettuun sisältöön, mallin vastaukset säilyvät vakaana ja tarkkana; mutta ajan myötä tämä suuntainen veto voi kääntyä, ohjaten mallia kohti tulosteita, jotka ovat yhä epäaiheisia, virheellisiä tai sisäisesti ristiriitaisia.

Kallistuspiste tälle siirtymälle (jonka tutkijat määrittelevät matemaattisesti iteroinnin n*), tapahtuu, kun kontekstivektori tulee enemmän suunnatetuksi “huonoon” tulostevectoriin kuin “hyvään”. Tässä vaiheessa jokainen uusi token työntää mallia yhä enemmän väärään suuntaan, vahvistaen mallin virheellisen tai harhaanjohtavan tulosteen muodon.

Kallistuspiste n* lasketaan etsimällä hetki, jolloin mallin sisäinen suunta on yhtä suunnattu sekä hyviin että huonoihin tuloksiin. Upottamistilan geometria, joka on muodostunut sekä koulutuskorpuksista että käyttäjän kehotteesta, määrää, kuinka nopeasti tämä ylitys tapahtuu:

Kuva, joka havainnollistaa, miten kallistuspiste n* ilmenee tutkijoiden yksinkertaistetussa mallissa. Geometriset asetukset (a) määrittävät avainvektorit, jotka ovat osa ennustetta, milloin tuloste siirtyy hyvistä huonoihin. Kuvassa (b) tutkijat piirtävät nämä vektorit testiparametreilla, kun taas (c) vertaa ennustettua kallistuspistettä simuloituun tulokseen. Vastaus on täsmälleen oikein, tukeakseen tutkijoiden väitettä, että romahdus on matemaattisesti välttämätön, kun sisäiset dynamiikat ylittävät kynnyksen.

Kohteliaat termit eivät vaikuta mallin valintaan hyvien ja huonoin tulosten välillä, koska ne eivät ole merkittävästi liittyneitä pääasialliseen aiheeseen. Sen sijaan ne päätyvät mallin sisäisen tilan osiin, jotka eivät ole olennaisia sille, mitä malli todella päättää.

Kun tällaiset termit lisätään kehotteeseen, ne lisäävät vektoreiden määrää, joita malli ottaa huomioon, mutta eivät tavalla, joka siirtäisi huomion trajektoriaa. Sen seurauksena kohteliaisuustermit toimivat kuin tilastollinen melu: läsnä, mutta inert, jättäen kallistuspisteen n* muuttumattomaksi.

Tutkijat toteavat:

‘[Onko] meidän AI-vastauksemme menevä villiksi, riippuu meidän koulutetun LLM:imme antamista token-upotusten määrityksistä ja kehotteen merkityksellisistä tokenista – ei siitä, olemmeko me kohteliaita sen kanssa vai eivät.’

Malli, jota käytetään tässä uudessa työssä, on tarkoituksella kapea, keskittyen yhteen huomio-päähän lineaarisilla token-dynamiikilla – yksinkertaisella asetuksella, jossa jokainen uusi token päivittää sisäistä tilaa suoran vektorin lisäyksen kautta, ilman epälineaarisia muunnoksia tai porttiin.

Tämä yksinkertainen asetus antaa tutkijoille mahdollisuuden työskennellä tarkkoja tuloksia ja antaa heille selkeän geometrisen kuvan siitä, miten ja milloin mallin tuloste voi äkkiä siirtyä hyvästä huonoon.

Heidän testeissään kaava, jonka he johdattavat tämän siirtymän ennustamiseksi, vastaa sitä, mitä malli todella tekee.

Chatting Up..?

Kuitenkin tämä tarkkuus toimii vain, koska malli on pidetty tarkoituksella yksinkertaisena. Vaikka tutkijat myöntävät, että heidän johtopäätöksiensä tulisi myöhemmin testata monimutkaisemmissa monipäisen mallissa, kuten Claude ja ChatGPT -sarjoissa, he uskovat, että teoria säilyy toistettavissa, kun huomio-päitä lisätään, ja toteavat*:

‘Kysymys siitä, mitä lisäilmiöitä ilmenee, kun huomio-päiden ja kerrosten määrää lisätään, on fascinating one. Mutta mitkä tahansa siirtymät yhden huomio-pään sisällä tulevat edelleen tapahtumaan, ja voivat tulla vahvistetuiksi ja/tai synchronoituiksi kytkennöistä – kuin ketjuun kytkettyjen ihmisten vetäminen yli kallion, kun yksi putoaa.’

Kuva, joka osoittaa, miten ennustettu kallistuspiste n* muuttuu kehotteen suuntautumisen mukaan hyvään tai huonoon sisältöön. Pinta tulee tutkijoiden approksimatiivisesta kaavasta ja osoittaa, että kohteliaat termit, jotka eivät selkeästi tue kumpaakaan puolta, eivät vaikuta merkittävästi siihen, milloin romahdus tapahtuu.

Mitä ei ole selvää, on se, selviääkö sama mekanismi moderniin transformer-arkkitehtuuriin. Monipäinen huomio antaa mahdollisuuksia vuorovaikutuksille erikoistuneiden päiden välillä, mikä voi puskia tai peittää tämänkaltaisen kallistumisen.

Tutkijat tunnustavat tämän monimutkaisuuden, mutta väittävät, että huomio-päät ovat usein löyhästi kytkettyjä, ja että heidän mallissaan kuvattu sisäinen romahdus voi olla vahvistettu, ei estetty, täysimittaisissa järjestelmissä.

Ilman mallin laajentamista tai empiiristä testausta tuotannon LLM:issä, väite on vielä vahvistamatta. Kuitenkin mekanismi näyttää riittävän tarkalta, jotta se tukee jatkotutkimuksia, ja tutkijat tarjoavat selkeän mahdollisuuden haastaa tai vahvistaa teoriansa laajassa mittakaavassa.

Signing Off

Tällä hetkellä kohteliaisuuden aihe kuluttajien kohtaisiin LLM-järjestelmiin näyttää olevan lähestytty joko (pragmatistisesta) näkökulmasta, jonka mukaan koulutetut järjestelmät voivat vastata hyödyllisemmin kohteliaisiin kysymyksiin; tai että taktiton ja karkea viestintätapa näiden järjestelmien kanssa riski siirtyä käyttäjän todellisiin sosiaalisiin suhteisiin, tapojen kautta.

Väittäen, että LLM:t eivät ole vielä olleet laajasti käytössä todellisissa sosiaalisissa konteksteissa, jotta tutkimuskirjallisuus voisi vahvistaa jälkimmäisen tapauksen; mutta uusi tutkimus heittää mielenkiintoisen epäilyn kohteliaisuuden hyödyistä antropomorfisoiduissa AI-järjestelmissä.

Stanfordin tutkimus viime lokakuussa ehdotti (toisin kuin 2020 tutkimus) että LLM-järjestelmien kohtelemista kuin ihmisiä riski heikentää kielen merkitystä, ja johtopäätöksen, että ‘rote’ kohteliaisuus lopulta menettää alkuperäisen sosiaalisen merkityksensä:

[Lause, joka näyttää ystävälliseltä tai aidoilta, jos sitä lausuu ihminen, voi olla epätoivottava, jos se tulee AI-järjestelmältä, koska jälkimmäisellä ei ole merkityksellistä sitoutumista tai aikomusta lauseen taustalla, jolloin lause menettää merkityksensä ja tulee epäaidoksi ja harhauttavaksi.’

Kuitenkin noin 67 prosenttia amerikkalaisista sanoo olevansa kohtelias heidän AI-keskusteluroboteilleen, Future Publishingin 2025 tutkimuksessa. Useimmat sanoivat, että se on vain “oikea asia tehdä”, kun taas 12 prosenttia myönsi olevansa varovaisia – vain varmuuden vuoksi, jos koneet joskus nousevat valtaan.

* Minun muutos tutkijoiden sisäisistä viittauksista hyperlinkkeihin. Jossain määrin hyperlinkit ovat mielivaltaisia/esimerkkiviittauksia, koska tutkijat viittaavat useisiin alaviitteisiin, eivätkä aina tiettyyn julkaisuun.

Julkaistu ensimmäisen kerran keskiviikkona, 30. huhtikuuta 2025. Muutettu keskiviikkona, 30. huhtikuuta 2025, kello 15:29:00, muotoilun vuoksi.