Líderes del pensamiento

Lo que todo científico de datos debe saber sobre los transformadores de gráficos y su impacto en los datos estructurados

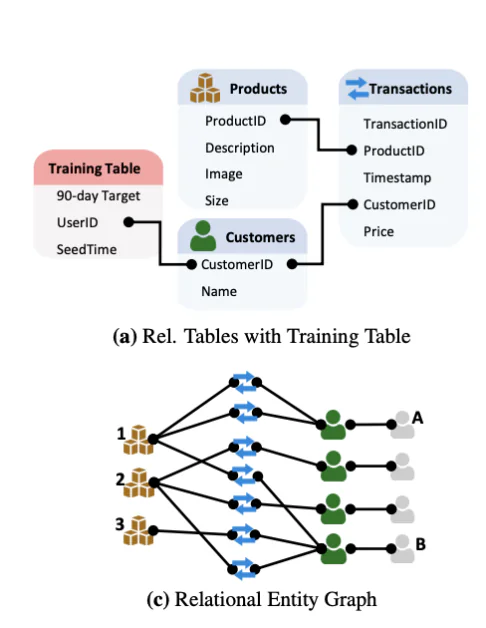

Cocreé Redes Neuronales de Gráficos mientras estudiaba en Stanford. Desde el principio, reconocí el increíble poder de esta tecnología. Cada punto de datos, cada observación, cada pieza de conocimiento no existe de forma aislada; forma parte de un gráfico conectado a otras piezas de conocimiento. Es importante destacar que los datos empresariales más valiosos, a menudo almacenados como tablas en bases de datos y almacenes de datos, pueden representarse de forma natural como... gráficaAprovechar esta estructura relacional es clave para construir modelos de IA precisos y no alucinantes.

Las redes neuronales de grafos (GNN) introdujeron arquitecturas de paso de mensajes que permitían razonar sobre grafos capturando conexiones entre fragmentos de conocimiento. Pero, al igual que los transformadores transformaron la comprensión del lenguaje, una nueva clase de modelos, los transformadores de grafos, aporta beneficios similares a los datos basados en grafos. Estos modelos combinan la flexibilidad de los mecanismos de atención con los valores a priori de grafos estructurales para modelar relaciones complejas con mayor eficacia que sus predecesores, las GNN.

Por qué los gráficos necesitan más que el paso de mensajes

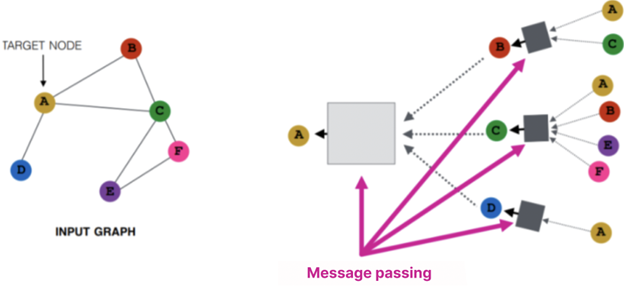

Las redes neuronales gráficas tradicionales (GNN) se basan en paso de mensajes, un proceso en el que cada nodo actualiza su estado interno agregando información de sus vecinos. Se trata de un proceso en el que cada nodo intercambia resúmenes con los nodos cercanos y los utiliza para refinar su propia comprensión. En múltiples capas, esto permite que la información se propague a través del grafo.

Si bien es potente para aprender patrones locales, el paso de mensajes tiene limitaciones importantes:

- Aplastamiento excesivoA medida que la información se agrega en muchos saltos, puede comprimirse, perdiendo detalles significativos. Esto es especialmente problemático en las redes neuronales profundas (GNN).

- Contexto limitadoEl paso de mensajes estándar no puede capturar fácilmente dependencias de largo alcance sin muchas capas, lo que aumenta la complejidad y el ruido.

- Expresividad:Muchas estructuras gráficas no se pueden diferenciar utilizando solo información del vecindario local, lo que limita el rendimiento del modelo en tareas que requieren distinciones estructurales finas.

Aquí es donde entran en juego los Transformadores de Gráficos. Al sustituir o ampliar el paso de mensajes con mecanismos de atención, permiten que cada nodo atienda directamente a otros (incluso a los distantes) según la importancia adquirida. El resultado son representaciones más ricas, mejor escalabilidad y la capacidad de razonar sobre estructuras complejas con mayor flexibilidad.

De GNN a transformadores de gráficos

El modelo original de Transformers, presentado en el icónico artículo, La atención es todo lo que necesitas, fue diseñado para modelar las relaciones entre tokens en una secuencia. Su éxito radica en la autoatención, un mecanismo que permite que cada entrada considere todas las demás, ponderadas por la relevancia aprendida.

Transformadores de gráficos Adaptar este paradigma permitiendo que los nodos presten atención no solo a sus vecinos, sino a cualquier nodo del grafo, ya sea mediante una atención completamente conectada o un enfoque híbrido que equilibre las señales globales y locales. El reto reside en introducir la noción de estructura en un modelo diseñado para secuencias no estructuradas.

Codificaciones posicionales específicas de gráficos

A diferencia del texto, los gráficos no tienen un orden inherente, lo que hace que... codificación posicional, que se refiere a técnicas para inyectar información estructural o basada en la ubicación en un modelo, no trivial. Los transformadores de grafos abordan esto con varios métodos:

- Vectores propios laplacianos: derivados de la matriz laplaciana del gráfico, proporcionan una incrustación espectral que captura la estructura global.

- Paseos aleatorios: captura la probabilidad de atravesar un nodo a otro en múltiples saltos.

- Codificaciones estructurales: incluyen métricas de distancia, grados de nodo o tipos de borde.

Estas codificaciones posicionales, ya sean espectrales, probabilísticas o estructurales, permiten a los Transformadores de Gráficos comprender la ubicación de cada nodo dentro del grafo general. Esta comprensión estructural es esencial para que los mecanismos de atención operen de forma significativa en datos irregulares y desordenados, lo que permite al modelo capturar relaciones que serían invisibles para métodos locales más simples.

Implementaciones y casos de uso en el mundo real

Para implementar Graph Transformers en producción se requiere una infraestructura escalable a tamaños de datos reales. Bibliotecas como PyTorch Geométrico (PyG) Lo hacen posible. Desarrollado sobre PyTorch, PyG proporciona un marco modular para implementar GNN y transformadores de grafos en diversas aplicaciones, desde modelado molecular hasta sistemas de recomendación. Admite entrenamiento por minilotes tanto en muchos grafos pequeños como en grafos grandes individuales, con compatibilidad multi-GPU y con torch.compile, lo que lo hace ideal tanto para flujos de trabajo de investigación como empresariales.

Estas herramientas ya impulsan una amplia gama de aplicaciones del mundo real. En el descubrimiento de fármacos, los transformadores de grafos ayudan a predecir propiedades moleculares modelando interacciones atómicas como grafos. En logística y optimización de la cadena de suministro, pueden representar y razonar sobre redes dinámicas de envíos, almacenes y rutas. Las empresas de comercio electrónico los utilizan para mejorar las recomendaciones al comprender la compra conjunta de productos y el comportamiento de navegación como grafos relacionales. Y en ciberseguridad, los modelos basados en grafos se utilizan para detectar anomalías mediante el análisis de patrones de acceso, topología de red y secuencias de eventos.

En cada uno de estos entornos, la capacidad de aprender de estructuras complejas e interconectadas, sin depender únicamente de características artesanales, está demostrando ser una gran ventaja.

Consideraciones técnicas

A pesar de su potencial, los Transformadores de Gráficos presentan desventajas de ingeniería. La autoatención completa escala cuadráticamente con el número de nodos, lo que convierte la memoria y la eficiencia computacional en una preocupación principal, especialmente para gráficos densos o de gran escala. Muchos gráficos reales también presentan aristas direccionales, lo que introduce asimetrías que complican la codificación de la información estructural. Y en implementaciones prácticas, las entradas rara vez son uniformes: combinar datos estructurados en gráficos con texto, series temporales o imágenes exige decisiones arquitectónicas cuidadosas y un preprocesamiento de datos robusto.

Estos desafíos no son insuperables, pero sí requieren un diseño de sistema cuidadoso, especialmente durante la transición de prototipos de investigación a modelos listos para producción.

¿Qué sigue?: Los LLM se encuentran con los gráficos

Una importante línea de investigación es la integración de grandes modelos de lenguaje (LLM) con estructuras de grafos. Estos sistemas híbridos utilizan LLM para codificar el contexto textual o extraer entidades, y luego basan esa información en un grafo para el razonamiento y la toma de decisiones.

En biología, esto ha impulsado herramientas como AlphaFoldEn la IA empresarial, permite sistemas de atención al cliente que combinan documentación y gráficos de comportamiento. Los transformadores de gráficos también desempeñan un papel cada vez más importante, permitiendo a los agentes de IA tomar decisiones más inteligentes y prácticas, al permitirles razonar sobre representaciones de estados estructurados y priorizar interacciones dinámicamente. Esta fusión ayuda a los agentes a comprender mejor las relaciones jerárquicas, rastrear las dependencias a lo largo del tiempo y adaptar su comportamiento en entornos complejos.

El campo aún está emergiendo, pero el potencial es significativo.

Conclusión

Los Transformadores de Gráficos no son solo la siguiente versión de las Redes de Generación de Datos (GNN); representan una convergencia de atención, estructura y escalabilidad. Ya sea que trabajes en finanzas, ciencias de la vida o sistemas de recomendación, el mensaje es claro: tus datos forman un gráfico, y tus modelos también deberían hacerlo.