Ángulo de Anderson

Hacia el Control Total en la Generación de Vídeo de IA

Los modelos de video fundamentales como Hunyuan y Wan 2.1, aunque potentes, no ofrecen a los usuarios el tipo de control granular que la producción de cine y televisión (particularmente la producción de efectos visuales) exige.

En los estudios profesionales de efectos visuales, los modelos de código abierto como estos, junto con modelos de imagen anteriores (en lugar de video) como Stable Diffusion, Kandinsky y Flux, se utilizan generalmente junto con una serie de herramientas de apoyo que adaptan su salida bruta para satisfacer necesidades creativas específicas. Cuando un director dice, “Eso se ve genial, pero ¿podemos hacerlo un poco más [n]?” no puedes responder diciendo que el modelo no es lo suficientemente preciso como para manejar dichas solicitudes.

En su lugar, un equipo de VFX de IA utilizará una serie de técnicas tradicionales de CGI y composición, aliadas con procedimientos y flujos de trabajo personalizados desarrollados con el tiempo, para intentar empujar los límites de la síntesis de video un poco más lejos.

Así que, por analogía, un modelo de video fundamental es similar a una instalación predeterminada de un navegador web como Chrome; hace mucho fuera de la caja, pero si deseas que se adapte a tus necesidades, en lugar de viceversa, necesitarás algunos complementos.

Control Freaks

En el mundo de la síntesis de imagen basada en difusión, el sistema de terceros más importante es ControlNet.

ControlNet es una técnica para agregar control estructurado a los modelos generativos basados en difusión, lo que permite a los usuarios guiar la generación de imágenes o video con entradas adicionales como mapas de bordes, mapas de profundidad o información de pose.

imagen (fila superior), segmentación semántica>imagen (abajo a la izquierda) y generación de imagen guiada por pose de humanos y animales (abajo a la izquierda).” width=”779″ height=”422″ /> Los diferentes métodos de ControlNet permiten profundidad>imagen (fila superior), segmentación semántica>imagen (abajo a la izquierda) y generación de imagen guiada por pose de humanos y animales (abajo a la izquierda).

En lugar de confiar únicamente en prompts de texto, ControlNet introduce ramas de red neuronal separadas, o adaptadores, que procesan estas señales de acondicionamiento mientras conservan las capacidades generativas del modelo base.

Esto permite salidas afinadas que se adhieren más estrechamente a las especificaciones del usuario, lo que lo hace particularmente útil en aplicaciones donde se requiere un control preciso de composición, estructura o movimiento:

Con una pose guía, se pueden obtener varios tipos de salidas precisas a través de ControlNet. Fuente: https://arxiv.org/pdf/2302.05543

Sin embargo, los marcos de trabajo basados en adaptadores de este tipo operan externamente en un conjunto de procesos neuronales que están muy enfocados internamente. Estos enfoques tienen varias desventajas.

Primero, los adaptadores se entrenan de forma independiente, lo que lleva a conflictos de rama cuando se combinan varios adaptadores, lo que puede implicar una calidad de generación degradada.

En segundo lugar, introducen redundancia de parámetros, lo que requiere cálculo y memoria adicionales para cada adaptador, lo que hace que la escalabilidad sea ineficiente.

En tercer lugar, a pesar de su flexibilidad, los adaptadores a menudo producen resultados subóptimos en comparación con los modelos que están completamente afinados para la generación multi-condición. Estos problemas hacen que los métodos basados en adaptadores sean menos efectivos para tareas que requieren una integración sin problemas de múltiples señales de control.

Idealmente, las capacidades de ControlNet se entrenarían nativamente en el modelo, de una manera modular que pudiera acomodar innovaciones posteriores y muy anticipadas, como la generación de video y audio simultáneos, o capacidades de sincronización de labios nativas (para audio externo).

Como está, cada pieza adicional de funcionalidad representa una tarea de post-producción o un procedimiento no nativo que tiene que navegar los pesos sensibles y estrechamente vinculados de cualquier modelo de base en el que esté operando.

FullDiT

En este punto de estancamiento llega una nueva oferta de China, que plantea un sistema en el que las medidas de estilo ControlNet se hornean directamente en un modelo de video generativo en el momento del entrenamiento, en lugar de ser relegadas a un afterthought.

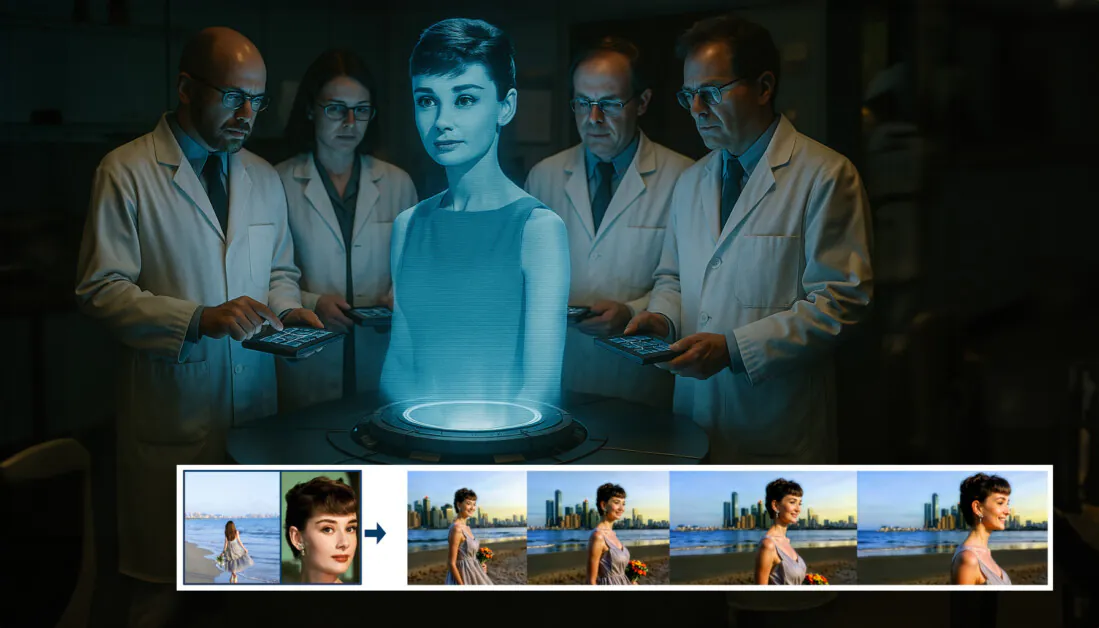

Del nuevo documento: el enfoque FullDiT puede incorporar imposición de identidad, profundidad y movimiento de cámara en una generación nativa, y puede invocar cualquier combinación de estos al mismo tiempo. Fuente: https://arxiv.org/pdf/2503.19907

Titled FullDiT, el nuevo enfoque fusiona condiciones multi-tarea como transferencia de identidad, mapeo de profundidad y movimiento de cámara en una parte integrada de un modelo de video generativo entrenado, para el cual los autores han producido un modelo entrenado prototipo y clips de video acompañantes en un sitio del proyecto.

En el ejemplo a continuación, vemos generaciones que incorporan movimiento de cámara, información de identidad y texto (es decir, prompts de texto de usuario):

Haga clic para reproducir. Ejemplos de imposición de usuario de estilo ControlNet con solo un modelo de base entrenado de forma nativa. Fuente: https://fulldit.github.io/

Debería tenerse en cuenta que los autores no proponen su modelo entrenado experimental como un modelo de base funcional, sino más bien como una prueba de concepto para modelos de video a texto (T2V) y de imagen a video (I2V) que ofrecen a los usuarios más control que solo un prompt de imagen o un prompt de texto.

Dado que no hay modelos de este tipo todavía, los investigadores crearon un nuevo benchmark titulado FullBench, para la evaluación de videos multi-tarea, y afirman un rendimiento de estado del arte en las pruebas como para como que diseñaron contra enfoques anteriores. Sin embargo, dado que FullBench fue diseñado por los autores mismos, su objetividad no ha sido probada, y su conjunto de datos de 1.400 casos puede ser demasiado limitado para conclusiones más amplias.

Quizás el aspecto más interesante de la arquitectura que el documento presenta es su potencial para incorporar nuevos tipos de control. Los autores afirman:

‘En este trabajo, solo exploramos condiciones de control de la cámara, identidades y información de profundidad. No investigamos más a fondo otras condiciones y modalidades como audio, habla, nube de puntos, cajas delimitadoras de objetos, flujo óptico, etc. Aunque el diseño de FullDiT puede integrar sin problemas otras modalidades con una modificación mínima de la arquitectura, cómo adaptar rápidamente y de forma rentable los modelos existentes a nuevas condiciones y modalidades es todavía una pregunta importante que requiere una exploración adicional.’

Aunque los investigadores presentan FullDiT como un paso adelante en la generación de video multi-tarea, se debe considerar que este nuevo trabajo se basa en arquitecturas existentes en lugar de introducir un paradigma fundamentalmente nuevo.

Sin embargo, FullDiT se encuentra actualmente solo (hasta donde llega mi conocimiento) como un modelo de base de video con instalaciones de estilo ControlNet ‘codificadas’, y es bueno ver que la arquitectura propuesta puede acomodar innovaciones posteriores también.

Haga clic para reproducir. Ejemplos de movimientos de cámara controlados por el usuario, del sitio del proyecto.

El nuevo documento se titula FullDiT: Modelo de base generativo de video multi-tarea con atención completa, y proviene de nueve investigadores en Kuaishou Technology y The Chinese University of Hong Kong. El sitio del proyecto está aquí y el nuevo benchmark de datos está en Hugging Face.

Método

Los autores sostienen que el mecanismo de atención unificado de FullDiT permite un aprendizaje de representación cruzada de modalidad más fuerte al capturar tanto relaciones espaciales como temporales entre condiciones:

Según el nuevo documento, FullDiT integra múltiples condiciones de entrada a través de la atención completa, convirtiéndolas en una secuencia unificada. Por el contrario, los modelos basados en adaptadores (izquierda) utilizan módulos separados para cada entrada, lo que lleva a redundancia, conflictos y un rendimiento más débil.

A diferencia de los conjuntos basados en adaptadores que procesan cada flujo de entrada por separado, esta estructura de atención compartida evita conflictos de rama y reduce la sobrecarga de parámetros. También afirman que la arquitectura puede escalarse a nuevos tipos de entrada sin un rediseño importante – y que el esquema del modelo muestra signos de generalización a combinaciones de condiciones que no se vieron durante el entrenamiento, como vincular el movimiento de la cámara con la identidad del personaje.

Haga clic para reproducir. Ejemplos de generación de identidad del sitio del proyecto.

En la arquitectura de FullDiT, todas las entradas de acondicionamiento – como texto, movimiento de cámara, identidad y profundidad – se convierten primero en un formato de token unificado. Estos tokens se concatenan luego en una sola secuencia larga, que se procesa a través de una pila de capas de transformador utilizando la atención completa. Este enfoque sigue trabajos anteriores como Open-Sora Plan y Movie Gen.

Este diseño permite que el modelo aprenda relaciones temporales y espaciales de manera conjunta en todas las condiciones. Cada bloque de transformador opera sobre la secuencia completa, permitiendo interacciones dinámicas entre modalidades sin depender de módulos separados para cada entrada – y, como hemos señalado, la arquitectura está diseñada para ser extensible, lo que hace mucho más fácil incorporar señales de control adicionales en el futuro, sin cambios estructurales importantes.

El Poder de Tres

FullDiT convierte cada señal de control en un formato de token estandarizado para que todas las condiciones puedan procesarse juntas en un marco de atención unificado. Para el movimiento de cámara, el modelo codifica una secuencia de parámetros extrínsecos – como posición y orientación – para cada cuadro. Estos parámetros están fechados y proyectados en vectores de incrustación que reflejan la naturaleza temporal de la señal.

La información de identidad se trata de manera diferente, ya que es inherentemente espacial en lugar de temporal. El modelo utiliza mapas de identidad que indican qué personajes están presentes en qué partes de cada cuadro. Estos mapas se dividen en patches, con cada parche proyectado en una incrustación que captura pistas de identidad espacial, lo que permite al modelo asociar regiones específicas del cuadro con entidades específicas.

La profundidad es una señal de espacio-tiempo, y el modelo la maneja dividiendo los videos de profundidad en parches 3D que abarcan tanto el espacio como el tiempo. Estos parches se incrustan de una manera que preserva su estructura a lo largo de los cuadros.

Una vez incrustados, todos estos tokens de condición (cámara, identidad y profundidad) se concatenan en una sola secuencia larga, lo que permite a FullDiT procesarlos juntos utilizando la atención completa. Esta estructura de representación compartida hace posible que el modelo aprenda interacciones entre modalidades y a lo largo del tiempo sin depender de flujos de procesamiento aislados.

Datos y Pruebas

El enfoque de entrenamiento de FullDiT dependió de conjuntos de datos anotados selectivamente adaptados a cada tipo de acondicionamiento, en lugar de requerir que todas las condiciones estuvieran presentes simultáneamente.

Para condiciones textuales, la iniciativa sigue el enfoque de captionado estructurado descrito en el proyecto MiraData.

Pipeline de colección y anotación de video del proyecto MiraData. Fuente: https://arxiv.org/pdf/2407.06358

Para el movimiento de cámara, el conjunto de datos RealEstate10K fue la principal fuente de datos, debido a sus anotaciones de parámetros de cámara de alta calidad.

Sin embargo, los autores observaron que el entrenamiento exclusivamente en conjuntos de datos de escenas estáticas de cámara como RealEstate10K tendía a reducir los movimientos de objetos y humanos dinámicos en los videos generados. Para contrarrestar esto, realizaron un ajuste fino adicional utilizando conjuntos de datos internos que incluían movimientos de cámara más dinámicos.

Las anotaciones de identidad se generaron utilizando la canalización desarrollada para el proyecto ConceptMaster, que permitió una filtración y extracción eficientes de información de identidad de grano fino.

El marco de ConceptMaster está diseñado para abordar problemas de desacoplamiento de identidad mientras se mantiene la fidelidad del concepto en videos personalizados. Fuente: https://arxiv.org/pdf/2501.04698

Las anotaciones de profundidad se obtuvieron del conjunto de datos Panda-70M utilizando Depth Anything.

Optimización a través del Orden de los Datos

Los autores también implementaron un calendario de entrenamiento progresivo, introduciendo condiciones más desafiantes al comienzo del entrenamiento para asegurarse de que el modelo adquiriera representaciones robustas antes de que se agregaran tareas más simples.

El orden de entrenamiento procedió desde texto a cámara condiciones, luego identidades, y finalmente profundidad, con tareas más fáciles generalmente introducidas más tarde y con menos ejemplos.