Ángulo de Anderson

El ‘documento de investigación DDoS Attack’ que abruma la investigación científica

Los modelos de inteligencia artificial generativa, como ChatGPT, ahora inundan las plataformas de publicación académica con documentos de investigación generados por IA a niveles que están haciendo que la relación señaligena sea crítica. Un nuevo estudio afirma que esta inundación está abrumando a los investigadores, distorsionando las citas y erosionando la confianza en el registro científico, comparando la afluencia de documentos ayudados por IA con un ‘ataque DDoS’ a la ciencia en sí.

(Parcialmente) opinión La semana pasada, por primera vez en siete años de mantenerme al día con la corriente de literatura científica relacionada con la IA, tuve que admitir la derrota y reconocer que, al menos en momentos pico, ahora debo elegir entre mantenerme al tanto de las nuevas publicaciones esenciales o tener algún tiempo libre para escribir sobre algunas de ellas.

El número total de entradas en un número muy limitado de categorías relevantes (Visión por Computadora, Aprendizaje Automático, Modelos de Lenguaje, y algunas secciones menos suscritas) estaba en significativamente más de mil – solo para las solicitudes de un día.

En tal volumen, incluso ojear todos los nuevos títulos y ocasionalmente deleitarse en algunos de los resúmenes de abstractos haría de un día improductivo.

Esto fue el martes 7 de octubre. Por contraste, en la categoría de Aprendizaje Automático, este martes pasado (14 de octubre) ofreció un volumen de publicación ligeramente menos intenso que los 400 registros para el martes de la semana anterior; tenía un mero 354 registros:

354 solicitudes para la categoría de Aprendizaje Automático en un día. Fuente: https://arxiv.org/

Tendrías que haber estado leyendo Arxiv todos los días, durante algunos años, para darte cuenta de lo insano que están volviendo estos números.

Admitidamente, el martes es la ‘hora pico’ de Arxiv para las solicitudes, quizás porque es el primer día laboral que ocurre lejos de cualquier fin de semana largo disfrutado por las personas influyentes que los investigadores esperan alcanzar; y la categoría de Aprendizaje Automático es una sección de ‘atrapalotodo’ con un número menor de artículos únicos (artículos que no se publican simultáneamente en canales más especializados) que la mayoría de las otras categorías.

No obstante, el aumento en las solicitudes de artículos ya es un fenómeno anotado en la academia y en los medios.

Quizás el aspecto más impactante de esta escalada es cómo todas las categorías adyacentes son más o menos inalteradas en su frecuencia durante los últimos tres años, mientras que la categoría de Ciencias de la Computación (ver si puedes encontrarla en las cifras oficiales de Arxiv a continuación) está en una trayectoria ascendente severa:

El aumento de artículos de ciencias de la computación (CS) durante los últimos tres años. Fuente: https://info.arxiv.org/about/reports/submission_category_by_year.html

Hace poco más de tres años, la producción de artículos de IA de Arxiv se estimó que se duplicaba cada pocos años; y será interesante leer el propio resumen anual de tendencias de Arxiv al final de 2025.

Volumen al 11

Las dos razones más obvias por las que esto está sucediendo son a) un compromiso financiero sin precedentes con la IA generativa es atractivo para niveles masivos de inversión en investigación en los sectores privado y académico, que a menudo colaboran; y b) el hecho de que los sistemas de modelos de lenguaje de IA como ChatGPT ahora hacen que presentar artículos de investigación (incluidos artículos sobre IA) sea un proceso casi industrializado.

Sin embargo, la calidad de las presentaciones de investigación no está aumentando en tandem con el volumen (aunque la salida con errores de la IA tiende a generar más titulares en el sector legal que en el académico, no menos porque las ramificaciones son más obvias allí).

Una política de tolerancia cero es difícil de implementar en este caso, incluso si reconocer el contenido generado por IA fuera más fácil; además del hecho de que la IA en sí es una bendición manifiesta para la investigación científica en general, su uso en las presentaciones de artículos de investigación ha mejorado en general* la claridad del trabajo de muchos presentadores no ingleses – individuos y equipos que hasta ahora operaban en desventaja.

Pero el problema de reducir la barrera del lenguaje de esta manera es que también aumenta el número total de presentadores globales, sin aumentar el nivel de supervisión humana que da valor a dicho trabajo.

Si los niveles de presentación continúan aumentando exponencialmente, la relación señaligena se volverá tan ingobernable que solo la IA misma podría navegar las nuevas inundaciones y afluentes de artículos de IA; una tarea que no está más capacitada para realizar que para verificar su propia salida. Irónicamente, la investigación científica es una empresa humana intensa.

Un ataque a la investigación

La causa de esta reflexión es una colaboración nueva y interesante de China titulada Detener el ataque DDoS a la comunidad de investigación con documentos de investigación generados por IA.

El nuevo documento de posición se centra específicamente en las presentaciones de investigación – resúmenes de alto esfuerzo de particulares corrientes en la investigación, que han enumerado y contextualizado tradicionalmente, interpretando tendencias y haciendo predicciones informadas:

Una fracción mínima del vasto y creciente cuerpo de encuestas disponibles en secciones relacionadas con el aprendizaje automático y la IA, en arxiv.org

Dado que las encuestas curan en lugar de originar, son inusualmente fáciles de automatizar con IA, y los autores del nuevo trabajo caracterizan la proliferación de encuestas de bajo esfuerzo en términos de una amenaza de seguridad al sector de la investigación†:

‘[El] reciente aumento de las encuestas generadas por IA, especialmente habilitadas por grandes modelos de lenguaje (LLM), ha transformado este género tradicionalmente laborioso en una salida de alto volumen y bajo esfuerzo. Si bien dicha automatización reduce las barreras de entrada, también introduce una amenaza crítica: el fenómeno que denominamos el “ataque de documento de investigación DDoS” a la comunidad de investigación.

‘Esto se refiere a la proliferación no controlada de manuscritos de encuestas superficiales pero a menudo redundantes, de baja calidad o incluso alucinados, que inunda las plataformas de preimpresión, abruma a los investigadores y erosiona la confianza en el registro científico.

‘[Nosotros] argumentamos que debemos detener la carga de grandes cantidades de documentos de investigación generados por IA (es decir, ataque de documento de investigación DDoS) a la comunidad de investigación, instituyendo normas sólidas para la revisión asistida por IA.’

Los autores afirman que esta aceleración desenfrenada de la producción de encuestas amenaza con inundar el ecosistema de investigación con informes pulidos que carecen de profundidad crítica, y que probablemente propagarán errores fácticos y/o alucinaciones de citas.

El documento advierte que sin mejores reglas o supervisión, las encuestas generadas por IA podrían convertirse en copias superficiales que tergiversan qué temas son importantes, ocultan análisis significativos y hacen que las reseñas de literatura sean menos confiables:

‘Las implicaciones para la calidad de la investigación y la confianza son profundas. En primer lugar, los avances genuinos corren el riesgo de ser oscurecidos por rehashes generados algorítmicamente de trabajo existente.

‘Los recién llegados y los académicos interdisciplinarios pueden luchar por encontrar resúmenes confiables en medio del ruido. Además, los errores o sesgos introducidos por la redacción automatizada pueden propagarse sin control, sembrando la investigación posterior con premisas defectuosas.

‘En resumen, la inundación de encuestas generadas por IA no revisadas por pares pone en peligro tanto la rigidez de las reseñas de literatura como la credibilidad del registro científico.’

‘Autores anormales’

Los investigadores del nuevo documento proporcionan algunos análisis interesantes sobre la evolución de las presentaciones de encuestas:

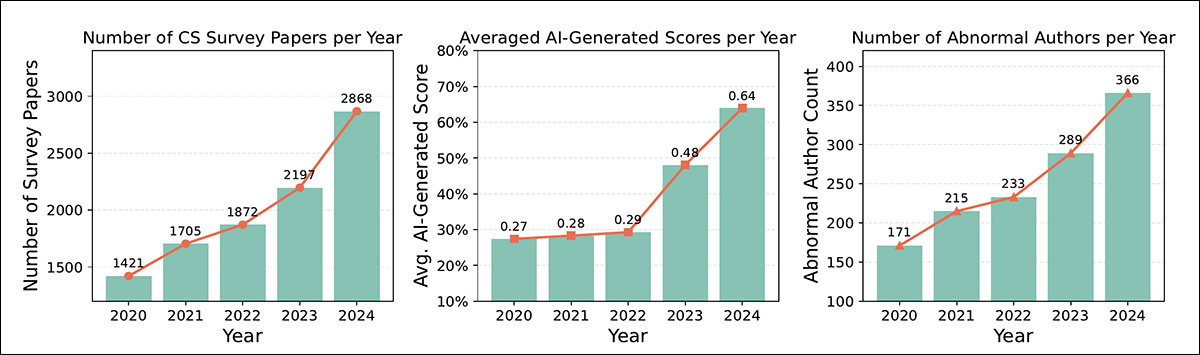

Izquierda: el recuento anual de artículos de encuesta de ciencias de la computación desde 2020 hasta 2024. Centro: puntuaciones de generación de IA promedio para esos artículos durante el mismo período. Derecha: número de autores marcados como anormales (aquellos con una producción de encuesta excepcionalmente alta, una diversidad de coautoría limitada y patrones institucionales recurrentes) cada año. Las tres tendencias muestran un aumento pronunciado a partir de 2023, coincidiendo con el lanzamiento de ChatGPT y otros modelos de lenguaje a gran escala.

En la primera columna vemos tendencias de crecimiento: la curva comienza a escalar alrededor de 2022, justo cuando ChatGPT emergió y los grandes modelos de lenguaje comenzaron a popularizarse, y los modelos de seguimiento como Claude, PaLM, y Gemini mantendrían ese impulso durante todo 2023.

El gráfico del medio muestra un aumento pronunciado en las presentaciones después de 2022, coincidiendo con el lanzamiento de ChatGPT. Un equipo de investigación encontró que para 2024, más del 10% de los resúmenes científicos habían sido procesados a través de un LLM. Un informe separado de una empresa de detección de IA estimó que el salto posterior a ChatGPT fue del 72% para los artículos en arXiv que pueden haber sido escritos con la ayuda de IA. El número de artículos con puntuaciones de generación de IA altas también se duplicó en un año, del 3,6% al 6,2%.

El gráfico de la derecha muestra un aumento constante en el número de patrones de autor ‘anormales’ (investigadores que presentan tres o más encuestas dentro de un mes mientras trabajan con menos de dos colaboradores), con un aumento más pronunciado a partir de 2022.

Los autores afirman que muchos de estos artículos de encuesta pueden haber sido redactados por IA, por diversas razones; algunos son escritos por autores solos o pequeños grupos que presentan múltiples encuestas en un corto período de tiempo; muchos cubren temas no relacionados; y en algunos casos, los autores no tienen ningún récord previo en los campos que están resumiendo.

Además, algunos se publican bajo colectivos anónimos sin vínculos institucionales claros – patrones que sugieren una inundación coordinada del campo con encuestas rápidas, posiblemente para ganar citas o mejorar perfiles académicos, en lugar de hacer cualquier contribución real a la literatura.

Problemas

Aunque no podemos cubrir todas las controversias del nuevo documento, debemos echar un vistazo a algunas de las observaciones más notables, así como lanzar una mirada crítica sobre las soluciones sugeridas por los autores a estos problemas.

Calidad y originalidad

El problema no es solo el volumen: muchas encuestas escritas por IA saltan lo que hace que una buena encuesta sea útil: estructura clara, análisis profundo, crédito correcto y asiduo, y verdadera perspicacia. En cambio, el documento sugiere que las encuestas generadas por IA a menudo leen como resúmenes cosidos, sin none de los cuidados o la curación necesarios.

Los autores observan, además, que las encuestas escritas por IA a menudo carecen de estructura, sino que simplemente enumeran artículos sin dirección clara, saltando secciones clave y sin crear contexto. Las encuestas escritas por humanos, por contraste, tienden a establecer categorías adecuadas y contar una historia más coherente.

También, muchas encuestas potencialmente ayudadas por IA parecen simplemente copiar desgloses de temas existentes, a veces directamente de Wikipedia. Por ejemplo, el documento señala que múltiples encuestas sobre Vision Transformers contienen títulos de sección y estructura comunes, lo que sugiere una salida de plantilla de IA:

‘En contraste, una encuesta bien escrita por un humano podría introducir una nueva taxonomía, por ejemplo, categorizando ViT por estrategias de eficiencia. La falta de tal estructura original en muchas de las recientes presentaciones de encuestas preimpresas plantea preocupaciones de que pueden haber sido generadas por IA con una perspicacia humana limitada.’

No me cites

Quizás lo más vergonzoso en público, las encuestas escritas por IA a menudo obtienen citas incorrectas, perdiendo artículos clave, incluyendo artículos no relevantes, y a veces incluso enumerando artículos inexistentes – errores que sugieren que las referencias provienen de un emparejamiento de patrones de superficie, en lugar de una verdadera pericia.

Los autores también señalan que algunos artículos de encuesta recientes, a menudo de equipos completamente diferentes, comparten hasta un 70% de sus listas de referencias – un nivel de superposición tan alto que argumentan que sugiere una dependencia compartida de LLM, que extraen de la misma piscina estrecha de material de origen.

De hecho, los usuarios casuales de ChatGPT saben que cuanto más oscuro es el tema, menos fuentes diversas hay para que el modelo generalice; muy a menudo, localizar las propias fuentes limitadas del modelo en la web es más útil que tratar de interactuar con esa información a través de una IA que no tuvo datos adecuados en un dominio particular.

Un estilo homogéneo que emerge

Los autores también señalan que muchas encuestas escritas por IA sobre el mismo tema parecen y suenan casi idénticas, ya que los LLM reutilizan la fraseología y la estructura, especialmente para temas populares, lo que resulta en una inundación de artículos casi idénticos que agregan poco valor y también agregan ruido significativo a los investigadores que buscan respuestas de dominio*:

‘Cuando múltiples autores piden a un LLM que “escriba una reseña de literatura sobre X”, el modelo a menudo produce respuestas muy similares, especialmente para definiciones comunes o hechos bien conocidos. Investigaciones recientes han demostrado un aumento pronunciado en el uso de ciertos patrones de escritura vinculados a LLM, lo que sugiere que muchos artículos ahora comparten el mismo estilo.’

Tu ChatGPT se está mostrando

El documento observa que una forma rápida de detectar encuestas escritas por IA es a través de la presencia de frases como ‘como un modelo de lenguaje de IA’ o ‘mi conocimiento de corte’, lo que sugiere una curación mínima o incluso cero de la salida del modelo de lenguaje antes de presentar los artículos (aunque una búsqueda dirigida en el momento de la escritura no reveló tales pistas indexadas en la búsqueda de Google).

El documento señala que muchas encuestas ‘sospechosas’ muestran una diversidad de palabras más baja y una fraseología repetida, por ejemplo, comenzando múltiples párrafos con Además. Este tipo de patrón, sugieren los autores, es típico de la escritura de estilo GPT, y podría ser una bandera útil para detectar texto generado automáticamente.

(Mi comentario personal sobre esto es que las restricciones del periodismo en línea a menudo requieren que un escritor enumere muchos artículos en una forma de prosa no estilizada. Por lo tanto, ChatGPT y sus pares probablemente hayan aprendido este mal hábito de los escritores humanos que se enfrentaron a un número limitado de alternativas léxicas. Además, la conjetura de los autores muestra que están involucrados en los principios de la detección de contenido de IA, que es un campo complejo y en desarrollo, con pocos constantes duraderos del tipo que sugieren los autores)

Aunque los investigadores continúan desarrollando un discurso fascinante sobre el impacto negativo de las encuestas de IA en la cultura de la investigación y la confianza, debemos remitir al lector al documento de origen para una mayor profundidad sobre esto.

Soluciones!

La solución del documento es fascinante, radical y al mismo tiempo extrañamente poco original: que la utilidad de los artículos de encuesta debería reemplazarse por una Encuesta en vivo dinámica – por interpretación, una especie de híbrido entre una Wiki y una página de GitHub, constantemente alimentada con nuevos datos de LLM y otros sistemas de IA, pero con commits realizados solo por humanos, para que la IA no pueda ‘auto-publicar’ actualizaciones.

El sistema propuesto compartiría la versión y la ramificación de GitHub, convirtiendo esencialmente un recurso de información en una lista actualizada constantemente similar a la ‘awesome’ cepa de listas curadas en GitHub:

‘Bajo este marco, un miembro de la comunidad establece primero un tema de encuesta wiki especificando el alcance, las preguntas de investigación clave y las referencias seminales, lo que establece así un límite temático claro y una estructura inicial.

‘Después, un agente de ingesta basado en LLM monitorea continuamente los archivos de preimpresión, los procedimientos de la conferencia y las tablas de clasificación de los benchmarks. Extrae automáticamente resúmenos, figuras y métricas de rendimiento clave; sintetiza resúmenos concisos de nuevos resultados; actualiza el gráfico de citas para reflejar las relaciones entre artículos; y señala las tendencias de investigación emergentes para una revisión posterior.

‘Por diseño, estas actualizaciones automatizadas ocurren dentro de horas de la publicación, garantizando que el repositorio permanezca en la vanguardia.

‘Los contribuyentes humanos intervienen entonces para proporcionar la profundidad interpretativa que las máquinas solas no pueden ofrecer. Refinan las taxonomías en evolución para capturar distinciones metodológicas sutiles, coordinan interpretaciones contradictorias de innovaciones algorítmicas en diferentes subcampos y proporcionan comparaciones críticas más profundas al documento.’

El libro de los cambios

Los autores exponen con entusiasmo y al mismo tiempo justifican esta propuesta, y esencialmente la justifican con algo que es muy cierto: las encuestas de alto esfuerzo escritas por humanos sobre temas volátiles alrededor de la IA envejecen tan rápido que apenas vale la pena escribirlas; y el documento señala que un plazo de tres meses para un nuevo artículo de encuesta probablemente signifique que estará desactualizado (o incluso gravemente desactualizado) para cuando llegue su día de publicación programada:

‘Año tras año, las comunidades están inundadas de resúmenes repetitivos o superficiales que rápidamente pierden relevancia, dejando a los practicantes y los recién llegados luchando por distinguir la señal de ruido. El ciclo de publicación tradicional (es decir, borrador, presentar, revisar y publicar) puede abarcar varios meses, después de lo cual los avances críticos pueden haber cambiado ya el panorama.

‘Además, el volumen creciente de encuestas estáticas agrega a la sobrecarga cognitiva, ya que los lectores deben buscar entre numerosos documentos superpuestos para encontrar ideas sustantivas.’

Desafortunadamente, la solución del documento comparte muchas de las peores y más denostadas cualidades de Discord: la mayoría de ellas, especialmente que sería un recurso en constante cambio y evolución.

Dado que cualquier parte de una Encuesta en vivo dinámica podría desaparecer o modificarse en cualquier momento, sería imposible utilizarla como una fuente citable y estable; excepto, quizás, vinculando a un ‘anterior commit’, de la misma manera que archive.is y la Wayback Machine, entre otros sitios de archivo, proporcionan instantáneas vinculables de contenido de página web, congeladas en un momento particular. Pero ¿qué recursos necesitaría tal commit, y podría confiarse en que permanezca activo con el tiempo?

Además, una plataforma/Wiki con contenido y definiciones en constante cambio sería un desafío para indexar, ya sea por motores de búsqueda tradicionales o LLM.

Quizás la parte más débil de la propuesta del sistema es la idea de que las personas reales deben supervisar los commits de los agentes de LLM; como siempre, las personas reales son caras. Lo que se propone es algo entre un museo y una biblioteca – ambos necesitarán una provisión de ‘carne’ proporcional al volumen de datos y al número de temas cubiertos.

Si ‘usar personas reales‘ es la única respuesta a un problema de desarrollo de IA, es justo decir que el problema sigue abierto y sin resolver.

Conclusión

En este momento, la vida útil corta de los artículos de encuesta sobre IA es molesta; si la tendencia actual hacia la escritura automatizada a gran escala y la presentación continúa, como se prevé en el nuevo documento, la relación señaligena se volverá crónica y la literatura ingobernable.

En tal situación, sería aún más difícil que las voces menores, no FAANG, se escuchen en la tormenta de presentaciones, y los líderes del mercado probablemente ganarían una prominencia aún mayor.

Además de las encuestas en vivo, el nuevo documento propone que los autores no solo estén limitados a declarar cuando se utiliza IA en cualquier parte de una presentación, sino que también que las secciones ayudadas por IA estén etiquetadas explícitamente dentro de un artículo (quizás con un archivo JSON lateral…?).

Dado que esto es una perspectiva onerosa, el documento sugiere alternativamente lo que solo puedo caracterizar como un ‘gueto de IA’ – una sección distinta en la presentación que se reserva para las contribuciones de IA.

En resumen, el nuevo trabajo tiene, al menos en mi opinión, ninguna solución realista que ofrecer; pero los autores han prestado un servicio útil al enmarcar los desafíos que se avecinan.

El documento Detener el ataque DDoS a la comunidad de investigación con documentos de investigación generados por IA se puede encontrar en https://arxiv.org/abs/2510.09686, y está escrito por seis autores en departamentos de la Universidad Jiao Tong de Shanghai.

___________________________________

* No todos sienten que esto es el caso.

†Énfasis de los autores, no mío. Además, donde corresponda, mi conversión de las citas en línea de los autores en hipervínculos.

Publicado por primera vez el viernes 17 de octubre de 2025