Ángulo de Anderson

Incluso el AI Básico Puede Escribir Noticias que Pasan por Humanas

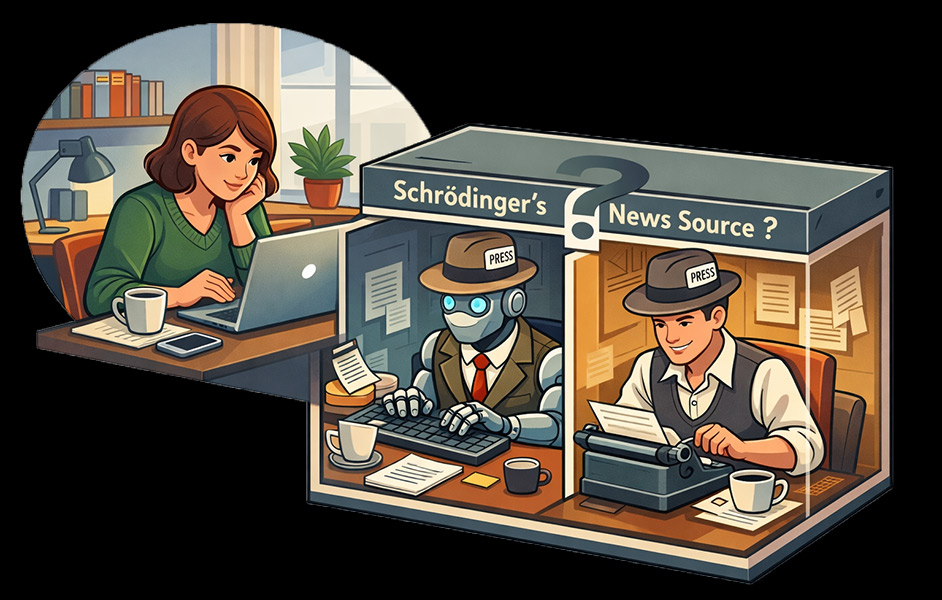

Nueva investigación indica que incluso los modelos de AI locales pequeños pueden escribir noticias que las personas no pueden distinguir de la verdadera labor periodística, igualando a los sistemas de alto nivel, y dejando a los lectores incapaces de determinar quién escribió qué.

Según una nueva colaboración de investigación entre Alemania y Francia, los humanos no pueden determinar si un artículo de noticias es escrito por AI o por un humano – incluso cuando es escrito por modelos de código abierto que se pueden descargar y ejecutar en ordenadores de escritorio de nivel de consumidor relativamente promedio.

En otra indicación de que el pequeño AI está en ascenso, un estudio de 2.318 juicios recopilados de 1.054 participantes en un portal de estudio académico dedicado encontró que los lectores humanos no podían identificar el origen de un artículo a un nivel superior al azar, incluso cuando fue generado por modelos relativamente modestos con tan solo siete mil millones de parámetros, incluyendo Mistral y Llama variantes:

Puntuaciones promedio de fuente y autenticidad para LLMs probados. Los 200 mil millones de parámetros de GPT-4o no superan significativamente los 7B parámetros de los modelos más pequeños. Los probados para el estudio fueron Gemma 7B, Phi-3 Mini, LLaMA-2 13B, Mistral 7B, GPT-4o y GPT-3.5. Fuente

Los autores regresan a un tema que examinaron por primera vez en la publicación de 2024 release ¿Bendición o maldición? Una encuesta sobre el impacto de la IA generativa en las noticias falsas. Los hallazgos en sí son resultados recién publicados de un proyecto más grande inicialmente anunciado en enero, y hacen uso del marco de participación en línea JudgeGPT de los autores.

Poder ligero

Titulado ¿Pueden los humanos distinguir? Un estudio de doble eje de la percepción humana de noticias generadas por LLM, y proveniente de tres investigadores de la Universidad de Ciencias Aplicadas de Frankfurt y la unidad de investigación IRISA en Nantes, la nueva investigación hace una importante distinción entre ‘noticias falsas’ y ‘noticias escritas por AI’ (ya que las noticias falsas pueden ser escritas por personas o por AI, y los dos aspectos no son necesariamente sinónimos).

Sin embargo, quizás el aspecto más interesante es la conclusión del papel de que los modelos pequeños, incluyendo Mistral 7B y Gemma 7B, pueden, con solo siete mil millones de parámetros, igualar con aplomo a los likes de un modelo ChatGPT (4o) con 200 mil millones de parámetros:

‘Los modelos de peso abierto con tan solo 7B parámetros producen texto calificado de manera no diferente a la salida de GPT-4o, lo que indica que la capacidad de generar texto indistinguible de los humanos ya no está restringida a los modelos de vanguardia.’

Sin embargo, ‘noticias generadas por AI’ pueden representar muchos tipos diferentes de colaboración humano/AI, desde la corrección ortográfica hasta la deferencia total de esfuerzo, y el estudio no aclara exactamente qué tipo de contenido de AI se produjo para las pruebas (aunque describe la metodología para producirlo – véase a continuación).

Método

Para los participantes comprometidos con la plataforma JudgeGPT, cada fragmento de noticias se evaluó utilizando un marco de doble eje en el que proporcionaron tres calificaciones independientes en controles deslizantes continuos de 0-100:

La interfaz de usuario del portal JudgeGPT, donde los calificadores evalúan el material en atribución de fuente; autenticidad; y familiaridad con el tema. Consulte el papel de la fuente para una mejor resolución.

El juicio de fuente capturó si un pasaje parecía escrito por máquina o por un humano; el juicio de autenticidad, si se percibía como falso o legítimo; y la familiaridad con el tema, cuán bien conocía el lector el tema.

Se utilizaron escalas continuas en lugar de una escala de Likert, para capturar grados de certeza más precisamente, y para respaldar el análisis estadístico, incluyendo correlación de Pearson y agrupación.

Los fragmentos de texto generados por máquina se produjeron mediante el marco RogueGPT de los autores, la arquitectura de alimentación para JudgeGPT. RogueGPT orquesta contribuciones de seis Modelos de Lenguaje Grande (LLMs): ChatGPT-4; ChatGPT-3.5; ChatGPT-4o; LLaMA-2 13B; Gemma 7B; y Mistral 7B.

Se utilizó una llamada basada en personajes para generar los textos, y las generaciones de AI se basaron en temas de noticias reales y se verificaron con hechos por humanos.

Por el contrario, los fragmentos escritos por humanos se extrajeron de ‘medios de comunicación establecidos’ y ‘bases de datos de información’ no especificadas.