Ética

La Base de Datos de Incidentes de IA tiene como objetivo hacer que los algoritmos de IA sean más seguros

Cualquier sistema lo suficientemente grande tendrá errores, y parte de la corrección de estos errores es tener una base de datos de ellos que se pueda analizar para evaluar sus impactos y causas potenciales. Al igual que la FDA mantiene una base de datos para reacciones adversas a medicamentos, o la Junta Nacional de Seguridad del Transporte mantiene una base de datos para accidentes aéreos, la Base de Datos de Incidentes de IA es una base de datos destinada a catalogar fallos de sistemas de IA y ayudar a los investigadores de IA a ingeniar nuevos métodos para evitar estos fallos. Los creadores de la Base de Datos de Incidentes de IA (AIID) esperan que ayude a las empresas de IA a desarrollar IA más segura y ética.

¿Qué es la AIID?

La AIID es el producto de la organización Partnership on AI (PAI). PAI fue fundada inicialmente en 2016 por miembros de equipos de investigación de IA en grandes empresas de tecnología como Facebook, Apple, Amazon, Google, IBM y Microsoft. Desde entonces, la organización ha reclutado miembros de muchas más organizaciones, incluyendo varias organizaciones sin fines de lucro. En 2018, PAI se propuso crear un estándar de clasificación consistente para los fallos de IA. Sin embargo, no había una recopilación de incidentes de IA sobre la que basar esta clasificación. Por esta razón, PAI creó la AIID.

Según TechTalks, el formato de la AIID se inspiró en la estructura de la base de datos de accidentes aéreos mantenida por la Junta Nacional de Seguridad del Transporte. Desde que se comenzaron a recopilar informes en 1996, el sistema de transporte aéreo comercial ha logrado aumentar la seguridad de la industria de la aviación archivando y analizando incidentes. La esperanza es que un repositorio similar de incidentes de IA pueda hacer que los sistemas de IA sean más seguros, éticos y confiables. La AIID también se inspiró en la base de datos de Vulnerabilidades y Exposiciones Comunes, que es un repositorio de fallos de software notables que abarcan una variedad de industrias y disciplinas diferentes.

Sean McGregor es el consultor técnico principal en IBM para el Watson AI XPRIZE. McGregor también es responsable de supervisar el desarrollo de la base de datos real de la AIID. McGregor explicó que el objetivo de la AIID es, en última instancia, prevenir que los sistemas de IA causen daños, o al menos disminuir la gravedad de los incidentes adversos. Como McGregor señaló, los sistemas de aprendizaje automático son sustancialmente más complejos e impredecibles que los sistemas de software tradicionales, y como resultado, no se pueden probar de la misma manera que otros software. Los sistemas de aprendizaje automático pueden cambiar su comportamiento de manera inesperada. McGregor nota que la capacidad de los sistemas de aprendizaje profundo para aprender puede significar que “los fallos son más probables, más complicados y más peligrosos” cuando entran en un mundo no estructurado.

Más de 1,000 incidentes relacionados con IA registrados

Desde que se creó la AIID, se han registrado más de 1,000 incidentes relacionados con IA en la base de datos. De todos los incidentes en la base de datos, los problemas relacionados con la equidad de IA fueron el tipo más común de incidente adverso. Muchos de estos incidentes de equidad involucran el uso de algoritmos de reconocimiento facial por parte de agencias gubernamentales. McGregor también nota que hay un número creciente de incidentes que involucran robótica que se agregan a la base de datos.

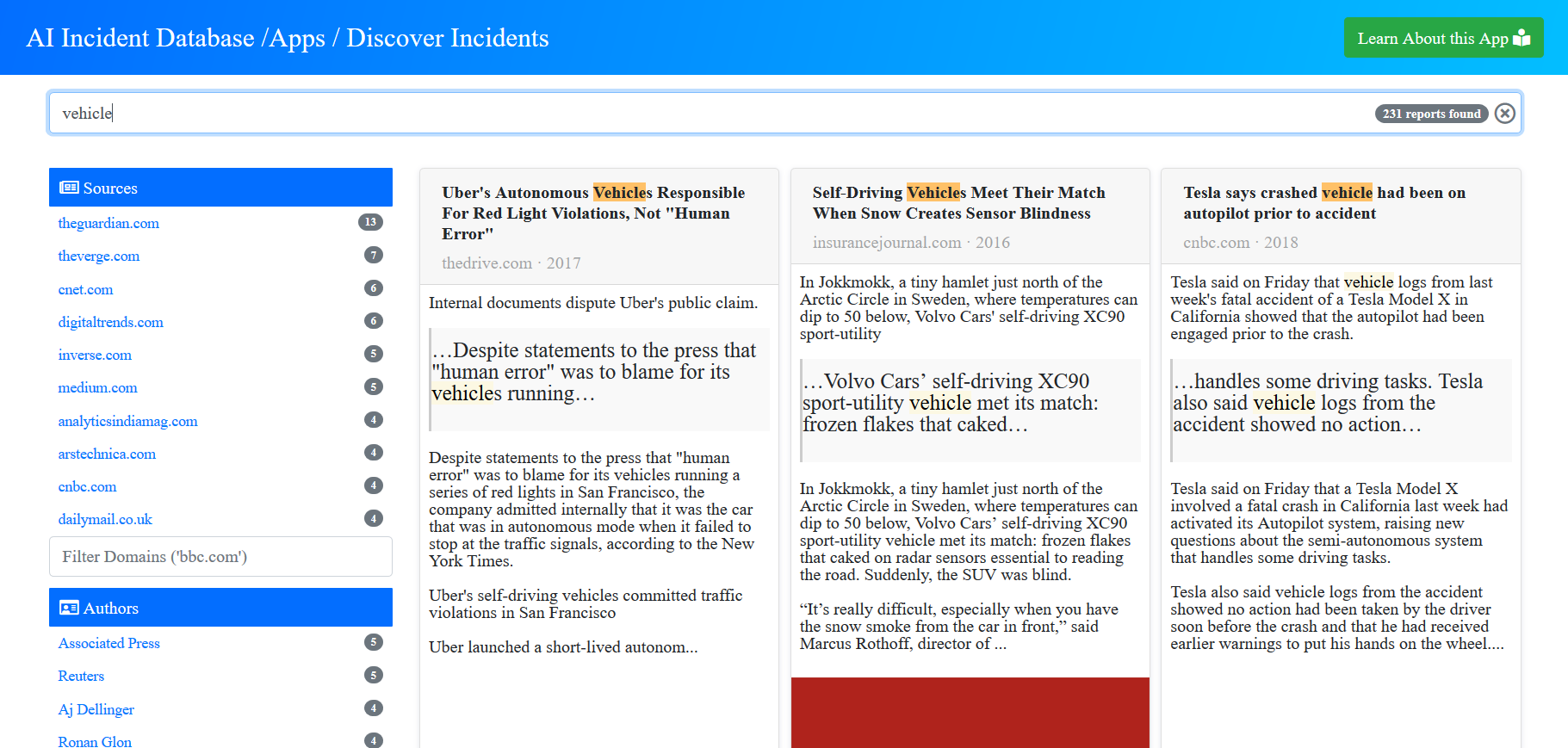

Los visitantes de la base de datos pueden ejecutar consultas, buscando incidentes en la base de datos según criterios como palabras clave, ID de incidente, fuente o autor. Por ejemplo, ejecutar una búsqueda de “Deepfake” devuelve 7 informes, mientras que buscar “robots” devuelve 158 informes.

Una base de datos centralizada para incidentes de fallos de IA y funcionamiento de manera inesperada puede ayudar a investigadores, ingenieros y éticos a supervisar el desarrollo y la implementación de sistemas de IA. Los gerentes de productos en empresas de tecnología podrían utilizar la AIID para ver si hay algún problema potencial antes de emplear sistemas de recomendación de IA, o un ingeniero de IA podría obtener una idea de los posibles sesgos que deben corregirse al crear la aplicación de IA. De la misma manera, los oficiales de riesgos podrían utilizar la base de datos para determinar los efectos secundarios negativos potenciales asociados con un modelo de IA, lo que les permite planificar y desarrollar medidas para mitigar los daños potenciales.

La arquitectura subyacente de la AIID está diseñada para ser flexible, lo que permite la creación de nuevas herramientas para consultar la base de datos y extraer información significativa. La Partnership on AI y McGregor colaborarán para ingeniar una taxonomía flexible que se pueda utilizar para clasificar todas las formas de incidentes de IA. El equipo espera que, una vez creada la taxonomía flexible, se pueda combinar con un sistema automatizado que registre automáticamente los incidentes de IA.

“La comunidad de IA ha comenzado a compartir registros de incidentes entre sí para motivar cambios en sus productos, procedimientos de control y programas de investigación”, explicó McGregor a través de TechTalks. “El sitio se lanzó públicamente en noviembre, así que estamos apenas comenzando a realizar los beneficios del sistema”.